Layer-Wise High-Impact Parameter Ratio Optimization in Post-Training Quantization for Large Language Models

作者: Cuong Pham, Hoang Anh Dung, Cuong C. Nguyen, Trung Le, Gustavo Carneiro, Thanh-Toan Do

分类: cs.LG

发布日期: 2025-11-21

💡 一句话要点

提出层级高影响参数比率优化以解决LLM量化问题

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 后训练量化 高影响参数 大型语言模型 二次优化 计算效率 模型准确性 自然语言处理

📋 核心要点

- 现有的后训练量化方法在极低位宽下会导致显著的准确性损失,未能有效处理高影响参数的层级差异。

- 本文提出了一种二次优化框架,针对每一层的高影响参数比率进行优化,考虑层间的依赖关系。

- 实验结果表明,所提方法在资源受限的情况下,能够保留更多高影响参数,且在量化后的模型中性能损失微乎其微。

📝 摘要(中文)

大型语言模型(LLMs)在自然语言处理领域取得了显著进展,但其庞大的参数量在部署时带来了计算和内存挑战。后训练量化(PTQ)作为一种有效的解决方案,能够在最小开销下缓解这些问题。然而,现有PTQ方法在极低位宽下会遭遇显著的准确性损失,主要是由于高影响参数对量化性能的重大影响。本文提出了一种二次优化框架,能够确定层级特定的高影响参数比率,并考虑层间依赖性,从而在保持高性能的同时,优化计算效率。

🔬 方法详解

问题定义:本文旨在解决大型语言模型在后训练量化过程中由于高影响参数导致的准确性损失问题。现有方法通常采用固定的高影响参数比率,未能考虑不同层的敏感性差异。

核心思路:提出一种二次优化框架,针对每一层的高影响参数比率进行动态调整,以最大限度地保留重要参数,同时降低其他参数的位宽。

技术框架:整体架构包括高影响参数的识别、层级比率的优化、以及量化过程的实施。首先识别高影响参数,然后通过优化算法确定每层的比率,最后进行量化。

关键创新:最重要的创新在于引入层级特定的高影响参数比率优化,突破了以往方法的局限,能够更灵活地应对不同层的特性。

关键设计:在优化过程中,采用了二次损失函数来平衡高影响参数与其他参数的量化策略,同时设计了高效的量化算法以降低计算复杂度。具体的参数设置和网络结构细节在实验部分进行了详细描述。

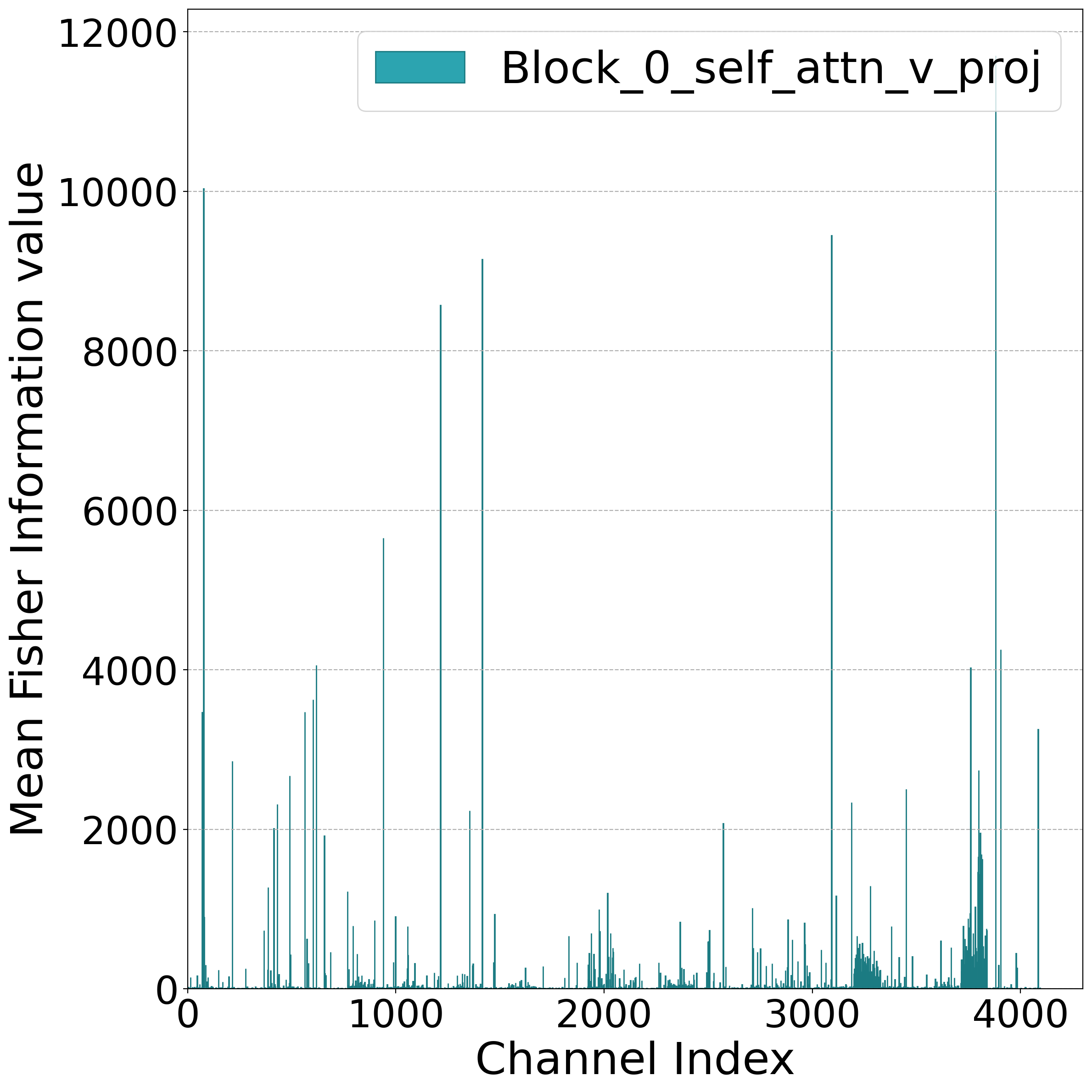

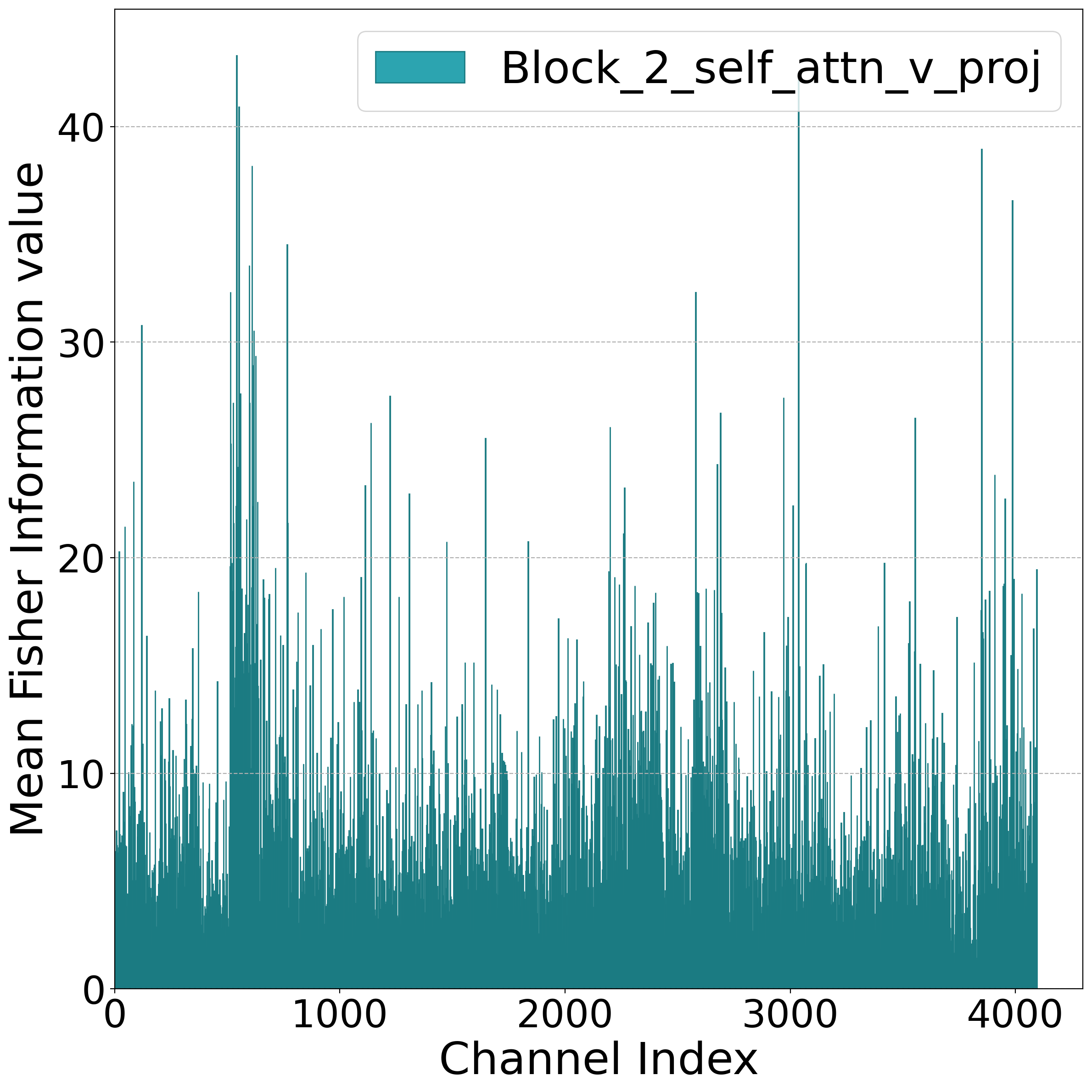

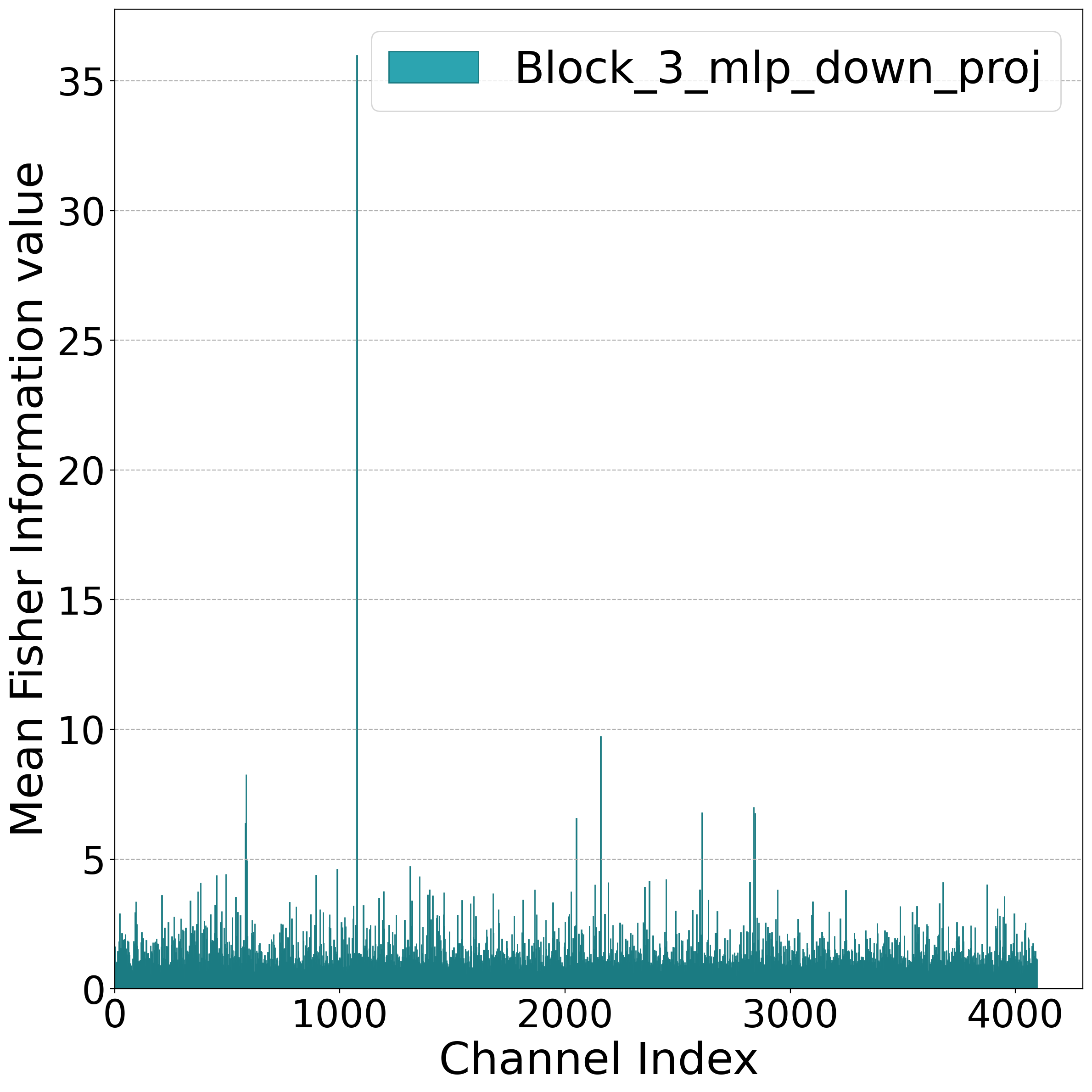

🖼️ 关键图片

📊 实验亮点

实验结果显示,所提方法在与现有最先进技术的对比中,能够在相同资源预算下保留更多高影响参数,且量化后的模型性能损失低于5%。这一成果显著提升了大型语言模型的实用性和效率。

🎯 应用场景

该研究的潜在应用领域包括自然语言处理、智能对话系统和机器翻译等。通过优化大型语言模型的量化过程,可以在资源受限的环境中实现高效的模型部署,提升实际应用的可行性和性能。

📄 摘要(原文)

Large language models (LLMs) have significantly advanced natural language processing, but their massive parameter counts create substantial computational and memory challenges during deployment. Post-training quantization (PTQ) has emerged as a promising approach to mitigate these challenges with minimal overhead. While existing PTQ methods can effectively quantize LLMs, they experience substantial accuracy loss at extremely low bit-widths, primarily due to high-impact parameters that significantly influence quantization performance. Several approaches address these issues by identifying and retaining the high-impact parameters in FP16 format. However, they apply fixed ratios of high-impact parameters across all layers, overlooking layer-wise sensitivity variations. In this paper, we propose a quadratic optimization framework that determines layer-specific ratios of high-impact parameters while considering inter-layer dependencies. We quantize high-impact parameters to moderate bit-widths, which often result in negligible performance degradation in quantized LLMs, while the remaining parameters can be quantized to extremely low bit-widths. Under the same resource-constrained budget, this allows for preserving more high-impact parameters than methods that keep selecting a few in FP16 format. Additionally, the proposed framework allows us to leverage an advanced quantization method that often requires extensive learnable parameters solely for high-impact parameters, while applying a computationally efficient method to the rest. Our approach achieves an effective balance between computational efficiency and model accuracy while maintaining high performance compared to state-of-the-art methods.