PersonalizedRouter: Personalized LLM Routing via Graph-based User Preference Modeling

作者: Zhongjie Dai, Tao Feng, Jiaxuan You

分类: cs.LG

发布日期: 2025-11-21

💡 一句话要点

提出 PersonalizedRouter,通过图建模用户偏好实现个性化LLM路由。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 个性化推荐 大型语言模型 LLM路由 图神经网络 用户偏好建模

📋 核心要点

- 现有LLM选择方法难以捕捉用户个性化偏好,通常只优化单一目标(如性能或成本),缺乏从交互数据中学习的能力。

- PersonalizedRouter通过构建异构图来建模用户偏好,该图利用交互数据(任务上下文、查询、LLM、用户决策)进行个性化LLM选择。

- 实验表明,PersonalizedRouter在模拟和真实用户基准测试中显著优于现有方法,并在少样本学习方面表现出强大的泛化能力。

📝 摘要(中文)

随着具有不同能力和响应风格的大型语言模型(LLM)数量不断增长,用户拥有了更广泛的选择范围,但也给选择合适的LLM带来了挑战,因为用户在性能、成本和响应风格方面的偏好各不相同。现有的LLM选择方法通常针对单一固定目标进行优化,例如性能、成本或两者之间的权衡,并且无法从交互数据中学习个体用户偏好。为了解决这些局限性,我们提出了 PersonalizedRouter,这是一个基于图的框架,它通过利用包含任务上下文、查询、候选LLM和用户决策的交互数据来建模不同的用户画像并执行个性化的LLM选择。为了捕获用户查询和最佳LLM之间的上下文信息,PersonalizedRouter将交互数据转换为异构图,其中不同类型节点之间的关系由边表示。为了评估跨用户的适应性,我们设计了两种策略:多成本效率模拟策略和LLM-as-a-Judge策略。此外,我们构建了PersonaRoute-Bench,这是一个包含1000个模拟用户和10个LLM的大规模基准。实验结果表明,PersonalizedRouter显著优于现有的LLM选择方法,并且在两种模拟策略下,超越了最强的方法,分别提升了15.38%和9.83%。在拥有1000个用户的PersonaRoute-Bench上,它进一步超越了最佳方法,分别提升了16.19%和59.69%,同时保持了更高的效率。此外,PersonalizedRouter展示了强大的少样本泛化能力,在适应新用户和新LLM时,分别达到了完全训练模型性能的64.81%和85.80%。

🔬 方法详解

问题定义:现有LLM选择方法无法有效建模和利用用户的个性化偏好。它们通常只关注性能、成本等单一指标的优化,而忽略了用户在响应风格、特定任务上的偏好差异。这导致为所有用户推荐相同的LLM,无法满足不同用户的个性化需求。现有方法缺乏从用户交互数据中学习用户偏好的能力,难以适应用户的动态变化。

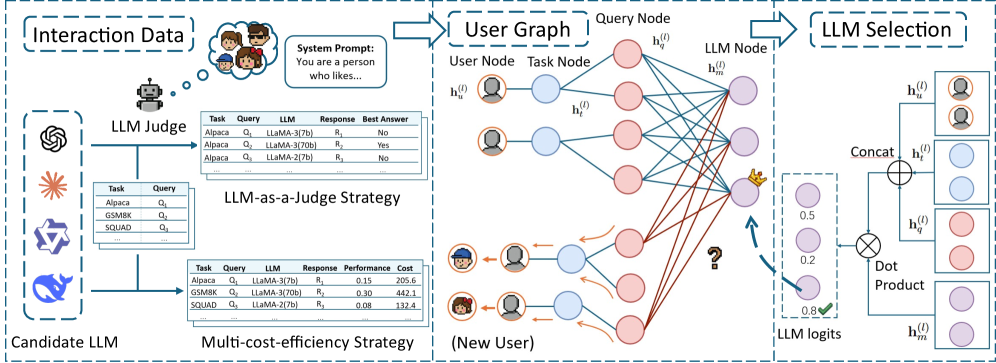

核心思路:PersonalizedRouter的核心思路是将用户与LLM的交互数据建模成一个异构图,其中节点代表用户、LLM和任务上下文,边代表用户对LLM在特定任务上下文下的选择。通过图神经网络学习节点表示,从而捕捉用户偏好和LLM的适用性。这种方法能够根据用户的历史交互行为,预测用户对不同LLM的偏好程度,从而实现个性化的LLM路由。

技术框架:PersonalizedRouter框架主要包含以下几个模块:1) 交互数据收集:收集用户与LLM的交互数据,包括用户ID、查询、任务上下文、候选LLM列表和用户选择的LLM。2) 异构图构建:将交互数据转换为异构图,节点类型包括用户、LLM和任务上下文,边表示用户对LLM的选择关系。3) 图神经网络学习:使用图神经网络(如GraphSAGE或GAT)学习图中节点的表示向量,捕捉用户偏好和LLM的适用性。4) LLM选择:根据学习到的节点表示,预测用户对不同LLM的偏好程度,选择最符合用户偏好的LLM。

关键创新:PersonalizedRouter的关键创新在于使用图结构来建模用户偏好和LLM的适用性。与传统的基于规则或单一指标的LLM选择方法相比,PersonalizedRouter能够更全面地捕捉用户偏好,并根据用户的历史交互行为进行个性化推荐。此外,该方法能够适应新的用户和LLM,具有较强的泛化能力。

关键设计:在异构图构建方面,需要仔细设计节点和边的类型,以充分表达用户偏好和LLM的适用性。例如,任务上下文可以表示为文本向量,用户可以表示为用户画像向量。在图神经网络学习方面,可以选择合适的图神经网络结构和损失函数,以有效学习节点表示。例如,可以使用对比学习损失来鼓励相似用户选择相似LLM,不同用户选择不同LLM。

🖼️ 关键图片

📊 实验亮点

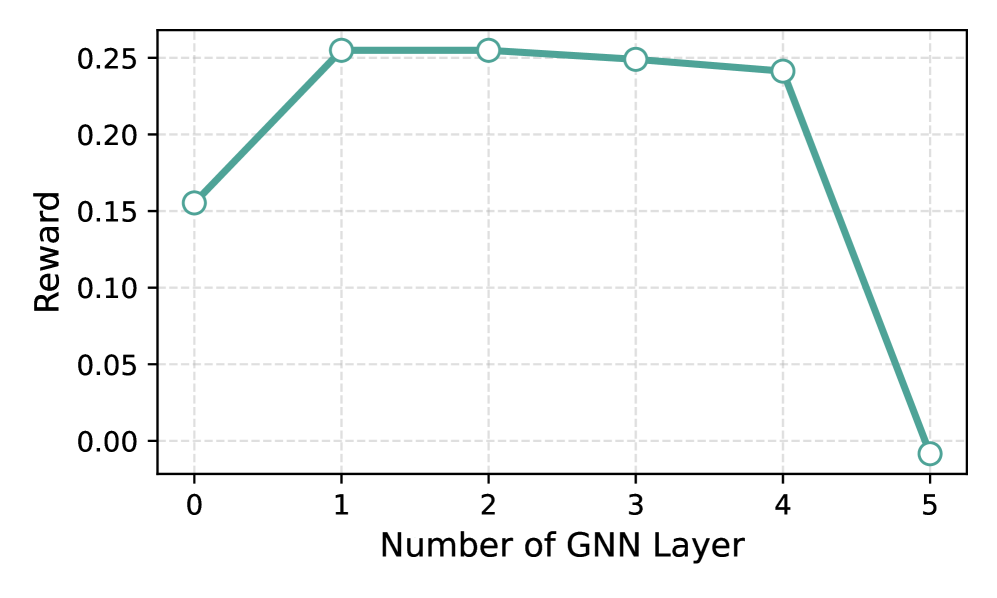

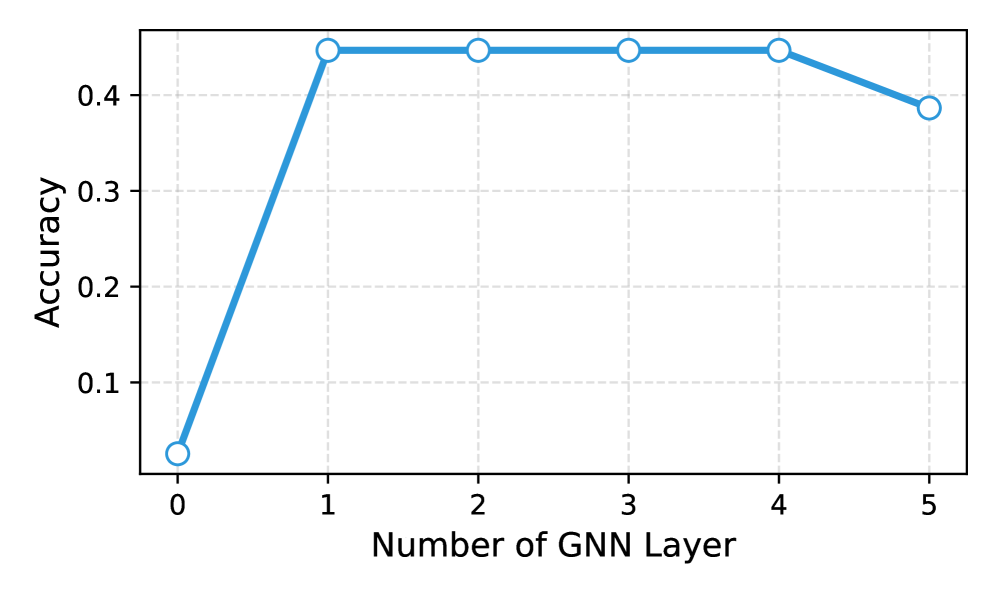

实验结果表明,PersonalizedRouter在PersonaRoute-Bench基准测试中显著优于现有方法,在两种模拟策略下分别提升了15.38%和9.83%。在包含1000个用户的PersonaRoute-Bench上,它进一步超越了最佳方法,分别提升了16.19%和59.69%,同时保持了更高的效率。此外,PersonalizedRouter展示了强大的少样本泛化能力,在适应新用户和新LLM时,分别达到了完全训练模型性能的64.81%和85.80%。

🎯 应用场景

PersonalizedRouter可应用于各种需要个性化LLM选择的场景,例如智能客服、内容生成、代码生成等。它可以根据用户的历史交互行为和偏好,选择最适合用户的LLM,提高用户满意度和效率。该研究的成果有助于构建更智能、更个性化的人工智能系统。

📄 摘要(原文)

The growing number of Large Language Models (LLMs) with diverse capabilities and response styles provides users with a wider range of choices, which presents challenges in selecting appropriate LLMs, as user preferences vary in terms of performance, cost, and response style. Current LLM selection methods typically optimize for a single fixed objective, such as performance, cost, or a trade-off between them, and fail to learn individual user preferences from interaction data. To address these limitations, we propose PersonalizedRouter, a graph-based framework that models diverse user profiles and performs personalized LLM selection by leveraging interaction data that includes task context, queries, candidate LLMs, and user decisions. To capture contextual information between user queries and optimal LLMs, PersonalizedRouter converts the interaction data into a heterogeneous graph, where the relationships between different types of nodes are represented by edges. To evaluate adaptability across users, we design two strategies: the multi-cost-efficiency simulation strategy and the LLM-as-a-Judge strategy. In addition, we construct PersonaRoute-Bench, a large-scale benchmark with 1,000 simulated users and 10 LLMs. Experimental results show that PersonalizedRouter significantly outperforms existing LLM selection methods and surpasses the strongest methods by a large margin of 15.38% and 9.83% under two simulation strategies. On the PersonaRoute-Bench with 1,000 users, it further surpasses the best methods by 16.19% and 59.69% while maintaining higher efficiency. Moreover, PersonalizedRouter demonstrates strong few-shot generalization, achieving 64.81% and 85.80% of the fully trained model's performance when adapting to new users and new LLMs.