Multi-Phase Spacecraft Trajectory Optimization via Transformer-Based Reinforcement Learning

作者: Amit Jain, Victor Rodriguez-Fernandez, Richard Linares

分类: cs.LG

发布日期: 2025-11-14

💡 一句话要点

提出基于Transformer的强化学习框架,解决航天器多阶段轨迹优化问题。

🎯 匹配领域: 支柱一:机器人控制 (Robot Control) 支柱二:RL算法与架构 (RL & Architecture)

关键词: 强化学习 Transformer 轨迹优化 航天器控制 多阶段任务

📋 核心要点

- 现有强化学习方法在航天动力学任务中通常需要为不同任务阶段设计独立的策略,限制了适应性和增加了操作复杂性。

- 论文提出一种基于Transformer的强化学习框架,通过单一策略架构统一多阶段轨迹优化,利用Transformer建模长期时序上下文的能力。

- 实验结果表明,该框架不仅在简单情况下匹配解析解,而且能够有效地学习跨动态变化体制的连贯控制策略。

📝 摘要(中文)

本文提出了一种基于Transformer的强化学习框架,用于统一多阶段轨迹优化问题,旨在解决航天器发射、上升、级分离和轨道进入等任务中,对具备跨动态变化体制的自适应策略的需求。该框架利用Transformer建模长期时序上下文的能力,通过将近端策略优化(PPO)与Gated Transformer-XL (GTrXL)架构相结合,消除了手动阶段切换,同时保持控制决策的稳定性。实验验证表明,该框架在单阶段基准测试中表现接近最优,并能有效学习跨动态变化体制的连贯控制策略,为可扩展的自主任务规划奠定基础,减少对特定阶段控制器的依赖,同时保持与安全关键验证协议的兼容性。

🔬 方法详解

问题定义:论文旨在解决航天器多阶段轨迹优化问题,例如发射、上升、级分离和轨道进入等。现有方法通常需要为每个阶段训练单独的强化学习策略,导致泛化能力差,且需要手动切换阶段,增加了复杂性。因此,需要一种能够处理不同动态体制,并能自动切换阶段的统一策略。

核心思路:论文的核心思路是利用Transformer架构强大的时序建模能力,将航天器多阶段轨迹优化问题视为一个序列决策问题。通过Transformer的自注意力机制,策略可以学习到不同阶段之间的依赖关系,从而实现跨阶段的连贯控制。此外,使用Gated Transformer-XL (GTrXL) 架构来处理更长的序列,并保持控制决策的稳定性。

技术框架:整体框架基于近端策略优化(PPO)算法。传统的PPO通常使用循环神经网络(RNN)来处理时序信息,而本文将其替换为Transformer编码器-解码器结构。该结构接收航天器的状态作为输入,通过Transformer编码器提取特征,然后通过解码器生成控制指令。GTrXL被用于增强Transformer处理长序列的能力,并使用门控机制来控制信息的流动。

关键创新:最重要的创新点在于使用Transformer架构来统一处理多阶段轨迹优化问题。与传统的基于RNN的方法相比,Transformer具有更强的时序建模能力和并行计算能力。此外,GTrXL架构的引入进一步提升了模型处理长序列的能力,并保证了控制决策的稳定性。这种方法避免了手动阶段切换,实现了端到端的自主控制。

关键设计:论文中使用了Gated Transformer-XL (GTrXL) 架构,该架构通过引入门控机制来控制信息的流动,从而避免了梯度消失问题,并提升了模型处理长序列的能力。损失函数采用PPO的裁剪损失函数,用于稳定策略更新。具体参数设置未知,但Transformer的层数、头数和隐藏层维度等参数会影响模型的性能。

🖼️ 关键图片

📊 实验亮点

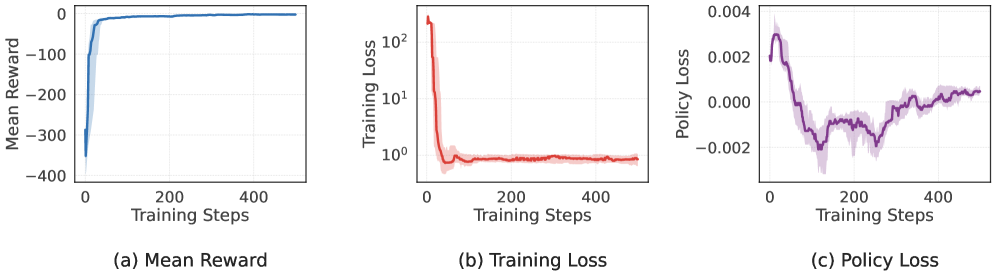

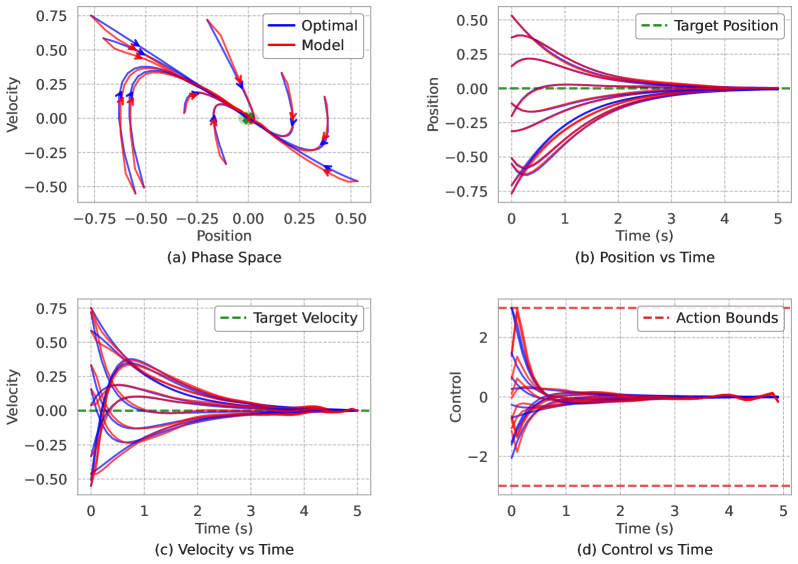

实验结果表明,该框架在单阶段基准测试(双积分器和范德波尔振荡器)中表现接近最优解。在多阶段航路点导航和火箭上升问题中,该框架能够有效地学习跨动态变化体制的连贯控制策略,并成功完成包括大气飞行、级分离和真空操作在内的复杂任务。具体性能数据未知,但结果表明该方法优于或至少匹配了传统方法。

🎯 应用场景

该研究成果可应用于航天器自主任务规划、卫星编队控制、深空探测等领域。通过减少对特定阶段控制器的依赖,降低了任务设计的复杂性,提高了航天器在复杂环境下的适应性和自主性。未来,该技术有望应用于更复杂的航天任务,例如空间碎片清除、在轨服务等。

📄 摘要(原文)

Autonomous spacecraft control for mission phases such as launch, ascent, stage separation, and orbit insertion remains a critical challenge due to the need for adaptive policies that generalize across dynamically distinct regimes. While reinforcement learning (RL) has shown promise in individual astrodynamics tasks, existing approaches often require separate policies for distinct mission phases, limiting adaptability and increasing operational complexity. This work introduces a transformer-based RL framework that unifies multi-phase trajectory optimization through a single policy architecture, leveraging the transformer's inherent capacity to model extended temporal contexts. Building on proximal policy optimization (PPO), our framework replaces conventional recurrent networks with a transformer encoder-decoder structure, enabling the agent to maintain coherent memory across mission phases spanning seconds to minutes during critical operations. By integrating a Gated Transformer-XL (GTrXL) architecture, the framework eliminates manual phase transitions while maintaining stability in control decisions. We validate our approach progressively: first demonstrating near-optimal performance on single-phase benchmarks (double integrator and Van der Pol oscillator), then extending to multiphase waypoint navigation variants, and finally tackling a complex multiphase rocket ascent problem that includes atmospheric flight, stage separation, and vacuum operations. Results demonstrate that the transformer-based framework not only matches analytical solutions in simple cases but also effectively learns coherent control policies across dynamically distinct regimes, establishing a foundation for scalable autonomous mission planning that reduces reliance on phase-specific controllers while maintaining compatibility with safety-critical verification protocols.