HealSplit: Towards Self-Healing through Adversarial Distillation in Split Federated Learning

作者: Yuhan Xie, Chen Lyu

分类: cs.LG, cs.AI

发布日期: 2025-11-14

备注: Accepted by AAAI 2026

💡 一句话要点

HealSplit:面向分割联邦学习,通过对抗蒸馏实现自愈的数据中毒防御。

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture)

关键词: 分割联邦学习 数据中毒攻击 对抗蒸馏 拓扑异常检测 自愈防御

📋 核心要点

- 分割联邦学习易受数据中毒攻击,现有防御方法在SFL中效果不佳,因为无法访问完整的模型更新。

- HealSplit通过拓扑感知检测、生成式恢复和对抗性多教师蒸馏,实现对SFL中毒攻击的端到端防御。

- 实验表明,HealSplit在多个数据集和攻击场景下,显著优于现有最先进的防御方法,具有更强的鲁棒性。

📝 摘要(中文)

分割联邦学习(SFL)是一种新兴的隐私保护分布式学习范式。然而,它仍然容易受到针对局部特征、标签、分割数据和模型权重的复杂数据中毒攻击。现有的防御方法主要从传统联邦学习(FL)改编而来,由于访问完整模型更新的权限有限,在SFL下效果较差。本文提出了HealSplit,这是第一个为SFL量身定制的统一防御框架,提供针对五种复杂中毒攻击的端到端检测和恢复。HealSplit包含三个关键组件:(1)拓扑感知检测模块,构建分割数据上的图,通过拓扑异常评分(TAS)识别中毒样本;(2)生成式恢复管道,合成检测到的异常的语义一致替代品,并通过一致性验证学生网络进行验证;(3)对抗性多教师蒸馏框架,使用来自Vanilla Teacher的语义监督和来自异常影响去偏(AD)Teacher的异常感知信号来训练学生网络,并由拓扑和基于梯度的交互矩阵之间的对齐来指导。在四个基准数据集上的大量实验表明,HealSplit始终优于十种最先进的防御方法,在不同的攻击场景中实现了卓越的鲁棒性和防御有效性。

🔬 方法详解

问题定义:分割联邦学习(SFL)面临严重的数据中毒攻击威胁,攻击者可以通过篡改局部数据(特征、标签等)来影响全局模型的性能。现有的联邦学习防御方法无法直接应用于SFL,因为SFL中客户端只拥有部分模型,无法获取完整的模型更新信息,这使得检测和防御中毒攻击变得更加困难。因此,需要一种专门为SFL设计的防御机制,能够有效地检测和恢复中毒数据,从而保证模型的鲁棒性。

核心思路:HealSplit的核心思路是通过构建一个自愈框架,实现对SFL中毒数据的检测和恢复。该框架包含三个关键模块:拓扑感知检测模块用于识别中毒样本;生成式恢复管道用于生成中毒样本的替代品;对抗性多教师蒸馏框架用于训练一个鲁棒的学生模型。通过这三个模块的协同工作,HealSplit能够有效地防御各种类型的数据中毒攻击。

技术框架:HealSplit的整体框架包括以下三个主要阶段: 1. 拓扑感知检测模块:该模块首先构建分割数据上的图结构,然后利用拓扑异常评分(TAS)识别中毒样本。 2. 生成式恢复管道:该模块使用生成模型合成检测到的异常样本的语义一致替代品,并通过一致性验证学生网络进行验证。 3. 对抗性多教师蒸馏框架:该模块使用Vanilla Teacher和Anomaly-Influence Debiasing (AD) Teacher,通过对抗蒸馏训练学生模型,并使用拓扑和梯度信息对齐来指导训练。

关键创新:HealSplit的关键创新在于其统一的防御框架,该框架集成了拓扑感知检测、生成式恢复和对抗性多教师蒸馏三个模块,实现了对SFL中毒攻击的端到端防御。此外,HealSplit还提出了Anomaly-Influence Debiasing (AD) Teacher,该教师模型能够提供异常感知信号,从而提高学生模型的鲁棒性。

关键设计: * 拓扑异常评分(TAS):通过分析分割数据图的拓扑结构,识别与其他样本差异较大的异常样本。 * 生成式恢复管道:使用GAN等生成模型生成中毒样本的替代品,保证替代品与原始样本具有相似的语义信息。 * 对抗性多教师蒸馏:使用Vanilla Teacher提供语义监督,AD Teacher提供异常感知信号,通过对抗训练提高学生模型的鲁棒性。 * 损失函数:使用交叉熵损失、KL散度损失等,保证学生模型能够学习到教师模型的知识,并具有一定的抗干扰能力。

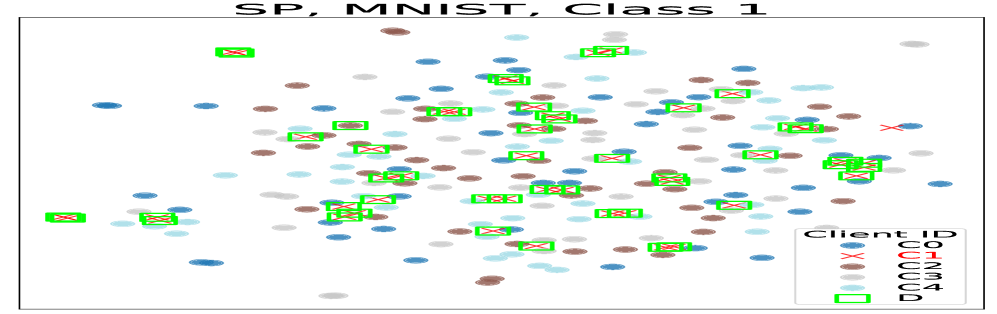

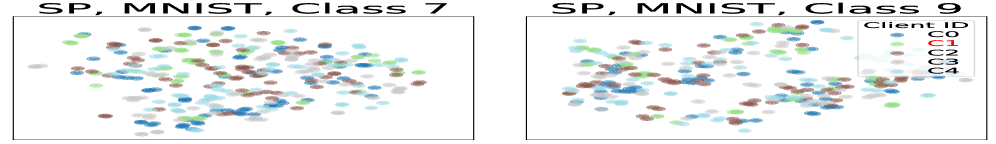

🖼️ 关键图片

📊 实验亮点

HealSplit在四个基准数据集上进行了广泛的实验,结果表明,HealSplit在各种攻击场景下均优于十种最先进的防御方法。例如,在某些攻击场景下,HealSplit的防御效果比现有方法提高了10%以上,证明了其卓越的鲁棒性和防御有效性。

🎯 应用场景

HealSplit可应用于各种隐私敏感的分布式学习场景,例如医疗健康、金融风控等。通过防御数据中毒攻击,HealSplit能够保证模型的安全性和可靠性,从而促进分割联邦学习在实际应用中的落地。未来,该研究可以扩展到更复杂的攻击场景,并与其他隐私保护技术相结合,构建更加安全的分布式学习系统。

📄 摘要(原文)

Split Federated Learning (SFL) is an emerging paradigm for privacy-preserving distributed learning. However, it remains vulnerable to sophisticated data poisoning attacks targeting local features, labels, smashed data, and model weights. Existing defenses, primarily adapted from traditional Federated Learning (FL), are less effective under SFL due to limited access to complete model updates. This paper presents HealSplit, the first unified defense framework tailored for SFL, offering end-to-end detection and recovery against five sophisticated types of poisoning attacks. HealSplit comprises three key components: (1) a topology-aware detection module that constructs graphs over smashed data to identify poisoned samples via topological anomaly scoring (TAS); (2) a generative recovery pipeline that synthesizes semantically consistent substitutes for detected anomalies, validated by a consistency validation student; and (3) an adversarial multi-teacher distillation framework trains the student using semantic supervision from a Vanilla Teacher and anomaly-aware signals from an Anomaly-Influence Debiasing (AD) Teacher, guided by the alignment between topological and gradient-based interaction matrices. Extensive experiments on four benchmark datasets demonstrate that HealSplit consistently outperforms ten state-of-the-art defenses, achieving superior robustness and defense effectiveness across diverse attack scenarios.