LoRaCompass: Robust Reinforcement Learning to Efficiently Search for a LoRa Tag

作者: Tianlang He, Zhongming Lin, Tianrui Jiang, S. -H. Gary Chan

分类: cs.LG

发布日期: 2025-11-14

💡 一句话要点

LoRaCompass:基于鲁棒强化学习的高效LoRa标签搜索方法

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture)

关键词: LoRa 强化学习 标签定位 鲁棒性 领域偏移 信号波动 UCB探索

📋 核心要点

- 现有基于强化学习的LoRa标签搜索方法易受领域偏移和信号波动影响,导致定位不准确。

- LoRaCompass通过学习鲁棒的空间表征和引入UCB探索函数,提升了搜索的鲁棒性和效率。

- 实验表明,LoRaCompass在定位精度和搜索效率上均优于现有方法,成功率提升40%。

📝 摘要(中文)

本文研究了在未知环境中,利用移动传感器以最少的移动次数定位周期性广播LoRa标签的序贯决策问题,该标签通常佩戴在有认知障碍或有走失风险的人员身上。现有方法虽然利用强化学习进行搜索,但易受领域偏移和信号波动的影响,导致决策误差累积,最终造成定位不准确。为此,我们提出了LoRaCompass,一种旨在实现LoRa标签鲁棒高效搜索的强化学习模型。为了在领域偏移和信号波动下进行有效利用,LoRaCompass通过空间感知特征提取器和策略蒸馏损失函数,学习从RSSI中提取鲁棒的空间表征,从而最大化向标签移动的概率。此外,它还引入了受上限置信区间(UCB)启发的探索函数,引导传感器以越来越高的置信度朝向标签移动。LoRaCompass已在超过80km^2的不同未见环境中,通过地面和无人机辅助场景进行了验证。它在100米范围内定位标签的成功率很高(>90%),比现有方法提高了40%,并且搜索路径长度(以跳数计)与初始距离呈线性关系。

🔬 方法详解

问题定义:论文旨在解决在未知环境中,如何利用移动传感器通过接收到的LoRa信号强度指示(RSSI)值,以最少的移动次数(hops)高效、准确地定位周期性广播的LoRa标签。现有方法的痛点在于,强化学习模型容易受到领域偏移和信号波动的影响,导致决策误差累积,最终定位精度不高。

核心思路:论文的核心思路是设计一个鲁棒的强化学习模型,使其能够从不稳定的RSSI信号中学习到可靠的空间表征,并有效地进行探索,从而克服领域偏移和信号波动带来的挑战。通过空间感知特征提取器学习RSSI的空间信息,并使用策略蒸馏损失函数来提高模型的泛化能力。同时,引入UCB探索策略,平衡探索和利用,引导传感器更快地找到目标。

技术框架:LoRaCompass的整体框架包含以下几个主要模块:1) 环境交互模块:移动传感器与环境交互,接收RSSI值并执行动作。2) 空间感知特征提取器:从RSSI值中提取空间特征,学习鲁棒的空间表征。3) 策略网络:根据提取的空间特征,输出下一步的动作策略。4) 探索函数:基于UCB算法,鼓励探索未知的区域。5) 奖励函数:根据传感器与标签的距离变化,给予奖励或惩罚。

关键创新:LoRaCompass的关键创新在于:1) 鲁棒的空间表征学习:通过空间感知特征提取器和策略蒸馏损失函数,学习对领域偏移和信号波动不敏感的空间表征。2) UCB探索策略:引入UCB探索函数,平衡探索和利用,提高搜索效率。3) 端到端强化学习:直接从RSSI信号到动作策略,无需人工特征工程。

关键设计:1) 空间感知特征提取器:可以使用卷积神经网络(CNN)或图神经网络(GNN)来提取RSSI的空间特征。2) 策略蒸馏损失函数:可以使用KL散度或交叉熵损失函数,将预训练模型的知识迁移到在线学习模型。3) UCB探索函数:可以使用UCB1算法或其变体,根据访问次数和奖励值来计算探索的置信上界。4) 奖励函数:可以设计为与传感器和标签之间的距离负相关,例如负距离或负距离的平方。

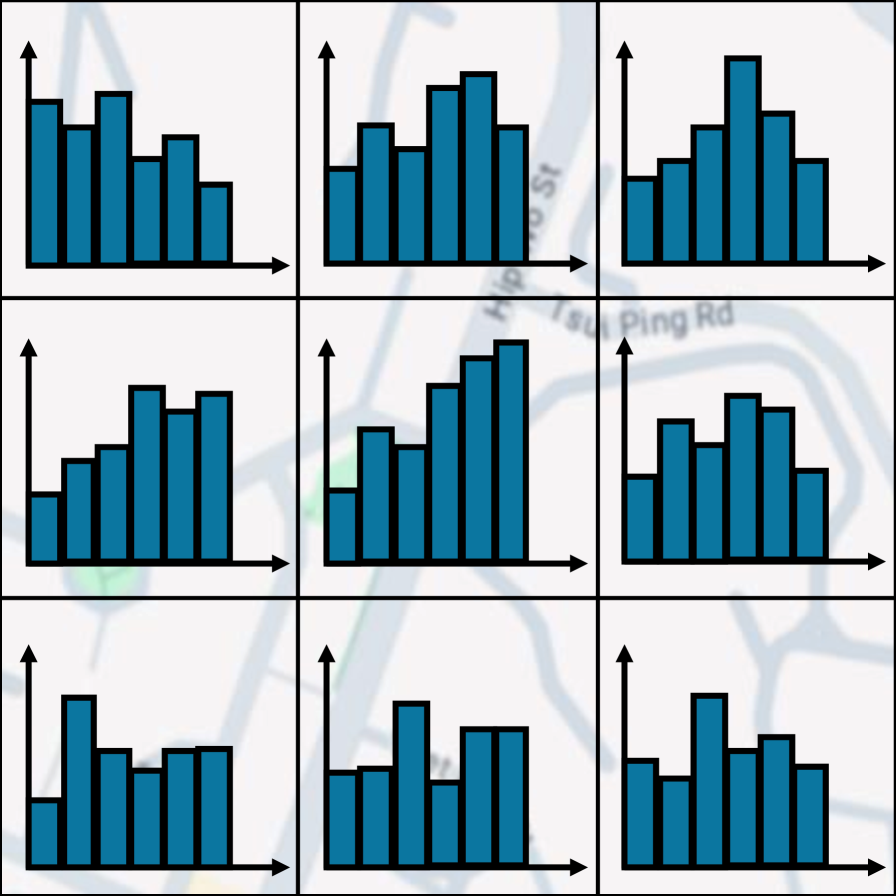

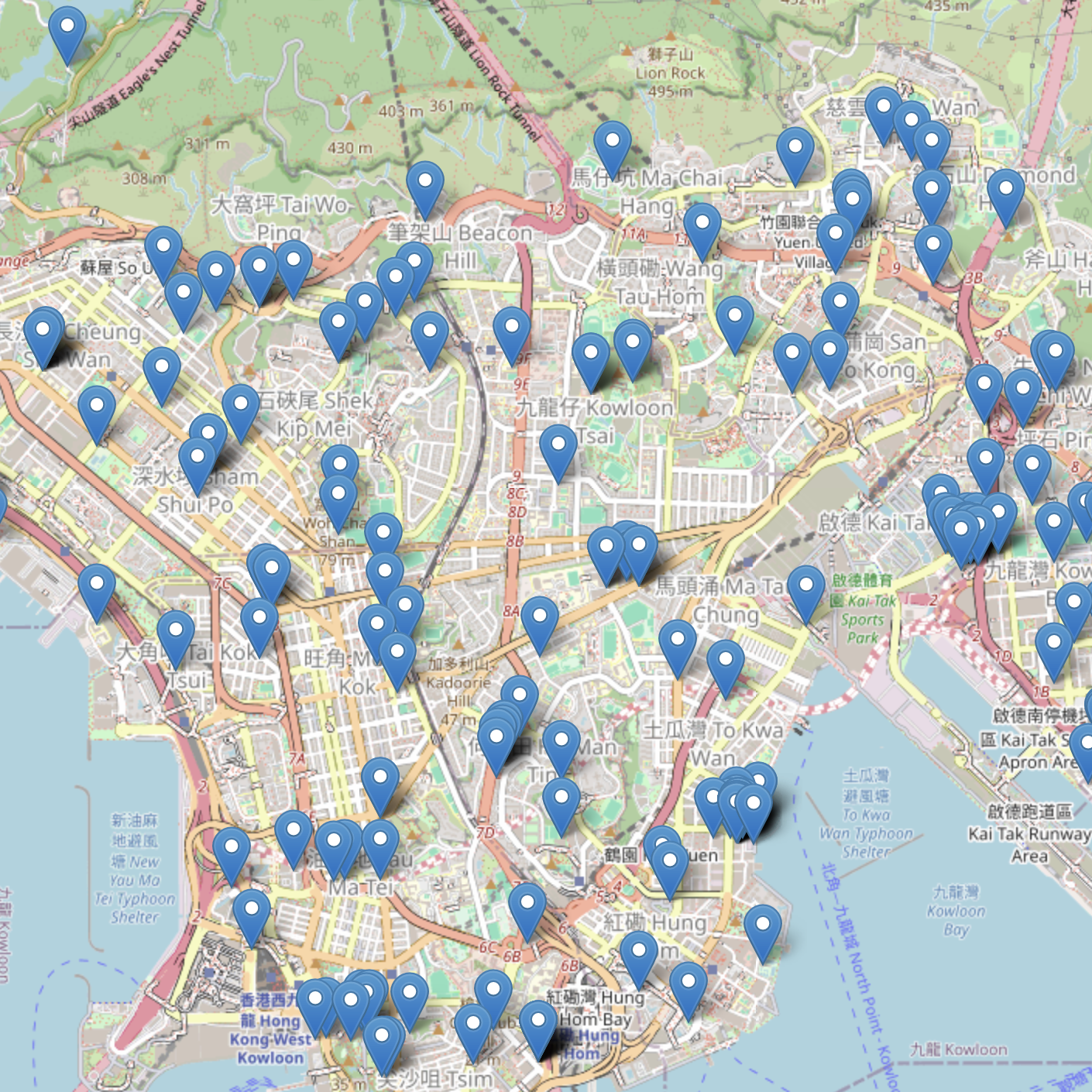

🖼️ 关键图片

📊 实验亮点

LoRaCompass在真实环境中进行了广泛的实验验证,覆盖超过80km^2的区域。实验结果表明,LoRaCompass在100米范围内定位标签的成功率超过90%,比现有方法提高了40%。此外,LoRaCompass的搜索路径长度(以跳数计)与初始距离呈线性关系,表明其具有很高的搜索效率。这些结果证明了LoRaCompass在实际应用中的有效性和优越性。

🎯 应用场景

LoRaCompass可应用于多种场景,例如搜寻走失人员(特别是患有认知障碍症的老人或儿童)、追踪资产、以及在灾难救援中定位幸存者。该技术能够有效降低搜寻成本,提高搜寻效率,具有重要的社会价值和经济效益。未来,可以进一步研究如何将LoRaCompass与其他传感器(如摄像头、激光雷达)融合,以实现更精确、更可靠的定位。

📄 摘要(原文)

The Long-Range (LoRa) protocol, known for its extensive range and low power, has increasingly been adopted in tags worn by mentally incapacitated persons (MIPs) and others at risk of going missing. We study the sequential decision-making process for a mobile sensor to locate a periodically broadcasting LoRa tag with the fewest moves (hops) in general, unknown environments, guided by the received signal strength indicator (RSSI). While existing methods leverage reinforcement learning for search, they remain vulnerable to domain shift and signal fluctuation, resulting in cascading decision errors that culminate in substantial localization inaccuracies. To bridge this gap, we propose LoRaCompass, a reinforcement learning model designed to achieve robust and efficient search for a LoRa tag. For exploitation under domain shift and signal fluctuation, LoRaCompass learns a robust spatial representation from RSSI to maximize the probability of moving closer to a tag, via a spatially-aware feature extractor and a policy distillation loss function. It further introduces an exploration function inspired by the upper confidence bound (UCB) that guides the sensor toward the tag with increasing confidence. We have validated LoRaCompass in ground-based and drone-assisted scenarios within diverse unseen environments covering an area of over 80km^2. It has demonstrated high success rate (>90%) in locating the tag within 100m proximity (a 40% improvement over existing methods) and high efficiency with a search path length (in hops) that scales linearly with the initial distance.