CAT-Net: A Cross-Attention Tone Network for Cross-Subject EEG-EMG Fusion Tone Decoding

作者: Yifan Zhuang, Calvin Huang, Zepeng Yu, Yongjie Zou, Jiawei Ju

分类: cs.SD, cs.LG, q-bio.NC

发布日期: 2025-11-14

备注: This is the extended version with technical appendices. The version of record appears in AAAI-26. Please cite the AAAI version

💡 一句话要点

CAT-Net:一种用于跨个体脑电-肌电融合声调解码的跨注意力网络

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 脑机接口 语音解码 脑电信号 肌电信号 跨注意力机制 领域对抗训练 多模态融合

📋 核心要点

- 现有语音BCI解码方法在处理普通话声调分类时面临挑战,因为声调的细微变化难以区分,且跨个体差异显著。

- 该论文提出了一种基于跨注意力机制的CAT-Net,融合脑电(EEG)和肌电(EMG)信号,以提升普通话声调解码的准确性和跨个体泛化能力。

- 实验结果表明,CAT-Net在可听和无声语音条件下均优于现有方法,且在跨个体评估中仍保持较高准确率,验证了其有效性。

📝 摘要(中文)

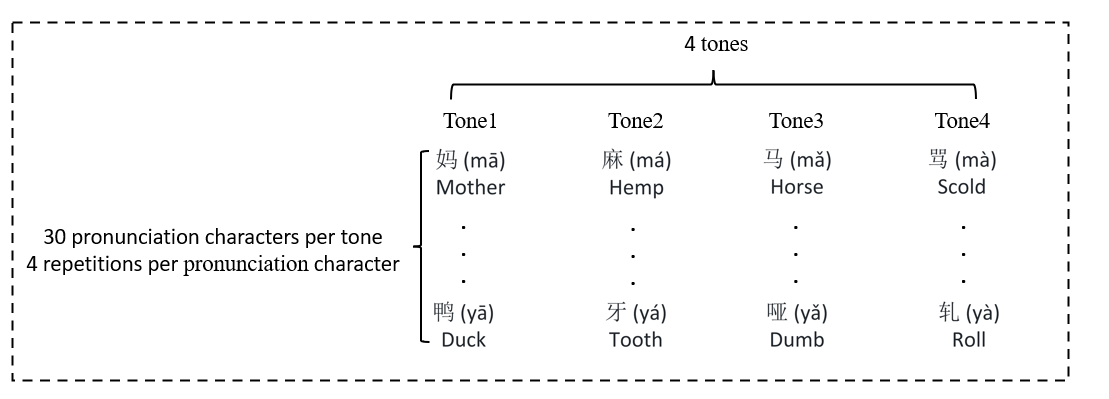

脑机接口(BCI)语音解码已成为辅助言语障碍人士的一种有前景的工具。脑电图(EEG)和肌电图(EMG)信号的融合为提高解码性能提供了强大的潜力。普通话声调分类提出了特殊的挑战,因为即使音素相同,声调变化也会传达不同的含义。本研究提出了一种新的跨个体多模态BCI解码框架,该框架融合了EEG和EMG信号,用于在可听和无声语音条件下对四种普通话声调进行分类。受到神经和肌肉系统在语音产生中的协同机制的启发,我们的神经解码架构将时空特征提取分支与跨注意力融合机制相结合,从而实现模态之间信息丰富的交互。我们进一步结合领域对抗训练来提高跨个体泛化能力。我们仅使用20个EEG通道和5个EMG通道从10名参与者收集了4800个EEG试验和4800个EMG试验,证明了最小通道解码的可行性。尽管采用了轻量级模块,但我们的模型在所有条件下均优于最先进的基线,在可听语音和无声语音下的平均分类准确率分别为87.83%和88.08%。在跨个体评估中,它仍然保持着强大的性能,在可听和无声语音下的准确率分别为83.27%和85.10%。我们进一步进行了消融研究,以验证每个组件的有效性。我们的研究结果表明,使用最少的EEG-EMG通道进行声调级解码是可行且可能跨个体泛化的,有助于开发实用的BCI应用。

🔬 方法详解

问题定义:论文旨在解决跨个体普通话声调脑机接口解码问题。现有方法难以有效融合脑电(EEG)和肌电(EMG)信号,且跨个体泛化能力较弱,导致解码准确率不高。尤其是在声调识别上,细微的声调变化难以捕捉,对解码精度提出了更高的要求。

核心思路:论文的核心思路是模拟神经和肌肉系统在语音产生中的协同机制,通过跨注意力机制实现EEG和EMG信号的有效融合。同时,采用领域对抗训练来减小个体差异,提高模型的跨个体泛化能力。这种设计旨在充分利用不同模态的信息互补性,并提升模型的鲁棒性。

技术框架:整体框架包含三个主要部分:1) 时空特征提取分支:分别从EEG和EMG信号中提取时空特征。2) 跨注意力融合机制:利用跨注意力模块,学习EEG和EMG特征之间的相关性,实现信息融合。3) 领域对抗训练:通过领域判别器和梯度反转层,使模型学习领域不变的特征,从而提高跨个体泛化能力。

关键创新:该论文的关键创新在于提出了跨注意力融合机制,能够自适应地学习EEG和EMG信号之间的相关性,从而更有效地融合多模态信息。此外,结合领域对抗训练,显著提升了模型的跨个体泛化能力,使其在不同个体之间具有更好的适应性。

关键设计:在网络结构上,采用了轻量级的卷积神经网络和循环神经网络进行时空特征提取。跨注意力模块使用多头注意力机制,以捕捉不同角度的模态间关系。领域对抗训练采用梯度反转层和领域判别器,损失函数包括分类损失和领域对抗损失,通过调整两个损失的权重来平衡分类准确率和领域不变性。

🖼️ 关键图片

📊 实验亮点

该研究提出的CAT-Net模型在普通话声调解码任务上取得了显著成果。在可听语音和无声语音条件下,平均分类准确率分别达到87.83%和88.08%,优于现有最先进的基线方法。在跨个体评估中,准确率分别达到83.27%和85.10%,表明该模型具有良好的跨个体泛化能力。消融实验验证了跨注意力融合机制和领域对抗训练的有效性。

🎯 应用场景

该研究成果可应用于开发辅助言语障碍人士的脑机接口系统,帮助他们恢复或改善语音交流能力。通过解码个体在无声或有声状态下的语音意图,可以实现文本生成或语音合成,从而提高他们的生活质量。此外,该技术还可应用于虚拟现实、游戏等领域,实现更自然、更直观的人机交互。

📄 摘要(原文)

Brain-computer interface (BCI) speech decoding has emerged as a promising tool for assisting individuals with speech impairments. In this context, the integration of electroencephalography (EEG) and electromyography (EMG) signals offers strong potential for enhancing decoding performance. Mandarin tone classification presents particular challenges, as tonal variations convey distinct meanings even when phonemes remain identical. In this study, we propose a novel cross-subject multimodal BCI decoding framework that fuses EEG and EMG signals to classify four Mandarin tones under both audible and silent speech conditions. Inspired by the cooperative mechanisms of neural and muscular systems in speech production, our neural decoding architecture combines spatial-temporal feature extraction branches with a cross-attention fusion mechanism, enabling informative interaction between modalities. We further incorporate domain-adversarial training to improve cross-subject generalization. We collected 4,800 EEG trials and 4,800 EMG trials from 10 participants using only twenty EEG and five EMG channels, demonstrating the feasibility of minimal-channel decoding. Despite employing lightweight modules, our model outperforms state-of-the-art baselines across all conditions, achieving average classification accuracies of 87.83% for audible speech and 88.08% for silent speech. In cross-subject evaluations, it still maintains strong performance with accuracies of 83.27% and 85.10% for audible and silent speech, respectively. We further conduct ablation studies to validate the effectiveness of each component. Our findings suggest that tone-level decoding with minimal EEG-EMG channels is feasible and potentially generalizable across subjects, contributing to the development of practical BCI applications.