On Flow Matching KL Divergence

作者: Maojiang Su, Jerry Yao-Chieh Hu, Sophia Pi, Han Liu

分类: cs.LG, cs.AI, cs.CV, stat.ML

发布日期: 2025-11-07

💡 一句话要点

推导Flow Matching KL散度的确定性上界,提升生成模型统计效率

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture)

关键词: Flow Matching KL散度 生成模型 统计效率 总变差距离

📋 核心要点

- 现有生成模型在统计效率方面存在挑战,尤其是在高维数据和复杂分布下。

- 论文提出了一种基于Flow Matching的KL散度上界分析方法,为理解和优化Flow Matching模型提供了理论基础。

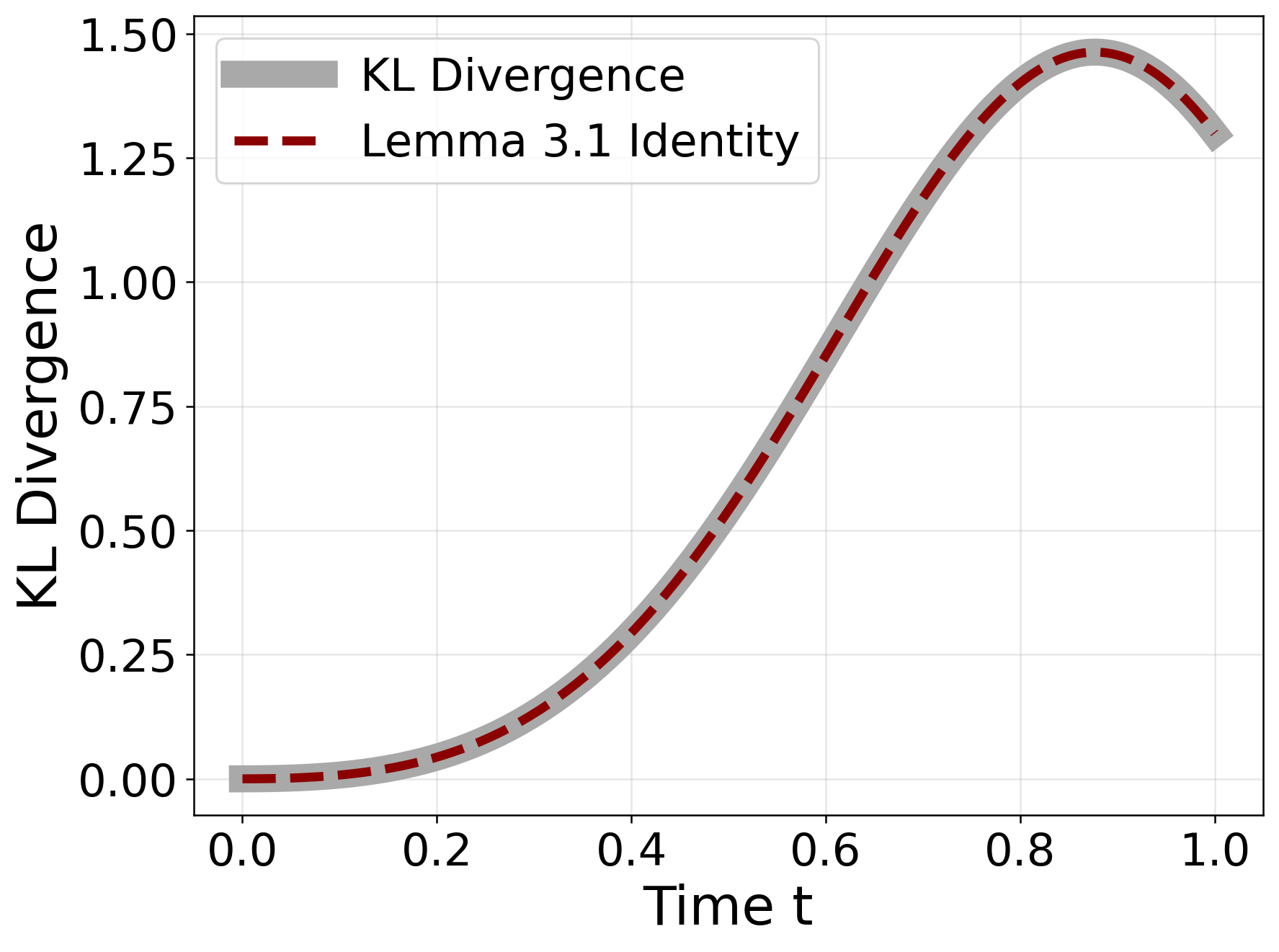

- 实验结果表明,Flow Matching在估计平滑分布时具有接近最优的效率,并验证了理论分析的有效性。

📝 摘要(中文)

本文推导了Flow Matching分布近似的Kullback-Leibler (KL)散度的确定性、非渐近上界。具体而言,如果$L_2$ Flow Matching损失以$ε^2 > 0$为界,那么真实数据分布和估计分布之间的KL散度以$A_1 ε+ A_2 ε^2$为界。其中,常数$A_1$和$A_2$仅取决于数据和速度场的规律性。因此,这个界限意味着Flow Matching Transformers在总变差(TV)距离下的统计收敛速度。我们证明了Flow Matching在估计平滑分布方面实现了接近minimax最优的效率。我们的结果使得Flow Matching的统计效率在TV距离下与扩散模型相当。对合成和学习速度的数值研究证实了我们的理论。

🔬 方法详解

问题定义:论文旨在解决Flow Matching模型在分布近似方面的统计效率问题。现有方法,如扩散模型,虽然取得了显著成果,但在理论分析和效率优化方面仍有改进空间。Flow Matching作为一种新兴的生成模型,其统计性质需要更深入的理解。

核心思路:论文的核心思路是通过推导Flow Matching分布近似的KL散度的确定性上界,来量化Flow Matching模型的统计效率。通过将KL散度与Flow Matching的损失函数联系起来,可以更好地理解模型性能,并为模型优化提供指导。

技术框架:论文的技术框架主要包括以下几个部分:首先,定义Flow Matching问题,并介绍相关的数学概念和符号。然后,推导Flow Matching分布近似的KL散度的上界,该上界与Flow Matching的损失函数相关。接着,分析该上界对Flow Matching Transformers在总变差距离下的统计收敛速度的影响。最后,通过数值实验验证理论结果。

关键创新:论文的关键创新在于推导了Flow Matching KL散度的确定性、非渐近上界。这个上界为理解Flow Matching模型的统计效率提供了新的视角,并为模型优化提供了理论依据。此外,论文还证明了Flow Matching在估计平滑分布方面具有接近minimax最优的效率。

关键设计:论文的关键设计包括:(1) 使用$L_2$ Flow Matching损失作为KL散度上界的约束条件;(2) 假设数据和速度场具有一定的规律性,以便推导KL散度的上界;(3) 分析KL散度上界对Flow Matching Transformers在总变差距离下的统计收敛速度的影响;(4) 通过合成数据和学习速度进行数值实验,验证理论结果。

🖼️ 关键图片

📊 实验亮点

论文通过数值实验验证了理论结果,表明Flow Matching在估计平滑分布时具有接近minimax最优的效率。实验结果与理论分析相符,为Flow Matching模型的实际应用提供了有力的支持。此外,论文还展示了Flow Matching Transformers在总变差距离下的统计收敛速度。

🎯 应用场景

该研究成果可应用于图像生成、音频合成、分子设计等领域。通过优化Flow Matching模型,可以提高生成模型的效率和质量,降低计算成本,并为实际应用提供更可靠的理论支持。未来,该研究可以进一步扩展到其他生成模型和更复杂的应用场景。

📄 摘要(原文)

We derive a deterministic, non-asymptotic upper bound on the Kullback-Leibler (KL) divergence of the flow-matching distribution approximation. In particular, if the $L_2$ flow-matching loss is bounded by $ε^2 > 0$, then the KL divergence between the true data distribution and the estimated distribution is bounded by $A_1 ε+ A_2 ε^2$. Here, the constants $A_1$ and $A_2$ depend only on the regularities of the data and velocity fields. Consequently, this bound implies statistical convergence rates of Flow Matching Transformers under the Total Variation (TV) distance. We show that, flow matching achieves nearly minimax-optimal efficiency in estimating smooth distributions. Our results make the statistical efficiency of flow matching comparable to that of diffusion models under the TV distance. Numerical studies on synthetic and learned velocities corroborate our theory.