Thought Branches: Interpreting LLM Reasoning Requires Resampling

作者: Uzay Macar, Paul C. Bogdan, Senthooran Rajamanoharan, Neel Nanda

分类: cs.LG, cs.AI, cs.CL

发布日期: 2025-10-31

备注: Uzay Macar and Paul C. Bogdan contributed equally to this work, and their listed order was determined by coinflip

💡 一句话要点

提出基于重采样的Thought Branches方法,用于更可靠地解释LLM的推理过程。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 大语言模型 思维链 可解释性 因果推断 重采样 模型干预 推理过程

📋 核心要点

- 现有方法仅分析单一思维链,无法充分理解LLM推理的因果关系和底层计算。

- 提出Thought Branches方法,通过对多个思维链进行重采样,研究LLM推理过程中的因果影响。

- 通过案例研究表明,重采样能够进行更可靠的因果分析,并实现有原则的思维链干预。

📝 摘要(中文)

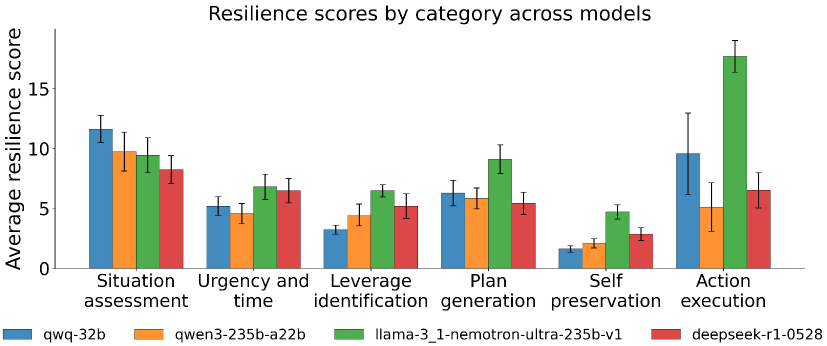

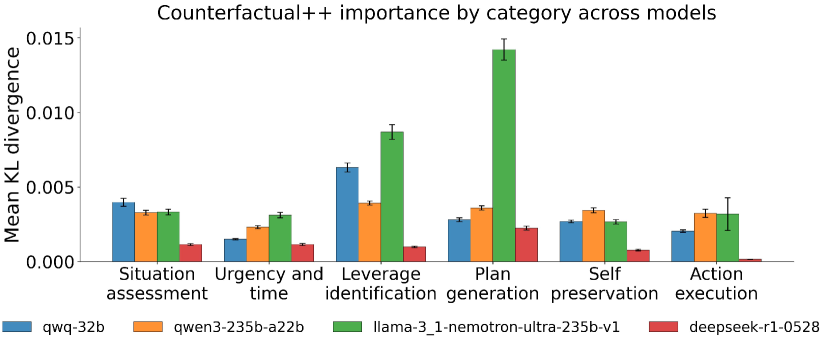

目前对推理模型的研究大多只关注单一的思维链(CoT),然而这些模型定义了许多可能的CoT的分布。我们认为,仅研究单个样本不足以理解因果影响和底层计算。虽然完全指定这个分布是不可行的,但可以通过采样来理解它。我们提出了使用重采样来研究模型决策的案例研究。首先,当模型陈述其行为的原因时,该原因是否真的导致了该行为?在“能动性错位”场景中,我们对特定句子进行重采样以衡量其下游影响。自保语句的因果影响很小,表明它们并没有真正驱动敲诈勒索行为。其次,对CoT的人工编辑是否足以指导推理?这些在文献中很常见,但会使模型脱离策略。重采样并选择具有所需属性的完成是原则上的on-policy替代方案。我们发现,与决策任务中的重采样相比,off-policy干预产生的影响很小且不稳定。第三,当模型可能在编辑后重复推理步骤时,我们如何理解删除推理步骤的效果?我们引入了一种弹性指标,该指标重复重采样以防止类似内容在下游重新出现。关键的计划语句可以抵抗删除,但在消除时会产生很大的影响。第四,由于CoT有时是“不忠实的”,我们的方法能在这个设置中教会我们什么吗?通过调整因果中介分析,我们发现对输出具有因果效应但未明确提及的提示对CoT产生微妙而累积的影响,即使删除了提示,这种影响仍然存在。总的来说,通过重采样研究分布可以实现可靠的因果分析、更清晰的模型推理叙述和有原则的CoT干预。

🔬 方法详解

问题定义:现有的大语言模型(LLM)推理研究通常只关注单个思维链(Chain-of-Thought, CoT),这无法充分反映模型内部推理过程的复杂性和不确定性。这种单一视角忽略了LLM实际上定义了一个关于多个可能CoT的分布。因此,基于单个CoT样本的分析可能导致对模型行为的误解,尤其是在理解因果关系和进行有效干预时。现有方法缺乏对整个CoT分布的考虑,限制了对模型推理过程的深入理解。

核心思路:该论文的核心思路是通过对LLM生成的多个CoT进行重采样,从而更全面地理解模型的推理过程。通过分析CoT分布,可以更准确地评估特定推理步骤的因果影响,并设计更有效的干预策略。重采样提供了一种在策略(on-policy)地探索模型行为的方式,避免了传统人工编辑CoT可能引入的偏差。

技术框架:该研究的技术框架主要围绕CoT的重采样和因果分析展开。具体包括以下几个阶段: 1. CoT生成:使用LLM生成初始的CoT推理过程。 2. 重采样:对CoT中的特定句子或步骤进行重采样,生成多个不同的CoT变体。 3. 因果分析:使用因果推断方法(如因果中介分析)评估重采样对模型输出的影响,从而确定特定推理步骤的因果效应。 4. 干预策略:基于因果分析的结果,设计有原则的CoT干预策略,例如通过移除或修改关键推理步骤来引导模型行为。

关键创新:该论文的关键创新在于: 1. 基于重采样的CoT分析:提出了一种新的分析LLM推理过程的方法,通过对CoT进行重采样来研究模型行为的分布,而非仅仅依赖于单个CoT样本。 2. 弹性指标:引入了一种弹性指标,用于评估移除推理步骤后,模型是否会重复类似内容,从而更准确地评估推理步骤的重要性。 3. 在策略干预:提出了一种在策略的CoT干预方法,通过重采样和选择来引导模型行为,避免了传统人工编辑CoT可能引入的偏差。

关键设计:论文中涉及的关键设计包括: 1. 重采样策略:如何选择需要重采样的句子或步骤,以及如何生成新的CoT变体。 2. 因果分析方法:如何选择合适的因果推断方法来评估重采样对模型输出的影响,例如使用因果中介分析来评估提示对CoT的间接影响。 3. 弹性指标的计算:如何定义和计算弹性指标,以评估移除推理步骤后,模型是否会重复类似内容。

🖼️ 关键图片

📊 实验亮点

论文通过案例研究展示了重采样的有效性。例如,在“能动性错位”场景中,发现自保语句的因果影响很小,表明它们并没有真正驱动敲诈勒索行为。在决策任务中,与off-policy干预相比,重采样产生了更大且更稳定的效果。此外,关键的计划语句可以抵抗删除,但在消除时会产生很大的影响。

🎯 应用场景

该研究成果可应用于提升LLM的可解释性和可控性,例如在医疗诊断、金融风控等高风险领域,可以帮助人们理解模型的推理过程,并确保模型做出合理的决策。此外,该方法还可以用于开发更有效的LLM干预策略,从而引导模型生成更符合人类期望的输出。

📄 摘要(原文)

Most work interpreting reasoning models studies only a single chain-of-thought (CoT), yet these models define distributions over many possible CoTs. We argue that studying a single sample is inadequate for understanding causal influence and the underlying computation. Though fully specifying this distribution is intractable, it can be understood by sampling. We present case studies using resampling to investigate model decisions. First, when a model states a reason for its action, does that reason actually cause the action? In "agentic misalignment" scenarios, we resample specific sentences to measure their downstream effects. Self-preservation sentences have small causal impact, suggesting they do not meaningfully drive blackmail. Second, are artificial edits to CoT sufficient for steering reasoning? These are common in literature, yet take the model off-policy. Resampling and selecting a completion with the desired property is a principled on-policy alternative. We find off-policy interventions yield small and unstable effects compared to resampling in decision-making tasks. Third, how do we understand the effect of removing a reasoning step when the model may repeat it post-edit? We introduce a resilience metric that repeatedly resamples to prevent similar content from reappearing downstream. Critical planning statements resist removal but have large effects when eliminated. Fourth, since CoT is sometimes "unfaithful", can our methods teach us anything in these settings? Adapting causal mediation analysis, we find that hints that have a causal effect on the output without being explicitly mentioned exert a subtle and cumulative influence on the CoT that persists even if the hint is removed. Overall, studying distributions via resampling enables reliable causal analysis, clearer narratives of model reasoning, and principled CoT interventions.