ECVL-ROUTER: Scenario-Aware Routing for Vision-Language Models

作者: Xin Tang, Youfang Han, Fangfei Gou, Wei Zhao, Xin Meng, Yang Yu, Jinguo Zhang, Yuanchun Shi, Yuntao Wang, Tengxiang Zhang

分类: cs.LG, cs.HC

发布日期: 2025-10-31

备注: 23 pages, 13 figures, 7 tables

💡 一句话要点

提出ECVL-ROUTER,针对不同场景需求动态路由视觉-语言模型。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 视觉-语言模型 场景感知路由 多模态学习 边缘计算 模型选择

📋 核心要点

- 现有视觉-语言模型通常依赖单一模型处理所有请求,忽略了不同场景下用户对速度、质量和能耗的差异化需求。

- ECVL-ROUTER 提出场景感知的路由框架,根据用户需求动态选择大型云端模型或小型边缘模型,优化整体效用。

- 实验结果表明,该方法能将超过80%的查询路由到小型模型,同时保证问题解决概率下降小于10%。

📝 摘要(中文)

视觉-语言模型(VLMs)在各种多模态任务中表现出色。然而,用户需求因场景而异,可以分为快速响应、高质量输出和低能耗。仅仅依靠部署在云端的大型模型来处理所有查询通常会导致高延迟和能源成本,而部署在边缘设备上的小型模型能够以低延迟和能源成本处理更简单的任务。为了充分利用大型和小型模型的优势,我们提出了ECVL-ROUTER,这是第一个针对VLM的场景感知路由框架。我们的方法引入了一种新的路由策略和评估指标,该策略和指标基于用户需求为每个查询动态选择合适的模型,从而最大化整体效用。我们还构建了一个专门为路由器训练而定制的多模态响应质量数据集,并通过广泛的实验验证了该方法。结果表明,我们的方法成功地将超过80%的查询路由到小型模型,同时问题解决概率的下降不到10%。

🔬 方法详解

问题定义:现有视觉-语言模型(VLMs)部署方案未能充分考虑用户在不同场景下的差异化需求。简单地使用大型云端模型会导致高延迟和高能耗,而小型边缘模型虽然速度快、能耗低,但可能无法处理复杂的任务。因此,需要一种能够根据场景动态选择合适模型的方案。

核心思路:ECVL-ROUTER的核心思路是构建一个场景感知的路由框架,该框架能够根据用户需求(例如,快速响应、高质量输出、低能耗)和查询的特性,动态地将查询路由到合适的模型。这样既能保证复杂任务的解决质量,又能降低简单任务的延迟和能耗。

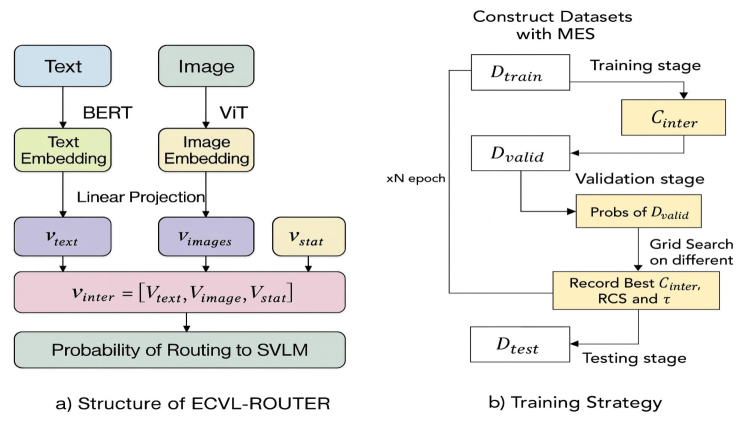

技术框架:ECVL-ROUTER框架包含以下主要模块:1) 特征提取模块:提取查询的特征,用于判断查询的复杂度和所需资源;2) 路由策略模块:根据提取的特征和用户需求,决定将查询路由到大型云端模型还是小型边缘模型;3) 模型执行模块:执行被选中的模型,并返回结果;4) 评估模块:评估模型的响应质量,用于优化路由策略。

关键创新:ECVL-ROUTER的关键创新在于其场景感知的路由策略。该策略不仅考虑了查询的复杂度,还考虑了用户对速度、质量和能耗的偏好。此外,论文还构建了一个专门用于路由器训练的多模态响应质量数据集,这为训练有效的路由策略提供了数据支持。

关键设计:路由策略的设计是ECVL-ROUTER的关键。论文可能使用了机器学习模型(例如,分类器或回归器)来预测查询的复杂度和所需资源。损失函数的设计需要平衡路由到小型模型的比例和问题解决概率的下降。数据集的构建需要覆盖各种场景和用户需求,并对响应质量进行准确的标注。

🖼️ 关键图片

📊 实验亮点

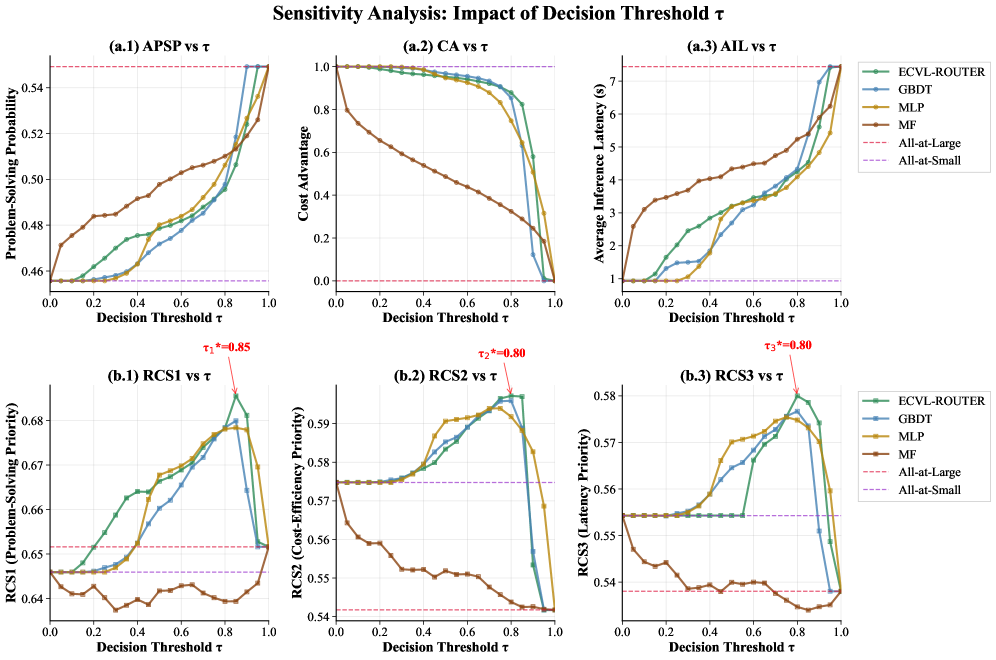

实验结果表明,ECVL-ROUTER能够成功地将超过80%的查询路由到小型模型,同时问题解决概率的下降小于10%。这表明该方法能够在保证服务质量的前提下,显著降低延迟和能耗。该方法优于静态路由策略,能够更好地适应不同场景下的用户需求。

🎯 应用场景

ECVL-ROUTER可应用于各种需要视觉-语言模型支持的场景,例如智能客服、自动驾驶、智能家居等。通过动态路由,可以根据用户需求和设备能力,优化响应速度、服务质量和能源消耗。未来,该技术有望推动视觉-语言模型在资源受限环境下的广泛应用。

📄 摘要(原文)

Vision-Language Models (VLMs) excel in diverse multimodal tasks. However, user requirements vary across scenarios, which can be categorized into fast response, high-quality output, and low energy consumption. Relying solely on large models deployed in the cloud for all queries often leads to high latency and energy cost, while small models deployed on edge devices are capable of handling simpler tasks with low latency and energy cost. To fully leverage the strengths of both large and small models, we propose ECVL-ROUTER, the first scenario-aware routing framework for VLMs. Our approach introduces a new routing strategy and evaluation metrics that dynamically select the appropriate model for each query based on user requirements, maximizing overall utility. We also construct a multimodal response-quality dataset tailored for router training and validate the approach through extensive experiments. Results show that our approach successfully routes over 80\% of queries to the small model while incurring less than 10\% drop in problem solving probability.