GraphKeeper: Graph Domain-Incremental Learning via Knowledge Disentanglement and Preservation

作者: Zihao Guo, Qingyun Sun, Ziwei Zhang, Haonan Yuan, Huiping Zhuang, Xingcheng Fu, Jianxin Li

分类: cs.LG, cs.AI

发布日期: 2025-10-30

备注: Accepted by the Main Track of NeurIPS-2025

💡 一句话要点

提出GraphKeeper,通过知识解耦与保持解决图领域增量学习中的灾难性遗忘问题。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 图增量学习 领域增量学习 知识解耦 知识保持 灾难性遗忘 图神经网络 图基础模型

📋 核心要点

- 现有图增量学习方法主要关注单领域内的任务或类别增量,无法有效应对跨多个图领域的知识更新挑战。

- GraphKeeper通过域特定参数高效微调、域内/域间解耦以及无偏差知识保持,来缓解嵌入偏移和决策边界偏差。

- 实验表明,GraphKeeper在图领域增量学习任务上取得了显著的性能提升,且能与多种图基础模型兼容。

📝 摘要(中文)

图增量学习(GIL)通过连续的知识获取来不断更新图模型,最近引起了人们的极大兴趣。然而,现有的GIL方法主要集中在单个领域内的任务增量和类增量场景。图领域增量学习(Domain-IL)旨在跨多个图领域更新模型,随着图基础模型(GFM)的发展,它变得至关重要,但在文献中仍未被探索。在本文中,我们提出了基于知识解耦和保持的图领域增量学习(GraphKeeper),从嵌入偏移和决策边界偏差的角度解决了Domain-IL场景中的灾难性遗忘问题。具体来说,为了防止增量图域之间的嵌入偏移和混淆,我们首先提出了特定于域的参数高效微调以及域内和域间解耦目标。因此,为了保持稳定的决策边界,我们引入了无偏差知识保持来持续适应增量域。此外,对于具有不可观察域的图,我们执行域感知分布判别以获得精确的嵌入。大量的实验表明,所提出的GraphKeeper实现了最先进的结果,与第二名相比,提高了6.5%~16.6%,且遗忘可忽略不计。此外,我们展示了GraphKeeper可以与各种具有代表性的GFM无缝集成,突出了其广泛的应用潜力。

🔬 方法详解

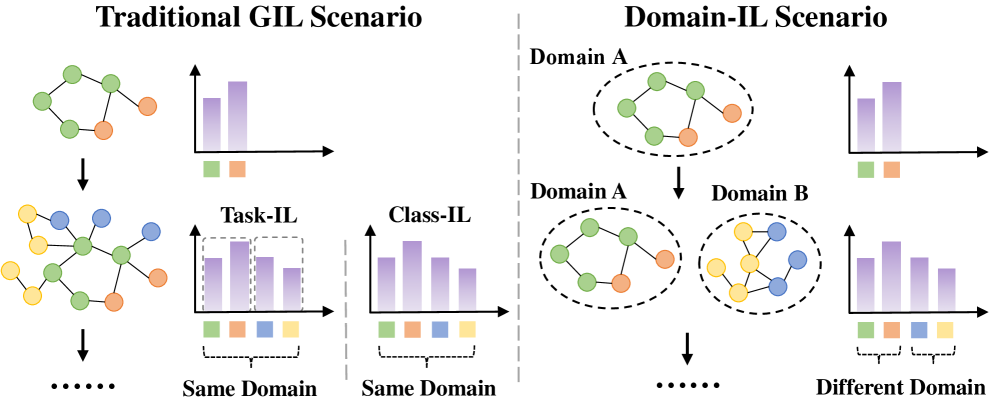

问题定义:论文旨在解决图领域增量学习(Domain-IL)中的灾难性遗忘问题。现有的图增量学习方法主要集中在单领域内的任务增量或类增量场景,无法有效应对跨多个图领域的知识更新,导致模型在学习新领域知识时,遗忘先前学习的知识。

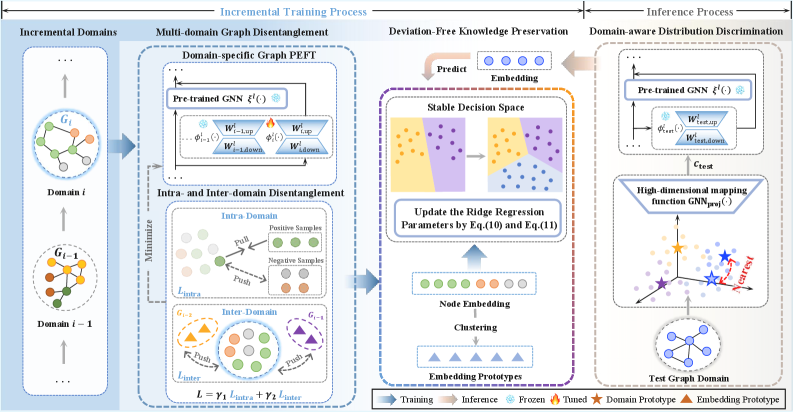

核心思路:GraphKeeper的核心思路是通过知识解耦和知识保持来缓解灾难性遗忘。具体来说,通过域特定参数高效微调来学习新领域的知识,同时利用域内和域间解耦目标来防止不同领域之间的嵌入混淆。此外,通过无偏差知识保持来稳定决策边界,避免模型在学习新知识时大幅改变先前学习的知识。

技术框架:GraphKeeper的整体框架包含以下几个主要模块:1) 域特定参数高效微调模块,用于学习新领域的知识;2) 域内解耦模块,用于减少同一领域内不同节点之间的特征耦合;3) 域间解耦模块,用于减少不同领域之间的特征耦合;4) 无偏差知识保持模块,用于稳定决策边界;5) 域感知分布判别模块(可选),用于处理具有不可观察域的图。

关键创新:GraphKeeper的关键创新在于:1) 首次提出了图领域增量学习问题,并针对该问题设计了相应的解决方案;2) 提出了域特定参数高效微调方法,能够在学习新知识的同时,避免对先前知识的过度修改;3) 提出了域内和域间解耦目标,能够有效减少不同领域之间的嵌入混淆;4) 提出了无偏差知识保持方法,能够稳定决策边界,避免模型在学习新知识时大幅改变先前学习的知识。

关键设计:在域特定参数高效微调中,论文采用了Adapter模块,只微调少量参数,从而避免对先前知识的过度修改。在域内解耦中,论文采用了对比学习损失,鼓励同一领域内的节点具有相似的嵌入。在域间解耦中,论文采用了对抗学习损失,鼓励不同领域之间的嵌入具有差异性。在无偏差知识保持中,论文采用了知识蒸馏损失,使得新模型能够学习到旧模型的知识。

🖼️ 关键图片

📊 实验亮点

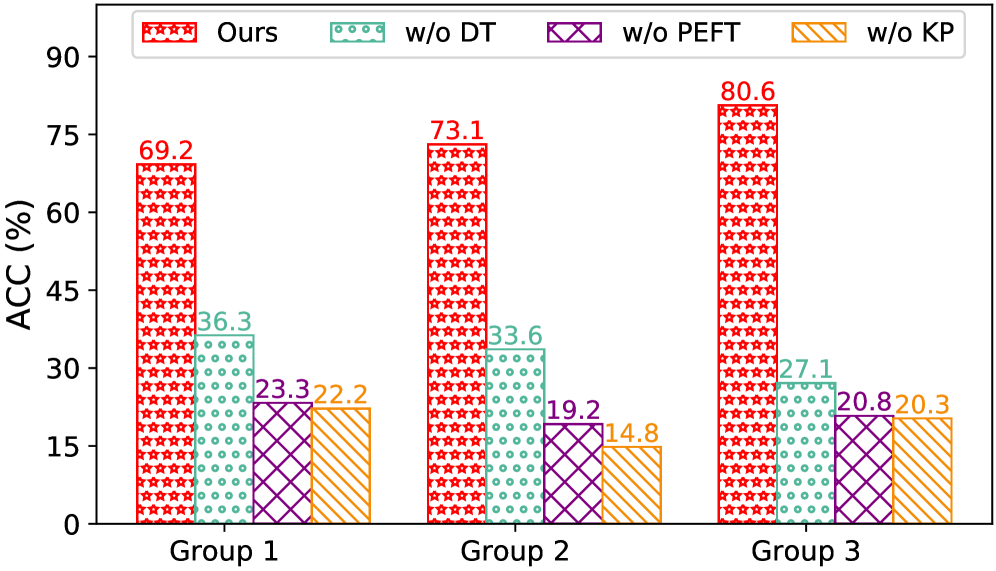

实验结果表明,GraphKeeper在图领域增量学习任务上取得了显著的性能提升,与第二名相比,平均提升了6.5%~16.6%,并且遗忘现象可以忽略不计。此外,GraphKeeper可以与各种具有代表性的图基础模型无缝集成,表明其具有广泛的应用潜力。

🎯 应用场景

GraphKeeper可应用于各种需要持续学习的图数据场景,例如社交网络分析、知识图谱更新、推荐系统等。通过不断学习新的图数据,模型可以更好地适应不断变化的环境,提供更准确、更可靠的服务。该研究对于构建具有持续学习能力的图基础模型具有重要意义。

📄 摘要(原文)

Graph incremental learning (GIL), which continuously updates graph models by sequential knowledge acquisition, has garnered significant interest recently. However, existing GIL approaches focus on task-incremental and class-incremental scenarios within a single domain. Graph domain-incremental learning (Domain-IL), aiming at updating models across multiple graph domains, has become critical with the development of graph foundation models (GFMs), but remains unexplored in the literature. In this paper, we propose Graph Domain-Incremental Learning via Knowledge Dientanglement and Preservation (GraphKeeper), to address catastrophic forgetting in Domain-IL scenario from the perspectives of embedding shifts and decision boundary deviations. Specifically, to prevent embedding shifts and confusion across incremental graph domains, we first propose the domain-specific parameter-efficient fine-tuning together with intra- and inter-domain disentanglement objectives. Consequently, to maintain a stable decision boundary, we introduce deviation-free knowledge preservation to continuously fit incremental domains. Additionally, for graphs with unobservable domains, we perform domain-aware distribution discrimination to obtain precise embeddings. Extensive experiments demonstrate the proposed GraphKeeper achieves state-of-the-art results with 6.5%~16.6% improvement over the runner-up with negligible forgetting. Moreover, we show GraphKeeper can be seamlessly integrated with various representative GFMs, highlighting its broad applicative potential.