CAS-Spec: Cascade Adaptive Self-Speculative Decoding for On-the-Fly Lossless Inference Acceleration of LLMs

作者: Zhiyuan Ning, Jiawei Shao, Ruge Xu, Xinfei Guo, Jun Zhang, Chi Zhang, Xuelong Li

分类: cs.LG, cs.AI

发布日期: 2025-10-30

备注: 10 pages, 3 figures, NeurIPS 2025 poster

💡 一句话要点

提出CAS-Spec,利用动态可切换推理加速策略加速LLM的无损推断。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 大型语言模型 推测解码 推理加速 动态稀疏 量化 自适应算法 模型优化

📋 核心要点

- 现有即时自推测解码方法在加速大型语言模型推理方面效果有限,无法达到专门训练模型的速度。

- CAS-Spec通过动态切换层稀疏性和激活量化等推理加速策略,构建级联的草稿模型,提升加速效果。

- 实验表明,CAS-Spec相比自回归解码平均加速1.1-2.3倍,DyTC算法比其他级联算法平均加速提升47%-48%。

📝 摘要(中文)

推测解码已成为部署大型语言模型(LLM)时一种广泛采用的有效无损推理加速技术。虽然即时自推测方法提供了无缝集成和广泛的实用性,但它们通常无法达到依赖专门训练的方法所能实现的速度增益。级联一个草稿模型层次结构有望进一步提高加速和灵活性,但训练多个模型的高成本限制了它的实际应用。本文提出了一种新的级联自适应自推测解码(CAS-Spec)方法,该方法通过利用动态可切换推理加速(DSIA)策略(包括层稀疏性和激活量化)来构建推测草稿模型。此外,传统的垂直和水平级联算法在应用于自推测解码方法时效率低下。我们引入了一种动态树级联(DyTC)算法,该算法基于接受率和延迟预测的启发式方法,自适应地路由多级草稿模型并分配草稿长度。与现有的即时推测解码方法相比,我们的CAS-Spec方法实现了最先进的加速,在各种LLM和数据集上的自回归解码的平均加速比为1.1倍到2.3倍。DyTC比基于级联的基线算法和基于树的基线算法分别提高了47%和48%的平均加速比。CAS-Spec可以轻松集成到大多数现有的LLM中,并且随着自推测解码技术的不断发展,具有进一步加速的潜力。

🔬 方法详解

问题定义:现有即时自推测解码方法虽然易于集成,但加速效果不如专门训练的模型。训练多个草稿模型进行级联可以进一步加速,但训练成本高昂,限制了其应用。因此,需要一种低成本且高效的即时自推测解码方法。

核心思路:CAS-Spec的核心思路是利用动态可切换推理加速(DSIA)策略,如层稀疏性和激活量化,来构建多个轻量级的草稿模型。通过动态调整这些策略,可以在不重新训练模型的情况下,获得不同复杂度的草稿模型,从而实现高效的级联推测解码。

技术框架:CAS-Spec包含两个主要部分:草稿模型构建和动态树级联(DyTC)算法。草稿模型构建阶段利用DSIA策略生成不同加速级别的草稿模型。DyTC算法则根据接受率和延迟预测,动态地选择合适的草稿模型和草稿长度,进行推测解码。

关键创新:CAS-Spec的关键创新在于:1) 利用DSIA策略动态构建草稿模型,避免了训练多个模型的成本;2) 提出了DyTC算法,能够自适应地路由多级草稿模型,并根据实时反馈调整草稿长度,提高了整体加速效果。

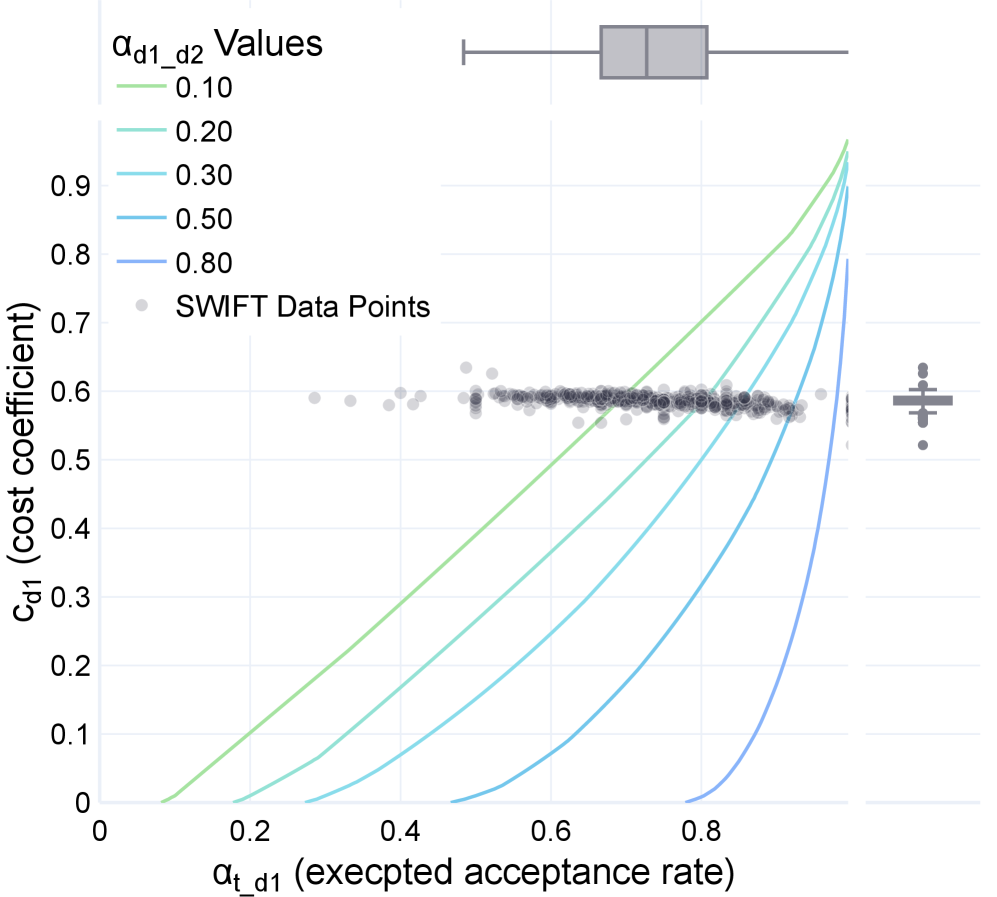

关键设计:DyTC算法的关键设计包括:1) 基于接受率和延迟预测的启发式路由策略,用于选择合适的草稿模型;2) 动态调整草稿长度的机制,以平衡推测的准确性和效率;3) 损失函数的设计,用于优化DSIA策略的参数,以提高草稿模型的预测精度。

🖼️ 关键图片

📊 实验亮点

CAS-Spec在多个LLM和数据集上进行了评估,结果表明,与自回归解码相比,平均加速比为1.1倍到2.3倍。DyTC算法比基于级联的基线算法和基于树的基线算法分别提高了47%和48%的平均加速比。这些结果表明,CAS-Spec在即时自推测解码方面取得了显著的性能提升。

🎯 应用场景

CAS-Spec可应用于各种需要加速LLM推理的场景,例如在线对话系统、文本生成、机器翻译等。该方法能够显著降低推理延迟,提高用户体验,并降低部署成本。随着自推测解码技术的不断发展,CAS-Spec具有进一步加速的潜力,有望成为LLM推理加速的重要解决方案。

📄 摘要(原文)

Speculative decoding has become a widely adopted as an effective technique for lossless inference acceleration when deploying large language models (LLMs). While on-the-fly self-speculative methods offer seamless integration and broad utility, they often fall short of the speed gains achieved by methods relying on specialized training. Cascading a hierarchy of draft models promises further acceleration and flexibility, but the high cost of training multiple models has limited its practical application. In this paper, we propose a novel Cascade Adaptive Self-Speculative Decoding (CAS-Spec) method which constructs speculative draft models by leveraging dynamically switchable inference acceleration (DSIA) strategies, including layer sparsity and activation quantization. Furthermore, traditional vertical and horizontal cascade algorithms are inefficient when applied to self-speculative decoding methods. We introduce a Dynamic Tree Cascade (DyTC) algorithm that adaptively routes the multi-level draft models and assigns the draft lengths, based on the heuristics of acceptance rates and latency prediction. Our CAS-Spec method achieves state-of-the-art acceleration compared to existing on-the-fly speculative decoding methods, with an average speedup from $1.1\times$ to $2.3\times$ over autoregressive decoding across various LLMs and datasets. DyTC improves the average speedup by $47$\% and $48$\% over cascade-based baseline and tree-based baseline algorithms, respectively. CAS-Spec can be easily integrated into most existing LLMs and holds promising potential for further acceleration as self-speculative decoding techniques continue to evolve.