A Novel XAI-Enhanced Quantum Adversarial Networks for Velocity Dispersion Modeling in MaNGA Galaxies

作者: Sathwik Narkedimilli, N V Saran Kumar, Aswath Babu H, Manjunath K Vanahalli, Manish M, Vinija Jain, Aman Chadha

分类: cs.LG, cs.CR

发布日期: 2025-10-28

💡 一句话要点

提出XAI增强的量子对抗网络,用于星系速度弥散建模

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture)

关键词: 量子机器学习 对抗网络 可解释性AI 星系速度弥散 混合神经网络

📋 核心要点

- 现有量子机器学习方法在预测精度、鲁棒性和可解释性之间难以取得平衡。

- 论文提出一种XAI增强的量子对抗网络,通过对抗评估器指导混合量子神经网络,优化预测精度和可解释性。

- 实验结果表明,Vanilla模型在回归指标上表现出最佳性能,验证了该方法在轻量级、高性能和可解释性方面的潜力。

📝 摘要(中文)

本文提出了一种新颖的量子对抗框架,旨在平衡量子机器学习方法在预测精度、鲁棒性和可解释性方面的挑战。该框架集成了混合量子神经网络(QNN)与经典深度学习层,并由基于LIME可解释性的评估器模型指导,同时扩展到量子GAN和自监督变体。在该模型中,对抗评估器通过计算反馈损失来并发地指导QNN,从而优化预测精度和模型可解释性。实验评估表明,Vanilla模型实现了RMSE = 0.27,MSE = 0.071,MAE = 0.21和R^2 = 0.59,在回归指标上表现出最一致的性能。这些结果证明了将量子启发方法与经典架构相结合以开发轻量级、高性能和可解释的预测模型的潜力,从而推动QML的应用超越当前限制。

🔬 方法详解

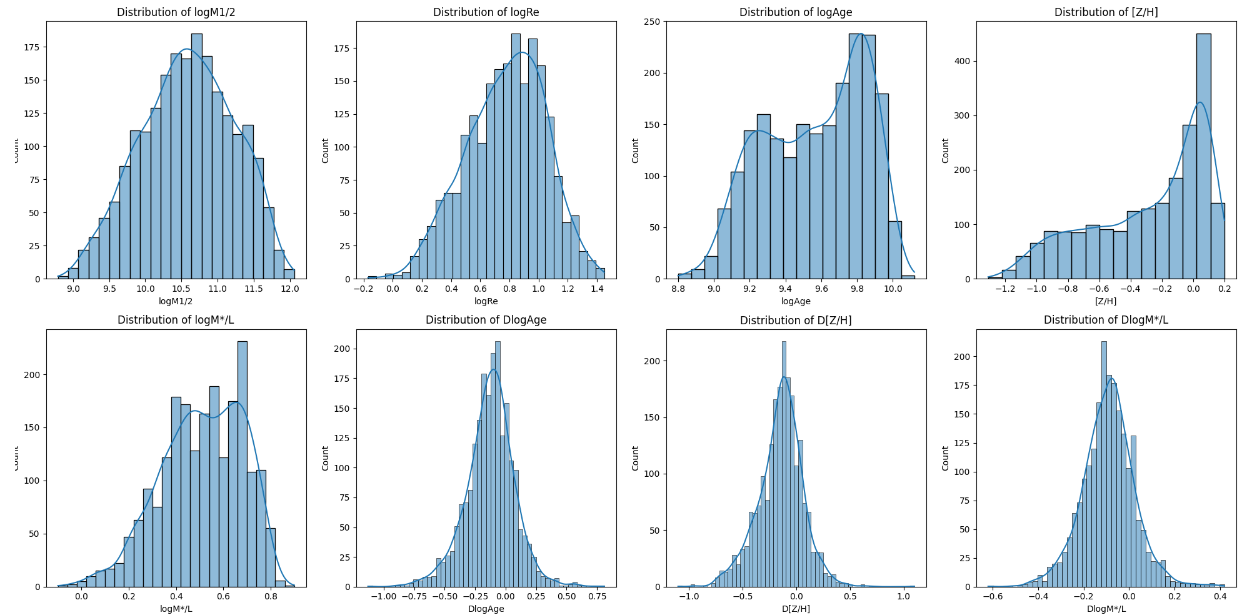

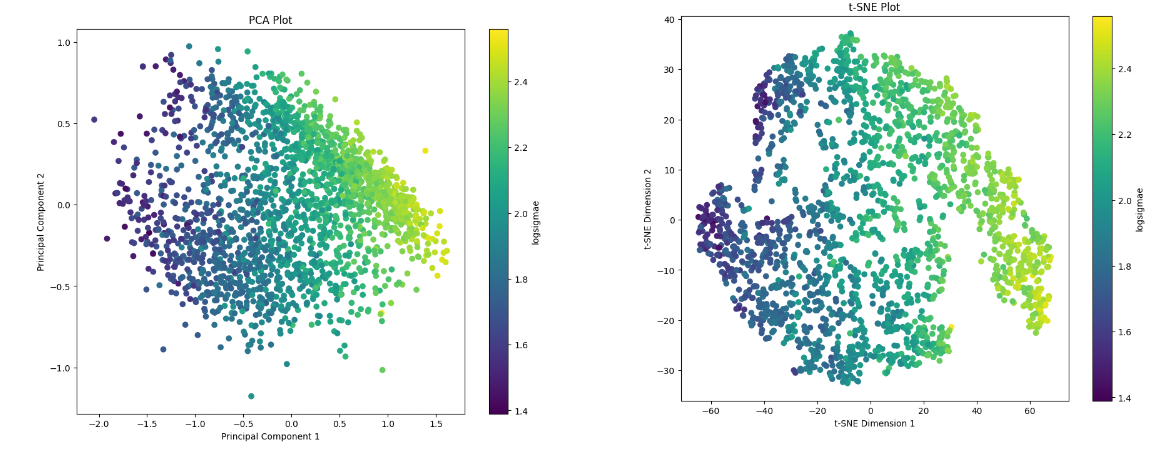

问题定义:论文旨在解决量子机器学习模型在预测精度、鲁棒性和可解释性之间难以平衡的问题。现有方法通常难以同时满足这三个方面的需求,限制了量子机器学习在实际问题中的应用。特别是在天文学领域,例如星系速度弥散建模,需要高精度和可解释的模型。

核心思路:论文的核心思路是通过引入对抗学习框架,利用一个对抗评估器来指导量子神经网络(QNN)的训练,从而在提高预测精度的同时,增强模型的可解释性。对抗评估器通过计算反馈损失来优化QNN,使其能够更好地学习数据的潜在特征。

技术框架:整体框架包含一个混合量子神经网络(QNN)作为生成器,一个经典深度学习层作为判别器(对抗评估器),以及一个基于LIME的可解释性模块。QNN负责进行预测,对抗评估器负责评估预测结果并提供反馈损失,LIME模块用于解释模型的预测结果。整个框架通过对抗训练的方式进行优化。

关键创新:最重要的技术创新点在于将对抗学习与量子神经网络相结合,并引入了基于LIME的可解释性模块。这种结合使得模型不仅具有较高的预测精度,还具有较好的可解释性,从而提高了模型在实际应用中的可靠性。此外,论文还探索了量子GAN和自监督变体。

关键设计:QNN的具体结构未知,但可以推断其输入是星系数据,输出是速度弥散的预测值。对抗评估器可能是一个经典神经网络,其输入是QNN的预测结果和真实值,输出是一个评估分数。LIME模块用于解释QNN的预测结果,提供每个输入特征对预测结果的贡献度。损失函数包括预测损失和对抗损失,用于优化QNN和对抗评估器。

🖼️ 关键图片

📊 实验亮点

实验结果表明,提出的Vanilla模型在星系速度弥散建模任务中取得了较好的性能,RMSE = 0.27,MSE = 0.071,MAE = 0.21,R^2 = 0.59。与其他对抗模型相比,Vanilla模型在回归指标上表现出最一致的性能,验证了该方法在提高预测精度和可解释性方面的有效性。

🎯 应用场景

该研究成果可应用于天文学领域,例如星系速度弥散建模,帮助天文学家更好地理解星系的结构和演化。此外,该方法还可以推广到其他需要高精度和可解释性的预测任务中,例如金融风险评估、医疗诊断等。该研究有助于推动量子机器学习在实际问题中的应用。

📄 摘要(原文)

Current quantum machine learning approaches often face challenges balancing predictive accuracy, robustness, and interpretability. To address this, we propose a novel quantum adversarial framework that integrates a hybrid quantum neural network (QNN) with classical deep learning layers, guided by an evaluator model with LIME-based interpretability, and extended through quantum GAN and self-supervised variants. In the proposed model, an adversarial evaluator concurrently guides the QNN by computing feedback loss, thereby optimizing both prediction accuracy and model explainability. Empirical evaluations show that the Vanilla model achieves RMSE = 0.27, MSE = 0.071, MAE = 0.21, and R^2 = 0.59, delivering the most consistent performance across regression metrics compared to adversarial counterparts. These results demonstrate the potential of combining quantum-inspired methods with classical architectures to develop lightweight, high-performance, and interpretable predictive models, advancing the applicability of QML beyond current limitations.