A Physics-informed Multi-resolution Neural Operator

作者: Sumanta Roy, Bahador Bahmani, Ioannis G. Kevrekidis, Michael D. Shields

分类: cs.LG, math.AP, physics.comp-ph, stat.ML

发布日期: 2025-10-27

备注: 26 pages, 14 figures, 4 tables

💡 一句话要点

提出物理信息多分辨率神经算子,解决数据匮乏和分辨率不一致问题

🎯 匹配领域: 支柱八:物理动画 (Physics-based Animation)

关键词: 神经算子 物理信息 多分辨率 偏微分方程 有限差分

📋 核心要点

- 现有算子学习方法依赖大量高质量数据,但在工程实践中数据获取往往困难,且分辨率不一致。

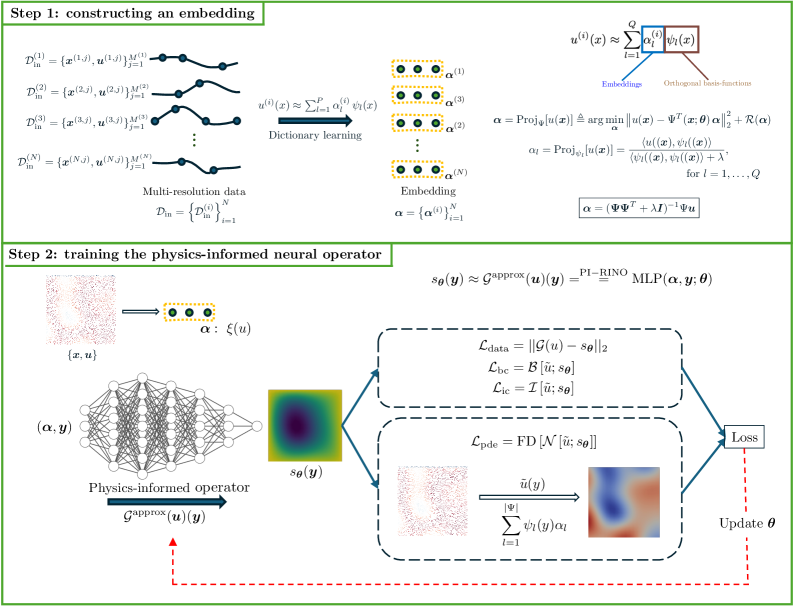

- 论文提出物理信息神经算子,利用预训练基函数将输入投影到潜在空间,并用MLP近似PDE算子。

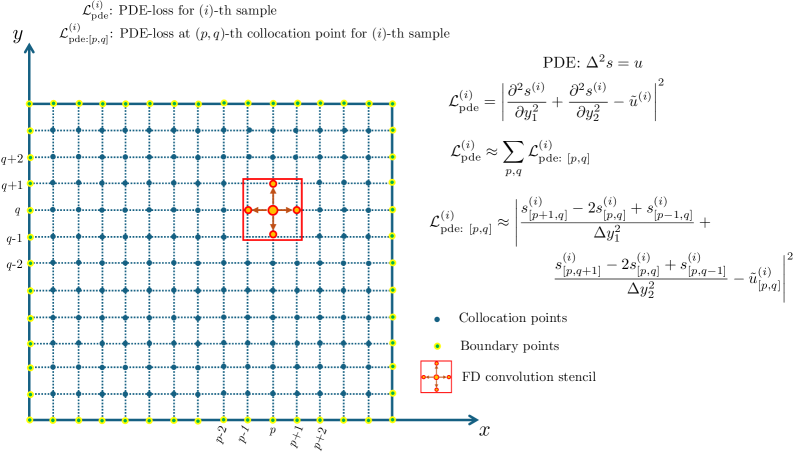

- 通过有限差分求解器在物理空间强制执行PDE,并在多分辨率数据上验证了方法的有效性。

📝 摘要(中文)

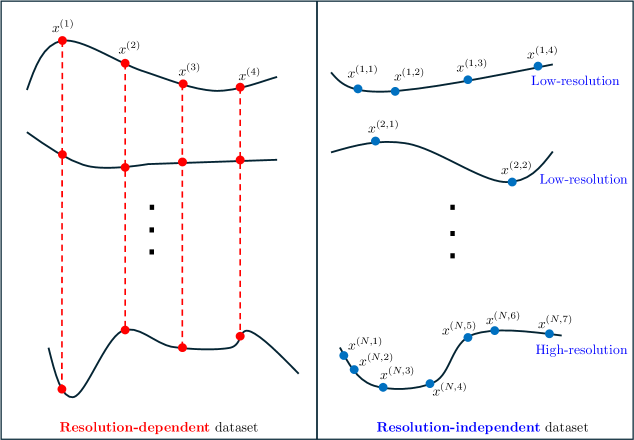

算子学习框架的预测精度依赖于高质量和大量的训练数据(输入-输出函数对),这在一些实际工程应用中可能难以获得。这些数据集可能离散化不均匀,样本之间的网格分辨率各不相同。本研究通过扩展分辨率无关神经算子(RINO)框架到完全无数据的设置,提出了一种物理信息算子学习方法,同时解决了这两个挑战。在这里,任意(但足够精细)离散化的输入函数被投影到潜在嵌入空间(即有限维向量空间),使用预训练的基函数。与底层偏微分方程(PDE)相关的算子然后通过一个简单的多层感知器(MLP)来近似,该MLP将潜在代码以及时空坐标作为输入,以在物理空间中产生解。偏微分方程通过物理空间中的有限差分求解器来强制执行。所提出方法的验证和性能在几个具有多分辨率数据的数值示例上进行了基准测试,其中输入函数以不同的分辨率进行采样,包括粗略和精细的离散化。

🔬 方法详解

问题定义:现有算子学习方法在训练数据不足或数据分辨率不一致的情况下表现不佳。工程应用中,高精度数据获取成本高昂,且不同样本可能采用不同的离散化方案,导致分辨率差异。因此,如何利用有限且分辨率不一致的数据训练有效的算子学习模型是一个关键问题。

核心思路:论文的核心思路是将物理信息融入到神经算子学习中,利用偏微分方程(PDE)的先验知识来约束模型的学习过程。通过预训练的基函数将输入函数投影到低维潜在空间,从而降低模型的复杂度,并利用有限差分方法在物理空间中强制执行PDE,从而提高模型的泛化能力和对数据分辨率变化的鲁棒性。

技术框架:该方法主要包含以下几个阶段:1) 输入函数编码:使用预训练的基函数将任意离散化的输入函数投影到低维潜在空间,得到潜在编码。2) 算子近似:使用多层感知器(MLP)来近似与底层PDE相关的算子,MLP的输入是潜在编码和时空坐标,输出是物理空间中的解。3) 物理信息约束:使用有限差分方法在物理空间中离散化PDE,并将其作为损失函数的一部分,从而强制执行PDE的约束。4) 模型训练:通过最小化预测解与真实解之间的差异以及PDE残差来训练模型。

关键创新:该方法的主要创新点在于:1) 完全数据自由的设置:通过物理信息约束,模型可以在几乎没有数据的情况下进行训练。2) 多分辨率适应性:通过将输入函数投影到潜在空间,模型可以处理具有不同分辨率的数据。3) RINO框架的扩展:将RINO框架扩展到物理信息驱动的场景,使其能够更好地处理实际工程问题。

关键设计:1) 基函数的选择:基函数的选择对潜在空间的表示能力有重要影响,论文中使用了预训练的基函数,具体类型未知。2) MLP结构:MLP的层数和每层神经元数量需要根据具体问题进行调整。3) 损失函数:损失函数由两部分组成:预测解与真实解之间的差异(如果存在真实解)以及PDE残差。PDE残差的计算采用有限差分方法,需要选择合适的差分格式和网格大小。4) 有限差分格式:根据PDE的类型选择合适的有限差分格式,例如中心差分、迎风差分等。

🖼️ 关键图片

📊 实验亮点

论文在多个数值示例上验证了所提出方法的有效性,包括具有多分辨率数据的场景。具体性能数据未知,但论文强调该方法能够在数据匮乏和分辨率不一致的情况下实现较好的预测精度。通过与基线方法(具体方法未知)的对比,展示了该方法在多分辨率数据处理方面的优势。

🎯 应用场景

该研究成果可应用于各种涉及偏微分方程求解的工程领域,例如流体力学、热传导、电磁学等。特别是在数据获取困难或数据分辨率不一致的场景下,该方法具有重要的应用价值。例如,可以用于预测复杂流体系统的行为,优化热管理系统的设计,或模拟电磁场的分布。

📄 摘要(原文)

The predictive accuracy of operator learning frameworks depends on the quality and quantity of available training data (input-output function pairs), often requiring substantial amounts of high-fidelity data, which can be challenging to obtain in some real-world engineering applications. These datasets may be unevenly discretized from one realization to another, with the grid resolution varying across samples. In this study, we introduce a physics-informed operator learning approach by extending the Resolution Independent Neural Operator (RINO) framework to a fully data-free setup, addressing both challenges simultaneously. Here, the arbitrarily (but sufficiently finely) discretized input functions are projected onto a latent embedding space (i.e., a vector space of finite dimensions), using pre-trained basis functions. The operator associated with the underlying partial differential equations (PDEs) is then approximated by a simple multi-layer perceptron (MLP), which takes as input a latent code along with spatiotemporal coordinates to produce the solution in the physical space. The PDEs are enforced via a finite difference solver in the physical space. The validation and performance of the proposed method are benchmarked on several numerical examples with multi-resolution data, where input functions are sampled at varying resolutions, including both coarse and fine discretizations.