MUStReason: A Benchmark for Diagnosing Pragmatic Reasoning in Video-LMs for Multimodal Sarcasm Detection

作者: Anisha Saha, Varsha Suresh, Timothy Hospedales, Vera Demberg

分类: cs.LG, cs.CL

发布日期: 2025-10-27

💡 一句话要点

提出MUStReason基准,诊断视频语言模型在多模态讽刺检测中的语用推理能力

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 多模态讽刺检测 视频语言模型 语用推理 隐含意图 MUStReason基准

📋 核心要点

- 现有方法在多模态讽刺检测中难以有效利用非语言线索和进行语用推理,导致性能瓶颈。

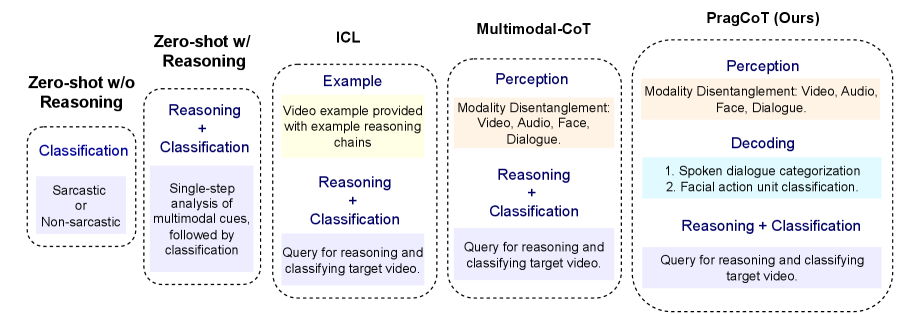

- 论文提出PragCoT框架,引导视频语言模型关注隐含意图而非字面意义,从而提升讽刺检测能力。

- MUStReason基准的实验结果表明,该框架能够有效提升视频语言模型在讽刺检测任务上的性能。

📝 摘要(中文)

讽刺是一种特殊的反讽,它涉及区分话语的字面意思和实际含义。检测讽刺不仅取决于话语的字面内容,还取决于非语言线索,如说话者的语气、面部表情和对话语境。然而,当前的多模态模型在讽刺检测等复杂任务上表现不佳,这些任务需要识别跨模态的相关线索,并对其进行语用推理以推断说话者的意图。为了探索视频语言模型(VideoLMs)的这些局限性,我们引入了MUStReason,这是一个诊断基准,它通过对特定模态相关线索和潜在推理步骤的注释进行丰富,以识别讽刺意图。除了对VideoLMs中的讽刺分类性能进行基准测试外,我们还使用MUStReason定量和定性地评估生成的推理,通过将问题分解为感知和推理,我们提出了PragCoT,一个引导VideoLMs关注隐含意图而非字面意义的框架,这是检测讽刺的核心属性。

🔬 方法详解

问题定义:论文旨在解决多模态讽刺检测中,现有视频语言模型难以有效利用非语言线索进行语用推理的问题。现有方法通常侧重于字面信息的理解,而忽略了讽刺表达中隐含的说话者意图,导致检测准确率不高。

核心思路:论文的核心思路是引导视频语言模型更加关注隐含意图而非字面意义。通过引入PragCoT框架,模型能够更好地理解说话者的真实意图,从而更准确地判断是否存在讽刺。这种方法模拟了人类理解讽刺的方式,即结合语境和非语言线索进行推理。

技术框架:整体框架包含数据输入、特征提取、推理生成和讽刺判断四个主要阶段。首先,从视频中提取视觉和听觉特征。然后,利用PragCoT框架生成推理过程,该框架鼓励模型关注隐含意图。最后,基于生成的推理过程和提取的特征,判断是否存在讽刺。

关键创新:论文的关键创新在于PragCoT框架的设计,它通过特定的训练策略和损失函数,引导模型学习如何从多模态数据中提取隐含意图。与传统的侧重于字面信息的模型相比,PragCoT框架能够更好地捕捉讽刺表达的本质。

关键设计:PragCoT框架的关键设计包括:1) 使用对比学习损失,鼓励模型区分字面意义和隐含意图;2) 设计了一种特殊的注意力机制,用于选择与隐含意图相关的模态特征;3) 使用生成式模型生成推理过程,从而使模型能够更好地解释其判断结果。具体的参数设置和网络结构细节在论文中有详细描述。

🖼️ 关键图片

📊 实验亮点

实验结果表明,PragCoT框架在MUStReason基准上显著提升了视频语言模型在讽刺检测任务上的性能。与现有基线模型相比,该框架在准确率、召回率和F1值等指标上均取得了显著提升,证明了其有效性。

🎯 应用场景

该研究成果可应用于智能客服、舆情监控、社交媒体分析等领域。通过准确识别讽刺言论,可以提升机器理解人类情感的能力,从而提供更智能、更人性化的服务。未来,该技术有望在人机交互、情感计算等领域发挥重要作用。

📄 摘要(原文)

Sarcasm is a specific type of irony which involves discerning what is said from what is meant. Detecting sarcasm depends not only on the literal content of an utterance but also on non-verbal cues such as speaker's tonality, facial expressions and conversational context. However, current multimodal models struggle with complex tasks like sarcasm detection, which require identifying relevant cues across modalities and pragmatically reasoning over them to infer the speaker's intention. To explore these limitations in VideoLMs, we introduce MUStReason, a diagnostic benchmark enriched with annotations of modality-specific relevant cues and underlying reasoning steps to identify sarcastic intent. In addition to benchmarking sarcasm classification performance in VideoLMs, using MUStReason we quantitatively and qualitatively evaluate the generated reasoning by disentangling the problem into perception and reasoning, we propose PragCoT, a framework that steers VideoLMs to focus on implied intentions over literal meaning, a property core to detecting sarcasm.