Lightweight Robust Direct Preference Optimization

作者: Cheol Woo Kim, Shresth Verma, Mauricio Tec, Milind Tambe

分类: cs.LG

发布日期: 2025-10-27

备注: arXiv admin note: substantial text overlap with arXiv:2509.02709

💡 一句话要点

提出DPO-PRO,通过轻量级分布鲁棒优化提升DPO在噪声环境下的性能

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 直接偏好优化 分布鲁棒优化 大型语言模型 噪声鲁棒性 模型微调

📋 核心要点

- DPO虽然有效,但对数据噪声敏感,易过拟合,限制了其在真实噪声环境下的应用。

- DPO-PRO通过轻量级DRO方法,仅关注偏好不确定性,避免了传统DRO的保守性和高计算成本。

- 实验表明,DPO-PRO在标准基准和公共卫生任务中,显著提升了DPO对噪声偏好信号的鲁棒性。

📝 摘要(中文)

直接偏好优化(DPO)因其稳定性和简洁性,已成为微调大型语言模型(LLM)的流行方法。然而,DPO也容易受到数据噪声的影响并产生过拟合。最近的研究提出了使用分布鲁棒优化(DRO)来解决数据中潜在的噪声和分布偏移。但是,这些方法通常过于保守且计算成本高昂。我们提出了DPO-PRO(具有偏好鲁棒性的DPO),这是一种基于DPO的鲁棒微调算法,它通过轻量级的DRO公式来考虑偏好分布中的不确定性。与先前的基于DRO的变体不同,DPO-PRO仅关注偏好中的不确定性,避免了不必要的保守性并产生了可忽略的计算开销。我们进一步表明,DPO-PRO等效于一个正则化的DPO目标,该目标会惩罚弱偏好信号下的模型过度自信。我们在标准对齐基准和真实的公共卫生任务上评估了DPO-PRO。实验结果表明,与现有的DPO变体相比,我们的方法始终提高了对噪声偏好信号的鲁棒性。

🔬 方法详解

问题定义:DPO在微调LLM时,容易受到训练数据中噪声偏好的影响,导致模型过拟合噪声数据,泛化能力下降。现有基于DRO的方法虽然能提升鲁棒性,但计算成本高昂,且可能引入不必要的保守性,影响模型性能。

核心思路:DPO-PRO的核心在于通过一个轻量级的DRO框架,只关注偏好分布中的不确定性,避免了全局分布偏移带来的保守性。通过最小化最坏情况下的偏好损失,模型能够更好地适应噪声偏好,提升鲁棒性。

技术框架:DPO-PRO的整体框架与DPO类似,仍然是基于reward model的优化。不同之处在于,DPO-PRO在计算损失函数时,引入了一个基于不确定性集合的鲁棒优化过程。具体来说,对于每个偏好对,DPO-PRO会考虑一个围绕经验偏好分布的不确定性集合,并最小化该集合中最坏情况下的DPO损失。

关键创新:DPO-PRO的关键创新在于其轻量级的DRO公式,它只考虑偏好分布中的局部不确定性,避免了全局分布偏移带来的保守性。此外,论文证明了DPO-PRO等价于一个正则化的DPO目标,该目标会惩罚弱偏好信号下的模型过度自信,从而提升鲁棒性。

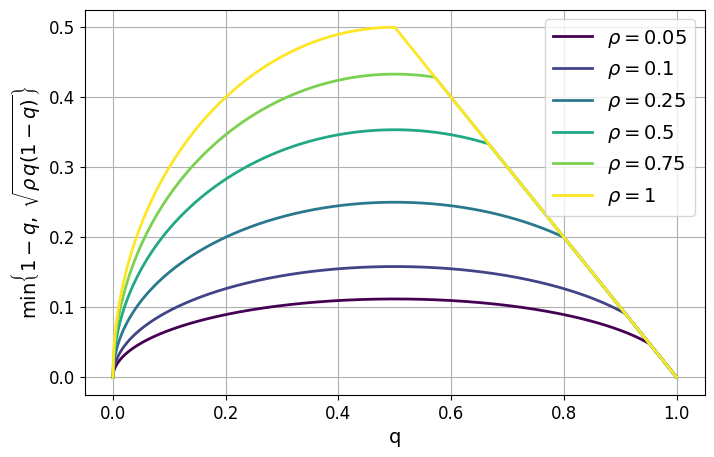

关键设计:DPO-PRO的关键设计在于不确定性集合的定义和鲁棒损失的计算。论文使用了一个基于KL散度的不确定性集合,并采用min-max优化来计算鲁棒损失。此外,论文还推导出了鲁棒损失的闭式解,使其可以高效地集成到DPO训练过程中。

🖼️ 关键图片

📊 实验亮点

实验结果表明,DPO-PRO在标准对齐基准和真实的公共卫生任务上,均优于现有的DPO变体。具体来说,DPO-PRO在噪声偏好信号下,能够显著提升模型的鲁棒性,降低过拟合风险。在某些任务上,DPO-PRO的性能提升超过了5%。

🎯 应用场景

DPO-PRO可应用于各种需要从人类反馈中学习的LLM微调场景,尤其是在数据质量不高或存在噪声偏好的情况下。例如,可以用于改进聊天机器人、内容生成模型和推荐系统,使其更加可靠和符合用户意图。该方法在医疗、金融等对模型鲁棒性要求高的领域具有重要应用价值。

📄 摘要(原文)

Direct Preference Optimization (DPO) has become a popular method for fine-tuning large language models (LLMs) due to its stability and simplicity. However, it is also known to be sensitive to noise in the data and prone to overfitting. Recent works have proposed using distributionally robust optimization (DRO) to address potential noise and distributional shift in the data. However, these methods often suffer from excessive conservatism and high computational cost. We propose DPO-PRO (DPO with Preference Robustness), a robust fine-tuning algorithm based on DPO which accounts for uncertainty in the preference distribution through a lightweight DRO formulation. Unlike prior DRO-based variants, DPO-PRO focuses solely on uncertainty in preferences, avoiding unnecessary conservatism and incurring negligible computational overhead. We further show that DPO-PRO is equivalent to a regularized DPO objective that penalizes model overconfidence under weak preference signals. We evaluate DPO-PRO on standard alignment benchmarks and a real-world public health task. Experimental results show that our method consistently improves robustness to noisy preference signals compared to existing DPO variants.