Adapting Interleaved Encoders with PPO for Language-Guided Reinforcement Learning in BabyAI

作者: Aryan Mathur, Asaduddin Ahmed

分类: cs.LG, cs.AI, eess.IV

发布日期: 2025-10-27

备注: Undergraduate research project, IIT Palakkad, 2025

💡 一句话要点

提出基于PPO的交错编码器,用于BabyAI中的语言引导强化学习

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture)

关键词: 强化学习 语言引导 视觉感知 Transformer 交错编码器 BabyAI PPO 对比学习

📋 核心要点

- 传统强化学习方法中,视觉感知和决策模块分离,导致策略失败无法有效指导感知模块学习。

- 论文采用感知-决策交错Transformer(PDiT)架构,在Transformer内部交替进行感知和决策,实现动态特征细化。

- 实验表明,在BabyAI GoToLocal环境中,PDiT编码器相比标准PPO基线,实现了更稳定的奖励和更强的对齐。

📝 摘要(中文)

深度强化学习智能体在需要理解视觉和语言的任务中常常表现不佳。传统的架构通常将感知(例如,基于CNN的视觉编码器)与决策(策略网络)隔离。这种分离可能效率低下,因为策略的失败不能直接帮助感知模块学习重要的内容。为了解决这个问题,我们实现了Mao等人(2023)提出的感知-决策交错Transformer(PDiT)架构,该模型在单个Transformer中交替进行感知和决策层。这种交错允许来自决策的反馈动态地细化感知特征。此外,我们整合了受CLIP启发的对比损失,以将文本任务嵌入与视觉场景特征对齐。我们在BabyAI GoToLocal环境中评估了PDiT编码器,发现该方法与标准PPO基线相比,实现了更稳定的奖励和更强的对齐。结果表明,交错Transformer编码器是开发更集成自主智能体的一个有希望的方向。

🔬 方法详解

问题定义:现有深度强化学习智能体在处理需要同时理解视觉和语言的任务时面临挑战。传统的架构将视觉感知(例如,CNN)与决策(策略网络)分离,导致感知模块无法从决策过程中学习,效率低下。这种分离使得策略的失败不能直接反馈到感知模块,从而无法优化视觉特征的提取。

核心思路:论文的核心思路是通过感知-决策交错的方式,将视觉感知和决策过程紧密结合。具体而言,采用Transformer架构,并在Transformer的层中交替进行感知层和决策层。这样,决策过程的反馈可以直接影响感知特征的提取,从而提高学习效率和性能。

技术框架:整体架构基于Transformer,关键在于感知层和决策层的交错排列。首先,视觉输入通过感知层提取视觉特征,然后这些特征与语言任务嵌入一起输入到决策层,决策层输出动作。这个过程在Transformer的多个层中交替进行,每一层决策层的输出都会影响下一层感知层的特征提取。此外,还引入了CLIP风格的对比损失,用于对齐视觉特征和语言任务嵌入。

关键创新:最重要的创新点在于感知-决策的交错结构。与传统的先感知后决策的pipeline不同,这种交错结构允许决策过程的反馈动态地调整感知特征,从而实现更有效的学习。此外,CLIP风格的对比损失也促进了视觉和语言特征的对齐。

关键设计:PDiT架构的关键设计包括:1) Transformer的层数和每一层中感知层和决策层的具体结构;2) CLIP风格对比损失的具体形式,包括正负样本的选择和损失函数的计算方式;3) 训练过程中的超参数设置,例如学习率、batch size等。具体参数设置在论文中未详细说明,属于未知信息。

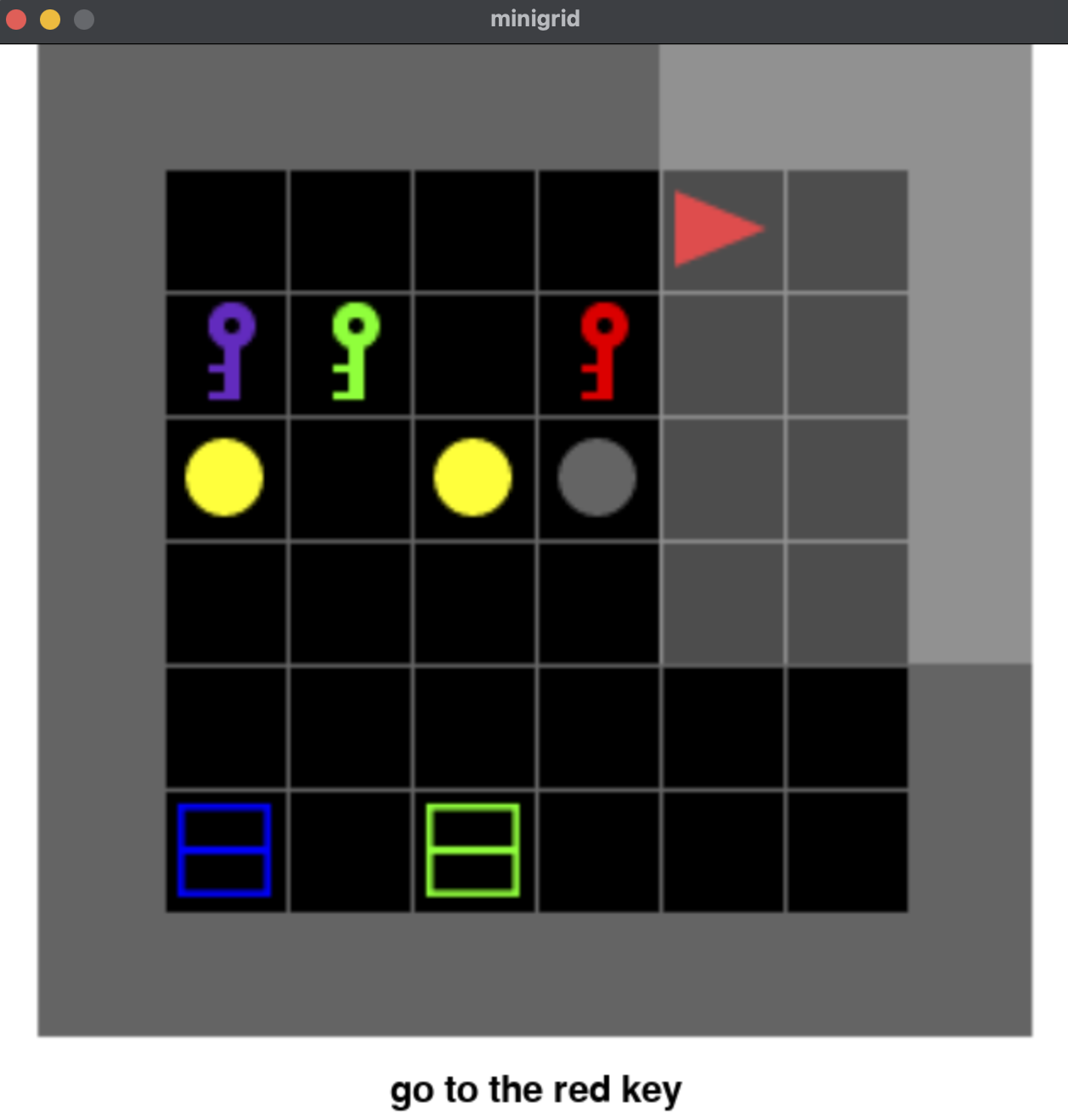

🖼️ 关键图片

📊 实验亮点

实验结果表明,在BabyAI GoToLocal环境中,PDiT编码器相比标准PPO基线,实现了更稳定的奖励和更强的视觉-语言特征对齐。具体性能提升数据未知,但论文强调了PDiT在学习过程中的稳定性和最终性能上的优越性。这表明交错Transformer编码器在语言引导的强化学习任务中具有显著优势。

🎯 应用场景

该研究成果可应用于机器人导航、自动驾驶、智能助手等领域,尤其是在需要理解复杂环境和人类指令的场景下。通过将视觉感知和决策紧密结合,可以提高智能体的自主性和适应性,使其能够更好地完成各种任务。未来的研究可以探索更复杂的交错结构和更有效的对比学习方法。

📄 摘要(原文)

Deep reinforcement learning agents often struggle when tasks require understanding both vision and language. Conventional architectures typically isolate perception (for example, CNN-based visual encoders) from decision-making (policy networks). This separation can be inefficient, since the policy's failures do not directly help the perception module learn what is important. To address this, we implement the Perception-Decision Interleaving Transformer (PDiT) architecture introduced by Mao et al. (2023), a model that alternates between perception and decision layers within a single transformer. This interleaving allows feedback from decision-making to refine perceptual features dynamically. In addition, we integrate a contrastive loss inspired by CLIP to align textual mission embeddings with visual scene features. We evaluate the PDiT encoders on the BabyAI GoToLocal environment and find that the approach achieves more stable rewards and stronger alignment compared to a standard PPO baseline. The results suggest that interleaved transformer encoders are a promising direction for developing more integrated autonomous agents.