QKCV Attention: Enhancing Time Series Forecasting with Static Categorical Embeddings for Both Lightweight and Pre-trained Foundation Models

作者: Hao Wang, Baojun Ma

分类: cs.LG, cs.AI

发布日期: 2025-10-21

备注: 10 pages, 5 figures

💡 一句话要点

提出QKCV注意力机制,利用静态类别嵌入增强时序预测模型性能

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 时间序列预测 注意力机制 类别嵌入 预训练模型 微调 QKCV注意力 静态类别信息

📋 核心要点

- 真实时序预测任务中,类别信息对捕捉数据内在模式至关重要,但现有方法可能无法充分利用这些信息。

- QKCV注意力机制通过引入静态类别嵌入,增强模型对类别特定信息的关注,从而提升预测精度。

- 实验表明,QKCV作为插件模块,可有效提升多种模型的预测性能,并能高效微调预训练模型。

📝 摘要(中文)

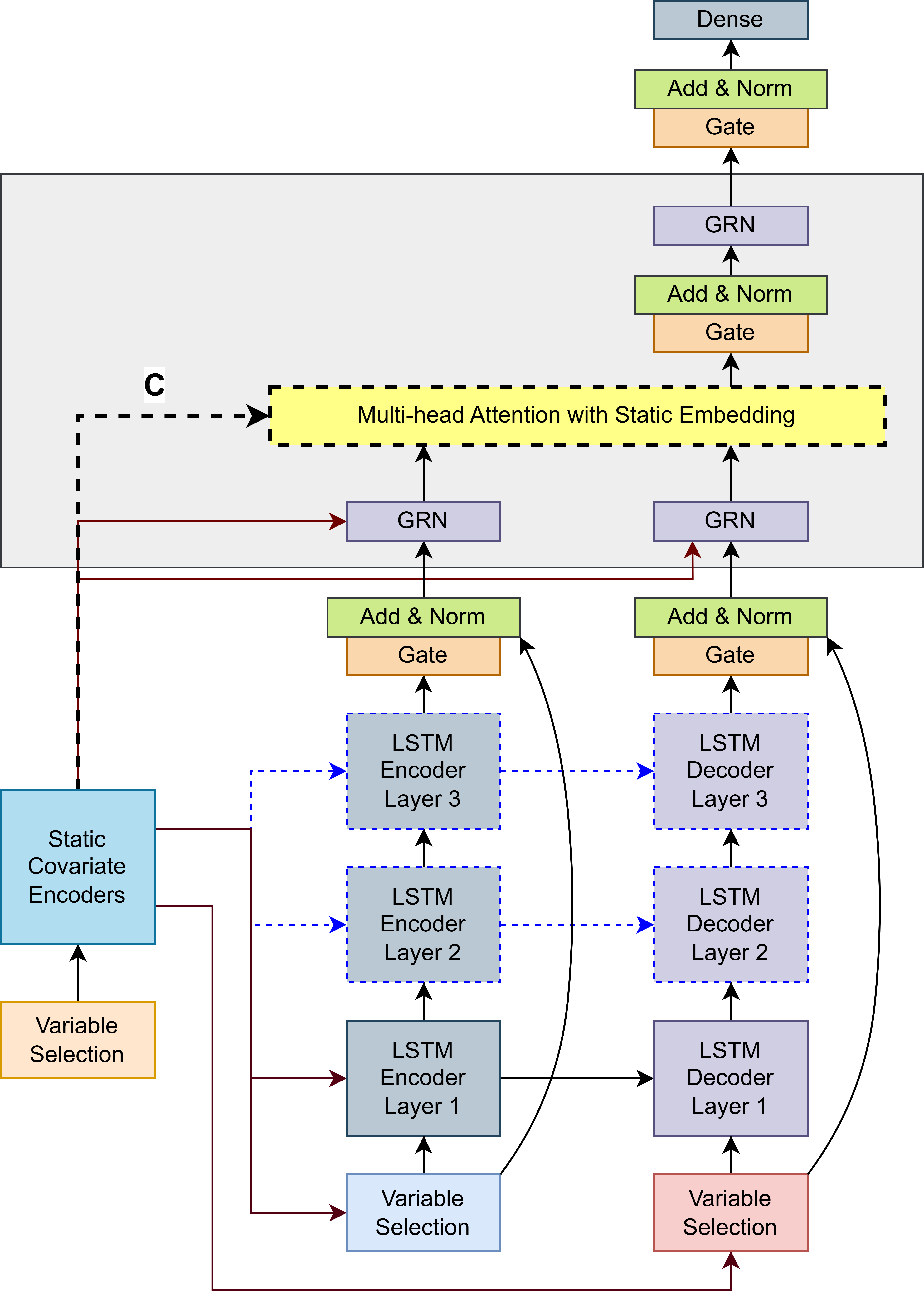

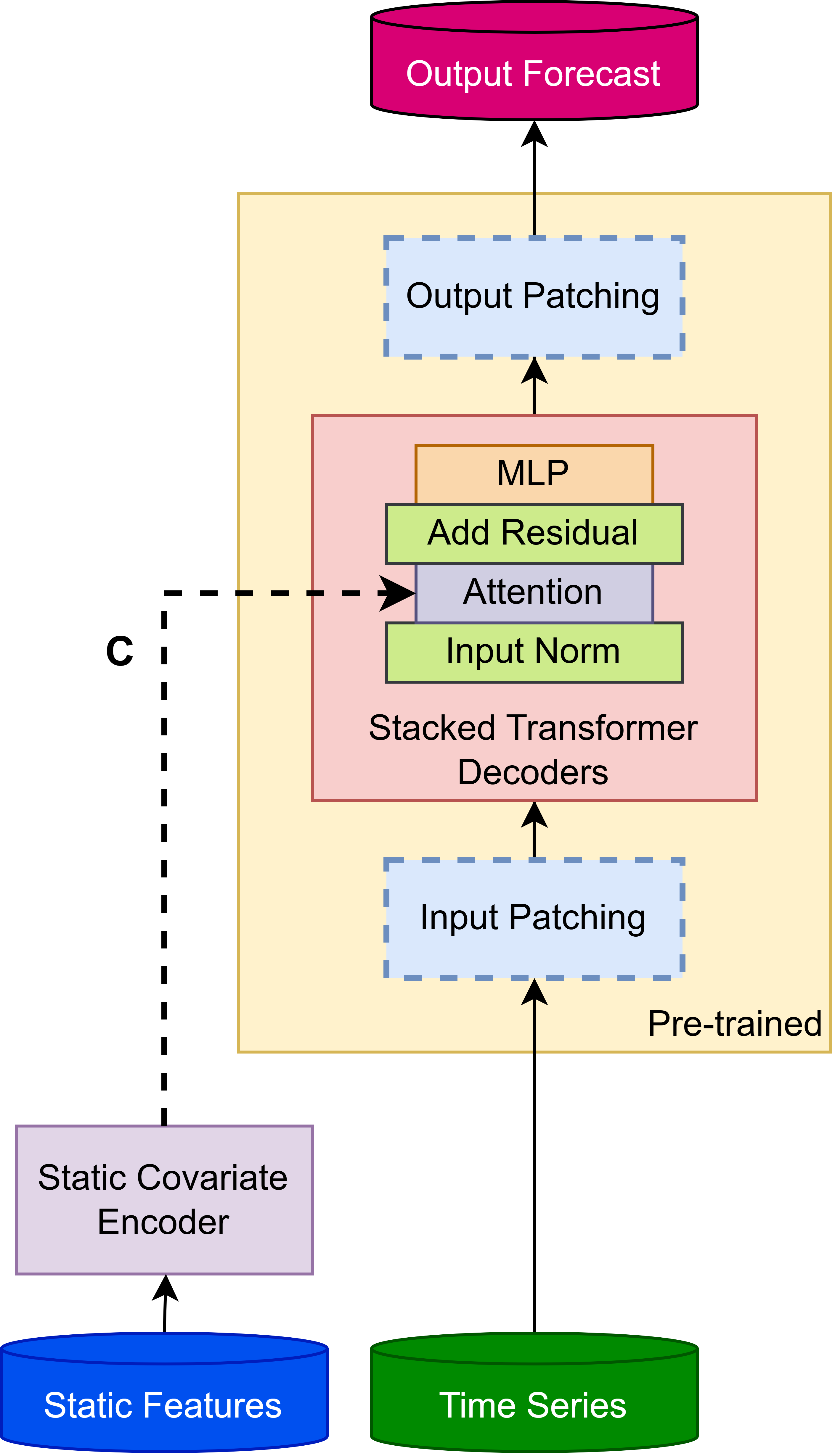

本文提出QKCV(Query-Key-Category-Value)注意力机制,它是传统QKV框架的扩展,通过引入静态类别嵌入C来强调类别特定信息,从而在时序预测中更好地捕捉数据内在模式。作为一个通用的即插即用模块,QKCV能够提升基于注意力机制的模型(例如Vanilla Transformer、Informer、PatchTST、TFT)在各种真实世界数据集上的预测精度。此外,QKCV还展现出卓越的适应性,可以通过仅更新静态嵌入C,同时保持预训练权重不变的方式,对单变量时间序列基础模型进行微调,从而降低计算开销并获得更优越的微调性能。

🔬 方法详解

问题定义:现有的时间序列预测模型在处理包含类别信息的数据时,往往无法充分利用这些静态的类别特征。虽然一些模型会考虑类别信息,但通常的处理方式不够直接,无法有效突出类别特征对时间序列预测的影响。这导致模型在捕捉数据内在模式时存在局限性,预测精度受到影响。

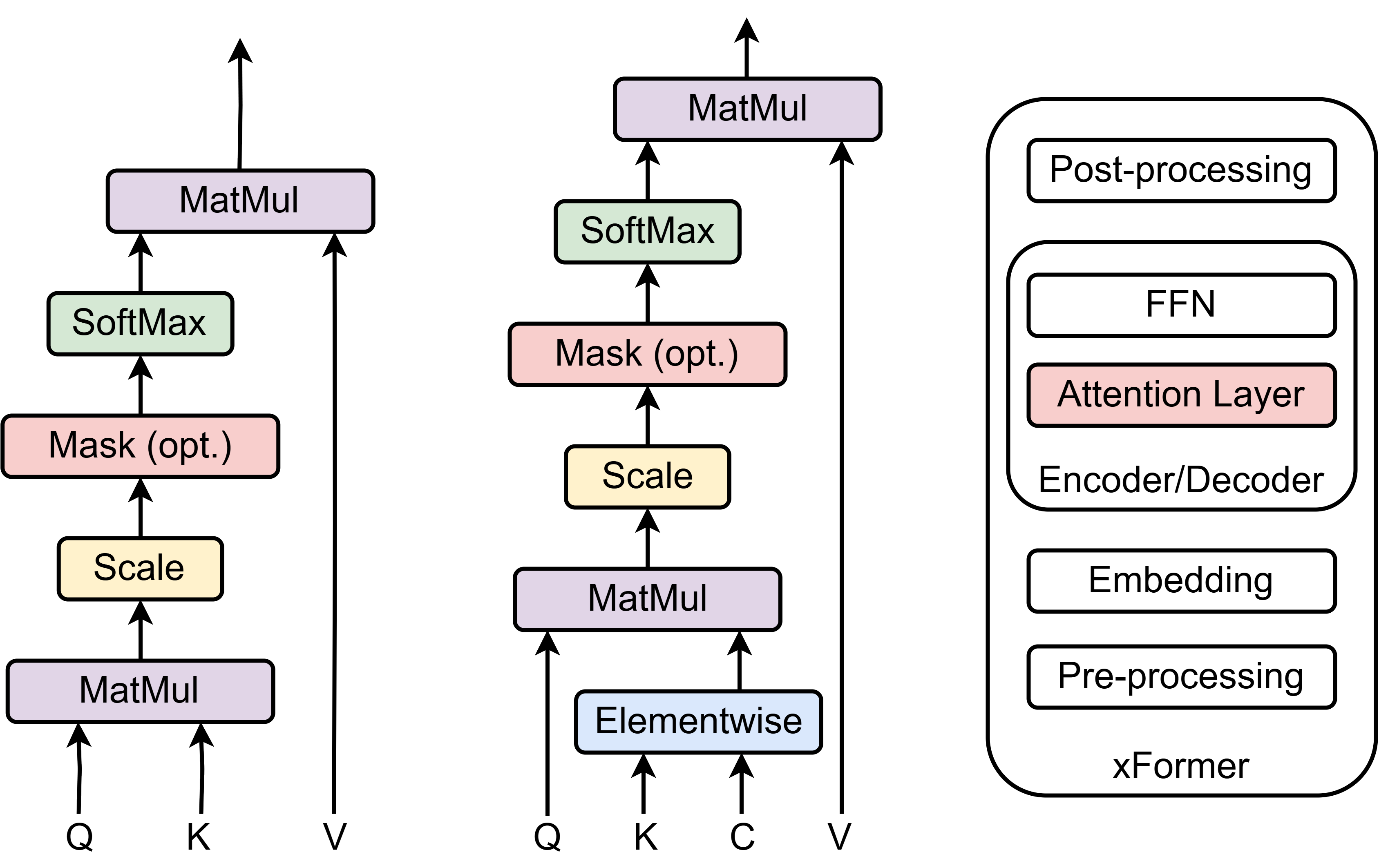

核心思路:QKCV注意力机制的核心思路是在传统的QKV注意力机制中引入类别信息。具体来说,就是将静态类别嵌入C添加到注意力计算过程中,使得模型能够显式地关注不同类别对时间序列的影响。通过这种方式,模型可以更好地捕捉类别特定的模式,从而提高预测精度。

技术框架:QKCV注意力机制的整体框架是在传统的QKV注意力机制的基础上进行扩展。它包含以下几个主要模块:Query (Q)、Key (K)、Category (C) 和 Value (V)。首先,将输入的时间序列数据转换为Query和Key。然后,引入静态类别嵌入C,它代表了不同类别的特征向量。接下来,将Query、Key和Category进行组合,计算注意力权重。最后,使用注意力权重对Value进行加权求和,得到最终的输出。

关键创新:QKCV注意力机制最重要的技术创新点在于引入了静态类别嵌入C,并将其融入到注意力计算过程中。与传统的QKV注意力机制相比,QKCV能够显式地关注类别信息,从而更好地捕捉类别特定的模式。此外,QKCV作为一个通用的插件模块,可以方便地集成到各种基于注意力机制的模型中。

关键设计:QKCV的关键设计在于静态类别嵌入C的表示和融合方式。类别嵌入C通常是一个可学习的参数矩阵,每一行代表一个类别的特征向量。在融合方面,一种常见的方式是将Query、Key和Category进行拼接,然后通过一个线性层进行转换。此外,还可以使用其他的融合方式,例如加权求和或注意力机制。损失函数方面,可以使用标准的均方误差(MSE)或平均绝对误差(MAE)等回归损失函数。

🖼️ 关键图片

📊 实验亮点

实验结果表明,QKCV注意力机制能够显著提升各种基于注意力机制的模型的预测精度。例如,在某些数据集上,QKCV可以将Vanilla Transformer的预测精度提高10%以上。此外,QKCV在微调预训练模型方面也表现出色,可以通过仅更新静态嵌入C的方式,在降低计算开销的同时,获得比传统微调方法更优越的性能。

🎯 应用场景

QKCV注意力机制可广泛应用于各种需要进行时间序列预测的领域,例如金融市场的股票价格预测、能源消耗预测、交通流量预测、销售预测等。通过利用类别信息,QKCV可以提高预测精度,帮助企业和个人做出更明智的决策。此外,QKCV在微调预训练模型方面的优势,使其在资源受限的场景下也具有很高的应用价值。

📄 摘要(原文)

In real-world time series forecasting tasks, category information plays a pivotal role in capturing inherent data patterns. This paper introduces QKCV (Query-Key-Category-Value) attention, an extension of the traditional QKV framework that incorporates a static categorical embedding C to emphasize category-specific information. As a versatile plug-in module, QKCV enhances the forecasting accuracy of attention-based models (e.g., Vanilla Transformer, Informer, PatchTST, TFT) across diverse real-world datasets. Furthermore, QKCV demonstrates remarkable adaptability in fine-tuning univariate time series foundation model by solely updating the static embedding C while preserving pretrained weights, thereby reducing computational overhead and achieving superior fine-tuning performance.