3D Optimization for AI Inference Scaling: Balancing Accuracy, Cost, and Latency

作者: Minseok Jung, Abhas Ricky, Muhammad Rameez Chatni

分类: cs.LG, cs.AI

发布日期: 2025-10-21 (更新: 2025-11-16)

💡 一句话要点

提出3D优化框架,联合校准精度、成本和延迟,实现AI推理的约束感知扩展。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: AI推理 多目标优化 精度-成本-延迟权衡 模型扩展 帕累托前沿

📋 核心要点

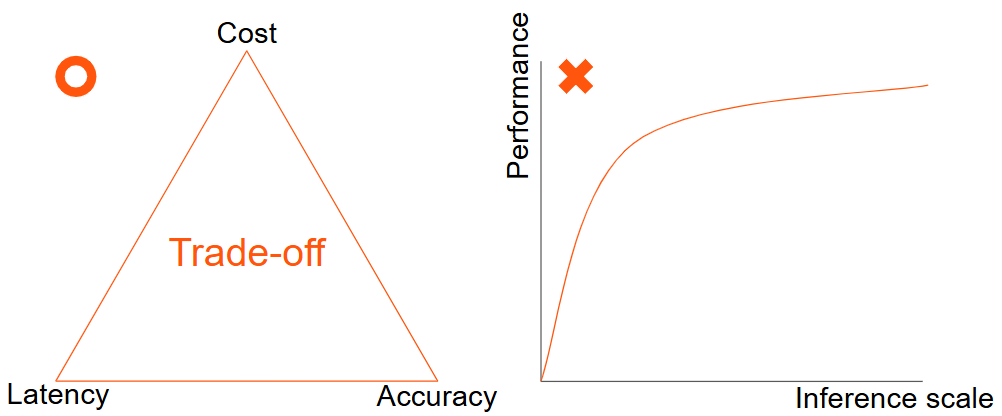

- 现有AI推理扩展方法通常只考虑精度与计算量的二维权衡,忽略了成本和延迟等关键约束。

- 论文提出一个3D优化框架,在统一决策空间内联合校准精度、成本和延迟,实现约束感知的推理扩展。

- 实验表明,基于帕累托前沿的膝点优化能实现最佳平衡,小模型通过优化推理扩展可媲美大模型性能。

📝 摘要(中文)

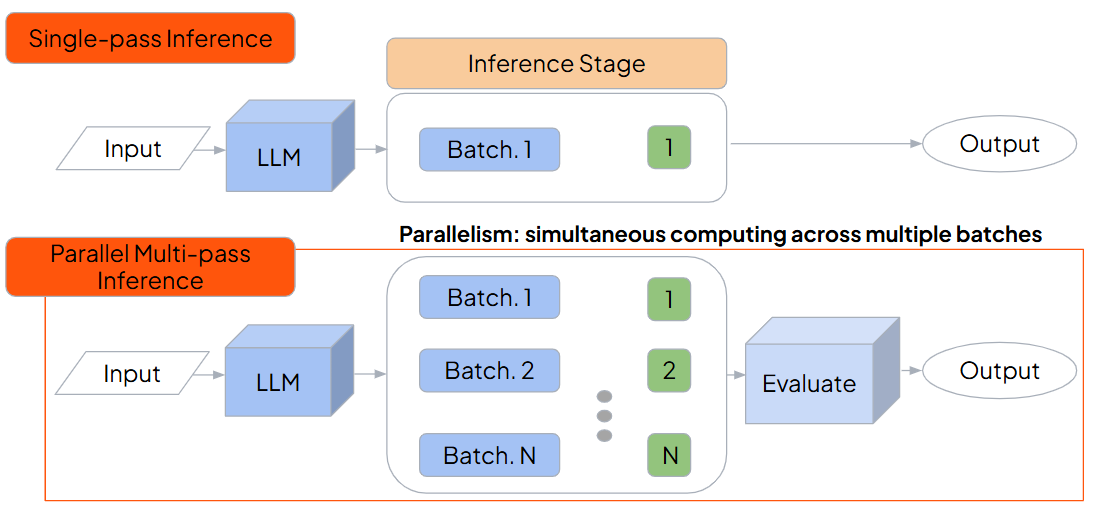

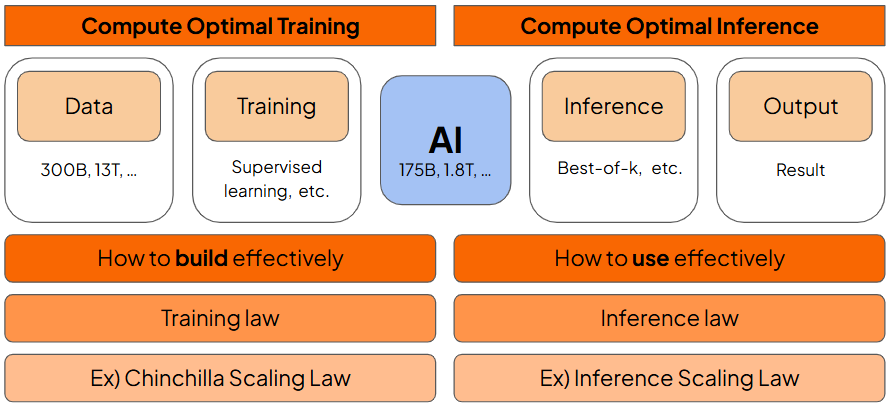

人工智能推理扩展通常通过一维启发式方法(固定的推理过程)或二维双变量权衡(例如,精度与计算量)进行调整,但这些方法未能考虑成本和延迟约束。本文提出了一种3D优化框架,该框架在一个统一的决策空间内联合校准精度、成本和延迟,从而实现约束感知的推理扩展。通过在三个代表性场景和九个模拟的大型语言模型上使用蒙特卡洛模拟,我们评估了四种优化方法来解决3D多目标优化(MOO)问题。将推理扩展构建为MOO问题,形成了一维和二维优化无法捕获的可行空间,从而能够进行环境自适应的推理扩展k值选择。结果表明,基于帕累托前沿的膝点优化实现了最佳平衡,而当精度优先时,精度最大化仍然是首选。我们的结果进一步表明,较小的模型与最佳推理扩展相结合,可以在一小部分成本下匹配或超过较大模型的性能。该框架为跨不同操作条件的部署感知推理扩展奠定了理论基础。

🔬 方法详解

问题定义:现有AI推理扩展方法,如固定推理过程或精度-计算量二维权衡,无法同时考虑精度、成本和延迟这三个关键因素,导致推理效率低下,难以适应不同部署环境的需求。尤其是在资源受限的场景下,如何找到精度、成本和延迟之间的最佳平衡点是一个挑战。

核心思路:论文的核心思路是将AI推理扩展问题建模为一个三维多目标优化(MOO)问题,目标是同时优化精度、降低成本和减少延迟。通过构建一个统一的决策空间,允许算法在不同推理配置(例如,模型大小、推理步骤数等)中进行选择,从而找到满足特定约束条件的最优解。

技术框架:该框架主要包含以下几个阶段:1) 问题建模:将推理扩展问题形式化为3D MOO问题,明确精度、成本和延迟的定义和计算方法。2) 可行空间构建:通过蒙特卡洛模拟等方法,探索不同推理配置下的精度、成本和延迟,构建可行解空间。3) 优化算法选择:选择合适的MOO算法,如基于帕累托前沿的膝点优化、精度最大化等。4) 推理扩展k值选择:根据优化算法的结果,选择最优的推理扩展k值,即确定最佳的推理配置。

关键创新:该论文的关键创新在于将AI推理扩展问题从传统的一维或二维优化提升到三维多目标优化,从而能够更全面地考虑精度、成本和延迟之间的权衡。这种3D优化方法能够更好地适应不同的部署环境和约束条件,找到更优的推理配置。

关键设计:论文中使用了蒙特卡洛模拟来探索可行空间,并评估了四种不同的优化方法:1) 精度最大化;2) 成本最小化;3) 延迟最小化;4) 基于帕累托前沿的膝点优化。其中,膝点优化旨在找到帕累托前沿上精度、成本和延迟之间平衡最佳的点。具体的参数设置和损失函数取决于具体的应用场景和模型。

🖼️ 关键图片

📊 实验亮点

实验结果表明,基于帕累托前沿的膝点优化在精度、成本和延迟之间实现了最佳平衡。更重要的是,研究表明,通过优化推理扩展,较小的模型可以在一小部分成本下匹配甚至超过较大模型的性能。例如,在某些场景下,小模型通过优化推理扩展,在精度上可以达到大模型的90%以上,而成本仅为大模型的50%。

🎯 应用场景

该研究成果可应用于各种AI推理场景,尤其是在资源受限的边缘设备或对延迟敏感的应用中,例如自动驾驶、智能监控、移动设备上的AI应用等。通过优化推理扩展,可以在保证精度的前提下,降低计算成本和延迟,提高用户体验和系统效率。该框架还为部署感知的推理扩展提供了理论基础,有助于在不同操作条件下选择最佳的推理配置。

📄 摘要(原文)

AI inference scaling is often tuned through 1D heuristics (a fixed reasoning pass) or 2D bivariate trade-offs (e.g., accuracy vs. compute), which fail to consider cost and latency constraints. We introduce a 3D optimization framework that jointly calibrates accuracy, cost, and latency within a unified decision space, enabling constraints-aware inference scaling. Using Monte Carlo simulations across three representative scenarios and nine simulated large language models, we evaluate four optimization methods to address the 3D multi-objective optimization (MOO) problem. Framing inference scaling in MOO shapes a feasible space that 1D and 2D optimizations fail to capture, enabling environment-adaptive selection of the inference scaling~$k$. Results show that knee-point optimization based on Pareto frontiers achieves the best balance, while accuracy-maximization remains favorable when accuracy is prioritized. Our results further show that smaller models, when combined with optimal inference scaling, can match or exceed the performance of larger models at a fraction of the cost. The framework establishes a theoretical foundation for deployment-aware inference scaling across diverse operational conditions.