Simple and Efficient Heterogeneous Temporal Graph Neural Network

作者: Yili Wang, Tairan Huang, Changlong He, Qiutong Li, Jianliang Gao

分类: cs.LG, cs.AI

发布日期: 2025-10-21

备注: Accepted by Neurips 2025

💡 一句话要点

提出SE-HTGNN,通过动态注意力机制和LLM提示,高效学习异构时序图表示。

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 异构时序图 图神经网络 动态注意力机制 大型语言模型 表示学习

📋 核心要点

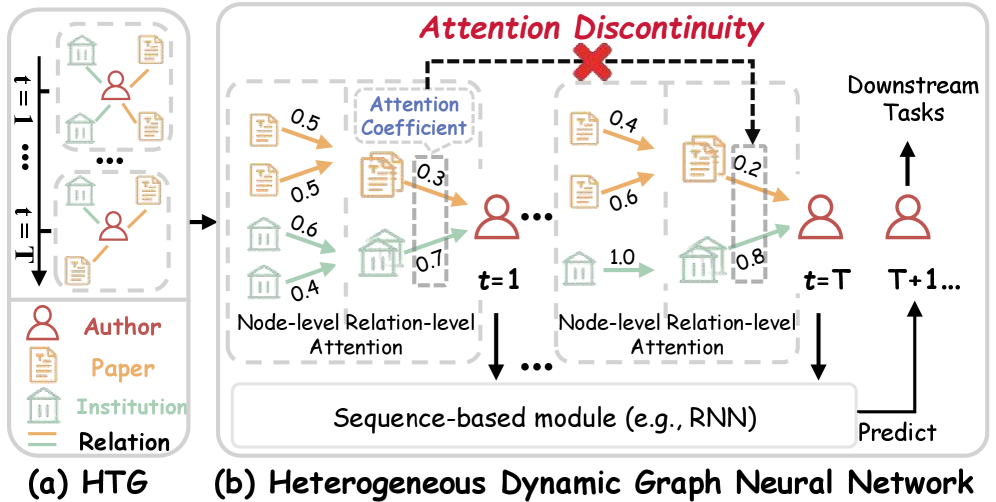

- 现有异构时序图神经网络(HTGNN)依赖解耦的时序和空间学习,忽略了时空信息的有效交互。

- SE-HTGNN通过动态注意力机制将时间建模融入空间学习,利用历史图快照信息指导后续注意力计算。

- 利用大型语言模型(LLM)提示SE-HTGNN,使模型能够捕获节点类型的隐式属性作为先验知识,提升性能。

📝 摘要(中文)

异构时序图(HTG)是现实世界中普遍存在的数据结构。为了增强HTG上的表示学习,最近提出了许多基于注意力的神经网络。然而,现有方法依赖于解耦的时序和空间学习范式,削弱了时空信息的交互,导致模型复杂度高。为了弥补这一差距,我们提出了一种新的HTG学习范式,称为简单高效的异构时序图神经网络(SE-HTGNN)。具体来说,我们创新性地通过一种新的动态注意力机制将时间建模集成到空间学习中,该机制保留来自历史图快照的注意力信息,以指导后续的注意力计算,从而提高HTG的整体判别表示学习。此外,为了全面和自适应地理解HTG,我们利用大型语言模型来提示SE-HTGNN,使模型能够捕获节点类型的隐式属性作为先验知识。大量实验表明,SE-HTGNN在保持最佳预测精度的同时,比最先进的最新基线快10倍。

🔬 方法详解

问题定义:现有异构时序图神经网络在处理时序信息时,通常采用解耦的时序和空间学习范式。这种方法忽略了时空信息之间的内在联系,导致模型无法充分利用时序信息来提升空间表示学习,同时也增加了模型的复杂度。因此,如何有效地融合时序和空间信息,同时降低模型复杂度,是本文要解决的关键问题。

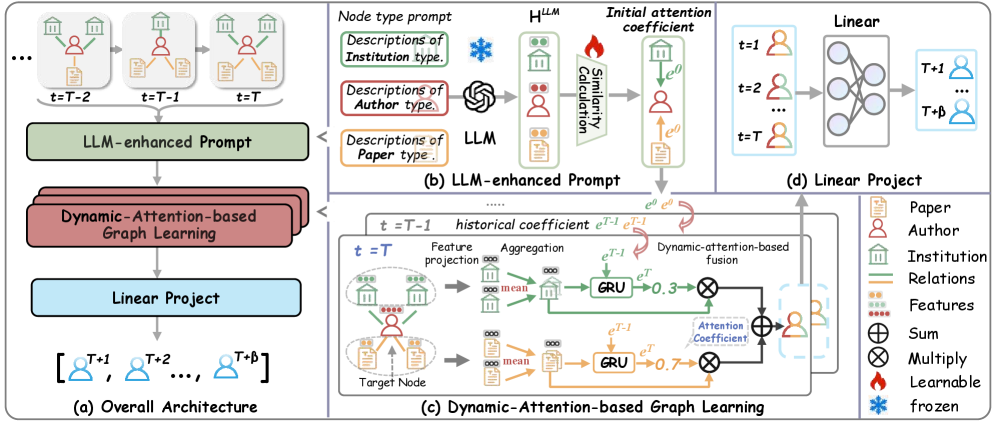

核心思路:本文的核心思路是将时间建模集成到空间学习中,通过动态注意力机制实现时序信息对空间学习的引导。具体来说,模型会保留来自历史图快照的注意力信息,并将其用于指导后续的注意力计算。这种方法能够有效地捕捉时序信息,并将其融入到空间表示学习中,从而提升模型的性能。此外,利用大型语言模型(LLM)来提供节点类型相关的先验知识,进一步提升模型的表达能力。

技术框架:SE-HTGNN的整体框架主要包含以下几个模块:1) 动态注意力机制模块:该模块负责将时间建模集成到空间学习中,通过保留历史图快照的注意力信息来指导后续的注意力计算。2) 大型语言模型提示模块:该模块利用大型语言模型来提供节点类型相关的先验知识,从而提升模型的表达能力。3) 图神经网络模块:该模块负责进行空间表示学习,利用动态注意力机制和LLM提供的先验知识来提升表示学习的效果。

关键创新:SE-HTGNN的关键创新在于以下两点:1) 动态注意力机制:该机制能够有效地将时间建模集成到空间学习中,通过保留历史图快照的注意力信息来指导后续的注意力计算,从而提升模型的性能。2) 大型语言模型提示:该方法利用大型语言模型来提供节点类型相关的先验知识,从而提升模型的表达能力。与现有方法相比,SE-HTGNN能够更有效地融合时序和空间信息,同时降低模型的复杂度。

关键设计:在动态注意力机制中,作者设计了一种基于历史注意力信息的加权机制,用于指导当前时刻的注意力计算。具体来说,模型会根据历史注意力信息的重要性来调整当前时刻的注意力权重。在大型语言模型提示方面,作者使用了预训练的语言模型来生成节点类型相关的嵌入向量,并将其作为先验知识输入到图神经网络中。损失函数方面,作者使用了交叉熵损失函数来优化模型的参数。

🖼️ 关键图片

📊 实验亮点

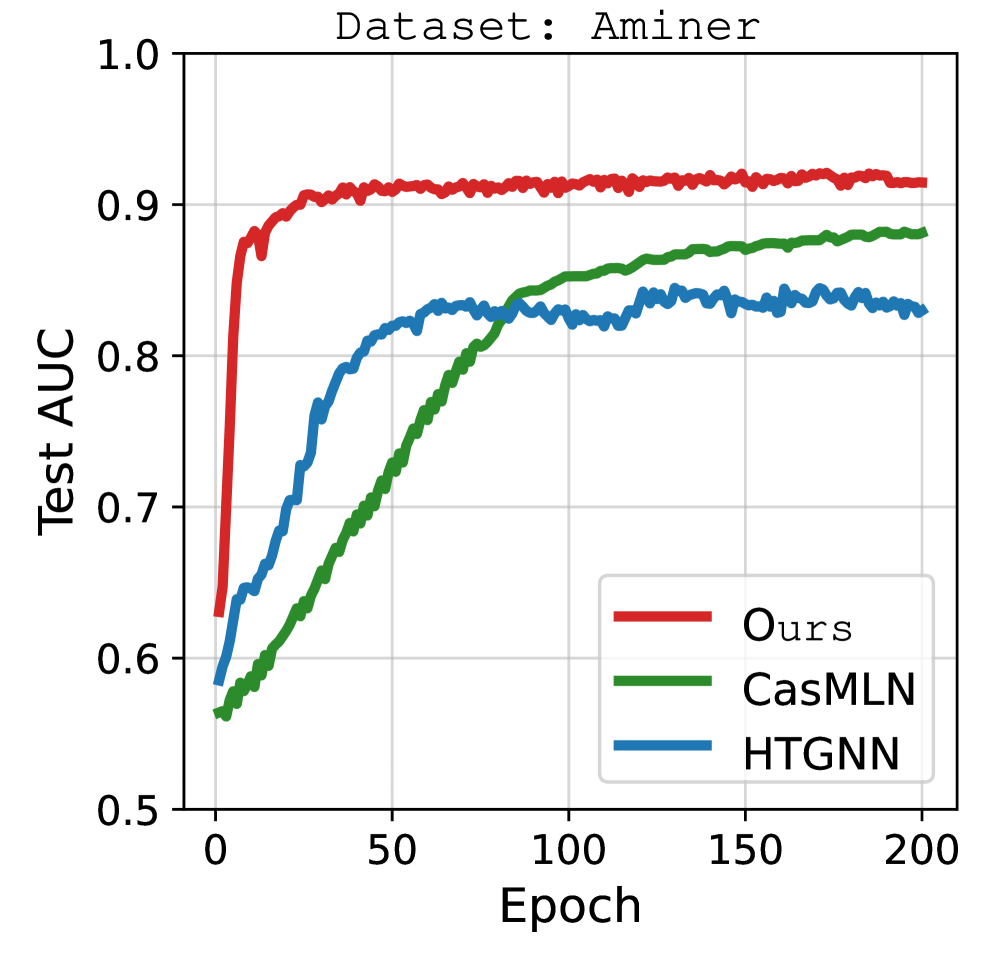

实验结果表明,SE-HTGNN在多个异构时序图数据集上取得了显著的性能提升,并在保持最佳预测精度的同时,比最先进的基线方法实现了高达10倍的加速。这表明SE-HTGNN在效率和准确性方面都具有显著优势。

🎯 应用场景

该研究成果可广泛应用于金融风控、社交网络分析、推荐系统、交通预测等领域。通过对异构时序图数据的有效建模,可以提升风险识别、用户行为预测、交通流量预测等任务的准确性和效率,具有重要的实际应用价值和广阔的应用前景。

📄 摘要(原文)

Heterogeneous temporal graphs (HTGs) are ubiquitous data structures in the real world. Recently, to enhance representation learning on HTGs, numerous attention-based neural networks have been proposed. Despite these successes, existing methods rely on a decoupled temporal and spatial learning paradigm, which weakens interactions of spatio-temporal information and leads to a high model complexity. To bridge this gap, we propose a novel learning paradigm for HTGs called Simple and Efficient Heterogeneous Temporal Graph N}eural Network (SE-HTGNN). Specifically, we innovatively integrate temporal modeling into spatial learning via a novel dynamic attention mechanism, which retains attention information from historical graph snapshots to guide subsequent attention computation, thereby improving the overall discriminative representations learning of HTGs. Additionally, to comprehensively and adaptively understand HTGs, we leverage large language models to prompt SE-HTGNN, enabling the model to capture the implicit properties of node types as prior knowledge. Extensive experiments demonstrate that SE-HTGNN achieves up to 10x speed-up over the state-of-the-art and latest baseline while maintaining the best forecasting accuracy.