Deeper with Riemannian Geometry: Overcoming Oversmoothing and Oversquashing for Graph Foundation Models

作者: Li Sun, Zhenhao Huang, Ming Zhang, Philip S. Yu

分类: cs.LG

发布日期: 2025-10-20

备注: Accept by NeurIPS 25

💡 一句话要点

提出基于黎曼几何的GBN网络,解决图神经网络的过平滑和过挤压问题

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 图神经网络 黎曼几何 过平滑 过挤压 消息传递 图表示学习 局部结构

📋 核心要点

- 图神经网络面临过平滑和过挤压问题,现有全局方法在局部可能产生负面影响,限制了表达能力。

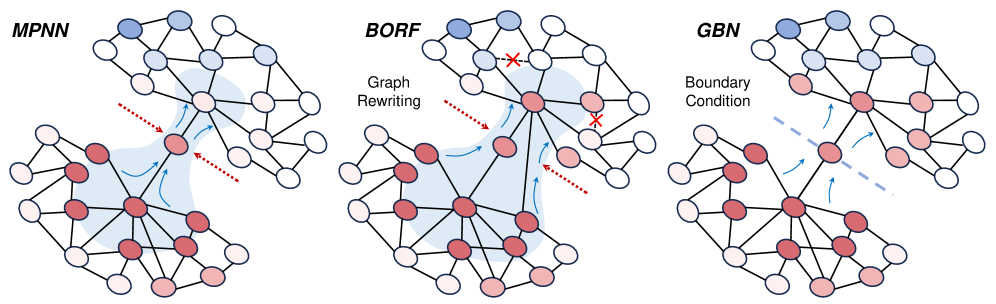

- 论文提出基于局部黎曼几何的自适应消息传递方法,通过非齐次边界条件解决过平滑和过挤压。

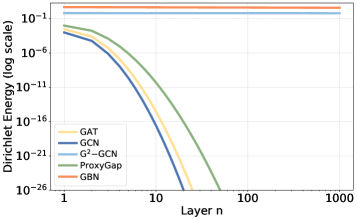

- 实验表明,所提出的GBN网络在同质和异质图上表现出强大的表达能力,且能有效避免深层网络性能退化。

📝 摘要(中文)

消息传递神经网络(MPNNs)是图基础模型的构建基石,但从根本上受到过平滑和过挤压问题的困扰。最近,解决这两个问题的兴趣激增。现有的工作主要采用全局方法,这些方法可能在某些区域有益,但在其他区域有害,最终导致次优的表达能力。在本文中,我们首先通过一个全局度量——谱隙λ——来重新审视过挤压问题,并证明λ的增加会导致关于输入特征的梯度消失,从而削弱消息传递的有效性。受这种理论见解的启发,我们提出了一种基于局部结构的自适应调整消息传递的 extbf{局部}方法。为了实现这一点,我们将局部黎曼几何与MPNNs联系起来,并建立了一个新的非齐次边界条件来解决过挤压和过平滑问题。在Robin条件下,我们设计了一个具有局部瓶颈调整的GBN网络,并结合了理论保证。在同质和异质图上的大量实验表明了GBN的表达能力。此外,即使网络深度超过256层,GBN也不会出现性能下降。

🔬 方法详解

问题定义:图神经网络中的过平滑问题指的是随着网络层数的增加,节点的表示逐渐趋同,导致节点区分度降低。过挤压问题指的是远距离节点的信息难以有效传递到目标节点,导致模型无法捕捉长程依赖关系。现有方法通常采用全局策略来缓解这些问题,但忽略了图结构的局部特性,可能在某些区域引入负面影响,最终限制了模型的表达能力。

核心思路:论文的核心思路是利用局部黎曼几何来指导消息传递过程,从而自适应地调整消息传递策略。具体来说,论文将图结构视为一个黎曼流形,并利用黎曼几何中的概念(如曲率)来刻画图的局部特性。然后,根据局部曲率信息,自适应地调整消息传递的强度,从而缓解过平滑和过挤压问题。

技术框架:论文提出的GBN网络主要包含以下几个模块:1) 局部黎曼几何计算模块:用于计算图的局部黎曼几何信息,如曲率。2) 消息传递模块:基于局部黎曼几何信息,自适应地调整消息传递的强度。3) 局部瓶颈调整模块:通过调整局部瓶颈的大小,进一步控制信息的流动,缓解过挤压问题。整体流程是,首先计算局部黎曼几何信息,然后利用该信息指导消息传递,最后通过局部瓶颈调整模块进一步优化信息流动。

关键创新:论文最重要的技术创新点在于将局部黎曼几何与图神经网络相结合,提出了一种自适应的消息传递策略。与现有方法相比,该方法能够根据图的局部特性,动态地调整消息传递的强度,从而更有效地缓解过平滑和过挤压问题。此外,论文还提出了一个非齐次边界条件,用于解决过平滑和过挤压问题,并给出了相应的理论保证。

关键设计:论文的关键设计包括:1) 局部曲率的计算方法:论文采用了一种基于图拉普拉斯算子的方法来计算局部曲率。2) 消息传递强度的调整策略:论文根据局部曲率的大小,自适应地调整消息传递的强度。具体来说,对于曲率较高的区域,减小消息传递的强度,以缓解过平滑问题;对于曲率较低的区域,增加消息传递的强度,以缓解过挤压问题。3) 局部瓶颈调整模块的设计:论文通过调整局部瓶颈的大小,控制信息的流动。具体来说,对于需要传递更多信息的节点,增大瓶颈的大小;对于需要减少信息传递的节点,减小瓶颈的大小。

🖼️ 关键图片

📊 实验亮点

实验结果表明,所提出的GBN网络在同质和异质图上都取得了显著的性能提升。例如,在某些数据集上,GBN的性能超过了现有最先进的方法。更重要的是,GBN能够有效避免深层网络中的性能退化问题,即使网络深度超过256层,仍然能够保持良好的性能。

🎯 应用场景

该研究成果可应用于各种需要处理图结构数据的领域,例如社交网络分析、生物信息学、知识图谱推理、推荐系统等。通过缓解过平滑和过挤压问题,可以提升图神经网络的表达能力和泛化性能,从而在这些应用中获得更好的效果。未来,该方法可以进一步扩展到处理更大规模、更复杂的图数据。

📄 摘要(原文)

Message Passing Neural Networks (MPNNs) is the building block of graph foundation models, but fundamentally suffer from oversmoothing and oversquashing. There has recently been a surge of interest in fixing both issues. Existing efforts primarily adopt global approaches, which may be beneficial in some regions but detrimental in others, ultimately leading to the suboptimal expressiveness. In this paper, we begin by revisiting oversquashing through a global measure -- spectral gap $λ$ -- and prove that the increase of $λ$ leads to gradient vanishing with respect to the input features, thereby undermining the effectiveness of message passing. Motivated by such theoretical insights, we propose a \textbf{local} approach that adaptively adjusts message passing based on local structures. To achieve this, we connect local Riemannian geometry with MPNNs, and establish a novel nonhomogeneous boundary condition to address both oversquashing and oversmoothing. Building on the Robin condition, we design a GBN network with local bottleneck adjustment, coupled with theoretical guarantees. Extensive experiments on homophilic and heterophilic graphs show the expressiveness of GBN. Furthermore, GBN does not exhibit performance degradation even when the network depth exceeds $256$ layers.