Optimizing Energy Management of Smart Grid using Reinforcement Learning aided by Surrogate models built using Physics-informed Neural Networks

作者: Julen Cestero, Carmine Delle Femine, Kenji S. Muro, Marco Quartulli, Marcello Restelli

分类: cs.LG, cs.AI

发布日期: 2025-10-20

期刊: Applied Energy, 2025, vol. 401, p. 126750

DOI: 10.1016/j.apenergy.2025.126750

💡 一句话要点

利用物理信息神经网络辅助强化学习优化智能电网能量管理

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture)

关键词: 智能电网 能量管理 强化学习 物理信息神经网络 替代模型 最优潮流 样本效率

📋 核心要点

- 智能电网能量管理优化面临系统复杂性和组件交互性挑战,传统强化学习方法样本效率低。

- 论文提出使用物理信息神经网络(PINN)构建替代模型,加速强化学习策略训练过程。

- 实验表明,该方法能在更短时间内获得收敛结果,提升强化学习在智能电网优化中的效率。

📝 摘要(中文)

智能电网中的能量管理优化面临着巨大的挑战,这主要是由于现实世界系统的复杂性以及各种组件之间错综复杂的相互作用。强化学习(RL)作为解决智能电网中最佳潮流问题的一种方案,正日益受到重视。然而,强化学习需要在给定的环境中进行强制迭代,以获得最佳策略。这意味着需要从一个很可能代价高昂的模拟器中获取样本,这可能导致样本效率问题。在这项工作中,我们通过使用物理信息神经网络(PINN)构建的替代模型来替代代价高昂的智能电网模拟器,从而优化了强化学习策略训练过程,在原始环境所用时间的一小部分内即可获得收敛结果。

🔬 方法详解

问题定义:论文旨在解决智能电网能量管理优化问题,现有方法依赖于代价高昂的智能电网模拟器进行强化学习训练,导致样本效率低下,训练时间过长。现有方法难以在实际应用中快速找到最优能量管理策略。

核心思路:论文的核心思路是利用物理信息神经网络(PINN)构建智能电网模拟器的替代模型。PINN能够将物理定律(例如电力系统的潮流方程)融入到神经网络的训练过程中,从而在少量数据下学习到精确的系统行为,降低对大量真实数据的依赖。

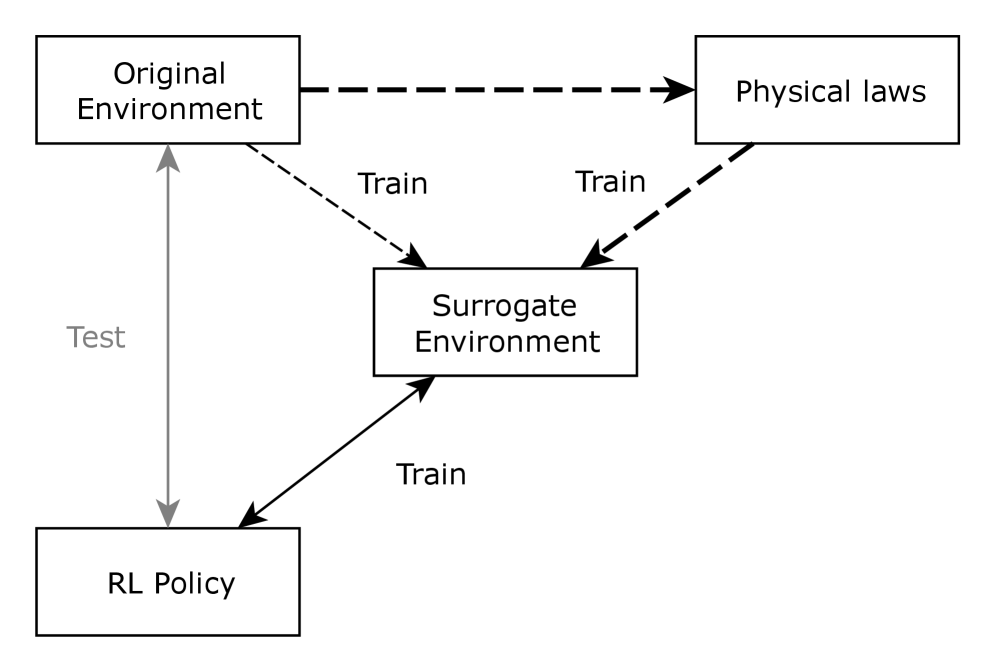

技术框架:整体框架包含两个主要阶段:首先,使用PINN训练智能电网的替代模型,该模型能够预测给定控制策略下的电网状态。然后,使用训练好的PINN替代模型作为强化学习环境,训练智能电网的能量管理策略。强化学习算法与PINN替代模型交互,通过试错学习找到最优策略。

关键创新:最重要的技术创新点在于将物理信息神经网络(PINN)引入到智能电网强化学习中。传统强化学习需要大量的真实数据或精确的模拟器,而PINN能够利用已知的物理定律来约束模型的学习过程,从而减少对数据的需求,提高模型的泛化能力。这使得强化学习能够在更短的时间内学习到有效的能量管理策略。

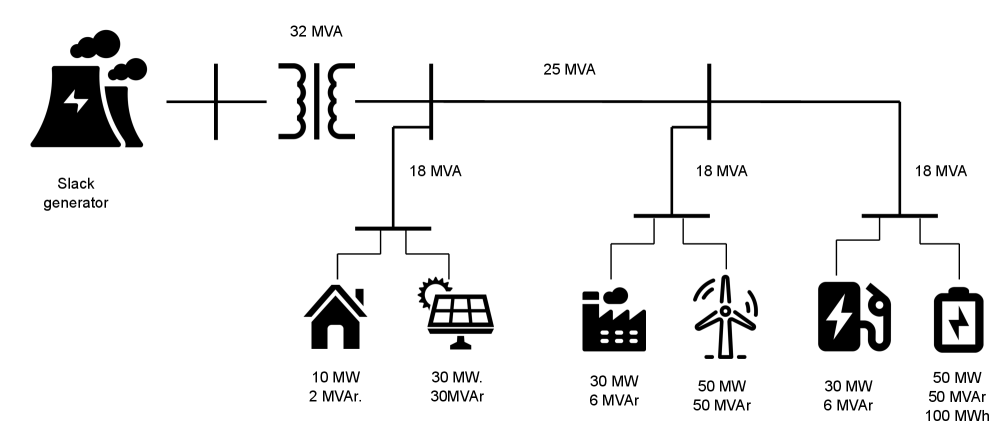

关键设计:PINN的网络结构需要根据具体的智能电网模型进行设计,损失函数通常包含两部分:一部分是数据驱动的损失,用于拟合已有的数据;另一部分是物理信息驱动的损失,用于满足电力系统的物理定律约束。强化学习算法可以选择常见的Q-learning、SARSA或Actor-Critic等算法。关键参数包括PINN的网络层数、每层神经元数量、学习率,以及强化学习算法的探索率、学习率等。

🖼️ 关键图片

📊 实验亮点

论文通过实验验证了所提出方法的有效性,表明使用PINN构建的替代模型能够显著加速强化学习的训练过程,在更短的时间内获得收敛结果。具体性能数据和对比基线未在摘要中给出,具体提升幅度未知。

🎯 应用场景

该研究成果可应用于智能电网的实时能量管理、需求响应、分布式电源优化调度等领域。通过加速强化学习训练过程,可以更快地部署智能电网控制策略,提高电网运行效率和稳定性,降低能源消耗和碳排放,具有重要的实际应用价值和环境效益。

📄 摘要(原文)

Optimizing the energy management within a smart grids scenario presents significant challenges, primarily due to the complexity of real-world systems and the intricate interactions among various components. Reinforcement Learning (RL) is gaining prominence as a solution for addressing the challenges of Optimal Power Flow in smart grids. However, RL needs to iterate compulsively throughout a given environment to obtain the optimal policy. This means obtaining samples from a, most likely, costly simulator, which can lead to a sample efficiency problem. In this work, we address this problem by substituting costly smart grid simulators with surrogate models built using Phisics-informed Neural Networks (PINNs), optimizing the RL policy training process by arriving to convergent results in a fraction of the time employed by the original environment.