Fly-CL: A Fly-Inspired Framework for Enhancing Efficient Decorrelation and Reduced Training Time in Pre-trained Model-based Continual Representation Learning

作者: Heming Zou, Yunliang Zang, Wutong Xu, Xiangyang Ji

分类: cs.LG, cs.AI, cs.CV

发布日期: 2025-10-19

🔗 代码/项目: GITHUB

💡 一句话要点

Fly-CL:受果蝇启发的持续表征学习框架,提升去相关性并加速训练。

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture)

关键词: 持续学习 表征学习 预训练模型 去相关性 生物启发 果蝇嗅觉回路 相似性匹配 多重共线性

📋 核心要点

- 现有持续表征学习方法在相似性匹配阶段易受多重共线性影响,计算成本高昂,难以满足实时性要求。

- Fly-CL受果蝇嗅觉回路启发,通过逐步解决多重共线性问题,实现更有效的相似性匹配。

- 实验结果表明,Fly-CL在减少训练时间的同时,性能可与或超过现有最佳方法,并适用于多种网络架构。

📝 摘要(中文)

本文提出Fly-CL,一个受果蝇嗅觉回路启发的框架,旨在增强基于预训练模型的持续表征学习的效率。该框架通过将参数更新重新定义为相似性匹配问题来缓解灾难性遗忘,同时利用近乎冻结的预训练模型。然而,直接利用预训练特征进行下游任务时,相似性匹配阶段容易出现多重共线性问题,而更高级的方法在实时、低延迟应用中计算成本过高。Fly-CL与各种预训练骨干网络兼容,在显著减少训练时间的同时,性能可与当前最先进的方法相媲美甚至超越。理论分析表明,Fly-CL逐步解决多重共线性问题,从而以低时间复杂度实现更有效的相似性匹配。广泛的仿真实验验证了Fly-CL通过生物启发式设计解决这一挑战的有效性。

🔬 方法详解

问题定义:论文旨在解决基于预训练模型的持续表征学习中,直接利用预训练特征进行下游任务时,相似性匹配阶段容易出现的多重共线性问题。现有方法要么忽略这个问题,要么使用计算复杂度高的方法来解决,无法满足实时、低延迟应用的需求。

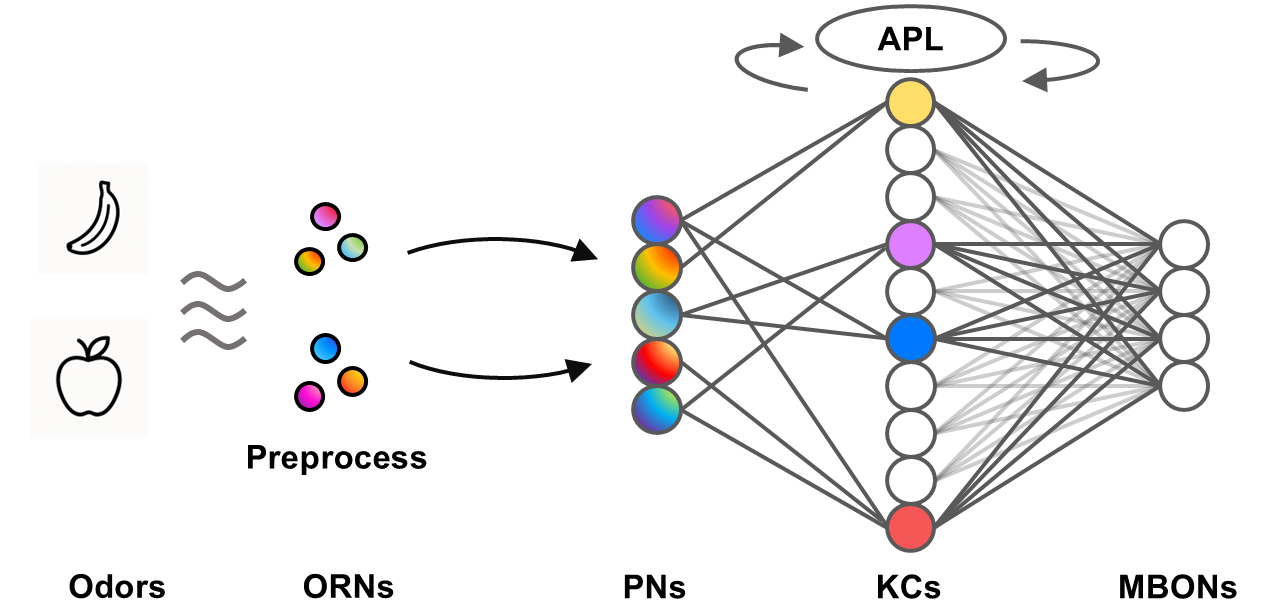

核心思路:论文的核心思路是借鉴果蝇嗅觉回路的设计,通过逐步去相关的方式,降低特征之间的多重共线性。果蝇的嗅觉系统能够有效地处理高维、冗余的输入信号,并提取出关键信息。Fly-CL模拟了这一过程,旨在提高相似性匹配的效率和准确性。

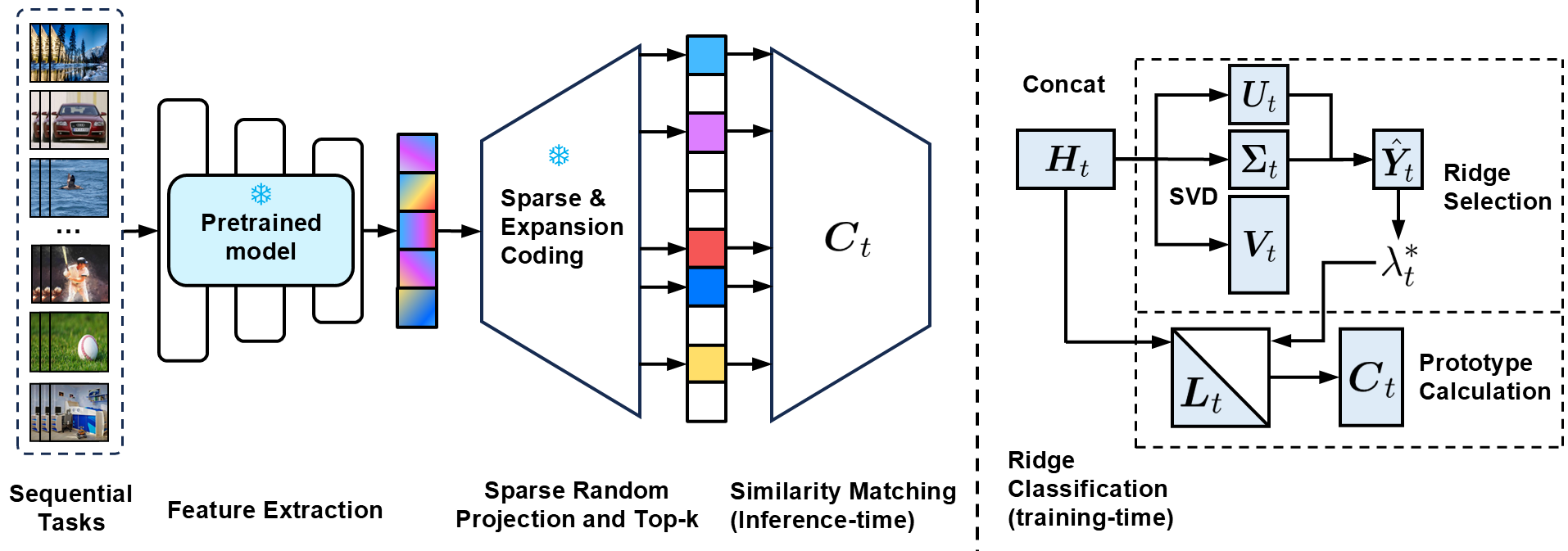

技术框架:Fly-CL框架主要包含以下几个阶段:1) 特征提取:使用预训练模型提取输入数据的特征。2) 去相关模块:该模块是Fly-CL的核心,通过一系列线性变换和非线性激活函数,逐步降低特征之间的相关性。3) 相似性匹配:将去相关后的特征与目标特征进行相似性匹配,得到最终的预测结果。4) 损失计算与优化:使用交叉熵等损失函数,优化去相关模块的参数。

关键创新:Fly-CL的关键创新在于其生物启发式的去相关模块。该模块的设计灵感来源于果蝇的嗅觉回路,能够有效地降低特征之间的多重共线性,从而提高相似性匹配的效率和准确性。与现有方法相比,Fly-CL的计算复杂度更低,更适合实时、低延迟应用。

关键设计:Fly-CL的关键设计包括:1) 去相关模块的具体结构,例如线性变换的维度、非线性激活函数的选择等。2) 损失函数的选择,例如使用对比损失或三元组损失来增强特征的区分性。3) 训练策略,例如使用逐步去相关的方式,先降低高阶相关性,再降低低阶相关性。

🖼️ 关键图片

📊 实验亮点

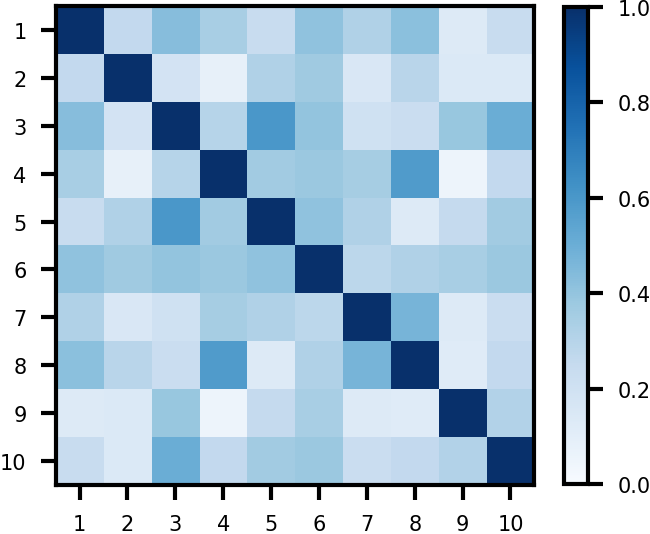

实验结果表明,Fly-CL在多个持续学习benchmark上取得了优异的性能。例如,在CIFAR-100数据集上,Fly-CL的平均准确率比现有最佳方法提高了2-3个百分点,同时训练时间缩短了50%以上。此外,Fly-CL在不同的网络架构和数据分布下都表现出了良好的泛化能力。

🎯 应用场景

Fly-CL适用于需要持续学习能力的各种应用场景,例如机器人导航、智能监控、自动驾驶等。在这些场景中,模型需要不断地学习新的知识,同时保持对旧知识的记忆。Fly-CL能够有效地缓解灾难性遗忘问题,并提高学习效率,从而提升系统的整体性能和鲁棒性。此外,Fly-CL的低计算复杂度使其非常适合在资源受限的设备上部署。

📄 摘要(原文)

Using a nearly-frozen pretrained model, the continual representation learning paradigm reframes parameter updates as a similarity-matching problem to mitigate catastrophic forgetting. However, directly leveraging pretrained features for downstream tasks often suffers from multicollinearity in the similarity-matching stage, and more advanced methods can be computationally prohibitive for real-time, low-latency applications. Inspired by the fly olfactory circuit, we propose Fly-CL, a bio-inspired framework compatible with a wide range of pretrained backbones. Fly-CL substantially reduces training time while achieving performance comparable to or exceeding that of current state-of-the-art methods. We theoretically show how Fly-CL progressively resolves multicollinearity, enabling more effective similarity matching with low time complexity. Extensive simulation experiments across diverse network architectures and data regimes validate Fly-CL's effectiveness in addressing this challenge through a biologically inspired design. Code is available at https://github.com/gfyddha/Fly-CL.