CoRA: Covariate-Aware Adaptation of Time Series Foundation Models

作者: Guo Qin, Zhi Chen, Yong Liu, Zhiyuan Shi, Haixuan Liu, Xiangdong Huang, Jianmin Wang, Mingsheng Long

分类: cs.LG

发布日期: 2025-10-14

💡 一句话要点

提出CoRA框架,通过协变量自适应提升时间序列基础模型在实际预测任务中的性能。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 时间序列预测 基础模型 协变量自适应 格兰杰因果关系 多模态融合

📋 核心要点

- 现有时间序列基础模型忽略了现实预测任务中重要的协变量信息,限制了其性能。

- CoRA框架通过格兰杰因果嵌入自动评估协变量的因果可预测性,并将其融入预训练模型。

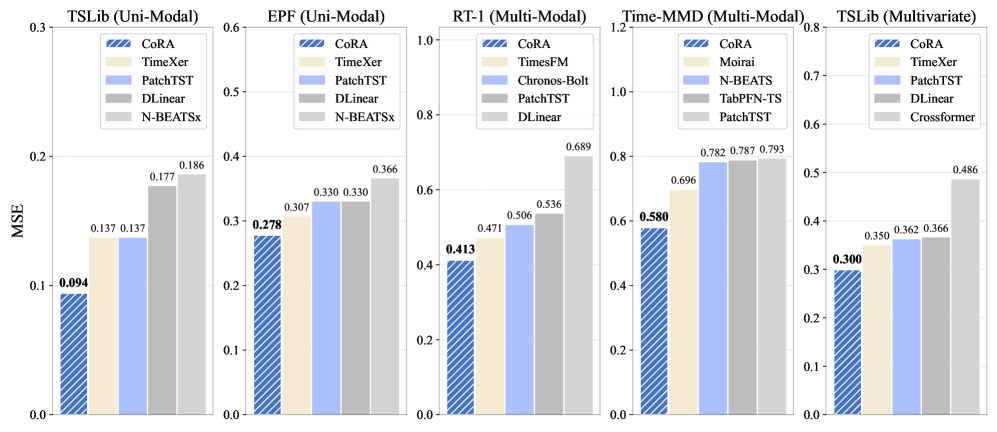

- 实验表明,CoRA在协变量感知预测中显著降低了MSE,并与多种TSFMs兼容。

📝 摘要(中文)

时间序列基础模型(TSFMs)通过其模型容量、可扩展性和零样本泛化能力展现了显著的影响。然而,由于变量间依赖关系的多样性和大规模多元数据集上的骨干网络可扩展性,大多数TSFMs通常在单变量时间序列上进行预训练。这种限制使得它们忽略了现实世界预测任务中来自各种协变量的关键信息。为了进一步提高TSFMs的性能,我们提出了一个通用的协变量感知自适应(CoRA)框架。它利用预训练的基础模型骨干网络,同时有效地结合来自各种模态的外生协变量,包括时间序列、语言和图像,以提高预测质量。在技术上,CoRA在自适应过程中保持了初始化的等价性和参数一致性。通过保留基础模型的骨干网络作为冻结的特征提取器,来自基础模型的结果嵌入在经验上被证明比原始数据更具信息量。此外,CoRA采用了一种新颖的格兰杰因果嵌入(GCE)来自动评估协变量相对于目标变量的因果可预测性。我们将这些加权嵌入与零初始化的条件注入机制相结合,避免了预训练基础模型的灾难性遗忘,并逐步整合外生信息。大量的实验表明,TSFMs的CoRA超越了最先进的协变量感知深度预测器,具有完整或少量的训练样本,在协变量感知预测方面实现了31.1%的MSE降低。与其他自适应方法相比,CoRA表现出与各种先进TSFMs的强大兼容性,并将协变量的范围扩展到其他模态,为TSFMs的应用提供了一个实用的范例。

🔬 方法详解

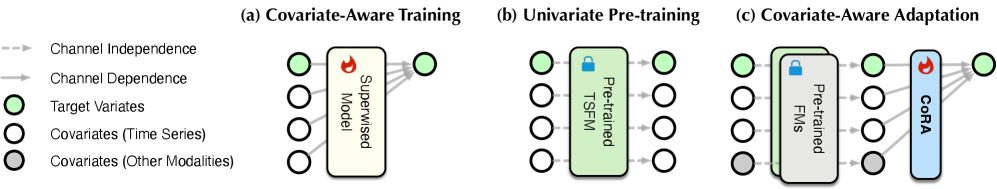

问题定义:现有时间序列基础模型(TSFMs)主要在单变量时间序列上预训练,忽略了实际预测任务中来自各种模态(如时间序列、语言、图像)的协变量信息。这导致模型无法有效利用这些外生信息,降低了预测精度。现有方法要么难以处理多种模态的协变量,要么在自适应过程中容易发生灾难性遗忘。

核心思路:CoRA的核心思路是利用预训练TSFMs强大的特征提取能力,同时引入协变量信息来提升预测性能。通过冻结预训练模型的骨干网络,避免灾难性遗忘,并利用格兰杰因果嵌入(GCE)自动评估协变量与目标变量之间的因果关系,从而有选择地整合协变量信息。这样既能保留预训练模型的泛化能力,又能有效地利用协变量信息。

技术框架:CoRA框架主要包含以下几个模块:1) 预训练TSFM骨干网络:作为特征提取器,保持冻结状态。2) 格兰杰因果嵌入(GCE):用于评估协变量与目标变量之间的因果关系,生成权重。3) 条件注入机制:将加权的协变量嵌入信息注入到预训练模型中,避免灾难性遗忘。整体流程是:首先,利用预训练TSFM提取时间序列特征;然后,利用GCE评估协变量的因果关系并生成权重;最后,通过条件注入机制将加权的协变量信息融入到TSFM中,进行预测。

关键创新:CoRA的关键创新在于:1) 提出了格兰杰因果嵌入(GCE),能够自动评估协变量与目标变量之间的因果关系,从而有选择地整合协变量信息。2) 采用了零初始化的条件注入机制,避免了预训练模型的灾难性遗忘,并逐步整合外生信息。3) 框架具有通用性,可以与多种TSFMs结合,并处理多种模态的协变量。

关键设计:GCE的具体实现方式是利用格兰杰因果关系检验来评估协变量对目标变量的预测能力,并将其转化为嵌入向量的权重。条件注入机制采用零初始化的方式,保证在初始阶段不影响预训练模型的性能,然后逐步学习协变量信息。损失函数主要包括预测损失和正则化项,用于约束模型参数,避免过拟合。

🖼️ 关键图片

📊 实验亮点

实验结果表明,CoRA框架在协变量感知预测任务中,相对于最先进的深度预测器,实现了31.1%的MSE降低。此外,CoRA还表现出与多种先进TSFMs的强大兼容性,并且能够有效处理多种模态的协变量。这些结果验证了CoRA框架的有效性和通用性。

🎯 应用场景

CoRA框架可广泛应用于需要考虑多种协变量的时间序列预测任务中,例如:供应链预测(考虑天气、新闻等因素)、金融市场预测(考虑宏观经济指标、新闻舆情等因素)、能源需求预测(考虑气象数据、人口统计数据等因素)。该研究有助于提升时间序列预测的准确性和可靠性,为相关领域的决策提供更有效的支持。

📄 摘要(原文)

Time Series Foundation Models (TSFMs) have shown significant impact through their model capacity, scalability, and zero-shot generalization. However, due to the heterogeneity of inter-variate dependencies and the backbone scalability on large-scale multivariate datasets, most TSFMs are typically pre-trained on univariate time series. This limitation renders them oblivious to crucial information from diverse covariates in real-world forecasting tasks. To further enhance the performance of TSFMs, we propose a general covariate-aware adaptation (CoRA) framework for TSFMs. It leverages pre-trained backbones of foundation models while effectively incorporating exogenous covariates from various modalities, including time series, language, and images, to improve the quality of predictions. Technically, CoRA maintains the equivalence of initialization and parameter consistency during adaptation. With preserved backbones of foundation models as frozen feature extractors, the outcome embeddings from foundation models are empirically demonstrated more informative than raw data. Further, CoRA employs a novel Granger Causality Embedding (GCE) to automatically evaluate covariates regarding their causal predictability with respect to the target variate. We incorporate these weighted embeddings with a zero-initialized condition-injection mechanism, avoiding catastrophic forgetting of pre-trained foundation models and gradually integrates exogenous information. Extensive experiments show that CoRA of TSFMs surpasses state-of-the-art covariate-aware deep forecasters with full or few-shot training samples, achieving 31.1% MSE reduction on covariate-aware forecasting. Compared to other adaptation methods, CoRA exhibits strong compatibility with various advanced TSFMs and extends the scope of covariates to other modalities, presenting a practical paradigm for the application of TSFMs.