Deep SPI: Safe Policy Improvement via World Models

作者: Florent Delgrange, Raphael Avalos, Willem Röpke

分类: cs.LG, cs.AI

发布日期: 2025-10-14 (更新: 2026-01-28)

备注: ICLR 2026, 10 pages main text, 21 pages appendix (excluding references)

💡 一句话要点

提出DeepSPI算法,通过世界模型实现安全策略改进,提升在线强化学习性能

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture)

关键词: 安全策略改进 世界模型 深度强化学习 在线学习 策略优化

📋 核心要点

- 现有安全策略改进方法主要集中于离线强化学习,难以直接应用于复杂的在线环境。

- DeepSPI通过结合世界模型和表征学习,将策略更新限制在安全邻域内,保证单调改进和收敛。

- 实验表明,DeepSPI在ALE-57基准测试中表现优异,与PPO等算法相比具有竞争力,并保留了理论保证。

📝 摘要(中文)

安全策略改进(SPI)为策略更新提供了理论控制,但现有保证主要集中在离线、表格型强化学习(RL)上。本文研究了结合世界模型和表征学习的通用在线环境下的SPI。我们开发了一个理论框架,表明将策略更新限制在当前策略的明确定义的邻域内,可以确保单调改进和收敛。该分析将转移和奖励预测损失与表征质量联系起来,产生了离线RL文献中经典SPI定理的在线“深度”类似物。基于这些结果,我们引入了DeepSPI,这是一种基于原则的在线算法,它将局部转移和奖励损失与正则化的策略更新相结合。在ALE-57基准测试中,DeepSPI匹配或超过了包括PPO和DeepMDPs在内的强大基线,同时保留了理论保证。

🔬 方法详解

问题定义:论文旨在解决在线强化学习中安全策略改进的问题。现有方法,特别是传统的安全策略迭代方法,通常依赖于离线数据或表格型环境,难以直接应用于高维、连续状态空间的在线强化学习任务。此外,如何有效地利用世界模型来指导策略改进,同时保证策略的安全性和单调改进,是一个挑战。

核心思路:论文的核心思路是将安全策略改进的思想与深度学习和世界模型相结合。通过学习环境的动态模型(世界模型),并在该模型上进行策略评估和改进,可以避免直接与真实环境交互带来的风险。同时,通过限制策略更新的幅度,确保策略的改进是单调的,从而保证安全性。

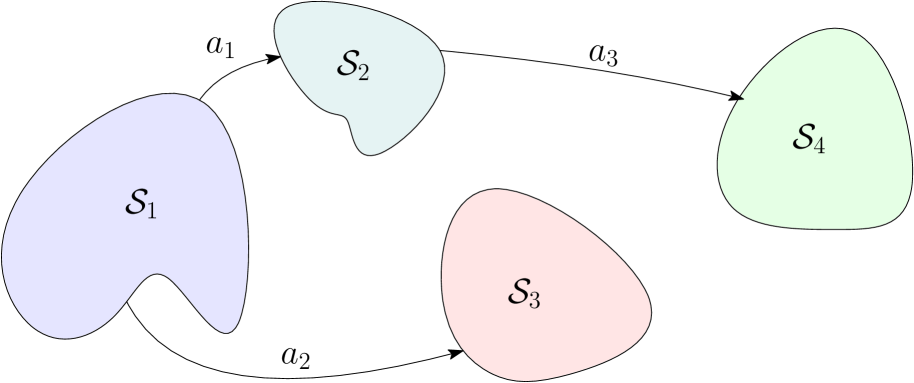

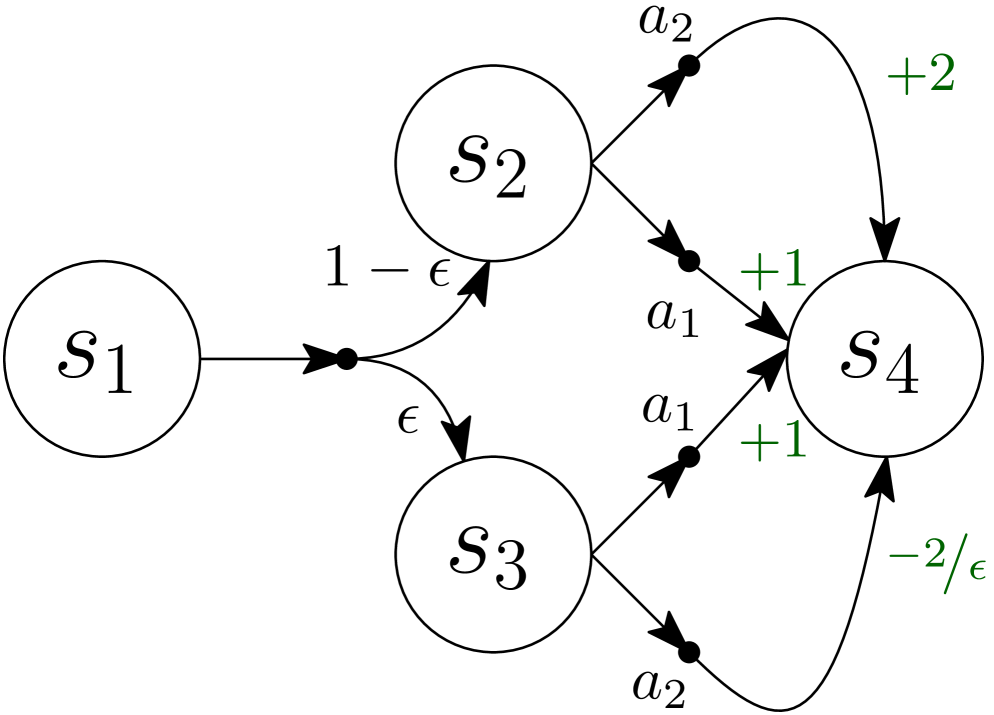

技术框架:DeepSPI的整体框架包括以下几个主要模块:1) 世界模型学习模块:用于学习环境的转移函数和奖励函数。2) 策略评估模块:利用世界模型评估当前策略的性能。3) 策略改进模块:基于策略评估的结果,更新策略,但限制更新幅度,以保证安全性。4) 表征学习模块:学习状态的有效表征,提高世界模型的预测精度和策略学习的效率。整个流程是一个迭代的过程,不断学习世界模型,评估和改进策略。

关键创新:论文最重要的技术创新点在于将离线安全策略改进的理论框架扩展到了在线深度强化学习领域。通过将转移和奖励预测损失与表征质量联系起来,建立了在线环境下的安全策略改进定理。此外,DeepSPI算法通过正则化的策略更新,有效地控制了策略更新的幅度,保证了策略的单调改进。

关键设计:DeepSPI的关键设计包括:1) 使用深度神经网络来表示世界模型和策略。2) 使用局部转移和奖励损失来训练世界模型,提高预测精度。3) 使用KL散度等正则化方法来限制策略更新的幅度。4) 使用合适的优化算法(如Adam)来训练神经网络。具体的参数设置需要根据具体的任务进行调整。

🖼️ 关键图片

📊 实验亮点

DeepSPI在ALE-57基准测试中取得了显著的成果,与PPO和DeepMDPs等先进算法相比,DeepSPI在多个游戏上取得了更好的性能,并且保留了理论上的安全保证。具体来说,DeepSPI在某些游戏上的得分超过了PPO,并且在所有测试的游戏中,DeepSPI的性能都与PPO相当或更好。

🎯 应用场景

DeepSPI具有广泛的应用前景,例如可以应用于机器人控制、自动驾驶、游戏AI等领域。通过学习环境的动态模型,DeepSPI可以在保证安全性的前提下,有效地改进策略,提高智能体的性能。此外,DeepSPI还可以应用于金融交易、医疗诊断等领域,帮助人们做出更明智的决策。

📄 摘要(原文)

Safe policy improvement (SPI) offers theoretical control over policy updates, yet existing guarantees largely concern offline, tabular reinforcement learning (RL). We study SPI in general online settings, when combined with world model and representation learning. We develop a theoretical framework showing that restricting policy updates to a well-defined neighborhood of the current policy ensures monotonic improvement and convergence. This analysis links transition and reward prediction losses to representation quality, yielding online, "deep" analogues of classical SPI theorems from the offline RL literature. Building on these results, we introduce DeepSPI, a principled on-policy algorithm that couples local transition and reward losses with regularised policy updates. On the ALE-57 benchmark, DeepSPI matches or exceeds strong baselines, including PPO and DeepMDPs, while retaining theoretical guarantees.