Chimera: State Space Models Beyond Sequences

作者: Aakash Lahoti, Tanya Marwah, Ratish Puduppully, Albert Gu

分类: cs.LG, cs.AI

发布日期: 2025-10-14

备注: Published in TMLR (October 2025); 22 Pages, 6 Figures, 11 Tables

💡 一句话要点

Chimera:提出一种超越序列建模的状态空间模型,统一处理不同拓扑结构的数据。

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture)

关键词: 状态空间模型 图神经网络 拓扑结构 归纳偏置 序列建模 图像分类 图数据挖掘

📋 核心要点

- 现有Transformer模型在处理具有拓扑结构的数据时,依赖于领域特定的归纳偏置,设计复杂且易引入副作用。

- Chimera通过推广状态空间模型,使其能够直接捕获任意图拓扑,无需额外的位置嵌入或随机游走等归纳偏置。

- 实验结果表明,Chimera在语言、视觉和图等多个领域均优于现有模型,验证了数据拓扑作为归纳偏置的有效性。

📝 摘要(中文)

基于Transformer的深度学习方法已成为建模序列、图像和图等多种数据的标准方法。这些方法依赖于自注意力机制,将数据视为无序的元素集合,忽略了数据的邻域结构或图拓扑。为了整合拓扑信息,通常需要引入领域相关的归纳偏置,例如序列和图像中的位置嵌入,或图中的随机游走。然而,设计这些任务特定的偏置需要大量工作,并且可能引入阻碍泛化的副作用。我们提出了Chimera,一种统一的模型,它以原则性的方式直接整合数据拓扑,从而消除了对领域特定偏置的需求。核心思想是,状态空间模型(本身不需要位置嵌入)可以被推广以捕获任何图拓扑。实验表明,Chimera在语言、视觉和图领域都取得了优异的性能,在GLUE上超过BERT 0.7个点,在ImageNet-1k上超过ViT 2.6%,并在Long Range Graph Benchmark上超过了所有基线。我们进一步提出了算法优化来提高Chimera的效率:(1)对于有向无环图,Chimera可以实现为线性时间递归;(2)对于一般图,一个简单的数学松弛可以实现Transformer的二次复杂度,而无需领域特定的启发式方法。这些结果验证了Chimera的核心贡献,并支持数据拓扑是跨模态的强大归纳偏置的观点。

🔬 方法详解

问题定义:现有Transformer模型在处理具有内在拓扑结构的数据(如图像和图)时,通常需要引入额外的归纳偏置(例如位置嵌入或随机游走)来编码这些结构信息。这些归纳偏置的设计往往是领域特定的,需要大量的人工设计和调整,并且可能会引入不利于模型泛化的副作用。因此,如何设计一种通用的模型,能够自动地学习和利用数据中的拓扑结构,是一个重要的研究问题。

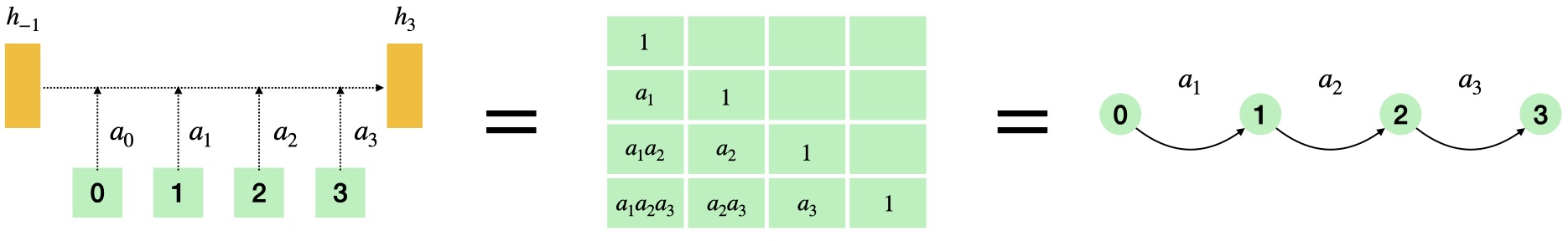

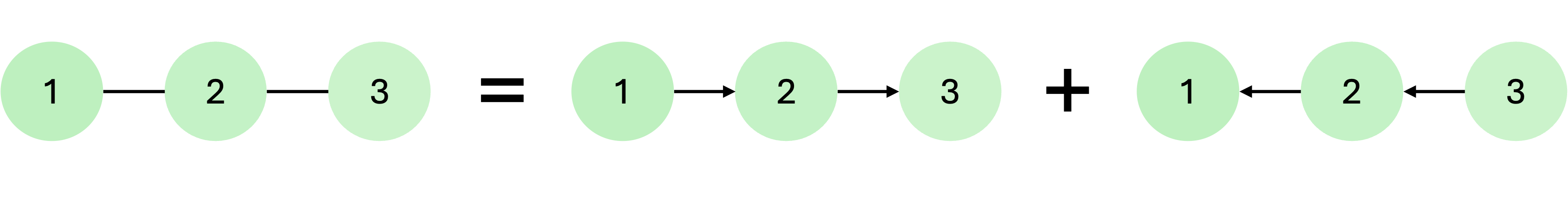

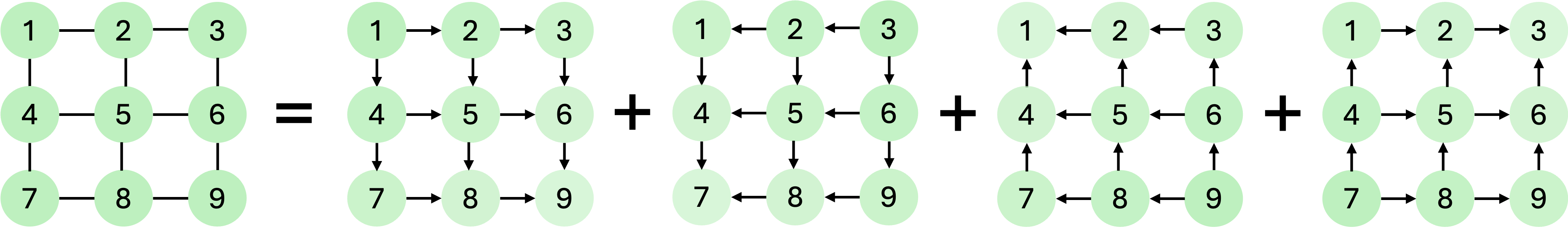

核心思路:Chimera的核心思路是将状态空间模型(State Space Model, SSM)推广到可以处理任意图拓扑的结构。传统的SSM主要用于处理序列数据,其特点是不需要显式的位置编码。Chimera通过将SSM的线性状态转移方程与图的邻接矩阵相结合,使得模型能够自然地感知和利用数据中的拓扑结构。这样,模型就可以在不需要人工设计归纳偏置的情况下,自动地学习到数据中的拓扑信息。

技术框架:Chimera的整体框架可以概括为以下几个步骤:1. 将输入数据表示为一个图结构,其中节点表示数据元素,边表示元素之间的关系。2. 构建一个基于状态空间模型的图神经网络,其中每个节点都对应一个状态向量。3. 使用图的邻接矩阵来定义状态向量之间的转移关系,使得信息可以在图中传播。4. 使用标准的训练方法(例如反向传播)来训练模型,使其能够学习到数据中的拓扑结构。

关键创新:Chimera最重要的技术创新在于它将状态空间模型与图结构相结合,从而实现了一种通用的拓扑感知模型。与传统的图神经网络相比,Chimera不需要手动设计消息传递规则,而是通过状态空间模型的线性转移方程自动地学习信息传递的方式。此外,Chimera还提出了一些算法优化,例如对于有向无环图,可以实现线性时间复杂度的计算,对于一般图,可以通过数学松弛来实现与Transformer相当的二次复杂度。

关键设计:Chimera的关键设计包括:1. 使用状态空间模型作为基本构建块,以避免对位置编码的依赖。2. 使用图的邻接矩阵来定义状态转移矩阵,从而将拓扑信息融入到模型中。3. 针对不同类型的图结构,提出了不同的算法优化,以提高模型的效率。例如,对于有向无环图,可以使用拓扑排序来实现线性时间复杂度的计算。对于一般图,可以使用矩阵分解或随机游走等方法来近似计算状态转移矩阵。

🖼️ 关键图片

📊 实验亮点

Chimera在多个领域取得了显著的性能提升。在GLUE基准测试中,Chimera超过BERT 0.7个点。在ImageNet-1k图像分类任务中,Chimera超过ViT 2.6%。在Long Range Graph Benchmark上,Chimera超过了所有基线模型。此外,论文还提出了针对有向无环图和一般图的算法优化,显著提高了Chimera的计算效率。

🎯 应用场景

Chimera作为一种通用的拓扑感知模型,具有广泛的应用前景。它可以应用于自然语言处理、计算机视觉、图数据挖掘等多个领域。例如,在自然语言处理中,Chimera可以用于建模句子的语法结构或文档的语义关系。在计算机视觉中,Chimera可以用于建模图像的场景图或视频中的对象关系。在图数据挖掘中,Chimera可以用于节点分类、链接预测等任务。该研究的实际价值在于提供了一种更加通用和高效的数据建模方法,可以减少对领域特定知识的依赖,并提高模型的泛化能力。未来,Chimera有望成为一种重要的深度学习工具,推动人工智能技术的发展。

📄 摘要(原文)

Transformer-based deep learning methods have become the standard approach for modeling diverse data such as sequences, images, and graphs. These methods rely on self-attention, which treats data as an unordered set of elements. This ignores the neighborhood structure or graph topology of the data and requires inductive biases--such as position embeddings in sequences and images, or random walks in graphs--to incorporate topology. However, designing such task-specific biases requires significant effort and can introduce side effects that hinder generalization. We introduce Chimera, a unified model that directly incorporates data topology in a principled way, removing the need for domain-specific biases. The key idea is that state space models--which naturally do not require position embeddings--can be generalized to capture any graph topology. Our experiments show that Chimera achieves strong performance across language, vision, and graph domains, outperforming BERT on GLUE by 0.7 points, ViT on ImageNet-1k by 2.6%, and all baselines on the Long Range Graph Benchmark. We further propose algorithmic optimizations to improve Chimera's efficiency: (1) for Directed Acyclic Graphs, Chimera can be implemented as a linear-time recurrence; (2) for general graphs, a simple mathematical relaxation achieves Transformer's quadratic complexity without domain-specific heuristics. These results validate Chimera's core contribution and support the idea that data topology is a powerful inductive bias across modalities.