Evaluating Open-Source Vision-Language Models for Multimodal Sarcasm Detection

作者: Saroj Basnet, Shafkat Farabi, Tharindu Ranasinghe, Diptesh Kanoji, Marcos Zampieri

分类: cs.LG

发布日期: 2025-10-13

备注: Accepted to ICDMW 2025 Workshop on Multimodal AI (MMAI). Full workshop info: https://icdmw25mmai.github.io/

期刊: Proc. IEEE International Conference on Data Mining Workshops (ICDMW 2025), Workshop on Multimodal AI (MMAI 2025), Los Angeles, USA, December 2025

💡 一句话要点

评估开源视觉-语言模型在多模态讽刺检测中的性能

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 多模态讽刺检测 视觉-语言模型 开源模型评估 零样本学习 少样本学习

📋 核心要点

- 多模态讽刺检测是理解复杂主观现象的关键,现有方法难以有效捕捉视觉和文本之间的微妙不一致。

- 本文采用零样本、单样本和少样本提示,评估多个先进开源视觉-语言模型在讽刺检测和解释生成方面的能力。

- 实验结果表明,现有模型在讽刺检测上表现尚可,但在生成高质量解释方面仍有不足,需要进一步微调。

📝 摘要(中文)

本文评估了七个最先进的开源视觉-语言模型(VLMs)——BLIP2、InstructBLIP、OpenFlamingo、LLaVA、PaliGemma、Gemma3和Qwen-VL——在零样本、单样本和少样本提示下检测多模态讽刺的能力。此外,还评估了这些模型生成讽刺实例解释的能力。我们在三个基准讽刺数据集(Muse、MMSD2.0和SarcNet)上评估了VLMs的性能。我们的主要目标有两个:(1)量化每个模型在检测讽刺图像-标题对方面的性能,以及(2)评估它们生成高质量解释的能力,这些解释突出了驱动讽刺的视觉-文本不一致性。结果表明,虽然当前模型在二元讽刺检测方面取得了一定的成功,但如果没有针对特定任务的微调,它们仍然无法生成高质量的解释。

🔬 方法详解

问题定义:论文旨在评估现有开源视觉-语言模型(VLMs)在多模态讽刺检测任务中的表现。现有的讽刺检测方法往往难以捕捉图像和文本之间微妙的语义不一致性,而大型VLMs有望通过其强大的多模态理解能力来解决这个问题。然而,这些模型在讽刺检测方面的实际性能和解释能力尚不明确。

核心思路:论文的核心思路是利用现有的开源VLMs,通过不同的prompting策略(零样本、单样本、少样本)来评估它们在多模态讽刺检测任务中的性能。同时,也评估模型生成解释的能力,以了解模型是否真正理解了讽刺背后的逻辑。通过对比不同模型的表现,可以了解当前VLMs在讽刺检测方面的优势和不足。

技术框架:论文采用的整体框架是:首先,选择七个具有代表性的开源VLMs(BLIP2, InstructBLIP, OpenFlamingo, LLaVA, PaliGemma, Gemma3, and Qwen-VL)。然后,在三个公开的多模态讽刺数据集(Muse, MMSD2.0, and SarcNet)上进行评估。评估分为两个方面:讽刺检测的准确率和生成解释的质量。对于讽刺检测,采用不同的prompting策略。对于解释生成,评估生成文本与人类标注的相似度。

关键创新:论文的主要创新在于对多个最新的开源VLMs在多模态讽刺检测任务上进行了系统的评估。之前的研究可能集中在特定模型或数据集上,而本文提供了一个更全面的比较。此外,论文还关注了模型生成解释的能力,这有助于理解模型是如何做出判断的,并为未来的研究提供了方向。

关键设计:论文的关键设计包括:1) 选择具有代表性的开源VLMs,覆盖了不同的模型架构和训练方式;2) 使用三个不同的数据集,以评估模型的泛化能力;3) 采用不同的prompting策略,以探索模型在不同条件下的性能;4) 同时评估讽刺检测的准确率和解释生成质量,以全面了解模型的性能。

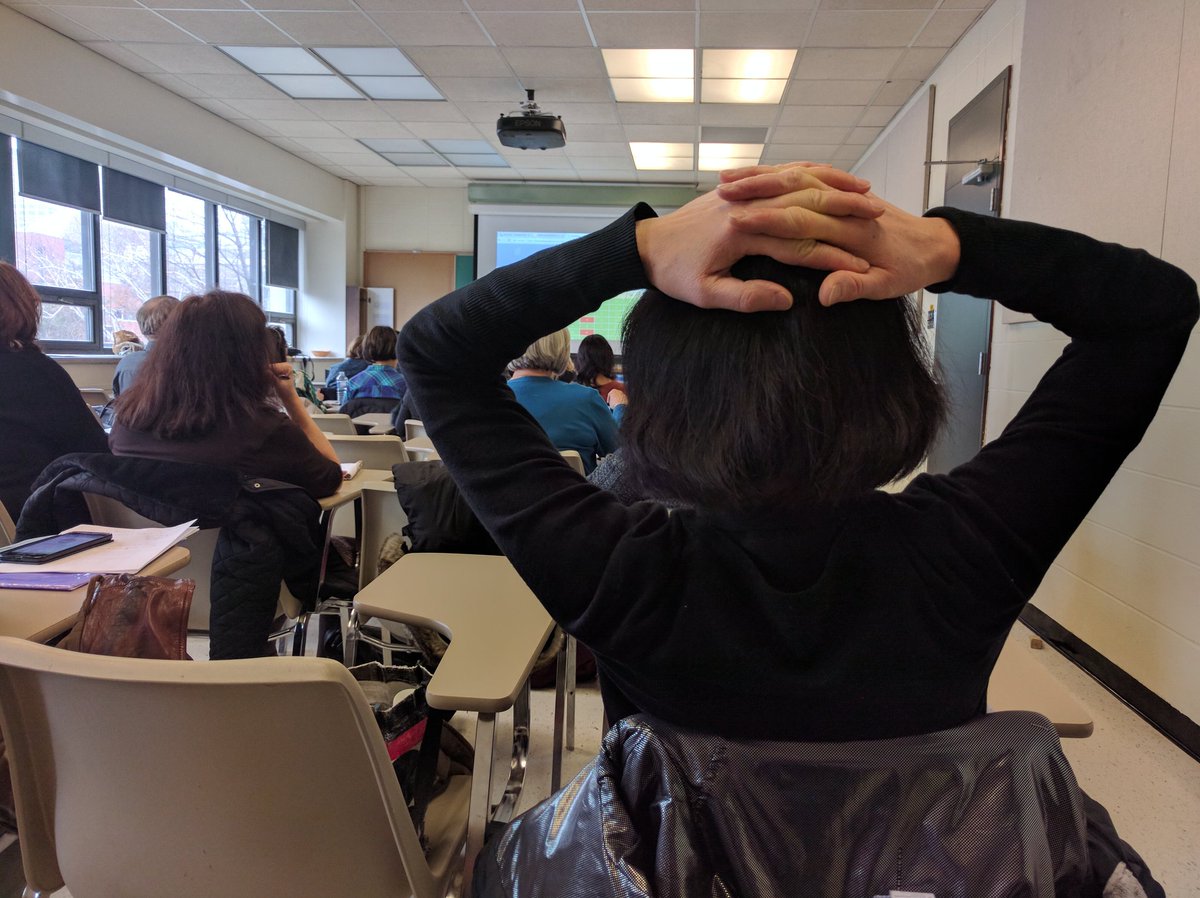

🖼️ 关键图片

📊 实验亮点

实验结果表明,当前开源VLMs在多模态讽刺检测方面取得了一定的成功,但性能差异较大。在二元讽刺检测任务中,部分模型表现出一定的识别能力,但整体准确率仍有提升空间。更重要的是,这些模型在生成高质量解释方面表现不佳,表明它们对讽刺的深层理解仍有不足,需要进一步的微调和优化。

🎯 应用场景

该研究成果可应用于社交媒体内容审核、情感分析、人机交互等领域。通过提升机器对讽刺的理解能力,可以更准确地识别网络欺凌、仇恨言论等不良信息,改善用户体验,并促进更自然的人机对话。未来,更强大的多模态讽刺检测模型有望应用于智能客服、虚拟助手等场景。

📄 摘要(原文)

Recent advances in open-source vision-language models (VLMs) offer new opportunities for understanding complex and subjective multimodal phenomena such as sarcasm. In this work, we evaluate seven state-of-the-art VLMs - BLIP2, InstructBLIP, OpenFlamingo, LLaVA, PaliGemma, Gemma3, and Qwen-VL - on their ability to detect multimodal sarcasm using zero-, one-, and few-shot prompting. Furthermore, we evaluate the models' capabilities in generating explanations to sarcastic instances. We evaluate the capabilities of VLMs on three benchmark sarcasm datasets (Muse, MMSD2.0, and SarcNet). Our primary objectives are twofold: (1) to quantify each model's performance in detecting sarcastic image-caption pairs, and (2) to assess their ability to generate human-quality explanations that highlight the visual-textual incongruities driving sarcasm. Our results indicate that, while current models achieve moderate success in binary sarcasm detection, they are still not able to generate high-quality explanations without task-specific finetuning.