Don't Walk the Line: Boundary Guidance for Filtered Generation

作者: Sarah Ball, Andreas Haupt

分类: cs.LG, cs.CL

发布日期: 2025-10-13

备注: 9 pages, 3 figures, 3 tables

💡 一句话要点

提出边界引导方法,提升生成模型安全性与效用性,避免生成结果落入分类器决策边界附近。

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture)

关键词: 生成模型 安全性 强化学习 边界引导 决策边界 安全分类器 LLM评估

📋 核心要点

- 现有方法微调生成器以减少被安全分类器过滤的概率,但易使生成结果接近决策边界,导致误判。

- 论文提出边界引导方法,通过强化学习明确引导生成远离分类器的边界,提升安全性和效用性。

- 实验表明,在越狱和模糊提示基准测试中,该方法在安全性和效用性上均优于现有方法,且具有鲁棒性。

📝 摘要(中文)

生成模型越来越多地与安全分类器结合使用,以过滤有害或不良输出。一种常见的策略是微调生成器,以降低被过滤的概率,但这可能并非最优:它通常会推动模型生成接近分类器决策边界的样本,从而增加假阳性和假阴性。我们提出了一种边界引导方法,这是一种强化学习微调方法,它明确地引导生成远离分类器的边界。在一个包含越狱和模糊提示的基准测试中,边界引导提高了输出的安全性和效用性,这由LLM-as-a-Judge评估判断。跨模型规模和奖励设计的全面消融实验证明了我们方法的鲁棒性。

🔬 方法详解

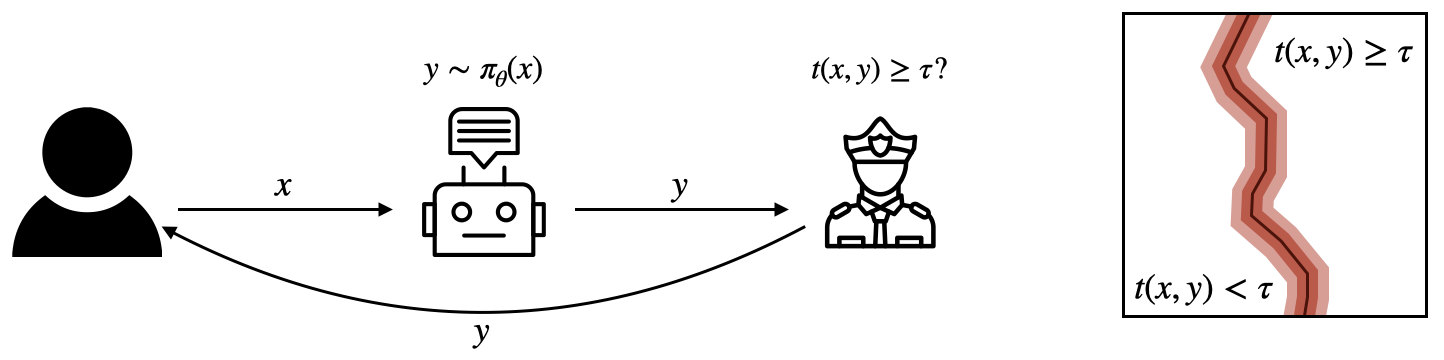

问题定义:论文旨在解决生成模型在对抗安全分类器时,微调策略容易使生成结果落入分类器决策边界附近的问题。现有方法简单地降低被过滤的概率,导致模型生成的结果虽然能通过安全检查,但同时也更容易被误判,即产生更多的假阳性和假阴性。这种现象降低了生成模型的实用性和安全性。

核心思路:论文的核心思路是通过强化学习,显式地引导生成模型远离安全分类器的决策边界。不同于以往仅关注降低被过滤概率的方法,该方法同时考虑了生成结果与决策边界的距离,鼓励生成更安全且更实用的样本。

技术框架:整体框架基于强化学习,主要包括以下几个模块:1) 生成模型(Generator):负责生成文本或其他类型的数据。2) 安全分类器(Safety Classifier):用于判断生成结果是否安全。3) 奖励函数(Reward Function):根据生成结果的安全性和与决策边界的距离,为生成模型提供奖励信号。4) 强化学习算法:利用奖励信号更新生成模型的参数,使其生成更安全且远离决策边界的结果。

关键创新:最重要的技术创新点在于引入了“边界引导”的概念,即在强化学习的奖励函数中,不仅考虑生成结果是否被安全分类器过滤,还考虑了生成结果与分类器决策边界的距离。这种显式地引导生成远离决策边界的方法,是与现有方法最本质的区别。

关键设计:关键设计包括:1) 奖励函数的设计:奖励函数需要平衡生成结果的安全性和与决策边界的距离。论文可能采用了多种奖励函数设计,并通过实验选择最优方案。2) 强化学习算法的选择:论文可能采用了常见的策略梯度算法,如REINFORCE或PPO,并根据具体任务进行了调整。3) 模型规模和训练参数的设置:论文可能针对不同规模的生成模型进行了实验,并调整了训练参数,以保证方法的有效性和鲁棒性。

🖼️ 关键图片

📊 实验亮点

实验结果表明,边界引导方法在越狱和模糊提示基准测试中,显著提高了生成模型的安全性和效用性。通过LLM-as-a-Judge评估,该方法在安全性指标和实用性指标上均优于现有方法。此外,消融实验证明了该方法在不同模型规模和奖励设计下的鲁棒性,表明其具有良好的泛化能力。

🎯 应用场景

该研究成果可应用于各种需要安全保障的生成模型,例如:对话系统、文本摘要、图像生成等。通过提升生成模型的安全性和实用性,可以减少有害信息的传播,提高用户体验,并降低模型被恶意利用的风险。未来,该方法可以进一步扩展到更复杂的场景,例如:多模态生成、对抗攻击防御等。

📄 摘要(原文)

Generative models are increasingly paired with safety classifiers that filter harmful or undesirable outputs. A common strategy is to fine-tune the generator to reduce the probability of being filtered, but this can be suboptimal: it often pushes the model toward producing samples near the classifier's decision boundary, increasing both false positives and false negatives. We propose Boundary Guidance, a reinforcement learning fine-tuning method that explicitly steers generation away from the classifier's margin. On a benchmark of jailbreak and ambiguous prompts, Boundary Guidance improves both the safety and the utility of outputs, as judged by LLM-as-a-Judge evaluations. Comprehensive ablations across model scales and reward designs demonstrate the robustness of our approach.