Query-Specific GNN: A Comprehensive Graph Representation Learning Method for Retrieval Augmented Generation

作者: Yuchen Yan, Zhihua Liu, Hao Wang, Weiming Li, Xiaoshuai Hao

分类: cs.LG, cs.AI

发布日期: 2025-10-13

🔗 代码/项目: GITHUB

💡 一句话要点

提出查询特定图神经网络(QSGNN)用于增强检索生成中多跳问题的知识检索。

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 检索增强生成 多跳问题 图神经网络 知识图谱 查询特定 表示学习 信息检索

📋 核心要点

- 现有RAG方法在处理多跳问题时,难以理解复杂语义结构,且易受检索噪声干扰。

- 提出QSGNN,通过多信息层知识图和查询引导的消息传递,实现更精确的知识检索。

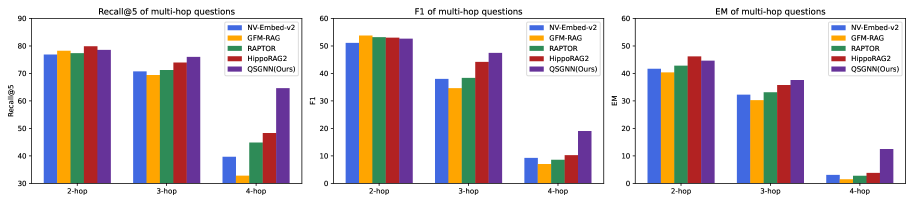

- 实验表明,QSGNN在多跳场景中表现出色,尤其在高跳问题上提升显著,最高达33.8%。

📝 摘要(中文)

检索增强生成(RAG)通过整合外部知识源来增强大型语言模型(LLMs)的能力。然而,需要识别多个知识目标以形成综合答案的多跳问题,对RAG系统提出了新的挑战。现有的方法通常难以充分理解具有复杂语义结构的查询,并且容易受到检索多个信息目标时产生的无关噪声的影响。为了解决这些限制,我们提出了一种用于多跳问题检索的新型图表示学习框架。我们首先引入一个多信息层知识图(Multi-L KG)来建模各种信息层,以便更全面地理解多跳问题。在此基础上,我们设计了一个查询特定图神经网络(QSGNN)用于在Multi-L KG上进行表示学习。QSGNN采用层内/层间消息传递机制,并且在每次消息传递中,信息聚合都由查询引导,这不仅有助于多粒度信息聚合,而且显著降低了噪声的影响。为了增强其学习鲁棒表示的能力,我们进一步提出了两种合成数据生成策略来预训练QSGNN。大量的实验结果表明了我们的框架在多跳场景中的有效性,尤其是在高跳问题中,改进可以达到33.8%。

🔬 方法详解

问题定义:论文旨在解决检索增强生成(RAG)系统中,针对多跳问题进行知识检索时面临的挑战。现有方法在处理复杂语义结构的多跳问题时,难以准确理解查询意图,并且在检索多个信息目标时容易受到无关噪声的干扰,导致检索结果不准确。

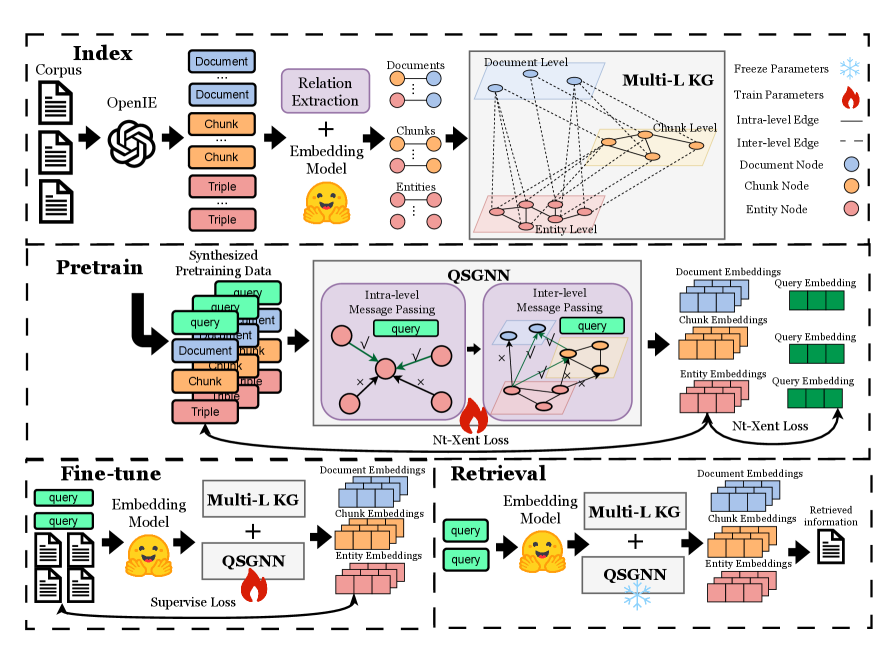

核心思路:论文的核心思路是构建一个查询特定的图神经网络(QSGNN),该网络能够根据查询动态地调整信息聚合方式,从而更有效地从知识图中提取相关信息。通过引入多信息层知识图(Multi-L KG),可以对知识进行多粒度的表示,从而更全面地理解多跳问题。

技术框架:整体框架包含以下几个主要步骤:1) 构建多信息层知识图(Multi-L KG),该图包含不同粒度的知识表示;2) 使用查询特定图神经网络(QSGNN)在Multi-L KG上进行表示学习,QSGNN采用层内和层间消息传递机制,并根据查询动态调整信息聚合权重;3) 使用合成数据生成策略预训练QSGNN,以增强其鲁棒性;4) 使用学习到的表示进行知识检索,并将其用于RAG系统的生成阶段。

关键创新:论文的关键创新在于提出了查询特定图神经网络(QSGNN),它能够根据查询动态地调整信息聚合方式,从而更有效地从知识图中提取相关信息。与传统的图神经网络相比,QSGNN引入了查询引导的消息传递机制,使得信息聚合更加关注与查询相关的信息,从而降低了噪声的影响。此外,多信息层知识图(Multi-L KG)的设计也使得模型能够更全面地理解多跳问题。

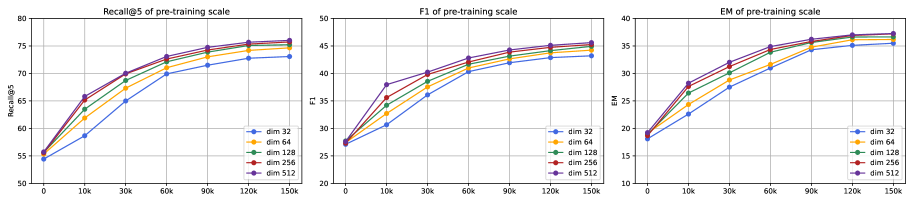

关键设计:QSGNN的关键设计包括:1) 查询引导的消息传递机制,通过注意力机制计算查询与节点之间的相关性,并将其作为信息聚合的权重;2) 多信息层知识图(Multi-L KG),包含实体、关系和属性等不同粒度的信息;3) 合成数据生成策略,用于生成包含不同跳数的合成问题,以增强模型的泛化能力。损失函数方面,可能采用了对比学习或交叉熵损失等方法,具体细节未在摘要中明确说明。

🖼️ 关键图片

📊 实验亮点

实验结果表明,提出的QSGNN框架在多跳场景中表现出色,尤其是在高跳问题中,改进可以达到33.8%。这表明该方法能够有效地处理复杂的多跳推理问题,并显著提升知识检索的准确性。具体的实验设置和对比基线未在摘要中详细说明,但33.8%的提升幅度足以证明该方法的有效性。

🎯 应用场景

该研究成果可应用于问答系统、智能助手、知识图谱检索等领域。通过提升多跳问题检索的准确性,可以显著改善这些应用的用户体验,并为更复杂的知识密集型任务提供支持。未来,该方法有望扩展到其他类型的知识图谱和RAG系统,进一步提升其性能和适用性。

📄 摘要(原文)

Retrieval-augmented generation (RAG) has demonstrated its ability to enhance Large Language Models (LLMs) by integrating external knowledge sources. However, multi-hop questions, which require the identification of multiple knowledge targets to form a synthesized answer, raise new challenges for RAG systems. Under the multi-hop settings, existing methods often struggle to fully understand the questions with complex semantic structures and are susceptible to irrelevant noise during the retrieval of multiple information targets. To address these limitations, we propose a novel graph representation learning framework for multi-hop question retrieval. We first introduce a Multi-information Level Knowledge Graph (Multi-L KG) to model various information levels for a more comprehensive understanding of multi-hop questions. Based on this, we design a Query-Specific Graph Neural Network (QSGNN) for representation learning on the Multi-L KG. QSGNN employs intra/inter-level message passing mechanisms, and in each message passing the information aggregation is guided by the query, which not only facilitates multi-granular information aggregation but also significantly reduces the impact of noise. To enhance its ability to learn robust representations, we further propose two synthesized data generation strategies for pre-training the QSGNN. Extensive experimental results demonstrate the effectiveness of our framework in multi-hop scenarios, especially in high-hop questions the improvement can reach 33.8\%. The code is available at: https://github.com/Jerry2398/QSGNN.