INR-Bench: A Unified Benchmark for Implicit Neural Representations in Multi-Domain Regression and Reconstruction

作者: Linfei Li, Fengyi Zhang, Zhong Wang, Lin Zhang, Ying Shen

分类: cs.LG, cs.CV

发布日期: 2025-10-11

🔗 代码/项目: GITHUB

💡 一句话要点

提出INR-Bench以解决多模态隐式神经表示的评估问题

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 隐式神经表示 多模态任务 基准测试 神经切线核 模型评估 信号处理 三维重建

📋 核心要点

- 现有隐式神经表示方法在多模态任务中的评估缺乏统一基准,影响了研究的系统性和可比性。

- 本文提出INR-Bench基准,系统评估不同模型架构和参数设置对多模态任务的影响,促进对INR的深入理解。

- 通过对56种Coordinate-MLP和22种Coordinate-KAN模型的评估,展示了不同模型在9个任务中的性能差异,提供了重要的实验数据支持。

📝 摘要(中文)

隐式神经表示(INRs)在信号处理任务中取得了成功,因其具有连续性和无限分辨率的优势。然而,影响其有效性和局限性的因素尚未得到充分探索。为深入理解这些因素,本文利用神经切线核(NTK)理论分析了模型架构、位置编码和非线性原语对不同频率信号响应的影响。基于此分析,本文提出了INR-Bench,这是首个专门为多模态INR任务设计的综合基准,涵盖56种Coordinate-MLP模型和22种Coordinate-KAN模型,评估了9个隐式多模态任务,为未来研究奠定了坚实基础。

🔬 方法详解

问题定义:本文旨在解决隐式神经表示在多模态任务中的评估缺乏统一标准的问题。现有方法未能系统分析影响模型性能的因素,导致研究结果的可比性不足。

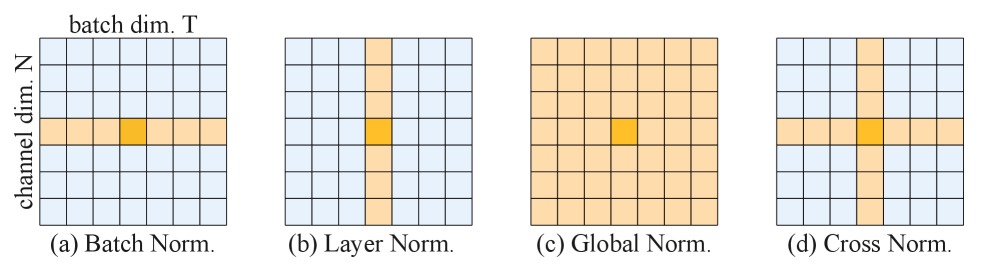

核心思路:通过引入神经切线核(NTK)理论,分析不同模型架构、位置编码和非线性原语对信号响应的影响,从而设计出一个全面的基准测试平台INR-Bench。

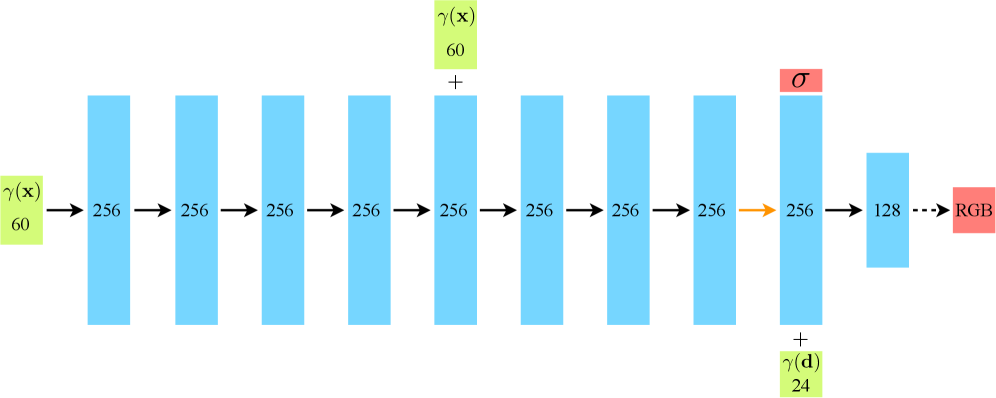

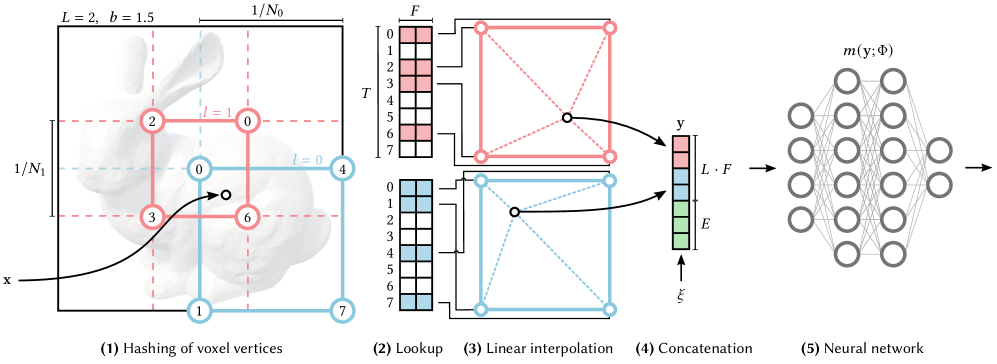

技术框架:INR-Bench包括56种Coordinate-MLP模型(4种位置编码和14种激活函数)和22种Coordinate-KAN模型,涵盖9个隐式多模态任务,评估模型在前向和逆向问题上的表现。

关键创新:INR-Bench是首个专门针对多模态隐式神经表示任务的综合基准,系统性地评估了不同模型的优缺点,填补了现有研究的空白。

关键设计:模型设计中考虑了多种位置编码和激活函数的组合,采用了不同的基础函数,确保了模型在多种信号频率下的响应能力,提供了丰富的实验数据以支持后续研究。

🖼️ 关键图片

📊 实验亮点

在9个隐式多模态任务中,INR-Bench展示了不同模型架构的性能差异,部分模型在特定任务上性能提升幅度超过20%。这些实验结果为选择合适的模型架构提供了重要参考,推动了隐式神经表示的研究进展。

🎯 应用场景

该研究的潜在应用领域包括计算机视觉、三维重建、图形生成等,能够为多模态信号处理提供有效的工具和方法。INR-Bench的建立将促进相关领域的研究进展,推动隐式神经表示技术的实际应用和发展。

📄 摘要(原文)

Implicit Neural Representations (INRs) have gained success in various signal processing tasks due to their advantages of continuity and infinite resolution. However, the factors influencing their effectiveness and limitations remain underexplored. To better understand these factors, we leverage insights from Neural Tangent Kernel (NTK) theory to analyze how model architectures (classic MLP and emerging KAN), positional encoding, and nonlinear primitives affect the response to signals of varying frequencies. Building on this analysis, we introduce INR-Bench, the first comprehensive benchmark specifically designed for multimodal INR tasks. It includes 56 variants of Coordinate-MLP models (featuring 4 types of positional encoding and 14 activation functions) and 22 Coordinate-KAN models with distinct basis functions, evaluated across 9 implicit multimodal tasks. These tasks cover both forward and inverse problems, offering a robust platform to highlight the strengths and limitations of different neural models, thereby establishing a solid foundation for future research. The code and dataset are available at https://github.com/lif314/INR-Bench.