Reinforcement Learning-Driven Edge Management for Reliable Multi-view 3D Reconstruction

作者: Motahare Mounesan, Sourya Saha, Houchao Gan, Md. Nurul Absur, Saptarshi Debroy

分类: cs.LG, cs.AI, cs.CV, cs.DC, cs.GR, cs.MM

发布日期: 2025-10-09

💡 一句话要点

提出基于强化学习的边缘管理框架,提升多视角3D重建在动态环境下的可靠性。

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture)

关键词: 多视角3D重建 边缘计算 强化学习 资源管理 Q-learning

📋 核心要点

- 边缘计算资源动态变化导致多视角3D重建的图像质量和网络稳定性下降,影响重建可靠性。

- 提出基于强化学习的边缘资源管理框架,通过相机和服务端选择,优化资源分配,提升重建质量。

- 在分布式测试平台上验证,该框架能有效平衡端到端延迟和重建质量,提升动态环境下的应用可靠性。

📝 摘要(中文)

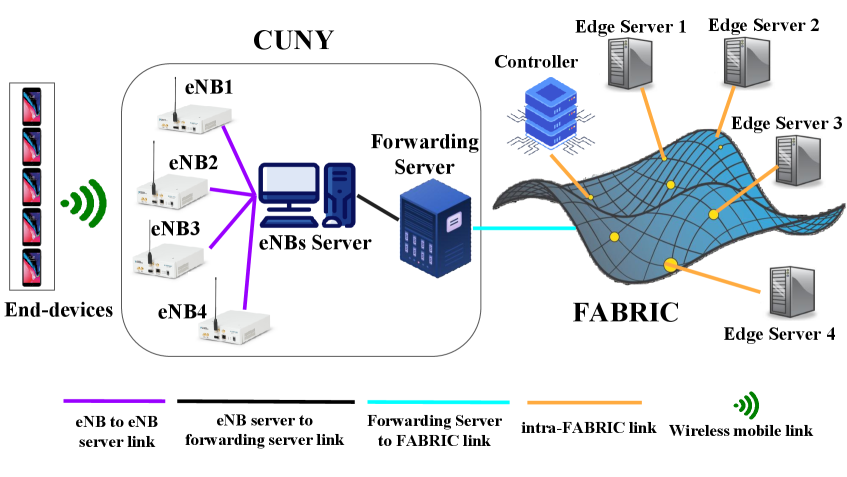

本文提出了一种基于强化学习(RL)的边缘资源管理框架,用于提升多视角3D重建的可靠性。该框架旨在解决边缘计算环境下资源动态变化和不可预测性带来的挑战,例如图像质量下降、网络连接不稳定和服务端负载波动。该框架采用两个协同的Q-learning智能体,分别负责相机选择和服务端选择,两者均在线运行,通过与边缘环境的交互学习策略。为了支持在真实约束下的学习和评估系统性能,我们实现了一个分布式测试平台,包括实验室托管的终端设备和FABRIC基础设施托管的边缘服务器,以模拟智能城市边缘基础设施在真实中断场景下的情况。实验结果表明,该框架通过有效平衡端到端延迟和重建质量,提高了动态环境下的应用可靠性。

🔬 方法详解

问题定义:多视角3D重建在边缘计算环境中面临资源约束和动态变化带来的挑战。现有方法难以适应边缘资源的不可预测性,导致重建质量下降、延迟增加,从而影响依赖于实时3D建模的应用,如火灾救援等场景的决策效率。

核心思路:论文的核心思路是利用强化学习,通过智能体与边缘环境的交互,学习最优的相机和服务端选择策略。这种方法能够根据当前环境状态动态调整资源分配,从而在资源受限和易受干扰的环境中,保证3D重建的质量和效率。

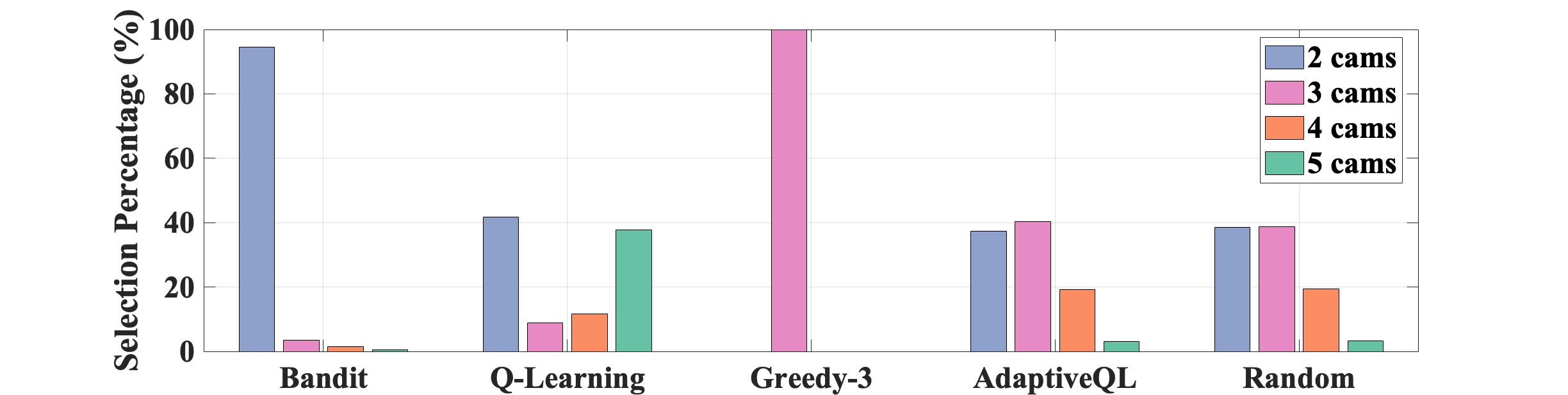

技术框架:该框架包含两个协同的Q-learning智能体:相机选择智能体和服务端选择智能体。这两个智能体在线运行,通过观察边缘环境的状态(如图像质量、网络延迟、服务器负载等),选择合适的相机和服务端进行3D重建。系统会根据重建结果(质量和延迟)给智能体提供奖励信号,智能体通过不断学习优化策略。

关键创新:该论文的关键创新在于将强化学习应用于边缘计算环境下的多视角3D重建资源管理。与传统的静态资源分配方法不同,该框架能够根据环境的动态变化自适应地调整资源分配策略,从而提高重建的可靠性和效率。此外,两个智能体的协同工作也提高了整体系统的性能。

关键设计:相机选择智能体和服务端选择智能体都使用Q-learning算法进行学习。状态空间包括图像质量、网络延迟、服务器负载等信息。动作空间包括可用的相机和服务端。奖励函数的设计需要平衡重建质量和延迟,例如,高质量的重建结果会获得更高的奖励,而过高的延迟会受到惩罚。具体的Q-learning参数(如学习率、折扣因子、探索率等)需要根据实际环境进行调整。

🖼️ 关键图片

📊 实验亮点

该论文通过在分布式测试平台上进行实验,验证了所提出的强化学习框架的有效性。实验结果表明,该框架能够在动态变化的边缘计算环境中,有效地平衡端到端延迟和重建质量,从而提高多视角3D重建的可靠性。具体的性能提升数据(例如,重建质量提升百分比、延迟降低百分比)需要在论文中查找。

🎯 应用场景

该研究成果可应用于多种边缘计算场景,例如智能城市、工业自动化和应急救援。在智能城市中,可用于实时监控和交通管理;在工业自动化中,可用于机器人导航和质量检测;在应急救援中,可用于火灾现场建模和灾情评估,为救援人员提供更全面的信息支持,提高救援效率。

📄 摘要(原文)

Real-time multi-view 3D reconstruction is a mission-critical application for key edge-native use cases, such as fire rescue, where timely and accurate 3D scene modeling enables situational awareness and informed decision-making. However, the dynamic and unpredictable nature of edge resource availability introduces disruptions, such as degraded image quality, unstable network links, and fluctuating server loads, which challenge the reliability of the reconstruction pipeline. In this work, we present a reinforcement learning (RL)-based edge resource management framework for reliable 3D reconstruction to ensure high quality reconstruction within a reasonable amount of time, despite the system operating under a resource-constrained and disruption-prone environment. In particular, the framework adopts two cooperative Q-learning agents, one for camera selection and one for server selection, both of which operate entirely online, learning policies through interactions with the edge environment. To support learning under realistic constraints and evaluate system performance, we implement a distributed testbed comprising lab-hosted end devices and FABRIC infrastructure-hosted edge servers to emulate smart city edge infrastructure under realistic disruption scenarios. Results show that the proposed framework improves application reliability by effectively balancing end-to-end latency and reconstruction quality in dynamic environments.