ELMUR: External Layer Memory with Update/Rewrite for Long-Horizon RL

作者: Egor Cherepanov, Alexey K. Kovalev, Aleksandr I. Panov

分类: cs.LG, cs.AI, cs.RO

发布日期: 2025-10-08

备注: 22 pages, 7 figures

💡 一句话要点

ELMUR:利用外部层记忆增强Transformer,解决长时程强化学习问题

🎯 匹配领域: 支柱一:机器人控制 (Robot Control)

关键词: 长时程强化学习 外部记忆 Transformer 部分可观测 机器人学习

📋 核心要点

- 现有强化学习方法难以处理部分可观测和长时程任务,因为它们无法有效利用长期依赖关系。

- ELMUR通过在Transformer的每一层引入结构化外部记忆,并使用LRU机制进行更新,从而解决了长时程依赖问题。

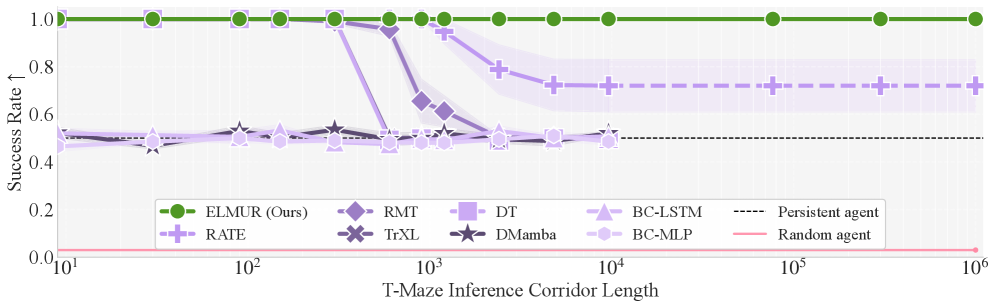

- 实验表明,ELMUR在合成T型迷宫、POPGym和MIKASA-Robo等任务中显著优于现有基线方法,提升了性能。

📝 摘要(中文)

真实世界的机器人智能体需要在部分可观测和长时程条件下行动,关键线索可能在影响决策之前很久就出现。然而,大多数现代方法仅依赖于瞬时信息,而没有结合过去的经验。标准循环或Transformer模型难以保留和利用长期依赖关系:上下文窗口会截断历史,而简单的记忆扩展在规模和稀疏性下会失效。我们提出了ELMUR(具有更新/重写的外部层记忆),这是一种具有结构化外部记忆的Transformer架构。每一层维护记忆嵌入,通过双向交叉注意力与它们交互,并通过使用替换或凸混合的最近最少使用(LRU)记忆模块更新它们。ELMUR将有效时程扩展到注意力窗口的100,000倍,并在走廊长度高达一百万步的合成T型迷宫任务中实现了100%的成功率。在POPGym中,它在超过一半的任务中优于基线。在具有视觉观测的MIKASA-Robo稀疏奖励操作任务中,它几乎使强基线的性能翻倍。这些结果表明,结构化的、层局部外部记忆为部分可观测下的决策提供了一种简单且可扩展的方法。

🔬 方法详解

问题定义:现有强化学习方法在处理长时程任务时,面临着无法有效利用长期依赖关系的问题。循环神经网络(RNN)和Transformer等模型在处理长序列时,存在梯度消失或计算复杂度过高的问题,导致无法记住很久之前的信息。简单的外部记忆扩展方法在面对大规模和稀疏数据时,也容易失效。因此,如何有效地利用长期记忆来指导决策是长时程强化学习中的一个关键挑战。

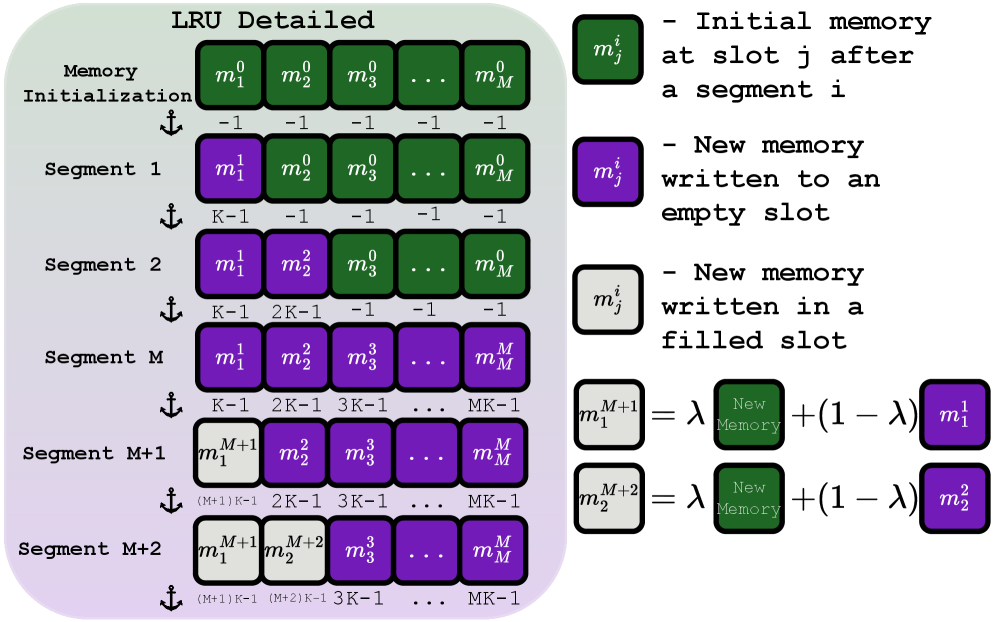

核心思路:ELMUR的核心思路是在Transformer的每一层都引入一个结构化的外部记忆模块。这个记忆模块可以存储和更新历史信息,并通过双向交叉注意力机制与当前层的输入进行交互。通过这种方式,模型可以利用长期记忆来指导决策,从而提高在长时程任务中的性能。此外,使用LRU机制来更新记忆,保证了记忆模块能够存储最相关的历史信息。

技术框架:ELMUR基于Transformer架构,并在每一层添加了一个外部记忆模块。整体流程如下:1. 输入数据经过Transformer层处理。2. 每一层都有一个外部记忆模块,存储该层的历史信息。3. 当前层的输入和记忆模块通过双向交叉注意力机制进行交互,从而将长期记忆融入到当前层的表示中。4. 记忆模块使用LRU机制进行更新,保留最相关的历史信息。5. 最终输出用于决策。

关键创新:ELMUR的关键创新在于引入了层局部的外部记忆模块,并使用LRU机制进行更新。与传统的全局记忆方法相比,层局部记忆可以更好地捕捉不同层次的抽象信息,并减少计算复杂度。LRU机制可以有效地保留最相关的历史信息,从而提高记忆模块的利用率。此外,使用双向交叉注意力机制可以更好地将长期记忆融入到当前层的表示中。

关键设计:ELMUR的关键设计包括:1. 每一层的记忆模块的大小,需要根据任务的复杂度和时程长度进行调整。2. LRU机制的更新策略,可以选择替换或凸混合。替换策略直接用新信息替换旧信息,而凸混合策略则将新信息和旧信息进行加权平均。3. 双向交叉注意力机制的实现细节,包括注意力头的数量和维度等。损失函数通常采用标准的强化学习损失函数,如Actor-Critic损失函数。

🖼️ 关键图片

📊 实验亮点

ELMUR在多个任务中取得了显著的性能提升。在合成T型迷宫任务中,ELMUR实现了100%的成功率,并将有效时程扩展到注意力窗口的100,000倍。在POPGym中,ELMUR在超过一半的任务中优于基线。在MIKASA-Robo稀疏奖励操作任务中,ELMUR几乎使强基线的性能翻倍。这些结果表明,ELMUR是一种有效的长时程强化学习方法。

🎯 应用场景

ELMUR具有广泛的应用前景,例如机器人导航、自动驾驶、游戏AI等需要长期规划和决策的领域。通过利用长期记忆,ELMUR可以帮助智能体更好地理解环境,并做出更明智的决策。此外,ELMUR还可以应用于自然语言处理、语音识别等领域,以提高模型对长序列数据的处理能力。该研究的实际价值在于提供了一种简单且可扩展的方法来解决长时程强化学习问题,并为未来的研究提供了新的思路。

📄 摘要(原文)

Real-world robotic agents must act under partial observability and long horizons, where key cues may appear long before they affect decision making. However, most modern approaches rely solely on instantaneous information, without incorporating insights from the past. Standard recurrent or transformer models struggle with retaining and leveraging long-term dependencies: context windows truncate history, while naive memory extensions fail under scale and sparsity. We propose ELMUR (External Layer Memory with Update/Rewrite), a transformer architecture with structured external memory. Each layer maintains memory embeddings, interacts with them via bidirectional cross-attention, and updates them through an Least Recently Used (LRU) memory module using replacement or convex blending. ELMUR extends effective horizons up to 100,000 times beyond the attention window and achieves a 100% success rate on a synthetic T-Maze task with corridors up to one million steps. In POPGym, it outperforms baselines on more than half of the tasks. On MIKASA-Robo sparse-reward manipulation tasks with visual observations, it nearly doubles the performance of strong baselines. These results demonstrate that structured, layer-local external memory offers a simple and scalable approach to decision making under partial observability.