Test-Time Efficient Pretrained Model Portfolios for Time Series Forecasting

作者: Mert Kayaalp, Caner Turkmen, Oleksandr Shchur, Pedro Mercado, Abdul Fatir Ansari, Michael Bohlke-Schneider, Bernie Wang

分类: cs.LG

发布日期: 2025-10-07

💡 一句话要点

提出时间序列预测的预训练模型组合方法,提升测试效率并保持精度。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 时间序列预测 预训练模型 模型组合 集成学习 模型选择

📋 核心要点

- 现有时间序列预测依赖大型单体模型,参数量大,测试效率低,且模型能力存在冗余。

- 构建小型预训练模型组合,通过集成或模型选择,在保证预测精度的同时,显著降低参数量和计算成本。

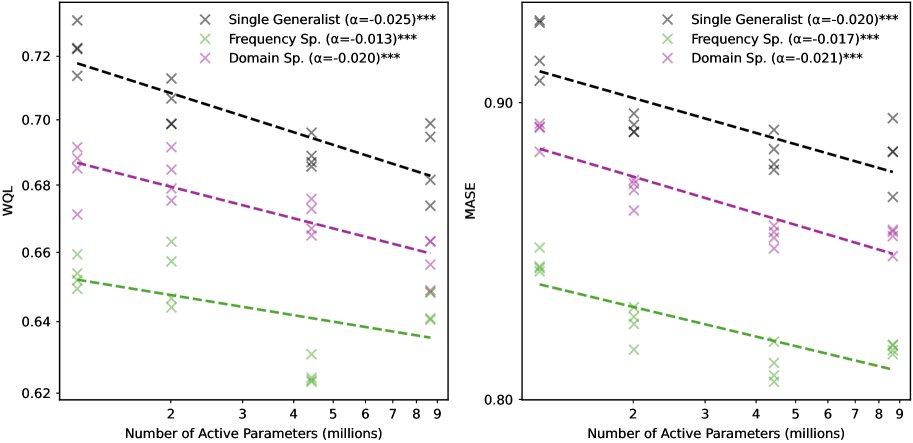

- 实验表明,专家模型组合优于通用模型组合,且后训练是创建多样化专家的有效方法,集成和模型选择优于微调。

📝 摘要(中文)

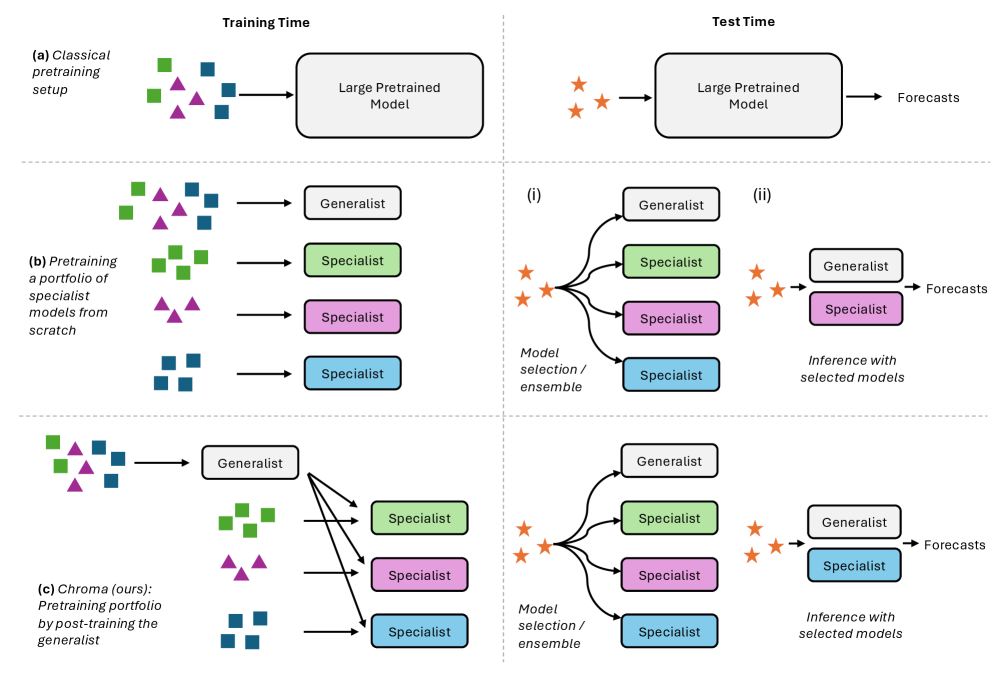

本文探讨了时间序列预测中,是否模型越大越好。研究提出了一种替代单一大模型的方案:构建一个由较小的、预训练预测模型组成的投资组合。通过对这些模型组合应用集成或模型选择,可以在大规模基准测试中实现具有竞争力的性能,同时使用更少的参数。研究探索了设计此类投资组合的策略,发现专家模型集合始终优于独立训练的通用模型组合。值得注意的是,研究表明对基础模型进行后训练是创建足够多样化的专家的一种计算有效方法,并提供了证据表明集成和模型选择比测试时微调更具计算效率。

🔬 方法详解

问题定义:论文旨在解决时间序列预测中,大型预训练模型参数冗余、测试效率低下的问题。现有方法通常依赖于训练单个庞大的模型,这导致了高昂的计算成本和部署难度,尤其是在资源受限的环境下。此外,通用模型可能无法很好地适应所有类型的时间序列数据,导致预测精度下降。

核心思路:论文的核心思路是构建一个由多个小型、预训练的“专家”模型组成的投资组合。每个专家模型专注于特定类型或特征的时间序列数据。通过集成这些专家模型的预测结果,或者根据输入数据选择合适的专家模型,可以在保证预测精度的同时,显著降低参数量和计算成本。

技术框架:该方法主要包含以下几个阶段:1) 预训练阶段:训练多个小型的时间序列预测模型,每个模型可以采用不同的架构或在不同的数据集上进行训练,以形成多样化的专家模型。2) 模型组合设计阶段:探索不同的策略来构建模型组合,例如随机选择、基于聚类的选择或基于元学习的选择。3) 集成或模型选择阶段:使用集成方法(如平均、加权平均)或模型选择方法(如基于规则的选择、基于学习的选择)来组合专家模型的预测结果。

关键创新:论文的关键创新在于提出了使用预训练模型组合来替代单一大模型的思想,并探索了多种构建和使用模型组合的策略。特别地,论文发现通过对基础模型进行后训练可以有效地创建多样化的专家模型,并且集成和模型选择比测试时微调更具计算效率。

关键设计:论文中涉及的关键设计包括:1) 专家模型的架构选择:可以使用不同的时间序列预测模型,如Transformer、LSTM等。2) 专家模型的训练数据选择:可以使用不同的时间序列数据集或对原始数据集进行采样,以训练出具有不同专长的模型。3) 集成或模型选择策略的选择:可以使用不同的集成方法(如平均、加权平均)或模型选择方法(如基于规则的选择、基于学习的选择),具体选择取决于数据集的特性和计算资源的限制。

🖼️ 关键图片

📊 实验亮点

实验结果表明,所提出的预训练模型组合方法在多个大规模时间序列基准测试中取得了具有竞争力的性能,同时使用的参数量远小于单一大模型。例如,在某个基准测试中,该方法在保持预测精度的前提下,将参数量降低了50%以上。此外,实验还证明了后训练是创建多样化专家模型的有效方法,并且集成和模型选择比测试时微调更具计算效率。

🎯 应用场景

该研究成果可应用于各种时间序列预测场景,如金融市场预测、供应链管理、能源需求预测、交通流量预测等。通过构建高效的预训练模型组合,可以在资源受限的环境下实现高精度的预测,降低计算成本,并提高模型的泛化能力。该方法还有助于推动时间序列预测领域向更轻量级、更高效的方向发展。

📄 摘要(原文)

Is bigger always better for time series foundation models? With the question in mind, we explore an alternative to training a single, large monolithic model: building a portfolio of smaller, pretrained forecasting models. By applying ensembling or model selection over these portfolios, we achieve competitive performance on large-scale benchmarks using much fewer parameters. We explore strategies for designing such portfolios and find that collections of specialist models consistently outperform portfolios of independently trained generalists. Remarkably, we demonstrate that post-training a base model is a compute-effective approach for creating sufficiently diverse specialists, and provide evidences that ensembling and model selection are more compute-efficient than test-time fine-tuning.