Reference Grounded Skill Discovery

作者: Seungeun Rho, Aaron Trinh, Danfei Xu, Sehoon Ha

分类: cs.LG, cs.AI

发布日期: 2025-10-07 (更新: 2025-12-02)

💡 一句话要点

提出参考引导的技能发现算法RGSD,用于高自由度智能体技能学习。

🎯 匹配领域: 支柱一:机器人控制 (Robot Control) 支柱二:RL算法与架构 (RL & Architecture) 支柱六:视频提取与匹配 (Video Extraction)

关键词: 技能发现 强化学习 对比学习 运动控制 高自由度 参考引导 无监督学习

📋 核心要点

- 高自由度智能体的无监督技能发现面临探索空间指数增长的挑战,而有意义的技能流形却很有限。

- RGSD算法通过对比预训练将运动嵌入到语义空间,引导智能体同时模仿参考行为并探索相关行为变体。

- 在SMPL人体模拟实验中,RGSD成功模仿并泛化了多种技能,并在下游任务中超越了模仿学习方法。

📝 摘要(中文)

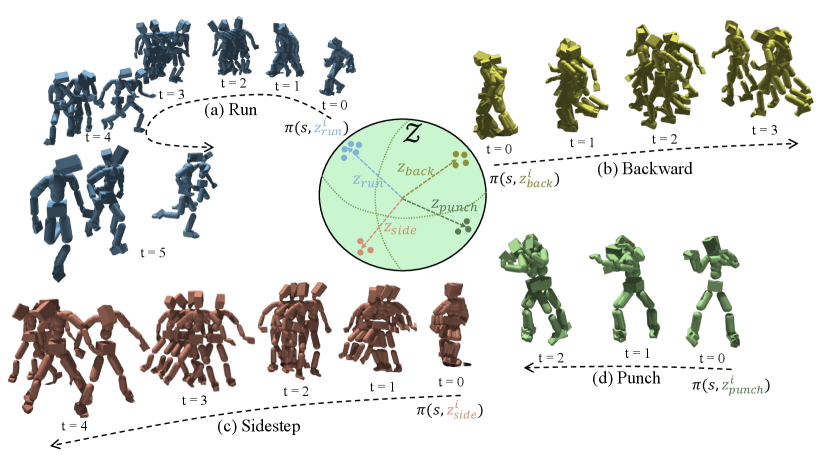

本文提出了一种新的算法,即参考引导的技能发现(RGSD),该算法利用参考数据将技能发现建立在语义上有意义的潜在空间中。RGSD首先执行对比预训练,将运动嵌入到单位超球面上,并将每个参考轨迹聚类到不同的方向。这种引导使得技能发现能够同时模仿参考行为,并发现语义相关的多样化行为。在具有359维观测和69维动作的模拟SMPL人体上,RGSD成功地模仿了行走、跑步、拳击和侧步等技能,同时也发现了这些行为的变体。在下游的运动任务中,RGSD利用发现的技能来忠实地满足用户指定的风格命令,并且优于模仿学习基线,后者通常无法保持命令的风格。总的来说,我们的结果表明,轻量级的参考引导为在高自由度系统中发现语义丰富且结构化的技能提供了一条实用的途径。

🔬 方法详解

问题定义:现有的无监督技能发现算法在高自由度智能体上难以扩展。随着维度增加,探索空间呈指数增长,而有意义的技能流形却相对有限。因此,如何有效地引导智能体在高维空间中进行探索,发现具有语义意义的技能,是一个关键问题。现有方法往往难以在探索效率和技能质量之间取得平衡。

核心思路:RGSD的核心思路是利用参考数据来引导技能发现过程。通过将技能嵌入到一个语义上有意义的潜在空间中,RGSD能够同时实现对参考行为的模仿和对相关行为变体的探索。这种方法利用了参考数据提供的先验知识,从而显著提高了探索效率和技能的语义一致性。

技术框架:RGSD算法主要包含两个阶段:参考数据预训练阶段和技能发现阶段。在预训练阶段,RGSD使用对比学习方法将参考运动轨迹嵌入到一个单位超球面上,每个参考轨迹对应一个不同的方向。在技能发现阶段,RGSD利用预训练得到的嵌入空间作为引导,鼓励智能体学习与参考行为相似但又具有多样性的技能。整个框架可以看作是一个分层强化学习结构,其中底层策略学习具体的运动控制,而高层策略则负责在嵌入空间中选择技能。

关键创新:RGSD的关键创新在于将参考数据引入到无监督技能发现过程中,从而实现了语义引导的探索。与传统的无监督技能发现方法相比,RGSD能够更有效地发现具有语义意义和结构化的技能。此外,RGSD采用的对比学习方法能够有效地将运动轨迹嵌入到潜在空间中,从而为后续的技能发现提供了良好的基础。

关键设计:RGSD的关键设计包括:1) 使用对比损失函数进行预训练,鼓励相似的运动轨迹在嵌入空间中靠近,不同的运动轨迹远离;2) 在技能发现阶段,使用一个额外的奖励函数,鼓励智能体学习与参考行为相似但又具有多样性的技能;3) 使用Actor-Critic框架进行强化学习,其中Actor网络负责生成动作,Critic网络负责评估状态的价值。

🖼️ 关键图片

📊 实验亮点

RGSD在模拟SMPL人体上成功模仿了行走、跑步、拳击和侧步等技能,并发现了这些行为的变体。在下游运动任务中,RGSD能够忠实地满足用户指定的风格命令,并且优于模仿学习基线。例如,RGSD能够生成具有特定风格(如快速行走或慢速跑步)的运动轨迹,而模仿学习方法往往无法保持命令的风格。实验结果表明,RGSD能够有效地发现语义丰富且结构化的技能。

🎯 应用场景

RGSD算法可应用于机器人运动控制、虚拟角色动画生成、人机交互等领域。例如,可以利用RGSD为机器人学习各种复杂的运动技能,使其能够更好地适应不同的环境和任务。在虚拟角色动画生成方面,RGSD可以生成更加自然和逼真的动画效果。在人机交互方面,RGSD可以帮助机器人更好地理解人类的意图,并做出相应的反应。该研究的未来影响在于降低机器人技能学习的难度,加速机器人在实际场景中的应用。

📄 摘要(原文)

Scaling unsupervised skill discovery algorithms to high-DoF agents remains challenging. As dimensionality increases, the exploration space grows exponentially, while the manifold of meaningful skills remains limited. Therefore, semantic meaningfulness becomes essential to effectively guide exploration in high-dimensional spaces. In this work, we present Reference-Grounded Skill Discovery (RGSD), a novel algorithm that grounds skill discovery in a semantically meaningful latent space using reference data. RGSD first performs contrastive pretraining to embed motions on a unit hypersphere, clustering each reference trajectory into a distinct direction. This grounding enables skill discovery to simultaneously involve both imitation of reference behaviors and the discovery of semantically related diverse behaviors. On a simulated SMPL humanoid with $359$-D observations and $69$-D actions, RGSD successfully imitates skills such as walking, running, punching, and sidestepping, while also discover variations of these behaviors. In downstream locomotion tasks, RGSD leverages the discovered skills to faithfully satisfy user-specified style commands and outperforms imitation-learning baselines, which often fail to maintain the commanded style. Overall, our results suggest that lightweight reference-grounding offers a practical path to discovering semantically rich and structured skills in high-DoF systems.