Differentiable Model Predictive Control on the GPU

作者: Emre Adabag, Marcus Greiff, John Subosits, Thomas Lew

分类: math.OC, cs.LG, eess.SY

发布日期: 2025-10-07

💡 一句话要点

提出GPU加速的可微模型预测控制,提升强化学习和模仿学习训练速度。

🎯 匹配领域: 支柱一:机器人控制 (Robot Control) 支柱二:RL算法与架构 (RL & Architecture)

关键词: 可微模型预测控制 GPU加速 序列二次规划 预处理共轭梯度 强化学习 模仿学习 自动驾驶

📋 核心要点

- 传统MPC优化算法的顺序性限制了其在GPU上的并行化,阻碍了学习与控制的结合。

- 论文提出一种GPU加速的可微优化工具,利用序列二次规划和定制PCG例程实现高效并行。

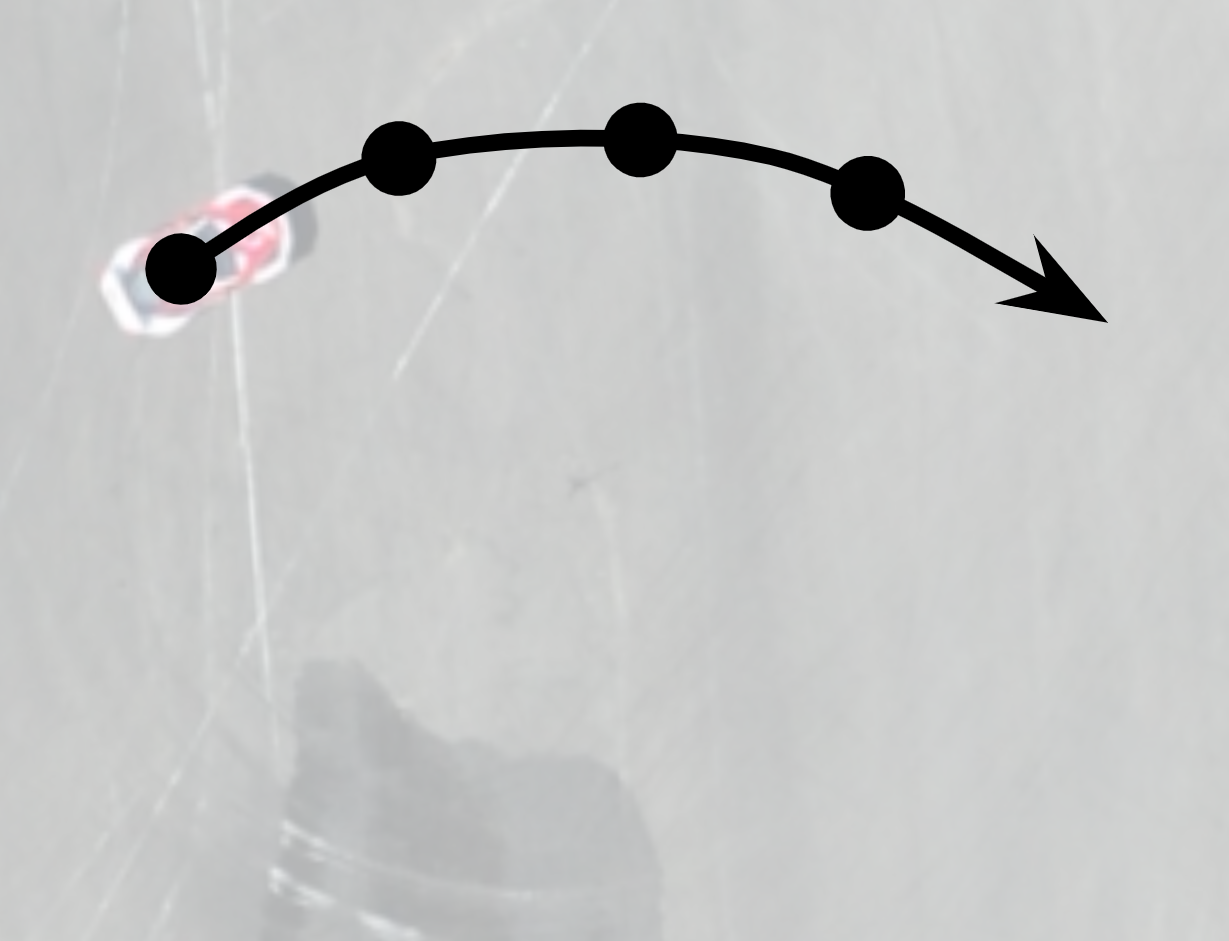

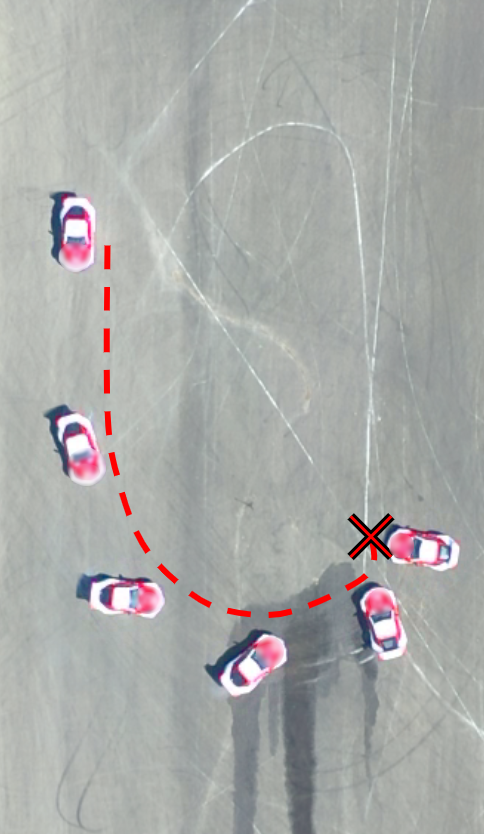

- 实验表明,该方法在强化学习和模仿学习任务中显著加速,并成功应用于汽车漂移动作控制。

📝 摘要(中文)

可微模型预测控制(MPC)为结合学习和控制提供了一个强大的框架。然而,由于传统优化算法的固有顺序性,难以在GPU等现代计算硬件上并行化,限制了其应用。本文通过引入一种GPU加速的MPC可微优化工具来解决这一瓶颈。该求解器利用序列二次规划和一个定制的、带有三对角预处理的预处理共轭梯度(PCG)例程,以利用问题的结构并实现高效的并行化。我们展示了相对于基于CPU和GPU的基线的显著加速,显著提高了基准强化学习和模仿学习任务的最新训练时间。最后,我们在具有挑战性的驾驶极限强化学习任务中展示了该方法,它能够使丰田Supra在水坑中稳健漂移。

🔬 方法详解

问题定义:论文旨在解决可微模型预测控制(MPC)在GPU上并行化效率低下的问题。传统的MPC优化算法本质上是串行的,难以充分利用GPU的并行计算能力,这限制了其在需要快速响应和大量计算的场景中的应用,例如强化学习和模仿学习中的策略训练。现有方法无法充分利用问题的结构,导致计算效率低下。

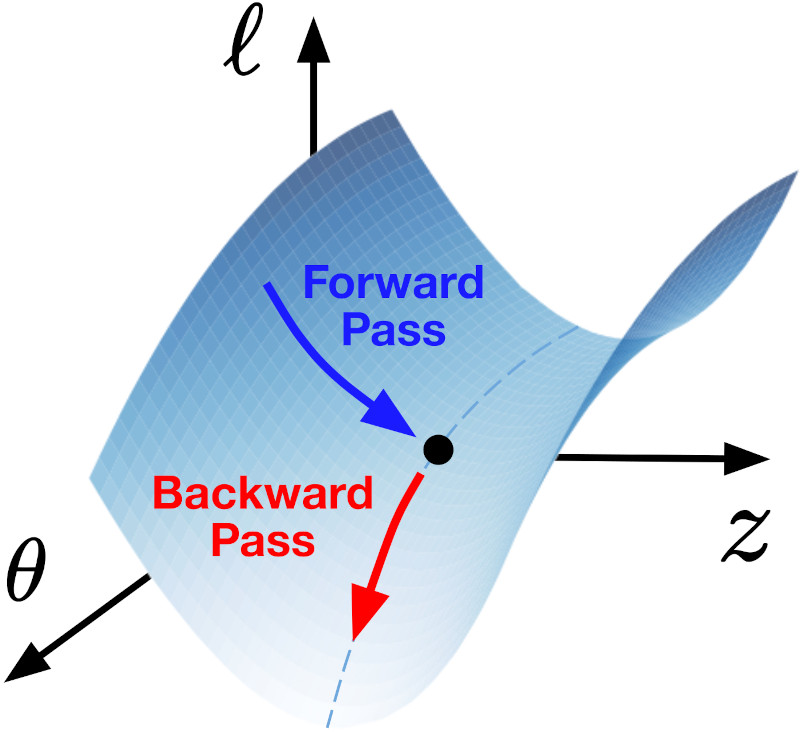

核心思路:论文的核心思路是设计一种能够充分利用GPU并行计算能力的可微优化求解器。通过定制的预处理共轭梯度(PCG)方法,结合序列二次规划(SQP),并针对MPC问题的特殊结构进行优化,实现高效的并行化求解。这种设计允许在GPU上同时处理多个优化步骤,从而显著提高计算速度。

技术框架:整体框架包括以下几个主要模块:1) 状态空间模型:描述系统的动态特性。2) 序列二次规划(SQP):用于将非线性优化问题转化为一系列二次规划子问题。3) 预处理共轭梯度(PCG):用于高效求解二次规划子问题,其中使用了针对MPC问题结构定制的三对角预处理。4) GPU加速:将整个计算流程移植到GPU上,利用其并行计算能力加速优化过程。

关键创新:最重要的技术创新点在于定制的预处理共轭梯度(PCG)方法和针对MPC问题结构的三对角预处理。传统的PCG方法可能收敛速度较慢,而论文通过分析MPC问题的结构特性,设计了一种专门的三对角预处理方法,显著提高了PCG的收敛速度。此外,将整个优化流程移植到GPU上,充分利用了GPU的并行计算能力。

关键设计:论文的关键设计包括:1) 三对角预处理矩阵的设计,该矩阵能够有效降低PCG的条件数,加速收敛。2) 损失函数的设计,用于衡量预测轨迹与目标轨迹之间的差异,并指导优化过程。3) 针对GPU架构的优化,例如内存访问模式和线程分配策略,以最大化GPU的利用率。

🖼️ 关键图片

📊 实验亮点

实验结果表明,该方法在强化学习和模仿学习任务中实现了显著的加速。例如,在驾驶极限强化学习任务中,该方法能够使丰田Supra在水坑中稳健漂移,并且训练时间相比于CPU和GPU基线方法有显著提升。具体性能数据(例如训练时间缩短比例)在论文中进行了详细展示。

🎯 应用场景

该研究成果可广泛应用于机器人控制、自动驾驶、运动规划等领域。特别是在需要快速响应和高精度控制的场景下,例如无人机集群控制、高速运动机器人、以及自动驾驶中的紧急避障等。通过加速MPC的计算速度,可以实现更复杂的控制策略和更强的环境适应性,从而提升系统的整体性能和安全性。

📄 摘要(原文)

Differentiable model predictive control (MPC) offers a powerful framework for combining learning and control. However, its adoption has been limited by the inherently sequential nature of traditional optimization algorithms, which are challenging to parallelize on modern computing hardware like GPUs. In this work, we tackle this bottleneck by introducing a GPU-accelerated differentiable optimization tool for MPC. This solver leverages sequential quadratic programming and a custom preconditioned conjugate gradient (PCG) routine with tridiagonal preconditioning to exploit the problem's structure and enable efficient parallelization. We demonstrate substantial speedups over CPU- and GPU-based baselines, significantly improving upon state-of-the-art training times on benchmark reinforcement learning and imitation learning tasks. Finally, we showcase the method on the challenging task of reinforcement learning for driving at the limits of handling, where it enables robust drifting of a Toyota Supra through water puddles.