Edit-Based Flow Matching for Temporal Point Processes

作者: David Lüdke, Marten Lienen, Marcel Kollovieh, Stephan Günnemann

分类: cs.LG

发布日期: 2025-10-07 (更新: 2025-10-08)

💡 一句话要点

提出基于编辑操作的流匹配模型,用于提升时间点过程的生成效率与灵活性。

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture)

关键词: 时间点过程 生成模型 流匹配 编辑操作 连续时间马尔可夫链

📋 核心要点

- 现有时间点过程模型依赖自回归参数化,存在顺序采样限制,影响生成效率。

- 提出基于编辑操作的流匹配模型,通过插入、删除和替换操作实现噪声到数据的转换。

- 实验结果表明,该模型在生成灵活性和效率方面均优于现有方法,尤其是在减少编辑操作数量方面。

📝 摘要(中文)

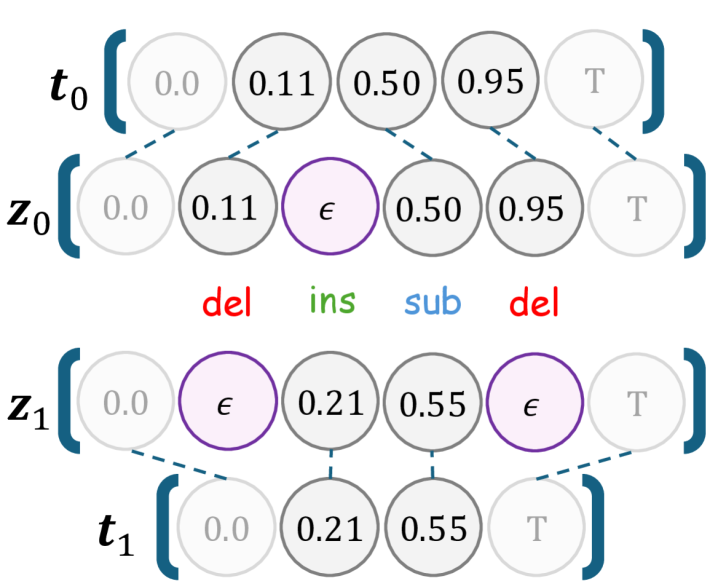

时间点过程(TPPs)是建模连续时间事件序列的基础工具,但现有方法大多依赖于自回归参数化,受限于其顺序采样。最近的非自回归扩散模型通过在离散马尔可夫链中插入和删除事件来联合插值噪声和数据,从而缓解了这些问题。本文推广了这一视角,并为TPPs引入了一种编辑流过程,该过程通过插入、删除和替换编辑操作将噪声转换为数据。通过学习连续时间马尔可夫链框架内的瞬时编辑率,我们获得了一个灵活高效的模型,有效地减少了生成过程中所需的编辑操作总数。实验结果表明,我们无条件训练的模型在基准TPPs上的各种无条件和条件生成任务中具有生成灵活性。

🔬 方法详解

问题定义:时间点过程(TPPs)旨在对连续时间内的事件序列进行建模。现有方法,特别是基于自回归的模型,在生成事件序列时需要逐个采样,效率较低,且难以捕捉全局依赖关系。扩散模型虽然有所改进,但仍然依赖离散的马尔可夫链进行编辑操作,存在优化空间。

核心思路:本文的核心在于将事件序列的生成过程视为一个连续时间内的编辑流,通过学习瞬时编辑率来控制事件的插入、删除和替换。这种方法不再依赖于离散的马尔可夫链,而是直接在连续时间域内进行优化,从而提高生成效率和灵活性。

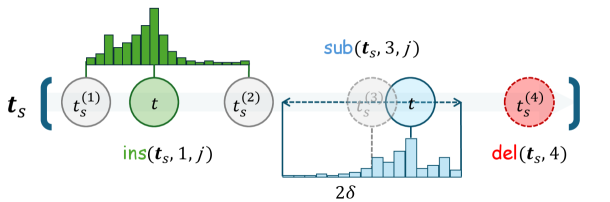

技术框架:该模型基于连续时间马尔可夫链框架,定义了一个编辑流过程,该过程通过三种基本编辑操作(插入、删除、替换)将噪声转化为目标数据。模型学习的是瞬时编辑率,即在给定时间和当前状态下,执行某种编辑操作的概率。通过积分这些瞬时编辑率,可以得到从噪声到数据的完整轨迹。

关键创新:最重要的创新在于将离散的编辑操作推广到连续时间域,并学习瞬时编辑率。这使得模型能够更灵活地控制生成过程,并减少所需的编辑操作总数。与传统的自回归模型相比,该方法是非自回归的,可以并行生成事件。与离散扩散模型相比,该方法在连续时间域内进行优化,避免了离散化的误差。

关键设计:模型的关键设计包括:1) 定义合适的编辑操作集合(插入、删除、替换);2) 设计能够有效学习瞬时编辑率的网络结构,例如使用神经网络来参数化编辑率函数;3) 选择合适的损失函数来训练模型,例如使用最大似然估计或变分推断;4) 针对不同的应用场景,设计合适的条件生成机制,例如通过引入条件变量来控制生成的事件类型或时间范围。

🖼️ 关键图片

📊 实验亮点

实验结果表明,该模型在多个基准时间点过程数据集上取得了优异的性能。尤其是在生成效率方面,该模型能够显著减少所需的编辑操作数量,从而加快生成速度。此外,该模型在无条件和条件生成任务中均表现出良好的灵活性,能够生成多样化的事件序列。

🎯 应用场景

该研究成果可应用于多种时间序列建模场景,如金融交易、医疗事件、社交网络动态、网络安全事件等。通过更高效、灵活地生成事件序列,可以用于异常检测、风险预测、用户行为建模等任务,具有重要的实际应用价值和商业前景。

📄 摘要(原文)

Temporal point processes (TPPs) are a fundamental tool for modeling event sequences in continuous time, but most existing approaches rely on autoregressive parameterizations that are limited by their sequential sampling. Recent non-autoregressive, diffusion-style models mitigate these issues by jointly interpolating between noise and data through event insertions and deletions in a discrete Markov chain. In this work, we generalize this perspective and introduce an Edit Flow process for TPPs that transports noise to data via insert, delete, and substitute edit operations. By learning the instantaneous edit rates within a continuous-time Markov chain framework, we attain a flexible and efficient model that effectively reduces the total number of necessary edit operations during generation. Empirical results demonstrate the generative flexibility of our unconditionally trained model in a wide range of unconditional and conditional generation tasks on benchmark TPPs.