Transcribing Rhythmic Patterns of the Guitar Track in Polyphonic Music

作者: Aleksandr Lukoianov, Anssi Klapuri

分类: cs.SD, cs.LG, eess.AS

发布日期: 2025-10-07

备注: Accepted to WASPAA 2025

💡 一句话要点

提出三步框架,用于从复音音乐中转录吉他音轨的节奏模式

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 节奏模式转录 吉他音轨 复音音乐 音源分离 扫弦检测 MERT模型 模式解码

📋 核心要点

- 现有方法在转录音乐节奏模式方面存在不足,尤其是在复音音乐中准确提取吉他节奏模式面临挑战。

- 论文提出一个三步框架,包括音源分离、扫弦检测和模式解码,以实现吉他节奏模式的自动转录。

- 实验结果表明,该方法能够以较高的准确率转录吉他节奏模式,并生成人类可读的表示。

📝 摘要(中文)

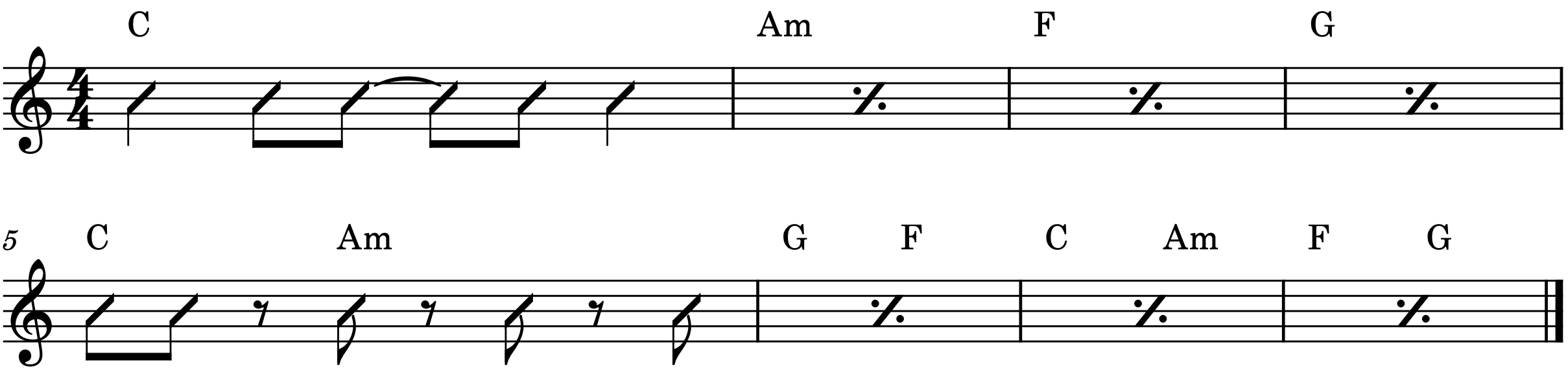

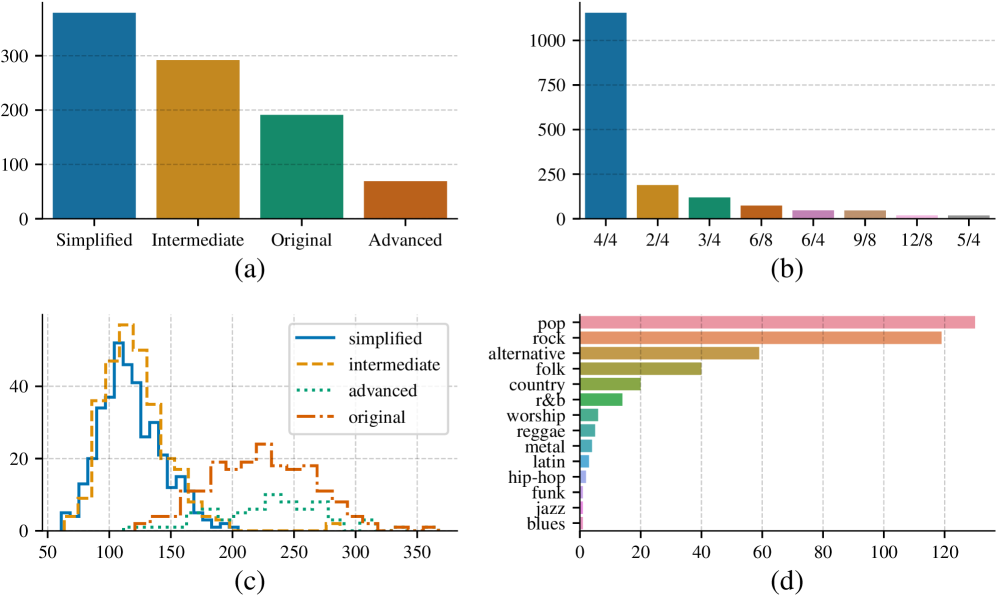

与和弦转录相比,歌曲中节奏模式的转录和编码受到的关注较少。本文针对节奏吉他这一乐器,其通常通过扫弦演奏重复和变化的节奏模式。然而,在许多情况下,无法客观地为歌曲的特定部分定义唯一的“正确”节奏模式。为了创建具有明确ground-truth标签的数据集,我们邀请专家音乐家转录了410首流行歌曲中的节奏模式,并录制了吉他音轨遵循这些转录的翻唱版本。为了转录扫弦及其相应的节奏模式,我们提出了一个三步框架。首先,我们执行近似的音源分离,以从复音混合音轨中提取吉他部分。其次,我们使用预训练的基础模型(MERT)作为骨干,检测分离后的吉他音频中的各个扫弦。最后,我们执行模式解码过程,其中转录的吉他扫弦序列由专家策划的词汇表中的模式表示。实验表明,可以相当高的精度转录复音音乐中吉他音轨的节奏模式,生成人类可读的表示,并包括自动检测的小节线和拍号标记。我们进行了消融研究和误差分析,并提出了一组评估指标来评估预测的节奏模式序列的准确性和可读性。

🔬 方法详解

问题定义:论文旨在解决从复音音乐中自动转录吉他音轨的节奏模式的问题。现有方法难以准确提取和表示吉他节奏,尤其是在存在其他乐器干扰的情况下。缺乏高质量的标注数据也是一个挑战。

核心思路:核心思路是将节奏模式转录分解为三个步骤:首先分离出吉他音轨,然后检测吉他音轨中的扫弦,最后将扫弦序列解码为节奏模式。这种分解简化了问题,并允许利用现有的音源分离和音频事件检测技术。

技术框架:整体框架包含三个主要阶段:1) 音源分离:使用近似的音源分离技术从复音混合音轨中提取吉他音轨。2) 扫弦检测:使用预训练的MERT模型作为骨干网络,检测分离后的吉他音轨中的各个扫弦事件。3) 模式解码:将检测到的扫弦序列与专家构建的节奏模式词汇表进行匹配,从而将扫弦序列转换为节奏模式序列。

关键创新:关键创新在于将预训练的语音模型MERT应用于吉他扫弦检测,并结合专家知识构建节奏模式词汇表进行模式解码。这种方法利用了预训练模型的强大特征提取能力,并结合了音乐领域的先验知识。

关键设计:MERT模型被用作扫弦检测的骨干网络,通过微调来适应吉他扫弦检测任务。专家构建的节奏模式词汇表包含了一系列常见的吉他节奏模式,用于将扫弦序列解码为节奏模式序列。论文还设计了一套评估指标来评估转录结果的准确性和可读性。

🖼️ 关键图片

📊 实验亮点

论文通过实验验证了所提出框架的有效性,能够以较高的准确率转录吉他节奏模式。实验结果表明,该方法能够生成人类可读的节奏模式表示,并自动检测小节线和拍号标记。消融研究分析了各个模块对整体性能的影响,误差分析揭示了该方法的局限性。

🎯 应用场景

该研究成果可应用于音乐信息检索、音乐教育、自动伴奏生成等领域。例如,可以用于自动分析歌曲的节奏结构,帮助音乐学习者理解和掌握吉他演奏技巧,或者用于生成与歌曲节奏相匹配的自动伴奏。该技术还有潜力应用于其他乐器的节奏模式分析。

📄 摘要(原文)

Whereas chord transcription has received considerable attention during the past couple of decades, far less work has been devoted to transcribing and encoding the rhythmic patterns that occur in a song. The topic is especially relevant for instruments such as the rhythm guitar, which is typically played by strumming rhythmic patterns that repeat and vary over time. However, in many cases one cannot objectively define a single "right" rhythmic pattern for a given song section. To create a dataset with well-defined ground-truth labels, we asked expert musicians to transcribe the rhythmic patterns in 410 popular songs and record cover versions where the guitar tracks followed those transcriptions. To transcribe the strums and their corresponding rhythmic patterns, we propose a three-step framework. Firstly, we perform approximate stem separation to extract the guitar part from the polyphonic mixture. Secondly, we detect individual strums within the separated guitar audio, using a pre-trained foundation model (MERT) as a backbone. Finally, we carry out a pattern-decoding process in which the transcribed sequence of guitar strums is represented by patterns drawn from an expert-curated vocabulary. We show that it is possible to transcribe the rhythmic patterns of the guitar track in polyphonic music with quite high accuracy, producing a representation that is human-readable and includes automatically detected bar lines and time signature markers. We perform ablation studies and error analysis and propose a set of evaluation metrics to assess the accuracy and readability of the predicted rhythmic pattern sequence.