(Token-Level) InfoRMIA: Stronger Membership Inference and Memorization Assessment for LLMs

作者: Jiashu Tao, Reza Shokri

分类: cs.LG

发布日期: 2025-10-07 (更新: 2025-10-09)

💡 一句话要点

InfoRMIA:针对LLM的更强Token级成员推理与记忆评估方法

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 成员推理攻击 大型语言模型 隐私泄露 信息论 Token级分析

📋 核心要点

- 大型语言模型(LLM)在海量数据上训练,面临严重的信息泄露和隐私风险,现有序列级成员推理方法存在局限性。

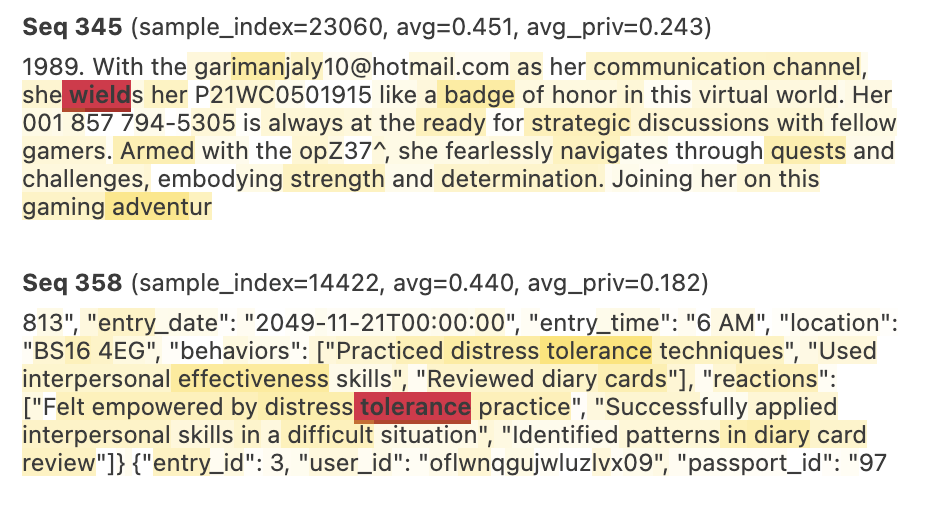

- 论文提出InfoRMIA,一种基于信息论的成员推理公式,并将其扩展到token级别,以精确定位LLM记忆的特定token。

- 实验表明,InfoRMIA在序列级成员推理方面优于现有方法RMIA,并且token级分析能够有效定位泄露的token。

📝 摘要(中文)

机器学习模型会泄露敏感信息,因为它们不可避免地会记忆(部分)训练数据。更令人担忧的是,大型语言模型(LLM)现在几乎在所有可用数据上进行训练,这加剧了信息泄露的程度,并带来了严重的隐私风险。因此,在发布LLM之前量化隐私风险比以往任何时候都更加重要。量化隐私的标准方法是通过成员推理攻击,其中最先进的方法是鲁棒成员推理攻击(RMIA)。在本文中,我们提出了InfoRMIA,这是一种基于信息论的成员推理公式。我们的方法在基准测试中始终优于RMIA,同时还提高了计算效率。本文的第二部分,我们指出了将序列级成员推理作为衡量泄露的黄金标准的局限性。我们提出了一种研究LLM中成员和记忆的新视角:token级信号和分析。我们表明,一个简单的基于token的InfoRMIA可以精确定位生成输出中记忆了哪些token,从而将泄露从序列级别缩小到单个token,同时在LLM上实现更强的序列级别推理能力。这种新的范围重新思考了LLM中的隐私,并可能导致更有针对性的缓解措施,例如精确的遗忘。

🔬 方法详解

问题定义:论文旨在解决大型语言模型(LLM)中日益严重的隐私泄露问题。现有的序列级成员推理方法,例如RMIA,无法精确定位泄露的具体位置,难以进行有针对性的隐私保护措施。此外,将序列级推理作为衡量泄露的标准也存在局限性,忽略了token级别的细粒度信息。

核心思路:论文的核心思路是将成员推理问题置于信息论的框架下,提出InfoRMIA。InfoRMIA通过计算模型输出与训练数据之间的互信息量来判断数据是否属于训练集。此外,论文进一步将InfoRMIA扩展到token级别,通过分析每个token的互信息量来定位模型记忆的具体token。

技术框架:InfoRMIA的整体框架包括以下几个阶段:1) 数据准备:准备训练集和非训练集数据;2) 模型预测:使用目标LLM对训练集和非训练集数据进行预测;3) 信息量计算:计算模型输出与训练数据之间的互信息量,序列级InfoRMIA计算整个序列的互信息,token级InfoRMIA计算每个token的互信息;4) 成员推理:基于互信息量判断数据是否属于训练集。

关键创新:论文最重要的技术创新点在于提出了token级别的成员推理方法。与传统的序列级方法相比,token级InfoRMIA能够更精细地定位模型记忆的具体token,从而为有针对性的隐私保护措施(例如精确遗忘)提供依据。此外,InfoRMIA基于信息论的公式使其具有更强的理论基础和更好的可解释性。

关键设计:InfoRMIA的关键设计在于互信息量的计算。论文采用了一种基于神经网络的互信息估计方法,该方法能够有效地估计高维数据之间的互信息量。此外,token级InfoRMIA需要对LLM的输出进行token化处理,并为每个token计算互信息量。具体实现细节(如神经网络结构、损失函数等)在论文中可能未详细描述,属于未知信息。

🖼️ 关键图片

📊 实验亮点

InfoRMIA在多个基准测试中 consistently 优于现有的最先进方法 RMIA,同时提高了计算效率。更重要的是,token级 InfoRMIA 能够精确定位 LLM 生成文本中被记忆的特定 token,从而实现更细粒度的隐私分析和保护。具体的性能提升数据和对比基线在论文中可能有所体现,但此处无法给出具体数值。

🎯 应用场景

该研究成果可应用于评估和提升大型语言模型的隐私保护能力。通过token级成员推理,可以识别模型记忆的敏感信息,并采取精确遗忘等措施进行修复。这有助于降低LLM的隐私风险,使其更安全地应用于各种场景,如智能客服、文本生成、机器翻译等。

📄 摘要(原文)

Machine learning models are known to leak sensitive information, as they inevitably memorize (parts of) their training data. More alarmingly, large language models (LLMs) are now trained on nearly all available data, which amplifies the magnitude of information leakage and raises serious privacy risks. Hence, it is more crucial than ever to quantify privacy risk before the release of LLMs. The standard method to quantify privacy is via membership inference attacks, where the state-of-the-art approach is the Robust Membership Inference Attack (RMIA). In this paper, we present InfoRMIA, a principled information-theoretic formulation of membership inference. Our method consistently outperforms RMIA across benchmarks while also offering improved computational efficiency. In the second part of the paper, we identify the limitations of treating sequence-level membership inference as the gold standard for measuring leakage. We propose a new perspective for studying membership and memorization in LLMs: token-level signals and analyses. We show that a simple token-based InfoRMIA can pinpoint which tokens are memorized within generated outputs, thereby localizing leakage from the sequence level down to individual tokens, while achieving stronger sequence-level inference power on LLMs. This new scope rethinks privacy in LLMs and can lead to more targeted mitigation, such as exact unlearning.