MCCE: A Framework for Multi-LLM Collaborative Co-Evolution

作者: Nian Ran, Zhongzheng Li, Yue Wang, Qingsong Ran, Xiaoyuan Zhang, Shikun Feng, Richard Allmendinger, Xiaoguang Zhao

分类: cs.LG, cs.AI

发布日期: 2025-10-06

💡 一句话要点

提出MCCE框架,利用多LLM协同进化解决多目标离散优化问题

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 多LLM协同 协同进化 多目标优化 药物设计 强化学习 轨迹记忆 混合LLM系统

📋 核心要点

- 多目标离散优化问题面临巨大的组合空间挑战,传统进化算法易陷入局部最优。

- MCCE框架结合闭源LLM的知识和开源LLM的可训练性,实现协同进化。

- 实验表明,MCCE在多目标药物设计中达到SOTA,验证了混合LLM持续进化的有效性。

📝 摘要(中文)

本文提出了一种多LLM协同进化(MCCE)框架,用于解决多目标离散优化问题,如分子设计。该框架结合了一个冻结的闭源LLM和一个轻量级的可训练模型。系统维护过去搜索过程的轨迹记忆,并通过强化学习逐步优化小模型。两个模型相互支持和补充,共同进行全局探索。与模型蒸馏不同,该过程通过相互启发增强了两个模型的能力。在多目标药物设计基准测试上的实验表明,MCCE实现了最先进的Pareto前沿质量,并始终优于基线方法。这些结果突出了混合LLM系统中实现持续进化的一种新范例,将知识驱动的探索与经验驱动的学习相结合。

🔬 方法详解

问题定义:论文旨在解决多目标离散优化问题,例如分子设计。这类问题由于其庞大且非结构化的组合空间而极具挑战性。传统的进化算法常常陷入局部最优,而专家知识可以为加速收敛提供关键指导。现有方法要么依赖于无法更新参数的闭源LLM,要么依赖于缺乏广泛知识和推理能力的小型开源模型。

核心思路:论文的核心思路是结合闭源LLM和开源LLM的优势,构建一个协同进化的框架。闭源LLM拥有强大的探索能力和知识储备,而开源LLM可以通过持续微调来内化经验。通过让两个模型相互协作、相互启发,可以实现知识驱动的探索和经验驱动的学习,从而更有效地解决多目标离散优化问题。

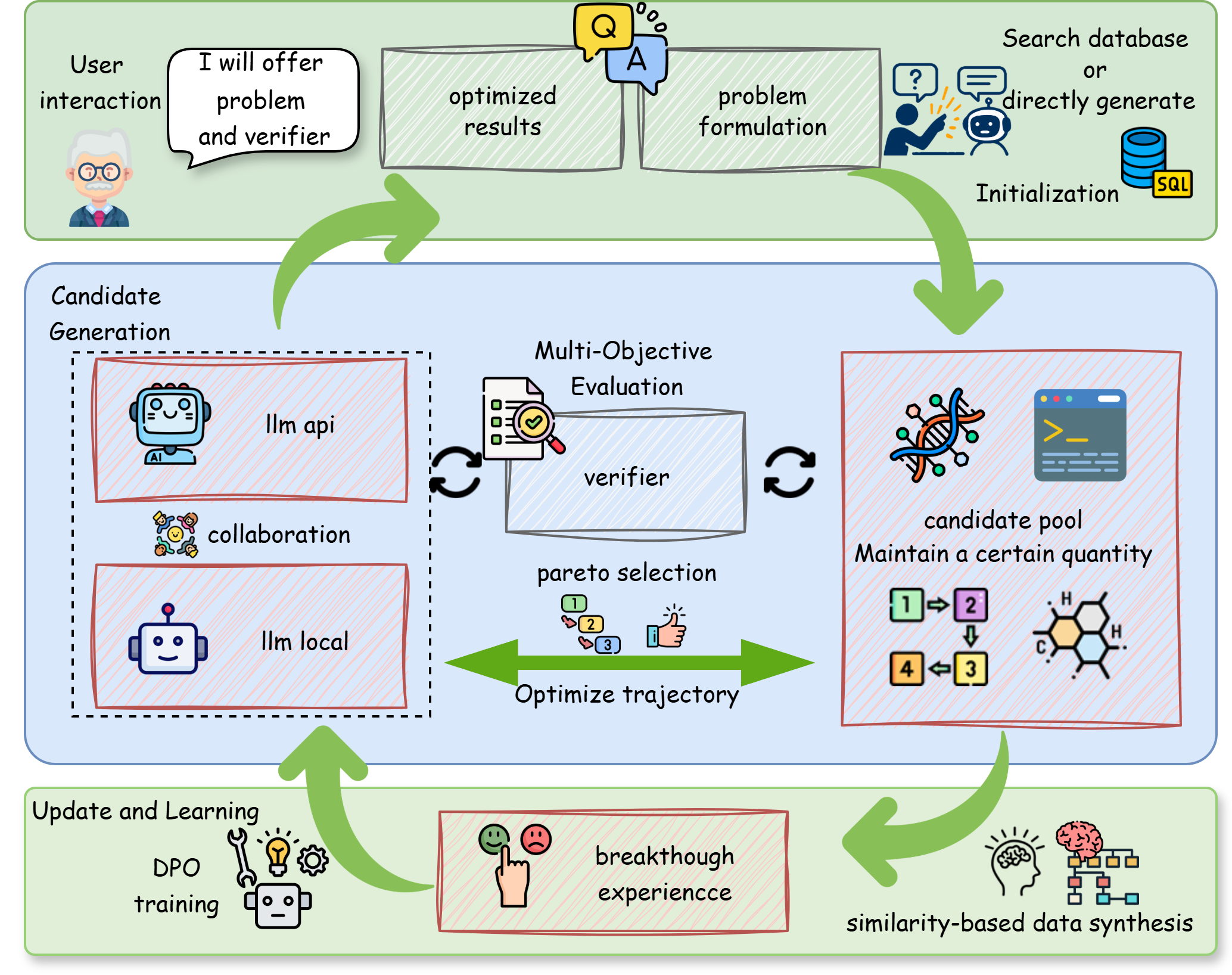

技术框架:MCCE框架包含两个主要组成部分:一个冻结的闭源LLM和一个轻量级的可训练模型。系统维护一个轨迹记忆,记录过去的搜索过程。可训练模型通过强化学习进行逐步优化,利用轨迹记忆中的数据进行学习。闭源LLM和可训练模型共同参与搜索过程,相互提供建议和指导。

关键创新:MCCE的关键创新在于其协同进化的机制。与传统的模型蒸馏不同,MCCE不是简单地将闭源LLM的知识转移到开源LLM,而是通过相互启发来增强两个模型的能力。闭源LLM可以从可训练模型的经验中学习,而可训练模型可以从闭源LLM的知识中学习。这种协同进化的机制使得MCCE能够更有效地探索搜索空间,并找到更好的解决方案。

关键设计:论文采用强化学习来训练可训练模型。具体来说,使用轨迹记忆中的数据作为训练样本,并设计合适的奖励函数来鼓励模型探索更好的解决方案。奖励函数的设计需要考虑多个目标,并平衡它们之间的权重。此外,论文还设计了一种机制来协调闭源LLM和可训练模型之间的交互,确保它们能够有效地协同工作。具体参数设置和网络结构等细节在论文中有详细描述。

🖼️ 关键图片

📊 实验亮点

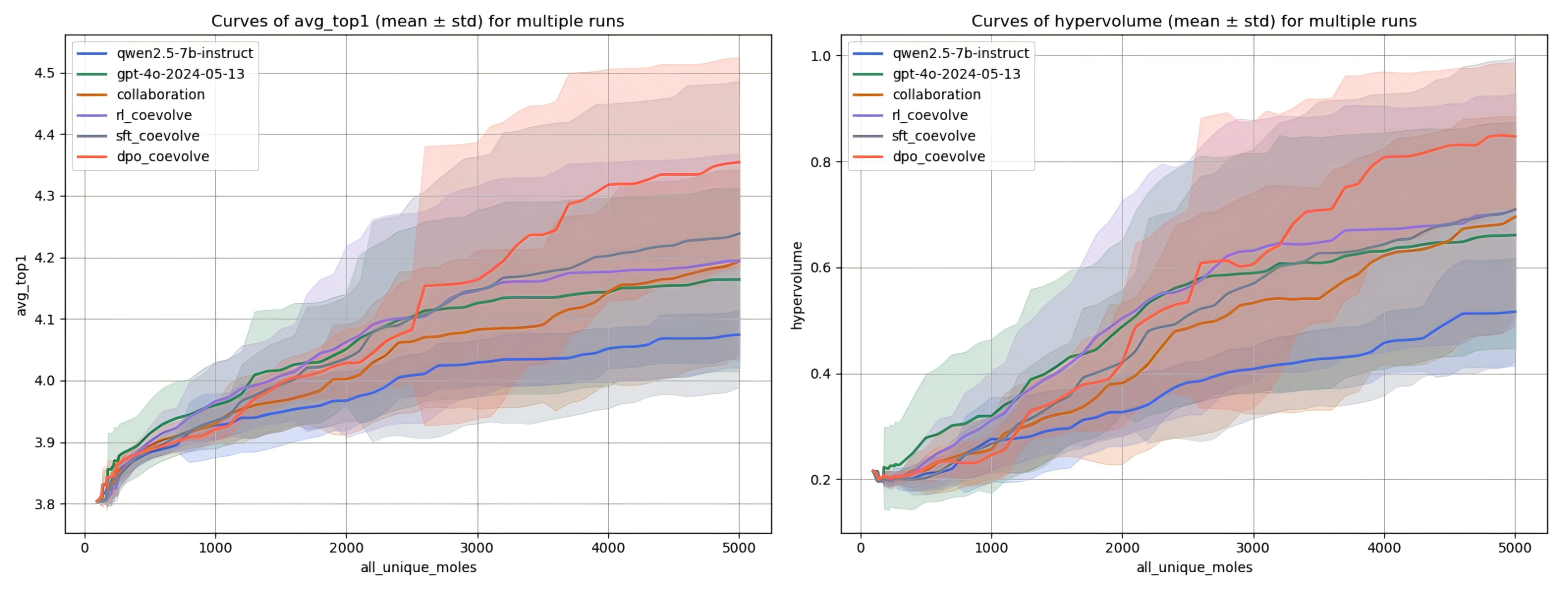

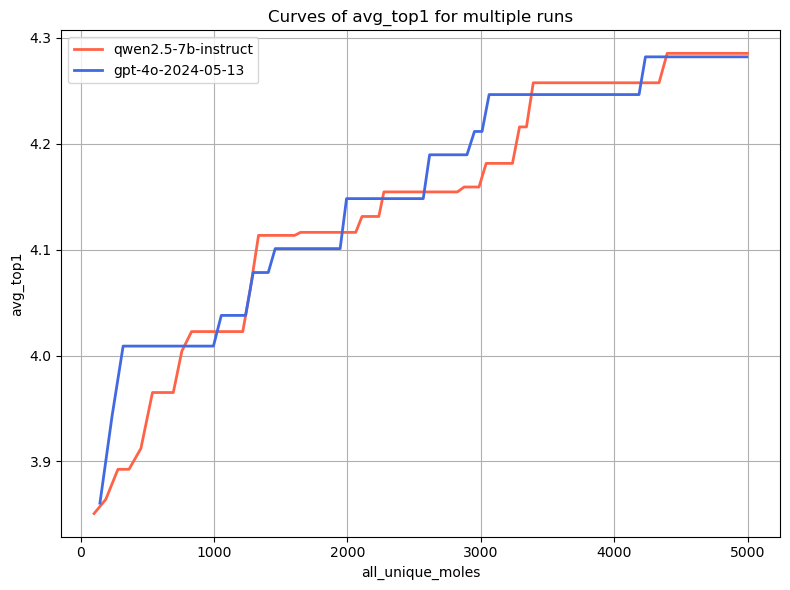

实验结果表明,MCCE在多目标药物设计基准测试中取得了最先进的Pareto前沿质量,并且始终优于基线方法。这表明MCCE能够有效地利用LLM的知识和经验学习,从而找到更好的解决方案。具体的性能提升幅度在论文中有详细的量化展示。

🎯 应用场景

MCCE框架具有广泛的应用前景,可以应用于药物设计、材料发现、组合优化等领域。通过结合LLM的知识和经验学习,MCCE可以更有效地解决这些领域的复杂问题,加速新药物和新材料的研发,并提高优化问题的求解效率。该研究为混合LLM系统的持续进化提供了一种新的范例。

📄 摘要(原文)

Multi-objective discrete optimization problems, such as molecular design, pose significant challenges due to their vast and unstructured combinatorial spaces. Traditional evolutionary algorithms often get trapped in local optima, while expert knowledge can provide crucial guidance for accelerating convergence. Large language models (LLMs) offer powerful priors and reasoning ability, making them natural optimizers when expert knowledge matters. However, closed-source LLMs, though strong in exploration, cannot update their parameters and thus cannot internalize experience. Conversely, smaller open models can be continually fine-tuned but lack broad knowledge and reasoning strength. We introduce Multi-LLM Collaborative Co-evolution (MCCE), a hybrid framework that unites a frozen closed-source LLM with a lightweight trainable model. The system maintains a trajectory memory of past search processes; the small model is progressively refined via reinforcement learning, with the two models jointly supporting and complementing each other in global exploration. Unlike model distillation, this process enhances the capabilities of both models through mutual inspiration. Experiments on multi-objective drug design benchmarks show that MCCE achieves state-of-the-art Pareto front quality and consistently outperforms baselines. These results highlight a new paradigm for enabling continual evolution in hybrid LLM systems, combining knowledge-driven exploration with experience-driven learning.