Reinforce-Ada: An Adaptive Sampling Framework under Non-linear RL Objectives

作者: Wei Xiong, Chenlu Ye, Baohao Liao, Hanze Dong, Xinxing Xu, Christof Monz, Jiang Bian, Nan Jiang, Tong Zhang

分类: cs.LG, cs.AI, cs.CL, stat.ML

发布日期: 2025-10-06 (更新: 2025-12-05)

备注: 27 pages, 10 figures

🔗 代码/项目: GITHUB

💡 一句话要点

提出Reinforce-Ada自适应采样框架,解决非线性RL目标下大语言模型推理中的信号丢失问题。

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 强化学习 大语言模型 自适应采样 非线性优化 信号恢复

📋 核心要点

- 现有大语言模型推理的强化学习方法,采用均匀采样策略,在处理困难提示时易出现信号丢失问题。

- Reinforce-Ada通过优化非线性RL目标,自适应地为不同难度的提示分配推理预算,从而恢复丢失的信号。

- 实验表明,Reinforce-Ada在多个基准测试中显著优于均匀采样基线,收敛速度提升高达2倍。

📝 摘要(中文)

针对大语言模型推理的强化学习(RL)常因信号丢失而受阻,即标准均匀采样在小批量下难以发现困难提示的有效学习信号。本文证明这种崩溃是欠采样的统计伪像,而非模型固有限制。为此,本文提出了一个基于优化非线性RL目标(如对数似然)的理论框架,表明该目标自然诱导出一个加权梯度估计器,优先考虑困难提示,并通过自适应采样稳健地实现。基于此,提出了Reinforce-Ada算法族,根据提示难度动态分配推理预算,有效地将RL计算扩展到最需要的地方。与丢弃低信号提示的被动过滤方法不同,Reinforce-Ada主动投入计算来恢复它们。本文引入了两种高效实现:基于估计的方法和无模型的序列采样方法。在多个基准测试上的大量实验表明,Reinforce-Ada显著优于GRPO等均匀基线,恢复了丢失的信号,并在保持相同总推理预算的同时,将收敛速度提高了高达2倍。代码已开源。

🔬 方法详解

问题定义:现有基于强化学习的大语言模型推理方法,通常采用均匀采样策略。这种策略在处理简单提示时效果尚可,但当遇到困难提示时,由于小批量采样不足,难以捕捉到有效的学习信号,导致信号丢失,模型训练效率低下甚至失效。现有方法未能有效区分不同提示的难度,并针对性地分配计算资源。

核心思路:Reinforce-Ada的核心思路是根据提示的难度动态调整采样策略,将更多的计算资源分配给困难提示,从而更有效地利用有限的计算预算。其理论基础在于优化非线性RL目标(如对数似然),这自然会产生一个加权梯度估计器,该估计器会优先考虑困难提示。通过自适应采样,可以稳健地实现这种加权梯度估计。

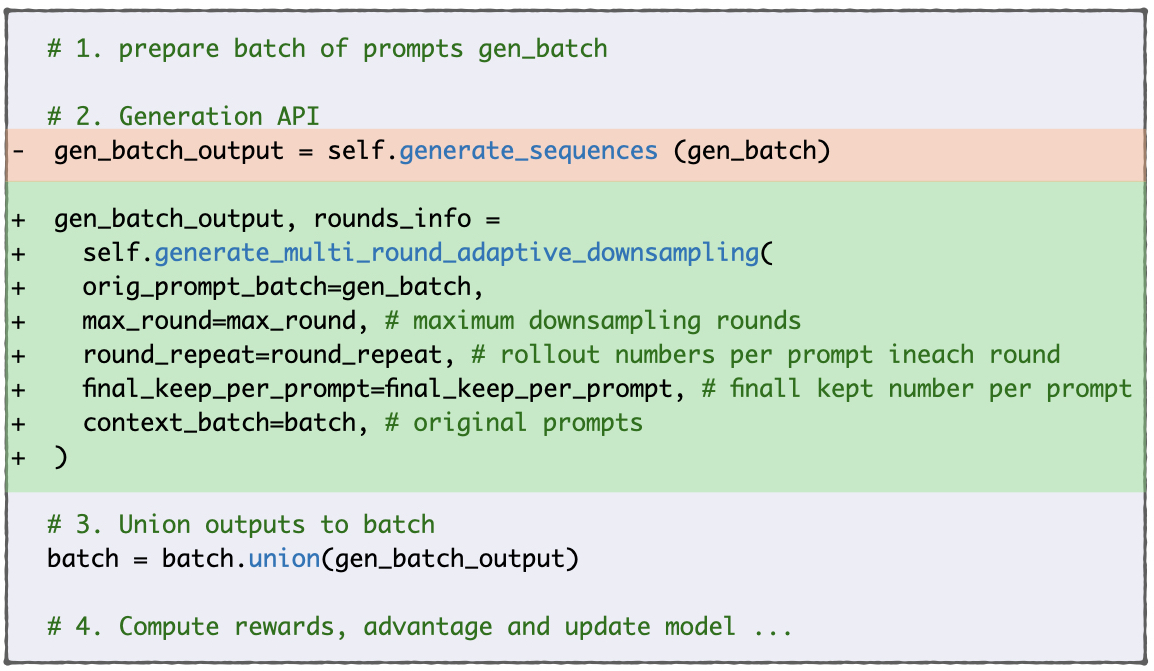

技术框架:Reinforce-Ada算法族包含两种主要实现方式:基于估计的方法和无模型的序列采样方法。整体流程如下:首先,根据某种指标(例如,初始奖励的方差)评估每个提示的难度。然后,根据提示的难度动态分配推理预算,对困难提示进行更多的采样。最后,利用采样数据更新模型参数。该框架的核心在于如何有效地估计提示的难度并根据难度自适应地调整采样策略。

关键创新:Reinforce-Ada的关键创新在于其自适应采样策略,它能够根据提示的难度动态调整采样概率,从而更有效地利用计算资源。与传统的均匀采样方法相比,Reinforce-Ada能够更好地处理困难提示,恢复丢失的信号。与被动过滤方法不同,Reinforce-Ada主动投入计算来恢复低信号提示。

关键设计:Reinforce-Ada的关键设计包括:1) 提示难度估计方法:可以使用初始奖励的方差或其他指标来估计提示的难度。2) 采样概率调整策略:可以根据提示的难度线性或非线性地调整采样概率。3) 两种具体实现:基于估计的方法和无模型的序列采样方法,分别采用不同的技术手段来实现自适应采样。具体的损失函数和网络结构与所使用的基础强化学习算法有关,Reinforce-Ada可以与多种强化学习算法结合使用。

🖼️ 关键图片

📊 实验亮点

实验结果表明,Reinforce-Ada在多个基准测试中显著优于均匀采样基线,如GRPO。在保持相同总推理预算的情况下,Reinforce-Ada能够将收敛速度提高高达2倍。这表明Reinforce-Ada能够有效地恢复丢失的信号,并更有效地利用计算资源。实验还验证了两种不同的Reinforce-Ada实现方式的有效性。

🎯 应用场景

Reinforce-Ada可应用于各种需要利用强化学习训练大语言模型的场景,例如代码生成、文本摘要、对话生成等。通过自适应采样,可以更有效地利用计算资源,提高模型的训练效率和性能。该方法尤其适用于处理包含大量困难样本的任务,能够显著提升模型在这些任务上的表现。未来,该方法可以进一步扩展到其他类型的强化学习任务中。

📄 摘要(原文)

Reinforcement learning (RL) for large language model reasoning is frequently hindered by signal loss, a phenomenon where standard uniform sampling with small group sizes fails to uncover informative learning signals for difficult prompts. We demonstrate that this collapse is a statistical artifact of undersampling rather than an inherent model limitation. To address this systematically, we introduce a theoretical framework based on optimizing a non-linear RL objective (e.g., log-likelihood). We show that this objective naturally induces a weighted gradient estimator that prioritizes difficult prompts, which can be robustly realized through adaptive sampling. Guided by this framework, we propose Reinforce-Ada, a family of algorithms that dynamically allocates inference budgets based on prompt difficulty, effectively scaling up RL compute to where it is needed most. Unlike passive filtering methods that discard low-signal prompts, Reinforce-Ada actively invests compute to recover them. We introduce two efficient realizations: an estimation-based approach and a model-free sequential sampling approach. Extensive experiments across multiple benchmarks show that Reinforce-Ada significantly outperforms uniform baselines like GRPO, recovering lost signals and accelerating convergence by up to $2\times$ while maintaining the same total inference budget. Code is available at https://github.com/RLHFlow/Reinforce-Ada.