Long-Term Mapping of the Douro River Plume with Multi-Agent Reinforcement Learning

作者: Nicolò Dal Fabbro, Milad Mesbahi, Renato Mendes, João Borges de Sousa, George J. Pappas

分类: cs.MA, cs.LG, eess.SY, stat.ML

发布日期: 2025-10-03 (更新: 2025-11-03)

💡 一句话要点

提出多智能体强化学习以解决长时间河流羽流映射问题

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture) 支柱八:物理动画 (Physics-based Animation)

关键词: 多智能体强化学习 自主水下机器人 河流羽流映射 时空高斯过程回归 Delft3D海洋模型 环境监测 数据驱动

📋 核心要点

- 现有方法在长时间河流羽流映射中面临能效和通信效率不足的挑战,难以实现有效的多智能体协作。

- 论文提出了一种多智能体强化学习方法,通过中央协调器与AUVs间歇性通信,结合时空高斯过程回归和多头Q网络控制器,优化AUV的运动。

- 实验结果表明,所提方法在多个基准测试中优于单智能体和多智能体基准,增加智能体数量显著提高了均方误差和操作耐力。

📝 摘要(中文)

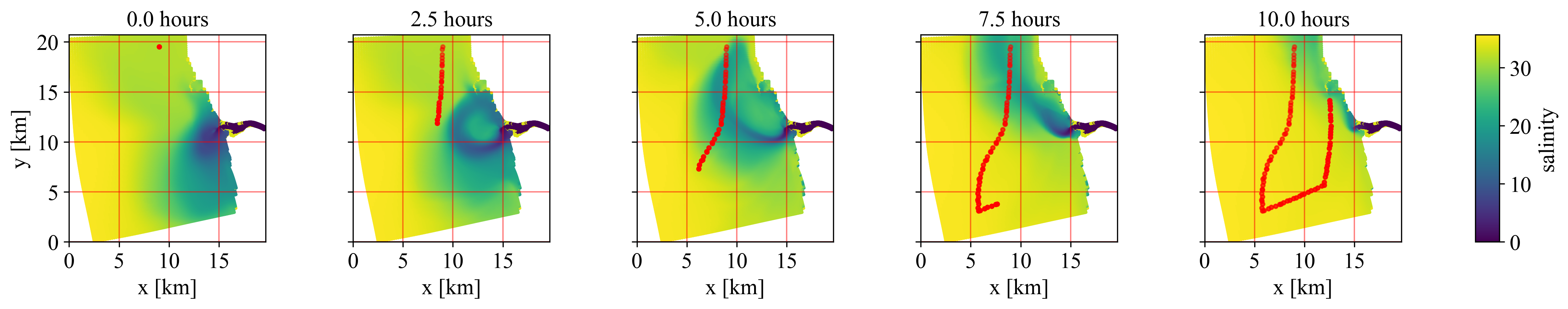

本研究探讨了使用多台自主水下机器人(AUVs)进行长时间(多天)河流羽流映射的问题,以杜罗河为代表案例。我们提出了一种能效和通信效率高的多智能体强化学习方法,其中中央协调器间歇性地与AUVs通信,收集测量数据并发出指令。该方法将时空高斯过程回归(GPR)与多头Q网络控制器相结合,调节每台AUV的方向和速度。通过使用Delft3D海洋模型的仿真,我们的方法在多个基准测试中表现优异,增加智能体数量不仅提高了均方误差(MSE),还增强了操作耐力。我们的算法在某些情况下显示,双倍增加AUV数量可以使耐力超过两倍,同时保持或提高准确性,强调了多智能体协调的优势。我们学习的策略在不同月份和年份的未见季节性环境中具有良好的泛化能力,为未来动态羽流环境的数据驱动长期监测发展提供了希望。

🔬 方法详解

问题定义:本研究旨在解决长时间河流羽流映射中的能效和通信效率问题。现有方法在多智能体协作中存在不足,难以实现高效的长期监测。

核心思路:我们提出了一种多智能体强化学习框架,通过中央协调器与AUVs进行间歇性通信,利用时空高斯过程回归(GPR)和多头Q网络控制器来优化每台AUV的运动方向和速度。这样的设计旨在提高能效和通信效率,同时增强多智能体之间的协作能力。

技术框架:整体架构包括中央协调器和多个AUVs,中央协调器负责收集数据和发出指令,而AUVs根据指令调整运动。主要模块包括数据收集、指令发出、运动控制和策略学习。

关键创新:论文的主要创新在于将时空高斯过程回归与多头Q网络相结合,形成了一种新的多智能体强化学习方法。这种方法在处理动态环境时表现出更好的适应性和效率,区别于传统的单智能体方法。

关键设计:在技术细节上,我们设置了适应性损失函数,以优化AUV的运动策略,并设计了多头Q网络结构,以便更好地处理多智能体之间的协作和信息共享。

🖼️ 关键图片

📊 实验亮点

实验结果显示,所提方法在多个基准测试中均优于现有单智能体和多智能体方法。增加AUV数量不仅提高了均方误差(MSE),还在某些情况下使操作耐力超过两倍,显示出多智能体协调的显著优势。

🎯 应用场景

该研究的潜在应用领域包括海洋环境监测、生态研究和水资源管理等。通过实现高效的长期监测,能够为环境保护和资源管理提供重要的数据支持,促进可持续发展。未来,该方法可扩展至其他动态环境的监测与管理。

📄 摘要(原文)

We study the problem of long-term (multiple days) mapping of a river plume using multiple autonomous underwater vehicles (AUVs), focusing on the Douro river representative use-case. We propose an energy - and communication - efficient multi-agent reinforcement learning approach in which a central coordinator intermittently communicates with the AUVs, collecting measurements and issuing commands. Our approach integrates spatiotemporal Gaussian process regression (GPR) with a multi-head Q-network controller that regulates direction and speed for each AUV. Simulations using the Delft3D ocean model demonstrate that our method consistently outperforms both single- and multi-agent benchmarks, with scaling the number of agents both improving mean squared error (MSE) and operational endurance. In some instances, our algorithm demonstrates that doubling the number of AUVs can more than double endurance while maintaining or improving accuracy, underscoring the benefits of multi-agent coordination. Our learned policies generalize across unseen seasonal regimes over different months and years, demonstrating promise for future developments of data-driven long-term monitoring of dynamic plume environments.