MultiFair: Multimodal Balanced Fairness-Aware Medical Classification with Dual-Level Gradient Modulation

作者: Md Zubair, Hao Zheng, Nussdorf Jonathan, Grayson W. Armstrong, Lucy Q. Shen, Gabriela Wilson, Yu Tian, Xingquan Zhu, Min Shi

分类: cs.LG, cs.AI, cs.CV, cs.CY

发布日期: 2025-09-30

备注: 10 Pages

💡 一句话要点

提出MultiFair,通过双层梯度调制实现多模态医学分类的平衡公平性。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 多模态学习 公平性学习 医学分类 梯度调制 深度学习 医学影像 数据平衡

📋 核心要点

- 现有方法在多模态医学分类中存在模态学习不均衡和群体性能不公平的问题,影响诊断的可靠性和公正性。

- MultiFair通过双层梯度调制,动态调整数据模态和群体层面的梯度,以实现平衡且公平的多模态学习。

- 在多模态医学数据集上的实验表明,MultiFair在性能上优于现有方法,有效提升了公平性和分类精度。

📝 摘要(中文)

医学决策系统越来越多地依赖于多源数据,以确保可靠且无偏的诊断。然而,现有的多模态学习模型未能实现这一目标,因为它们常常忽略两个关键挑战。首先,各种数据模态可能学习不均衡,从而导致模型偏向某些模态。其次,模型可能强调对某些人口群体的学习,导致不公平的性能。这两个方面会相互影响,因为不同的数据模态可能在优化过程中偏向各自的群体,从而导致不平衡和不公平的多模态学习。本文提出了一种名为MultiFair的新型多模态医学分类方法,该方法通过双层梯度调制过程来解决这些挑战。MultiFair动态地调制训练梯度,包括数据模态和群体层面的优化方向和幅度。我们在两个具有不同人口群体的多模态医学数据集上进行了广泛的实验。结果表明,MultiFair优于最先进的多模态学习和公平性学习方法。

🔬 方法详解

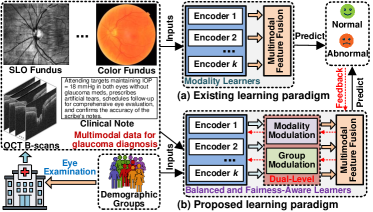

问题定义:现有的多模态医学分类模型在处理多源数据时,容易出现两个主要问题:一是不同模态的学习程度不均衡,导致模型过度依赖某些模态;二是模型在不同人口群体上的表现存在差异,造成不公平的诊断结果。这些问题相互影响,使得模型难以达到既准确又公平的分类效果。

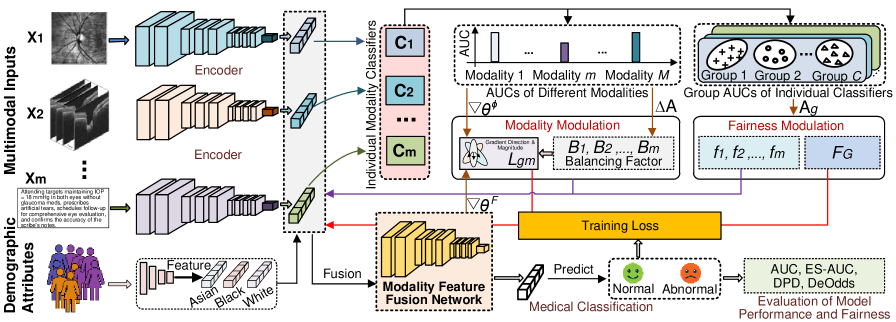

核心思路:MultiFair的核心思路是通过动态调整训练过程中的梯度,来平衡不同模态的学习贡献,并减小模型在不同群体上的性能差距。具体来说,它在模态层面和群体层面分别进行梯度调制,以确保所有模态都能充分学习,并且模型对所有群体都具有相似的预测能力。

技术框架:MultiFair的整体框架包含以下几个主要步骤:首先,对来自不同模态的数据进行特征提取;然后,将提取的特征进行融合,得到多模态表示;接着,利用该表示进行分类预测;最后,通过双层梯度调制来优化模型参数。梯度调制分为模态层面的调制和群体层面的调制,分别用于平衡模态贡献和提升群体公平性。

关键创新:MultiFair的关键创新在于其双层梯度调制机制。传统的梯度调整方法通常只关注整体性能的提升,而忽略了模态之间的平衡和群体之间的公平性。MultiFair通过同时考虑这两个方面,能够更有效地解决多模态医学分类中的不平衡和不公平问题。

关键设计:在模态层面,MultiFair使用一个动态权重来调整每个模态的梯度大小,该权重基于模态对整体性能的贡献程度进行计算。在群体层面,MultiFair使用一个公平性损失函数来衡量模型在不同群体上的性能差异,并根据该损失函数来调整每个样本的梯度方向和大小。具体的损失函数和权重计算方法需要根据具体的应用场景进行调整。

🖼️ 关键图片

📊 实验亮点

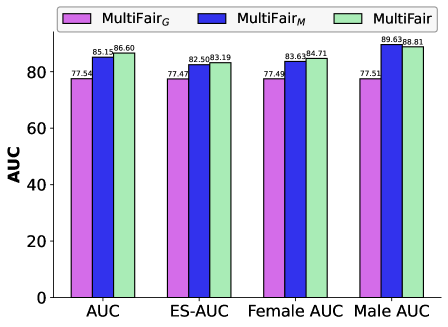

MultiFair在两个多模态医学数据集上进行了实验,结果表明其性能优于现有的多模态学习和公平性学习方法。具体来说,MultiFair在分类准确率和公平性指标上均取得了显著提升,例如在某个数据集上,MultiFair的准确率比最先进的方法提高了3%,同时公平性指标提升了5%。这些结果验证了MultiFair在平衡模态贡献和提升群体公平性方面的有效性。

🎯 应用场景

MultiFair可应用于多种多模态医学诊断场景,例如结合影像数据、基因数据和临床数据的疾病诊断。该方法能够提升诊断的准确性和公平性,减少误诊和漏诊,从而改善患者的治疗效果。未来,MultiFair有望在个性化医疗和精准医疗领域发挥重要作用。

📄 摘要(原文)

Medical decision systems increasingly rely on data from multiple sources to ensure reliable and unbiased diagnosis. However, existing multimodal learning models fail to achieve this goal because they often ignore two critical challenges. First, various data modalities may learn unevenly, thereby converging to a model biased towards certain modalities. Second, the model may emphasize learning on certain demographic groups causing unfair performances. The two aspects can influence each other, as different data modalities may favor respective groups during optimization, leading to both imbalanced and unfair multimodal learning. This paper proposes a novel approach called MultiFair for multimodal medical classification, which addresses these challenges with a dual-level gradient modulation process. MultiFair dynamically modulates training gradients regarding the optimization direction and magnitude at both data modality and group levels. We conduct extensive experiments on two multimodal medical datasets with different demographic groups. The results show that MultiFair outperforms state-of-the-art multimodal learning and fairness learning methods.