AccidentBench: Benchmarking Multimodal Understanding and Reasoning in Vehicle Accidents and Beyond

作者: Shangding Gu, Xiaohan Wang, Donghao Ying, Haoyu Zhao, Runing Yang, Ming Jin, Boyi Li, Marco Pavone, Serena Yeung-Levy, Jun Wang, Dawn Song, Costas Spanos

分类: cs.LG

发布日期: 2025-09-30

🔗 代码/项目: GITHUB

💡 一句话要点

AccidentBench:构建大规模多模态基准,评估车辆事故及其他安全场景下的理解与推理能力

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 多模态理解 安全关键场景 车辆事故 时空推理 意图推理 基准数据集 长视频理解 问答系统

📋 核心要点

- 现有方法在安全攸关的动态现实世界场景中,对多模态信息的理解和推理能力不足,尤其是在时间和空间推理方面面临挑战。

- AccidentBench通过构建包含车辆事故及航空、水运等场景的大规模数据集,系统性地评估模型在时间、空间和意图理解与推理方面的能力。

- 实验结果表明,即使是最先进的模型在AccidentBench的困难任务和长视频上表现仍然欠佳,揭示了现有模型在真实世界推理方面的差距。

📝 摘要(中文)

本文提出了AccidentBench,一个大规模基准数据集,旨在严格评估多模态模型在安全攸关的动态现实世界场景中的理解和推理能力。该基准结合了车辆事故场景以及航空和水运等“超越”领域,这些领域强调空间和时间推理(例如,导航、方向、多车辆运动)。AccidentBench包含约2000个视频和超过19000个人工标注的问答对,涵盖多种视频长度(短/中/长)和难度级别(易/中/难)。任务系统性地探究了时间、空间和意图理解与推理等核心能力。通过将以事故为中心的交通场景与更广泛的航空和水运安全场景统一起来,AccidentBench提供了一个全面的、物理基础的测试平台,用于评估模型在真实世界可变性下的表现。对最先进模型(例如,Gemini-2.5 Pro和GPT-5)的评估表明,即使是最强大的模型在最困难的任务和最长的视频上,准确率也仅达到约18%,揭示了在真实世界的时间、空间和意图推理方面存在显著差距。AccidentBench旨在揭示这些关键差距,并推动多模态模型的发展,使其更安全、更稳健,并更好地应对现实世界的安全关键挑战。代码和数据集可在https://github.com/SafeRL-Lab/AccidentBench 获得。

🔬 方法详解

问题定义:现有的多模态模型在理解和推理真实世界安全攸关场景(如车辆事故、航空和水运)中的复杂事件时,面临着时间、空间和意图推理的挑战。现有方法难以有效处理长视频中的复杂动态关系,并且缺乏对物理世界规则的深刻理解,导致在安全关键任务中表现不佳。

核心思路:AccidentBench的核心思路是构建一个大规模、多样化的多模态基准数据集,包含车辆事故以及航空和水运等场景,这些场景强调时间、空间和意图推理。通过提供不同难度级别和视频长度的问答对,系统性地评估模型在这些关键能力上的表现,从而揭示现有模型的不足之处,并推动更安全、更鲁棒的多模态模型的发展。

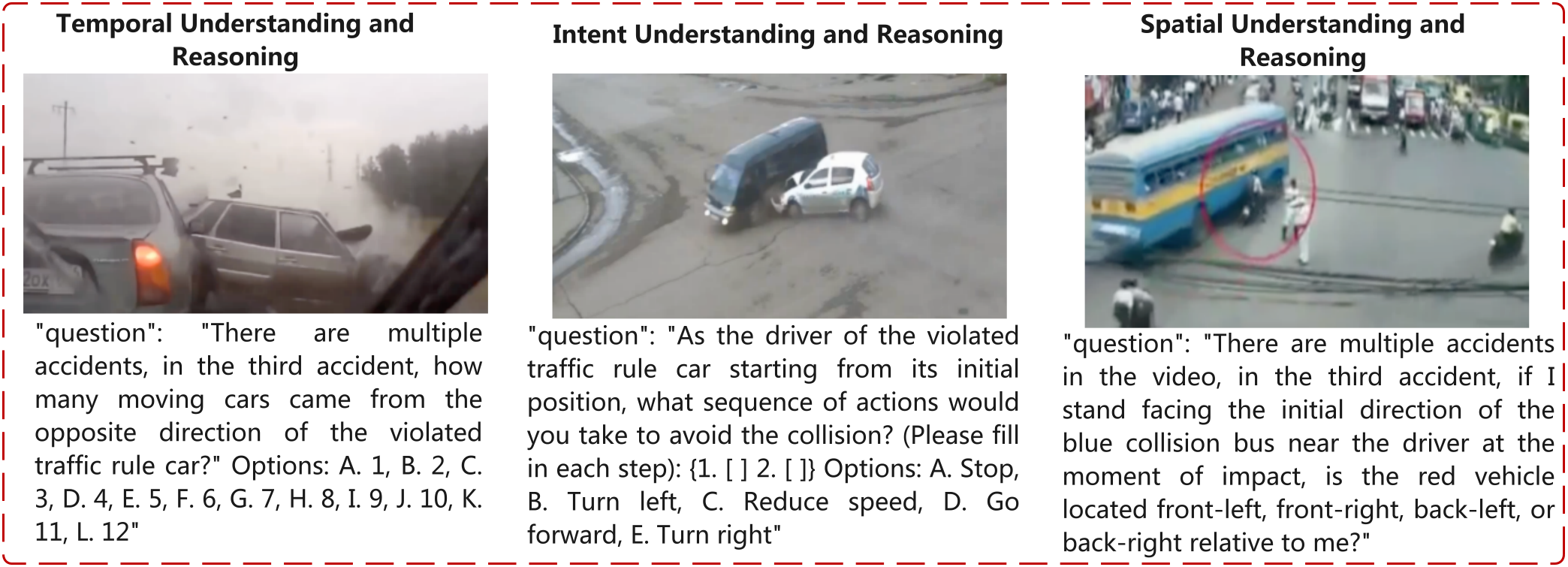

技术框架:AccidentBench数据集包含约2000个视频和超过19000个人工标注的问答对。数据集涵盖了车辆事故场景以及航空和水运等“超越”领域。数据集根据视频长度(短/中/长)和难度级别(易/中/难)进行划分。评估任务主要集中在时间理解、空间理解和意图理解与推理三个方面。

关键创新:AccidentBench的关键创新在于其综合性地结合了车辆事故场景与航空、水运等安全攸关场景,从而提供了一个更全面、更具挑战性的测试平台。此外,数据集的设计着重于评估模型在时间、空间和意图推理方面的能力,这对于安全关键应用至关重要。

关键设计:AccidentBench数据集中的问答对由人工标注,确保了标注的准确性和一致性。数据集中的视频长度和难度级别经过精心设计,以系统性地评估模型在不同场景下的表现。评估指标主要包括准确率,用于衡量模型回答问题的正确程度。

🖼️ 关键图片

📊 实验亮点

在AccidentBench基准测试中,即使是最先进的多模态模型(例如Gemini-2.5 Pro和GPT-5)在最困难的任务和最长的视频上,准确率也仅达到约18%。这表明现有模型在真实世界的时间、空间和意图推理方面存在显著差距,突显了AccidentBench的价值和意义。

🎯 应用场景

AccidentBench的研究成果可应用于自动驾驶、智能交通、航空安全、水运安全等领域。通过提升多模态模型在复杂动态环境下的理解和推理能力,可以有效减少事故发生,提高安全性。此外,该基准数据集还可以促进多模态模型在其他安全关键领域的应用,例如机器人导航、灾害救援等。

📄 摘要(原文)

Rapid advances in multimodal models demand benchmarks that rigorously evaluate understanding and reasoning in safety-critical, dynamic real-world settings. We present AccidentBench, a large-scale benchmark that combines vehicle accident scenarios with Beyond domains, safety-critical settings in air and water that emphasize spatial and temporal reasoning (e.g., navigation, orientation, multi-vehicle motion). The benchmark contains approximately 2000 videos and over 19000 human-annotated question--answer pairs spanning multiple video lengths (short/medium/long) and difficulty levels (easy/medium/hard). Tasks systematically probe core capabilities: temporal, spatial, and intent understanding and reasoning. By unifying accident-centric traffic scenes with broader safety-critical scenarios in air and water, AccidentBench offers a comprehensive, physically grounded testbed for evaluating models under real-world variability. Evaluations of state-of-the-art models (e.g., Gemini-2.5 Pro and GPT-5) show that even the strongest models achieve only about 18% accuracy on the hardest tasks and longest videos, revealing substantial gaps in real-world temporal, spatial, and intent reasoning. AccidentBench is designed to expose these critical gaps and drive the development of multimodal models that are safer, more robust, and better aligned with real-world safety-critical challenges. The code and dataset are available at: https://github.com/SafeRL-Lab/AccidentBench