Estimating Dimensionality of Neural Representations from Finite Samples

作者: Chanwoo Chun, Abdulkadir Canatar, SueYeon Chung, Daniel Lee

分类: stat.ML, cs.LG, q-bio.NC

发布日期: 2025-09-30

💡 一句话要点

提出一种偏差校正的维度估计器,用于解决神经表征维度估计中样本量依赖问题。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 神经表征维度估计 偏差校正 有限样本 参与率 神经科学 人工智能 维度约简

📋 核心要点

- 现有神经表征维度估计方法对样本数量敏感,尤其是在样本量较小时,估计结果偏差较大。

- 提出一种偏差校正的维度估计器,通过校正参与率的偏差,提高在有限样本下的估计准确性。

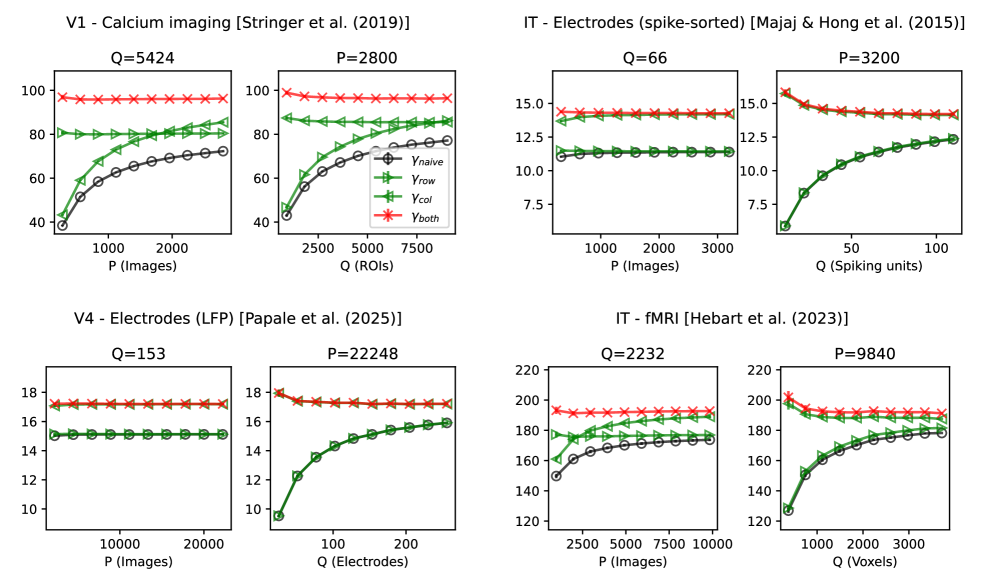

- 实验表明,该估计器在合成数据和真实神经数据上均表现良好,且对样本大小具有不变性。

📝 摘要(中文)

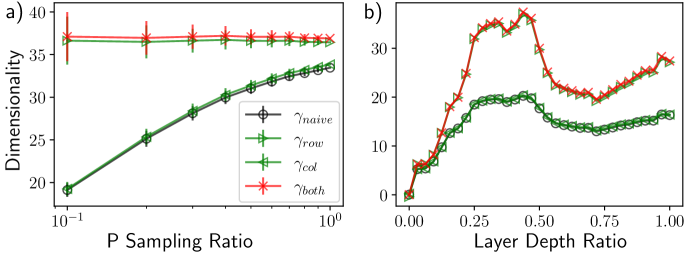

神经表征流形的全局维度能够深入了解人工和生物神经网络的计算过程。然而,现有的全局维度度量方法对样本数量敏感。本文指出,特征值参与率(participation ratio)作为一种常用的全局维度度量方法,在小样本情况下存在较大偏差。因此,提出了一种偏差校正的估计器,该估计器在有限样本和噪声情况下更加准确。在合成数据实验中,该估计器能够恢复真实的维度。此外,该估计器被应用于神经脑记录(包括钙成像、电生理记录和fMRI数据)以及大型语言模型的神经激活中,结果表明该估计器对样本大小具有不变性。最后,该估计器还可以通过适当加权有限样本来测量弯曲神经流形的局部维度。

🔬 方法详解

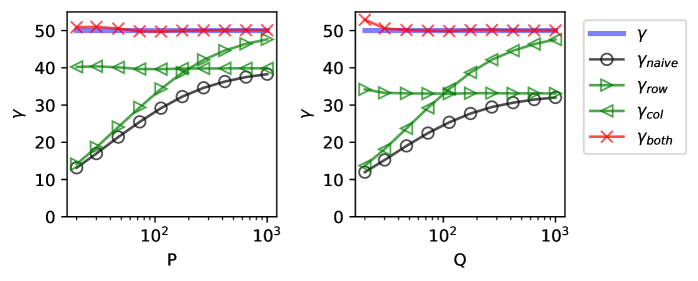

问题定义:论文旨在解决神经表征维度估计中,现有方法对样本数量敏感的问题。特别是,常用的参与率(participation ratio)在样本量较小时会产生较大的偏差,导致维度估计不准确。这种不准确性会影响对神经网络计算过程的理解。

核心思路:论文的核心思路是针对参与率的偏差进行校正,从而得到更准确的维度估计。通过理论分析,推导出偏差的表达式,并设计相应的校正项,使得估计器在有限样本下也能给出可靠的结果。这种校正使得估计器对样本大小具有不变性。

技术框架:该方法主要包含以下几个阶段:1)计算样本数据的协方差矩阵或相关矩阵;2)对协方差矩阵进行特征值分解,得到特征值谱;3)计算参与率,作为维度估计的初始值;4)根据样本量和特征值谱,计算偏差校正项;5)从初始值中减去偏差校正项,得到最终的维度估计值。

关键创新:该论文的关键创新在于提出了偏差校正项,能够有效地降低有限样本对维度估计的影响。与现有方法相比,该方法在小样本情况下能够更准确地估计神经表征的维度,并且对样本大小具有不变性。此外,该方法还可以通过加权样本来估计局部维度。

关键设计:偏差校正项的具体形式取决于特征值谱的统计特性和样本量。论文中可能给出了偏差校正项的数学表达式,并讨论了其适用条件。此外,对于局部维度估计,需要设计合适的加权方案,以突出局部区域的样本点。

🖼️ 关键图片

📊 实验亮点

该论文通过合成数据实验验证了所提出的偏差校正估计器能够准确恢复真实维度。在真实神经数据(包括钙成像、电生理记录和fMRI数据)以及大型语言模型的神经激活上的实验表明,该估计器对样本大小具有不变性,优于传统的参与率方法。具体的性能提升数据(例如,在特定数据集上维度估计的准确率提升)可能在论文正文中给出。

🎯 应用场景

该研究成果可应用于神经科学领域,帮助研究人员更准确地分析大脑神经活动数据,理解大脑的计算机制。此外,该方法也可应用于人工智能领域,例如分析神经网络的表征能力,优化网络结构,提高模型的泛化能力。该方法在样本量有限的情况下具有优势,因此在数据获取成本较高的场景下具有重要价值。

📄 摘要(原文)

The global dimensionality of a neural representation manifold provides rich insight into the computational process underlying both artificial and biological neural networks. However, all existing measures of global dimensionality are sensitive to the number of samples, i.e., the number of rows and columns of the sample matrix. We show that, in particular, the participation ratio of eigenvalues, a popular measure of global dimensionality, is highly biased with small sample sizes, and propose a bias-corrected estimator that is more accurate with finite samples and with noise. On synthetic data examples, we demonstrate that our estimator can recover the true known dimensionality. We apply our estimator to neural brain recordings, including calcium imaging, electrophysiological recordings, and fMRI data, and to the neural activations in a large language model and show our estimator is invariant to the sample size. Finally, our estimators can additionally be used to measure the local dimensionalities of curved neural manifolds by weighting the finite samples appropriately.