Noise-Guided Transport for Imitation Learning

作者: Lionel Blondé, Joao A. Candido Ramos, Alexandros Kalousis

分类: cs.LG, cs.AI

发布日期: 2025-09-30

🔗 代码/项目: GITHUB

💡 一句话要点

提出噪声引导传输(NGT),解决低数据量模仿学习中的专家策略学习问题。

🎯 匹配领域: 支柱一:机器人控制 (Robot Control) 支柱二:RL算法与架构 (RL & Architecture)

关键词: 模仿学习 最优传输 对抗训练 低数据量学习 连续控制 不确定性估计 机器人学习

📋 核心要点

- 现有模仿学习方法在低数据量下表现不佳,依赖大规模预训练或复杂架构,难以有效利用少量专家数据。

- NGT将模仿学习建模为最优传输问题,通过对抗训练求解,无需预训练,并自然地融入不确定性估计。

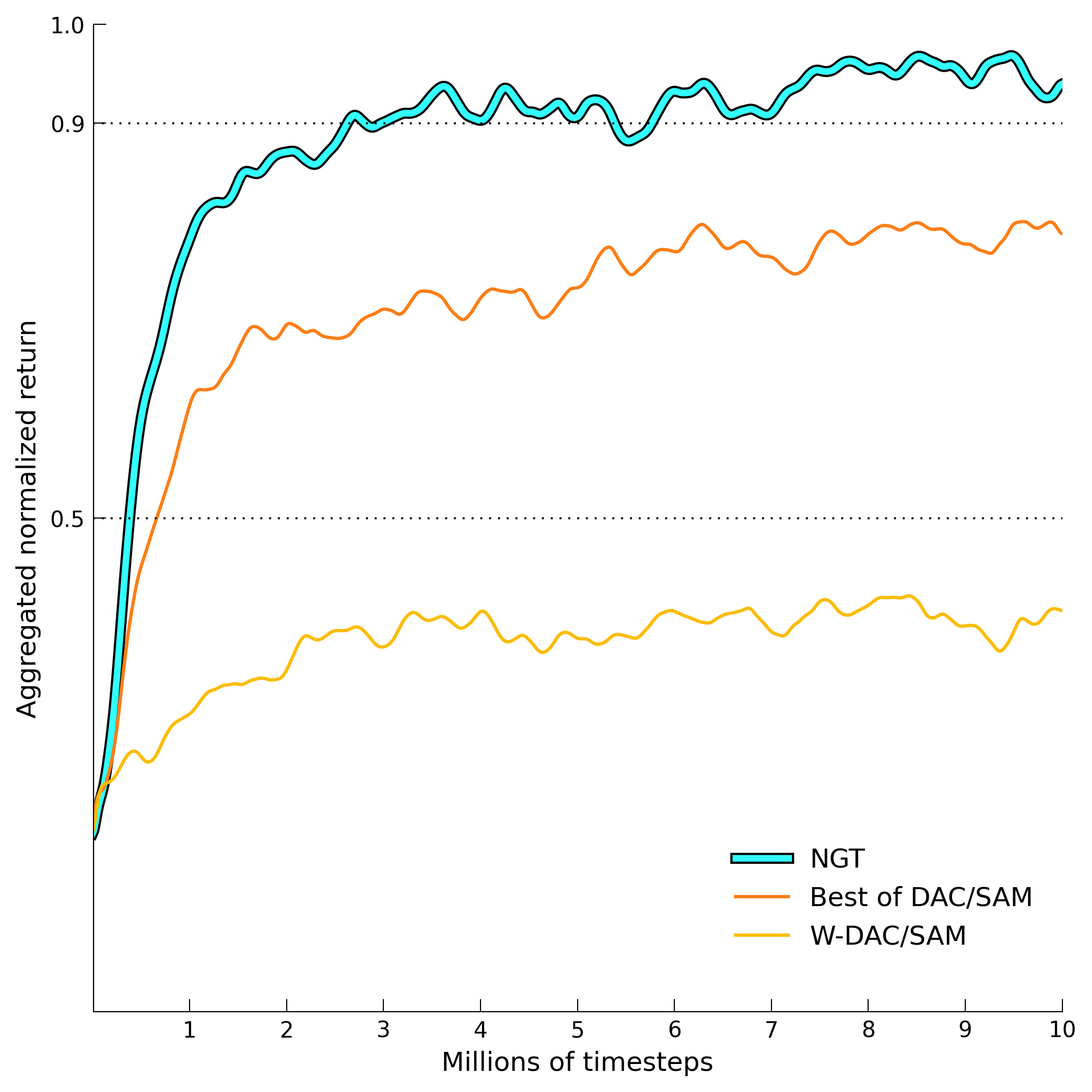

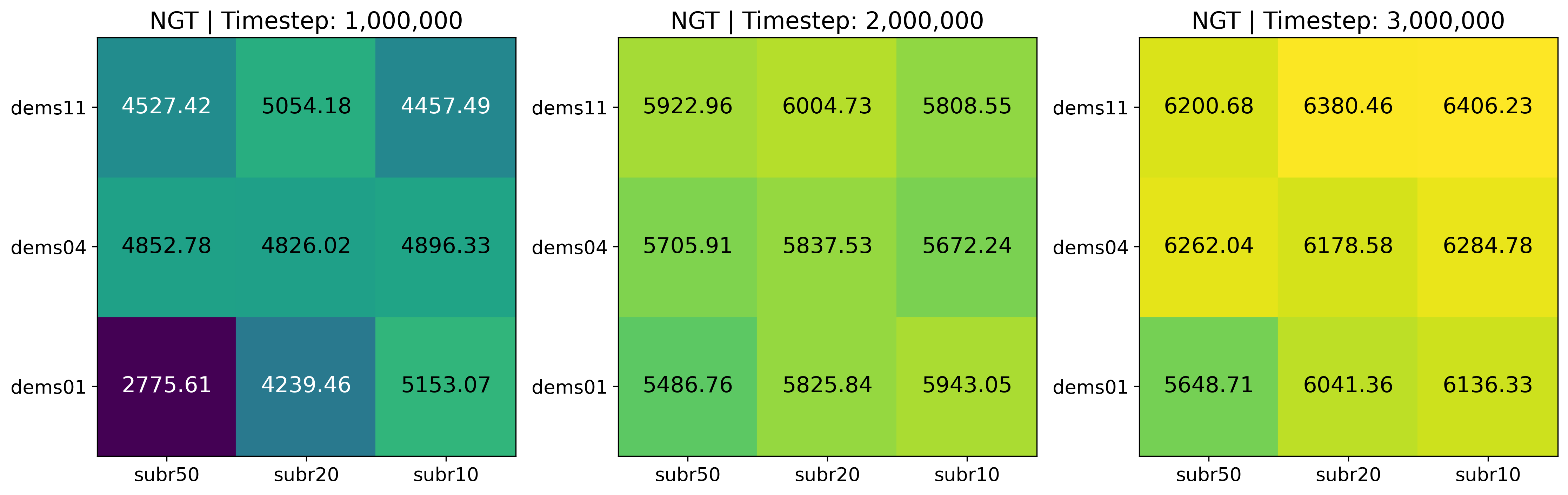

- 实验表明,NGT在极低数据量下,例如仅使用20个transitions,在连续控制任务上取得了优异的性能。

📝 摘要(中文)

本文研究了低数据量下的模仿学习问题,即只有少量专家演示数据可用。在这种情况下,依赖大规模预训练或高容量架构的方法难以应用,而关于演示数据的效率变得至关重要。我们提出了一种轻量级的离策略方法,称为噪声引导传输(NGT),它将模仿学习转化为一个通过对抗训练解决的最优传输问题。NGT不需要预训练或专门的架构,通过设计融入了不确定性估计,并且易于实现和调整。尽管其简单性,NGT在具有挑战性的连续控制任务(包括高维Humanoid任务)上,在极低数据量的情况下(仅20个transitions)实现了强大的性能。代码已在https://github.com/lionelblonde/ngt-pytorch上公开。

🔬 方法详解

问题定义:论文旨在解决低数据量模仿学习问题。传统模仿学习方法,如行为克隆和GAN-based方法,通常需要大量的专家数据才能有效学习策略。在数据量有限的情况下,这些方法容易过拟合,导致泛化能力差。此外,现有方法通常忽略了策略学习过程中的不确定性,这可能导致次优的策略。

核心思路:NGT的核心思路是将模仿学习问题转化为一个最优传输问题。具体来说,NGT试图找到一个将智能体的策略状态-动作分布“传输”到专家策略状态-动作分布的映射。通过最小化两个分布之间的传输成本,NGT可以学习到模仿专家行为的策略。此外,NGT通过引入噪声来估计策略的不确定性,从而提高策略的鲁棒性。

技术框架:NGT的整体框架包括一个生成器(策略网络)和一个判别器。生成器负责生成智能体的状态-动作分布,判别器负责区分智能体的状态-动作对和专家的状态-动作对。NGT使用对抗训练的方式来训练生成器和判别器。具体来说,生成器试图生成能够欺骗判别器的状态-动作对,而判别器试图准确地区分智能体的状态-动作对和专家的状态-动作对。通过这种对抗训练,生成器可以逐渐学习到模仿专家行为的策略。同时,NGT在生成器的输出中加入噪声,并利用判别器来估计策略的不确定性。

关键创新:NGT的关键创新在于将模仿学习问题建模为最优传输问题,并通过对抗训练来求解。与传统的模仿学习方法相比,NGT不需要预训练或专门的架构,并且能够自然地融入不确定性估计。此外,NGT在低数据量下表现出色,这使得它在实际应用中更具吸引力。NGT通过噪声引导的方式,使得策略学习更加稳定和鲁棒。

关键设计:NGT的关键设计包括:1) 使用Wasserstein距离作为最优传输的成本函数;2) 使用对抗训练来优化Wasserstein距离;3) 在生成器的输出中加入高斯噪声,并使用判别器来估计噪声的方差,从而获得策略的不确定性;4) 使用简单的神经网络结构作为生成器和判别器,以减少模型的复杂度,并提高训练的效率。损失函数包括对抗损失和噪声正则化项,用于平衡策略模仿和不确定性估计。

🖼️ 关键图片

📊 实验亮点

NGT在多个连续控制任务上进行了评估,包括高维Humanoid任务。实验结果表明,NGT在极低数据量下(例如仅使用20个transitions)取得了显著的性能提升,优于现有的模仿学习方法。例如,在Humanoid任务上,NGT的性能明显优于行为克隆和GAN-based方法,证明了其在低数据量下的有效性。

🎯 应用场景

NGT适用于需要从少量专家演示中学习策略的各种机器人和控制任务。例如,它可以用于训练机器人完成复杂的装配任务,或者用于自动驾驶汽车学习安全驾驶策略。由于其低数据量需求,NGT特别适用于那些获取大量专家数据成本高昂的场景。未来,NGT可以扩展到多智能体模仿学习和强化学习等领域。

📄 摘要(原文)

We consider imitation learning in the low-data regime, where only a limited number of expert demonstrations are available. In this setting, methods that rely on large-scale pretraining or high-capacity architectures can be difficult to apply, and efficiency with respect to demonstration data becomes critical. We introduce Noise-Guided Transport (NGT), a lightweight off-policy method that casts imitation as an optimal transport problem solved via adversarial training. NGT requires no pretraining or specialized architectures, incorporates uncertainty estimation by design, and is easy to implement and tune. Despite its simplicity, NGT achieves strong performance on challenging continuous control tasks, including high-dimensional Humanoid tasks, under ultra-low data regimes with as few as 20 transitions. Code is publicly available at: https://github.com/lionelblonde/ngt-pytorch.