Rotation Control Unlearning: Quantifying and Controlling Continuous Unlearning for LLM with The Cognitive Rotation Space

作者: Xiang Zhang, Kun Wei, Xu Yang, Jiahua Li, Su Yan, Cheng Deng

分类: cs.LG, cs.CL

发布日期: 2025-09-30 (更新: 2026-01-04)

💡 一句话要点

提出旋转控制卸载(RCU)方法,解决LLM持续卸载中的灾难性效用损失问题。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 大型语言模型 机器卸载 持续卸载 认知旋转空间 正交旋转轴正则化

📋 核心要点

- 现有机器卸载方法依赖保留数据集,且在持续卸载请求下会产生累积的灾难性效用损失。

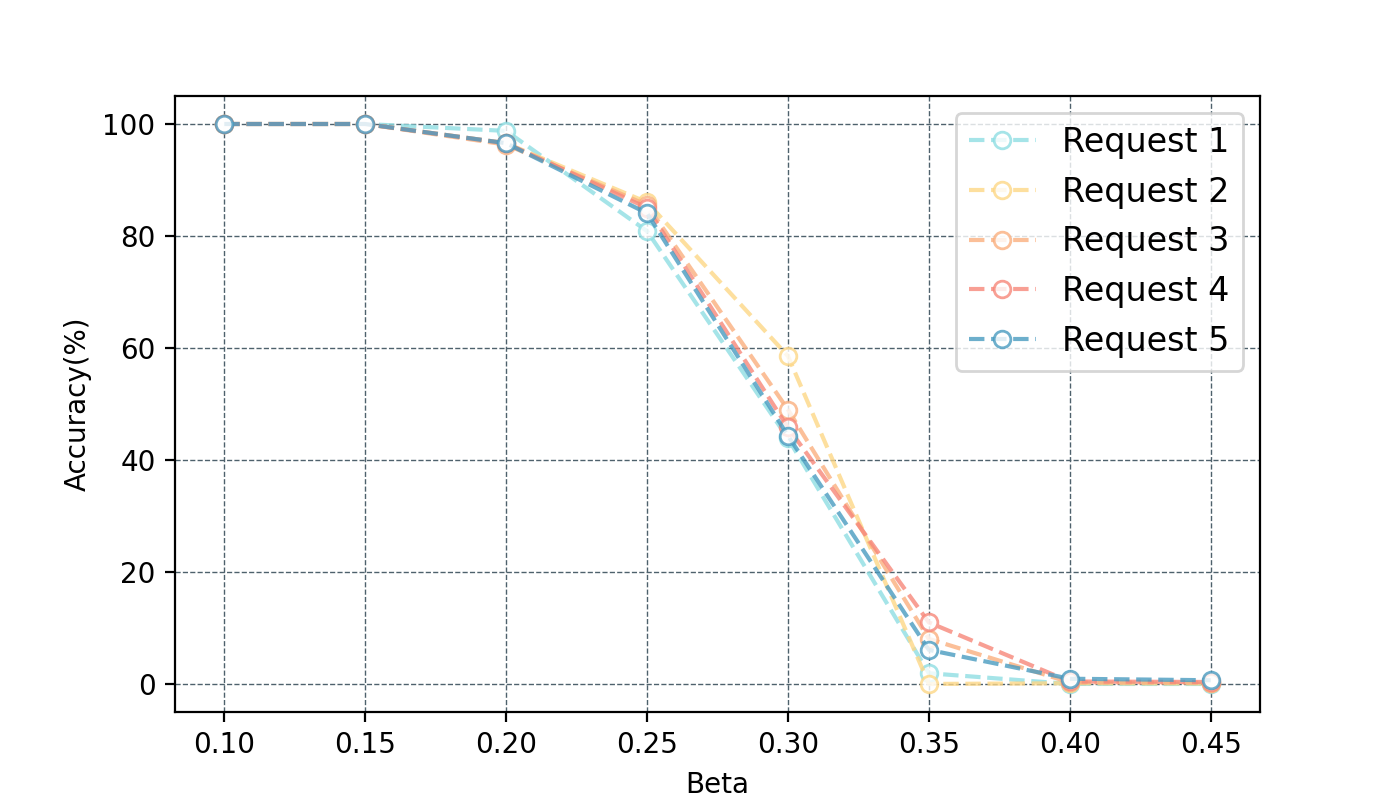

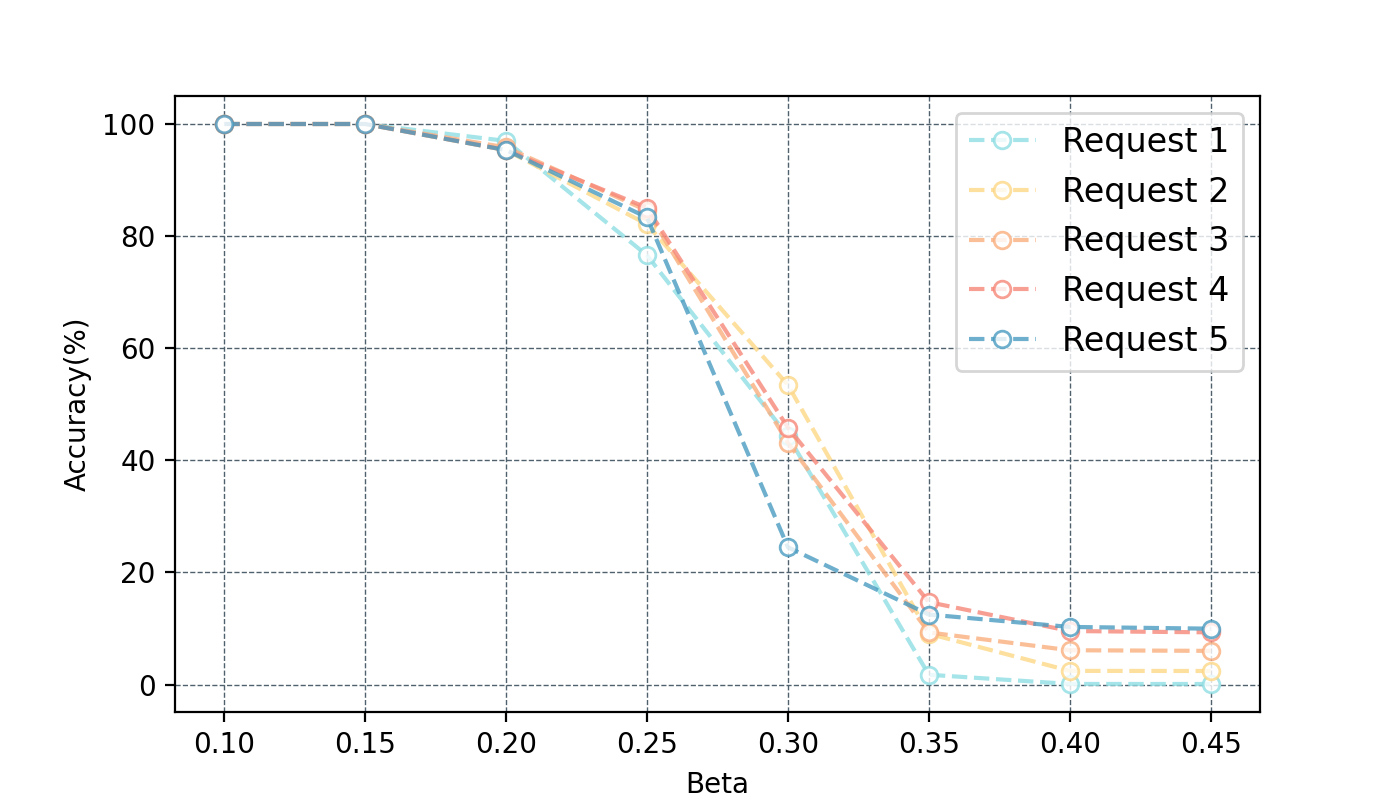

- RCU方法利用旋转显著性权重量化和控制卸载程度,并通过认知旋转空间模拟持续卸载过程。

- 正交旋转轴正则化用于最小化卸载请求间的干扰,实验表明RCU在无保留数据集下达到SOTA性能。

📝 摘要(中文)

随着大型语言模型(LLM)日益普及,其安全漏洞已引起广泛关注。机器卸载旨在通过消除不良数据的影响来缓解这些风险。然而,现有方法不仅依赖于保留数据集来维持模型效用,而且在持续卸载请求下会遭受累积的灾难性效用损失。为了解决这一困境,我们提出了一种名为旋转控制卸载(RCU)的新方法,该方法利用RCU的旋转显著性权重来量化和控制持续卸载过程中的卸载程度。我们设计了斜对称损失来构建认知旋转空间的存在,其中旋转角度的变化可以模拟持续卸载过程。此外,我们设计了正交旋转轴正则化,以强制持续卸载请求的相互垂直旋转方向,从而有效地最小化干扰并解决累积的灾难性效用损失。在多个数据集上的实验证实,我们的方法在没有保留数据集的情况下实现了SOTA性能。

🔬 方法详解

问题定义:论文旨在解决大型语言模型(LLM)在持续接收卸载请求时,模型效用急剧下降的问题。现有的机器卸载方法通常需要保留一部分数据集来维持模型的性能,但这在某些场景下是不可行的,并且仍然无法避免在多次卸载后的性能损失。因此,如何在不依赖保留数据集的情况下,实现LLM的持续卸载,并保证模型效用,是本文要解决的核心问题。

核心思路:论文的核心思路是构建一个“认知旋转空间”,将卸载过程模拟为模型参数在这个空间中的旋转。通过控制旋转的角度和方向,可以精确地控制卸载的程度和范围,从而避免过度卸载导致的性能损失。同时,通过引入正交旋转轴正则化,保证每次卸载都在不同的方向上进行,减少卸载之间的相互干扰。

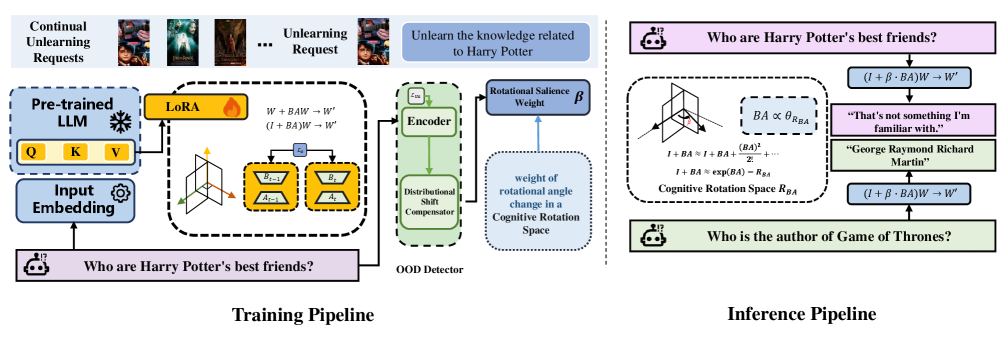

技术框架:RCU方法主要包含以下几个关键模块:1) 旋转显著性权重计算:用于量化每个参数对于特定卸载请求的重要性。2) 斜对称损失函数设计:用于构建认知旋转空间,使得模型参数可以在该空间中进行旋转。3) 正交旋转轴正则化:用于保证不同卸载请求的旋转方向相互垂直。整个流程如下:首先,对于每个卸载请求,计算旋转显著性权重;然后,利用斜对称损失函数和正交旋转轴正则化,对模型参数进行更新,实现卸载。

关键创新:RCU方法的关键创新在于:1) 提出了认知旋转空间的概念,将卸载过程转化为参数空间的旋转,从而可以更加精细地控制卸载的程度。2) 设计了斜对称损失函数,用于构建认知旋转空间,并保证旋转的有效性。3) 引入了正交旋转轴正则化,用于减少不同卸载请求之间的相互干扰,从而避免累积的性能损失。与现有方法相比,RCU方法不需要保留数据集,并且可以更好地控制卸载过程,从而在保证模型效用的同时,实现有效的卸载。

关键设计:斜对称损失函数的设计是关键。假设要卸载的数据为D,模型参数为θ,则斜对称损失函数可以表示为:L = ||R(θ) - θ||^2,其中R(θ)表示对θ进行旋转后的参数。旋转矩阵R的设计需要保证其斜对称性,即R^T = -R。正交旋转轴正则化通过约束不同卸载请求对应的旋转轴相互垂直来实现,即

🖼️ 关键图片

📊 实验亮点

实验结果表明,RCU方法在多个数据集上实现了SOTA性能,并且在没有保留数据集的情况下,仍然能够有效地卸载模型中的不良信息,同时保持模型的效用。与现有方法相比,RCU方法在持续卸载场景下,能够显著减少累积的灾难性效用损失,提升模型的稳定性和可靠性。具体性能数据未知,但强调了SOTA性能。

🎯 应用场景

RCU方法可应用于各种需要持续卸载的LLM场景,例如:1) 保护用户隐私,删除模型中包含的个人信息;2) 应对恶意攻击,移除模型中被污染的数据;3) 适应知识更新,遗忘过时或错误的知识。该方法能够提升LLM的安全性、可靠性和适应性,具有重要的实际应用价值和广阔的未来发展前景。

📄 摘要(原文)

As Large Language Models (LLMs) become increasingly prevalent, their security vulnerabilities have already drawn attention. Machine unlearning is introduced to seek to mitigate these risks by removing the influence of undesirable data. However, existing methods not only rely on the retained dataset to preserve model utility, but also suffer from cumulative catastrophic utility loss under continuous unlearning requests. To solve this dilemma, we propose a novel method, called Rotation Control Unlearning (RCU), which leverages the rotational salience weight of RCU to quantify and control the unlearning degree in the continuous unlearning process. The skew symmetric loss is designed to construct the existence of the cognitive rotation space, where the changes of rotational angle can simulate the continuous unlearning process. Furthermore, we design an orthogonal rotation axes regularization to enforce mutually perpendicular rotation directions for continuous unlearning requests, effectively minimizing interference and addressing cumulative catastrophic utility loss. Experiments on multiple datasets confirm that our method without retained dataset achieves SOTA performance.