FraudTransformer: Time-Aware GPT for Transaction Fraud Detection

作者: Gholamali Aminian, Andrew Elliott, Tiger Li, Timothy Cheuk Hin Wong, Victor Claude Dehon, Lukasz Szpruch, Carsten Maple, Christopher Read, Martin Brown, Gesine Reinert, Mo Mamouei

分类: cs.LG, stat.ML

发布日期: 2025-09-28 (更新: 2025-10-28)

备注: Accepted in AI-FIND ICAIF'25 (https://sites.google.com/view/icaif-fraud-detection-workshop/home)

💡 一句话要点

FraudTransformer:面向交易欺诈检测的时序感知GPT模型

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 欺诈检测 Transformer 时间序列 序列建模 GPT 位置编码 时间编码

📋 核心要点

- 现有欺诈检测模型难以有效利用事件发生的顺序以及事件之间不规则的时间间隔。

- FraudTransformer通过引入时间编码器和可学习的位置编码器,增强了GPT模型对时序信息的建模能力。

- 在大型工业数据集上的实验表明,FraudTransformer显著优于传统模型和Transformer变体,提升了欺诈检测性能。

📝 摘要(中文)

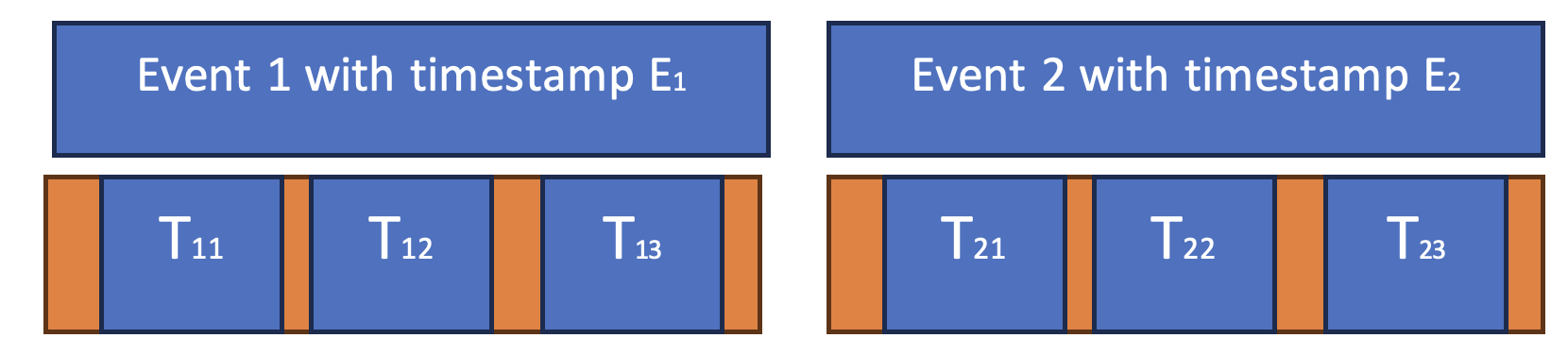

本文提出了一种名为FraudTransformer的序列模型,用于检测真实银行交易流中的支付欺诈。该模型在GPT架构的基础上,引入了(i)一个专门的时间编码器,用于嵌入绝对时间戳或事件间的时间间隔,以及(ii)一个学习到的位置编码器,用于保持相对顺序。在包含数千万交易和辅助事件的大型工业数据集上的实验表明,FraudTransformer超越了四个强大的经典基线模型(Logistic Regression、XGBoost和LightGBM),以及省略时间或位置组件的Transformer变体。在保留的测试集上,它提供了最高的AUROC和PRAUC。

🔬 方法详解

问题定义:论文旨在解决银行交易流中支付欺诈检测的问题。现有的方法,如传统的机器学习模型,无法充分利用交易事件的顺序信息和不规则的时间间隔,导致欺诈检测的准确率不高。

核心思路:论文的核心思路是利用Transformer模型强大的序列建模能力,并针对欺诈检测场景的特点,引入时间编码器和位置编码器,从而更好地捕捉交易事件的时序信息。这样可以更准确地识别欺诈行为。

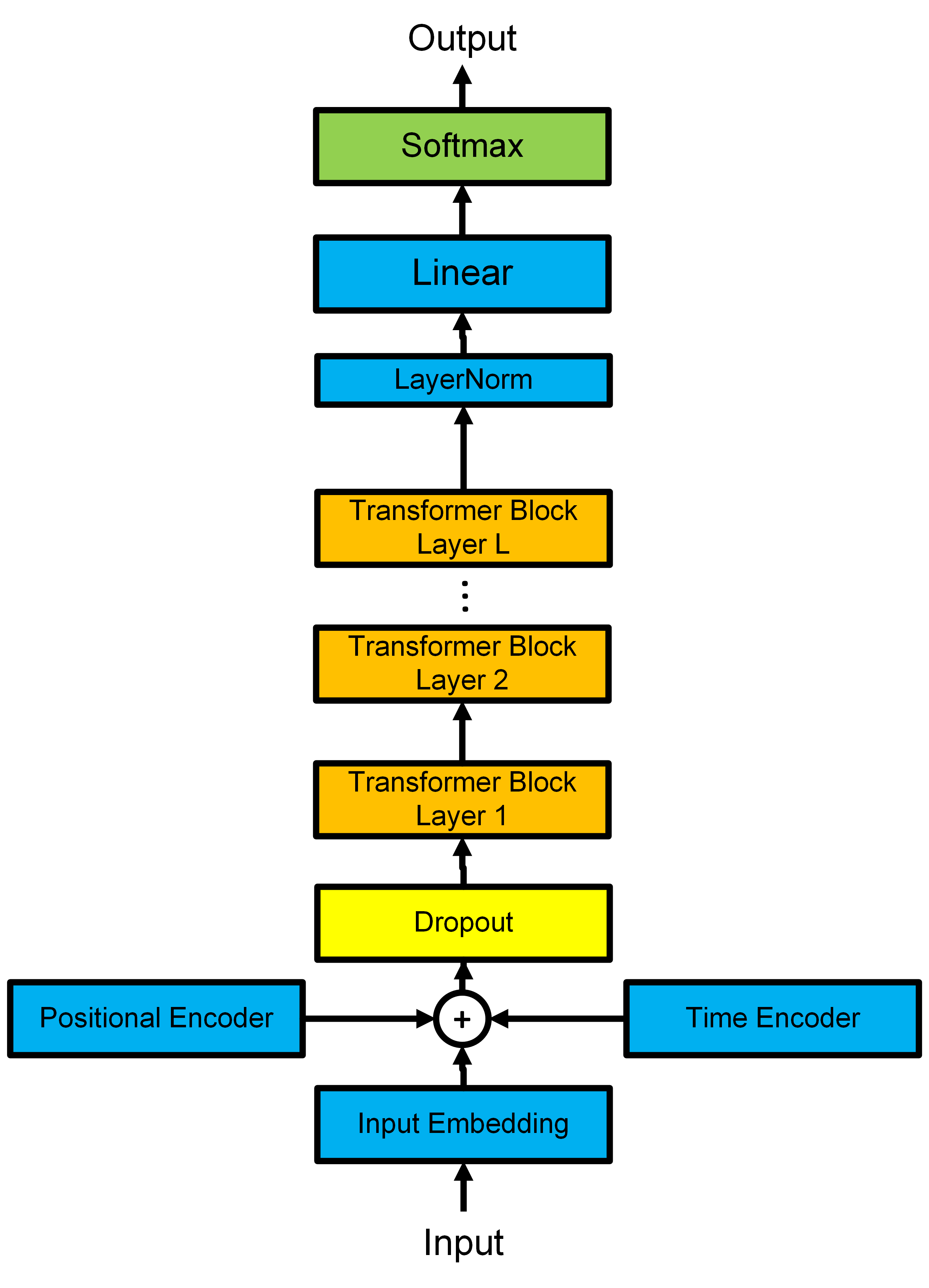

技术框架:FraudTransformer的整体架构基于GPT模型,主要包括以下几个模块:嵌入层(将交易数据转换为向量表示)、时间编码器(嵌入时间信息)、位置编码器(嵌入位置信息)、Transformer层(进行序列建模)和输出层(预测欺诈概率)。模型首先将交易数据进行嵌入,然后通过时间编码器和位置编码器将时间信息和位置信息添加到嵌入向量中,最后通过Transformer层进行序列建模,并输出欺诈概率。

关键创新:FraudTransformer的关键创新在于引入了专门的时间编码器和可学习的位置编码器。时间编码器可以嵌入绝对时间戳或事件间的时间间隔,从而捕捉交易事件的时间信息。位置编码器可以学习交易事件的相对顺序,从而捕捉交易事件的序列信息。

关键设计:时间编码器可以使用绝对时间戳或事件间的时间间隔作为输入,具体选择取决于数据集的特点。位置编码器是一个可学习的矩阵,通过训练数据学习交易事件的相对顺序。损失函数可以使用二元交叉熵损失函数,用于衡量预测的欺诈概率与真实标签之间的差异。网络结构方面,Transformer层的数量和隐藏层的大小可以根据数据集的大小和复杂度进行调整。

🖼️ 关键图片

📊 实验亮点

实验结果表明,FraudTransformer在大型工业数据集上显著优于四个强大的经典基线模型(Logistic Regression、XGBoost和LightGBM),以及省略时间或位置组件的Transformer变体。在保留的测试集上,FraudTransformer取得了最高的AUROC和PRAUC,证明了其在欺诈检测任务上的有效性。

🎯 应用场景

FraudTransformer可应用于银行、金融机构等场景,用于实时检测支付欺诈行为,降低欺诈风险,保护用户资金安全。该研究成果还可以推广到其他需要时序数据分析的领域,如网络安全、医疗健康等,具有广泛的应用前景。

📄 摘要(原文)

Detecting payment fraud in real-world banking streams requires models that can exploit both the order of events and the irregular time gaps between them. We introduce FraudTransformer, a sequence model that augments a vanilla GPT-style architecture with (i) a dedicated time encoder that embeds either absolute timestamps or inter-event values, and (ii) a learned positional encoder that preserves relative order. Experiments on a large industrial dataset -- tens of millions of transactions and auxiliary events -- show that FraudTransformer surpasses four strong classical baselines (Logistic Regression, XGBoost and LightGBM) as well as transformer ablations that omit either the time or positional component. On the held-out test set it delivers the highest AUROC and PRAUC.