SDQ-LLM: Sigma-Delta Quantization for 1-bit LLMs of any size

作者: Junhao Xia, Ming Zhao, Limin Xiao, Xiujun Zhang

分类: cs.LG, cs.AI, cs.CV

发布日期: 2025-09-27

🔗 代码/项目: GITHUB

💡 一句话要点

SDQ-LLM:面向任意规模LLM的Sigma-Delta 1比特量化框架

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 大语言模型 量化 低比特量化 Sigma-Delta量化 过采样 模型压缩

📋 核心要点

- 现有LLM面临巨大的计算和内存挑战,极低比特量化是高效部署的关键,但会严重影响模型性能。

- SDQ-LLM通过可调过采样率的Sigma-Delta量化,将高精度权重编码为极低比特表示,并用加法代替乘法。

- 实验表明,SDQ-LLM即使在低过采样率下,也能在OPT和LLaMA模型上实现高效且高精度的性能。

📝 摘要(中文)

本文提出SDQ-LLM,一种面向任意规模大语言模型(LLM)的Sigma-Delta量化框架,旨在实现极低比特量化并保留语言推理能力。SDQ-LLM的显著特点是可连续调节的过采样率(OSR),通过选择分数OSR(例如2.5倍)动态适应内存或VRAM约束,从而在模型大小和精度之间实现最佳权衡。SDQ-LLM采用过采样结合Sigma-Delta量化器,将LLM权重二值化或三值化,将高精度参数编码为1比特或1.58比特表示,并将线性层中的乘法运算替换为加法,从而显著提高极低比特量化下的推理效率。为了进一步减少量化精度损失,我们在量化前引入基于Hadamard的权重平滑,提高权重表示的稳定性和鲁棒性。此外,为了充分利用OSR的连续性并减少精度损失,我们认识到量化敏感性与权重方差之间的相关性,提出了一种细粒度的、层和线性相关的OSR分配策略MultiOSR。该策略基于权重方差和参数规模在层之间和每层内部分配OSR。在OPT和LLaMA模型系列上的大量实验表明,即使在高度激进的低OSR设置下,SDQ-LLM也能实现更高效和高精度的性能。

🔬 方法详解

问题定义:现有大语言模型(LLM)的部署面临着巨大的计算和内存压力,为了降低部署成本,极低比特量化是一种有效的方法。然而,直接将LLM的权重进行极低比特量化(如1比特)会导致严重的精度损失,从而影响模型的性能。现有的量化方法难以在极低比特量化下保持LLM的语言推理能力,并且缺乏灵活的内存/精度权衡机制。

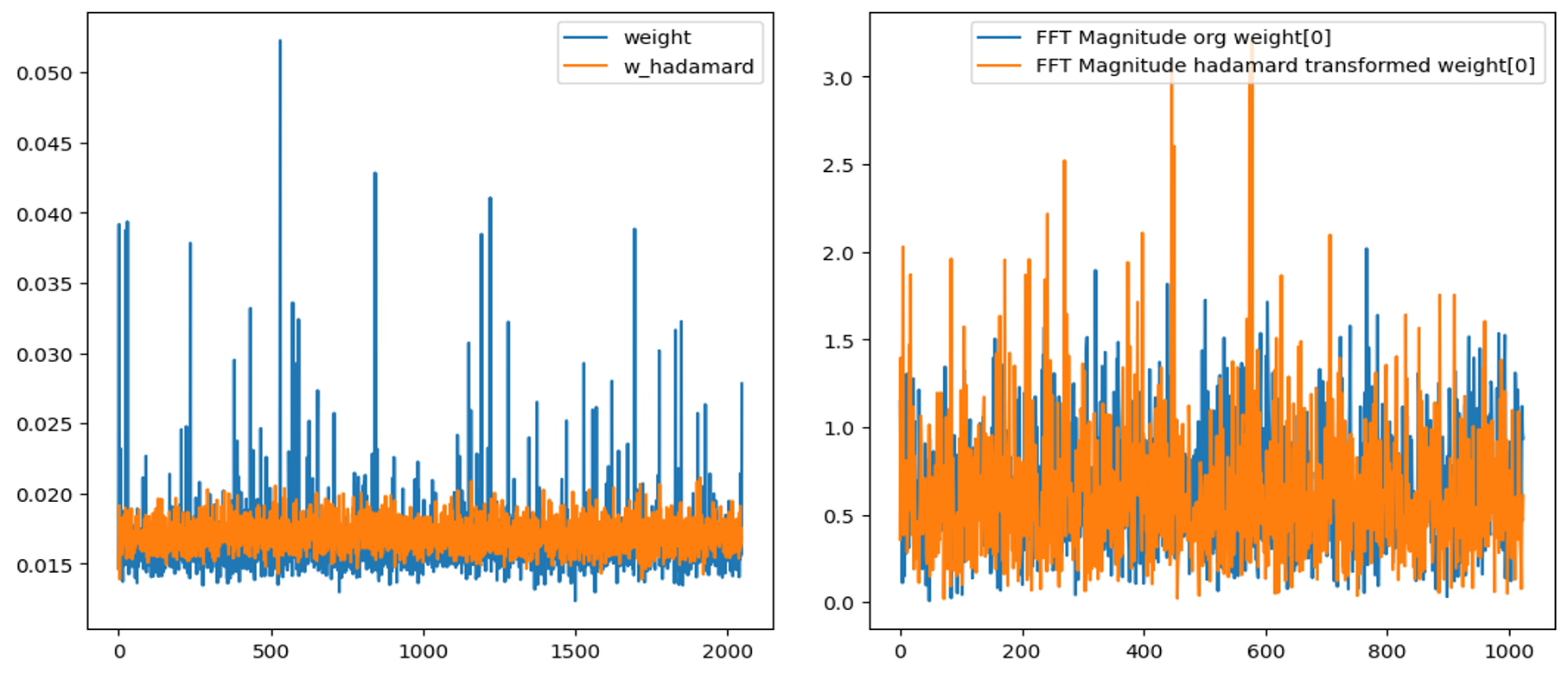

核心思路:SDQ-LLM的核心思路是利用Sigma-Delta量化器结合可调的过采样率(OSR)来实现LLM权重的极低比特量化。通过过采样,将高精度权重信息编码到低比特表示中,从而减少量化误差。此外,通过调整OSR,可以灵活地控制模型大小和精度之间的权衡。该方法还利用Hadamard变换进行权重平滑,并根据权重方差进行细粒度的OSR分配,进一步提升量化精度。

技术框架:SDQ-LLM的整体框架包括以下几个主要步骤:1) Hadamard权重平滑:使用Hadamard变换对权重进行平滑处理,提高权重的稳定性和鲁棒性。2) Sigma-Delta量化:使用Sigma-Delta量化器将权重进行量化,将高精度权重转换为1比特或1.58比特的表示。3) 过采样:通过调整过采样率(OSR)来控制量化精度和模型大小之间的权衡。4) MultiOSR分配:根据权重方差和参数规模,在层之间和每层内部分配OSR。

关键创新:SDQ-LLM的关键创新点在于:1) 提出了基于Sigma-Delta量化的极低比特LLM量化框架。2) 引入了可连续调节的过采样率(OSR),实现了模型大小和精度之间的灵活权衡。3) 提出了细粒度的、层和线性相关的OSR分配策略MultiOSR,进一步提升了量化精度。4) 结合Hadamard变换进行权重平滑,提高了权重的稳定性和鲁棒性。

关键设计:1) 过采样率(OSR)的连续可调性:允许用户根据实际的内存或VRAM约束,选择合适的分数OSR,例如2.5倍。2) MultiOSR分配策略:根据权重方差和参数规模,自适应地在不同层和同一层的不同线性层之间分配OSR。具体来说,权重方差较大的层或线性层分配较高的OSR,以减少量化误差。3) Hadamard权重平滑:使用Hadamard变换对权重进行平滑处理,降低量化噪声。

🖼️ 关键图片

📊 实验亮点

SDQ-LLM在OPT和LLaMA模型系列上进行了广泛的实验。实验结果表明,即使在高度激进的低OSR设置下,SDQ-LLM也能实现比现有方法更高效和高精度的性能。例如,在某些设置下,SDQ-LLM可以在保持相当精度的前提下,将模型大小降低到原来的几分之一。

🎯 应用场景

SDQ-LLM在资源受限的设备上部署大型语言模型具有广泛的应用前景,例如移动设备、嵌入式系统和边缘计算设备。通过极低比特量化,可以显著降低模型大小和计算复杂度,从而使得在这些设备上运行LLM成为可能。此外,SDQ-LLM还可以应用于云计算平台,以降低LLM的部署成本和提高推理效率。

📄 摘要(原文)

Large language models (LLMs) face significant computational and memory challenges, making extremely low-bit quantization crucial for their efficient deployment. In this work, we introduce SDQ-LLM: Sigma-Delta Quantization for 1-bit LLMs of any size, a novel framework that enables extremely low-bit quantization of LLMs while preserving their linguistic reasoning capabilities. A distinctive feature of SDQ-LLM is the continuous adjustability of the Over-Sampling Ratio (OSR), enabling dynamic adaptation to memory or VRAM constraints by selecting fractional OSR (e.g. 2.5 times) for an optimal trade-off between model size and accuracy. SDQ-LLM uses upsampling combined with Sigma-Delta Quantizer to binarize or ternarize LLMs weights, encoding high-precision parameters into 1-bit or 1.58-bit representations, replacing the multiplication operations within linear layers with addition. This approach significantly enhances inference efficiency under extremely low-bit quantization. To further reduce the loss of quantization precision, we incorporate Hadamard-based weight smoothing prior to quantization, improving the stability and robustness of the weight representations. Furthermore, to fully leverage the continuity of the OSR and reduce precision loss, recognizing the correlation between quantization sensitivity and weight variance, we propose a fine-grained, layer- and linear-wise OSR allocation strategy, MultiOSR. This strategy distributes OSR both across layers and within each layer, based on weight variance and parameter scale. Finally, extensive experiments on OPT and LLaMA model families demonstrate that SDQ-LLM achieves a more efficient and high-precision performance even under highly aggressive low-OSR settings. Our code is available at https://github.com/Dreamlittlecat/LLM-Quant-Factory.