Decision Potential Surface: A Theoretical and Practical Approximation of LLM's Decision Boundary

作者: Zi Liang, Zhiyao Wu, Haoyang Shang, Yulin Jin, Qingqing Ye, Huadi Zheng, Peizhao Hu, Haibo Hu

分类: cs.LG, cs.AI

发布日期: 2025-09-27

备注: Source code: https://github.com/liangzid/DPS

💡 一句话要点

提出决策势面(DPS)以近似大语言模型(LLM)的决策边界

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 大语言模型 决策边界 可解释性 决策势面 近似算法

📋 核心要点

- 现有方法难以有效构建大型语言模型(LLM)的决策边界,因为计算成本随词汇量和序列长度呈指数增长。

- 论文提出决策势面(DPS)的概念,通过分析不同采样序列的置信度来捕捉决策边界的潜力,从而简化计算。

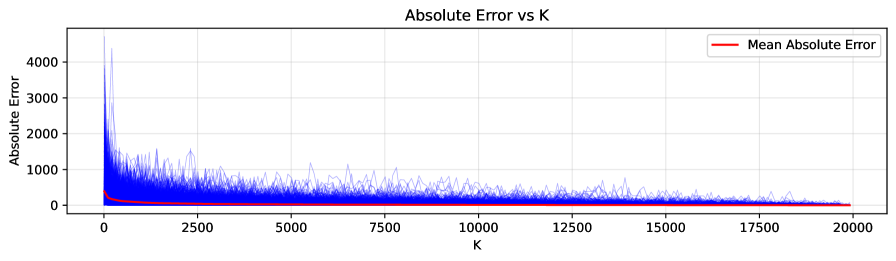

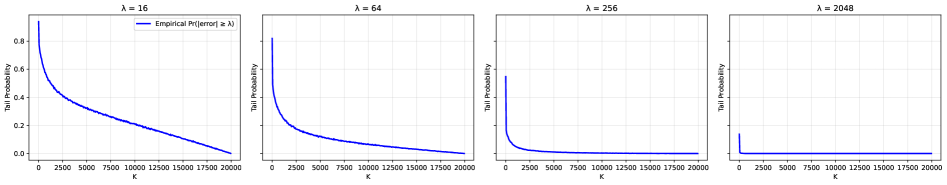

- 论文提出K-DPS算法,通过有限次采样近似LLM的决策边界,并从理论上证明了误差界限,实验验证了有效性。

📝 摘要(中文)

决策边界是机器学习模型中一个关键概念,它代表了模型对不同类别赋予相等分类概率的输入子空间,对于揭示模型的核心属性和解释行为至关重要。尽管分析大型语言模型(LLM)的决策边界最近引起了越来越多的关注,但由于巨大的词汇序列规模和LLM的自回归特性,为主流LLM构建决策边界在计算上仍然是不可行的。为了解决这个问题,本文提出了一种新的分析LLM决策边界的概念——决策势面(DPS)。DPS定义在区分每个输入的各种采样序列的置信度上,自然地捕捉了决策边界的潜力。我们证明了DPS中的零高度等值线等价于LLM的决策边界,封闭区域代表决策区域。通过利用DPS,我们在文献中首次提出了一种近似决策边界构建算法,即K-DPS,它只需要K次有限的序列采样,就可以用可忽略的误差来近似LLM的决策边界。我们从理论上推导了K-DPS和理想DPS之间的绝对误差、期望误差和误差集中的上限,证明了这些误差可以通过采样次数进行权衡。我们的结果通过各种LLM和语料库的广泛实验得到了经验验证。

🔬 方法详解

问题定义:现有方法难以有效构建大型语言模型(LLM)的决策边界。由于LLM的词汇量巨大,序列长度很长,并且具有自回归的特性,直接计算其决策边界所需的计算资源非常庞大,使得分析LLM的决策过程变得困难。现有的方法无法在可接受的时间和资源范围内,对LLM的决策边界进行有效的近似。

核心思路:论文的核心思路是引入“决策势面”(Decision Potential Surface, DPS)的概念,将决策边界的分析从直接计算分类概率,转化为分析不同采样序列的置信度。DPS通过捕捉模型区分不同采样序列的潜力,间接反映了决策边界的位置。通过分析DPS,可以避免直接处理庞大的词汇序列空间,从而降低计算复杂度。

技术框架:论文提出的技术框架主要包含以下几个阶段: 1. 定义决策势面 (DPS):对于给定的输入,计算LLM对不同采样序列的置信度,构建DPS。 2. 近似决策边界 (K-DPS):通过有限次(K次)采样,近似计算DPS,得到K-DPS。 3. 误差分析:从理论上推导K-DPS与理想DPS之间的误差界限,包括绝对误差、期望误差和误差集中。 4. 实验验证:在不同的LLM和语料库上进行实验,验证K-DPS的有效性和误差界限。

关键创新:论文最重要的技术创新点在于提出了决策势面(DPS)的概念,并基于此设计了K-DPS算法。与直接计算决策边界的方法相比,DPS通过分析采样序列的置信度,将问题转化为一个更容易处理的形式。K-DPS算法通过有限次采样来近似DPS,从而在计算复杂度和精度之间取得了平衡。这种方法首次实现了在可接受的计算资源下,对LLM决策边界的有效近似。

关键设计:K-DPS算法的关键设计在于采样次数K的选择。理论分析表明,K越大,K-DPS对理想DPS的近似程度越高,误差越小。然而,K越大,计算成本也越高。因此,需要根据实际应用的需求,在计算复杂度和精度之间进行权衡。此外,论文还推导了误差的理论上界,为选择合适的K值提供了依据。具体的损失函数和网络结构取决于所使用的LLM,论文主要关注的是如何利用DPS来分析LLM的决策边界,而不是设计新的LLM结构。

🖼️ 关键图片

📊 实验亮点

论文通过实验验证了K-DPS算法的有效性。实验结果表明,K-DPS能够以较小的计算成本,有效地近似LLM的决策边界。通过设置不同的采样次数K,可以控制K-DPS的精度和计算复杂度。实验还验证了论文提出的误差界限的有效性,表明可以通过增加采样次数来降低误差。

🎯 应用场景

该研究成果可应用于提升LLM的可解释性和安全性。通过近似LLM的决策边界,可以更好地理解模型的决策过程,发现潜在的偏见和漏洞,从而提高模型的可靠性和公平性。此外,该方法还可以用于评估LLM对对抗性攻击的鲁棒性,并指导模型的防御策略。

📄 摘要(原文)

Decision boundary, the subspace of inputs where a machine learning model assigns equal classification probabilities to two classes, is pivotal in revealing core model properties and interpreting behaviors. While analyzing the decision boundary of large language models (LLMs) has raised increasing attention recently, constructing it for mainstream LLMs remains computationally infeasible due to the enormous vocabulary-sequence sizes and the auto-regressive nature of LLMs. To address this issue, in this paper we propose Decision Potential Surface (DPS), a new notion for analyzing LLM decision boundary. DPS is defined on the confidences in distinguishing different sampling sequences for each input, which naturally captures the potential of decision boundary. We prove that the zero-height isohypse in DPS is equivalent to the decision boundary of an LLM, with enclosed regions representing decision regions. By leveraging DPS, for the first time in the literature, we propose an approximate decision boundary construction algorithm, namely $K$-DPS, which only requires K-finite times of sequence sampling to approximate an LLM's decision boundary with negligible error. We theoretically derive the upper bounds for the absolute error, expected error, and the error concentration between K-DPS and the ideal DPS, demonstrating that such errors can be trade-off with sampling times. Our results are empirically validated by extensive experiments across various LLMs and corpora.