WirelessMathLM: Teaching Mathematical Reasoning for LLMs in Wireless Communications with Reinforcement Learning

作者: Xin Li, Mengbing Liu, Yiyang Zhu, Wenhe Zhang, Li Wei, Jiancheng An, Chau Yuen

分类: cs.LG

发布日期: 2025-09-27

备注: Project Homepage: https://lixin.ai/WirelessMathLM

💡 一句话要点

WirelessMathLM:利用强化学习提升LLM在无线通信中的数学推理能力

🎯 匹配领域: 支柱一:机器人控制 (Robot Control) 支柱二:RL算法与架构 (RL & Architecture) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 无线通信 大型语言模型 强化学习 数学推理 领域知识 可验证性 策略优化

📋 核心要点

- 现有LLM在无线通信等专业领域的数学推理能力不足,无法有效解决信息论、优化等问题。

- 利用无线通信数学问题可验证的特性,通过强化学习训练小型LLM,无需人工标注即可提升性能。

- 实验表明,该方法训练的7B模型性能接近GPT-4o,且在通用数学基准测试中表现出正向迁移。

📝 摘要(中文)

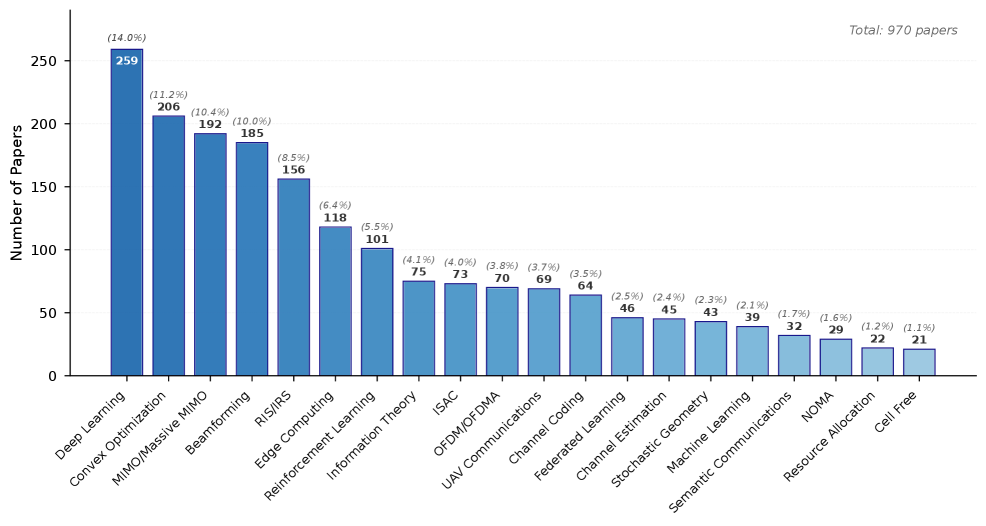

大型语言模型(LLM)擅长通用数学推理,但在专业技术数学方面表现不佳。在无线通信领域,问题需要精确处理信息论边界、优化约束和信号处理公式,即使是最先进的模型也难以胜任。我们提出了WirelessMathLM,证明了紧凑模型(0.5B-7B参数)可以通过领域特定的强化学习和可验证的奖励来匹配甚至超过更大的模型。我们的关键见解是,无线数学问题具有独特的属性——可验证的正确性——这使得无需人工反馈即可进行有效的强化学习。我们构建了WirelessMathBench-XL,这是一个包含来自970篇论文的4027个问题的综合基准。使用具有二元验证奖励的Group Relative Policy Optimization (GRPO),我们直接从基础检查点训练模型,而无需监督预热。我们的7B模型在WirelessMathBench-XL上实现了39.5%的准确率,接近GPT-4o (40.4%),同时使用的参数比DeepSeek-R1 (671B, 57.4%)少约100倍。值得注意的是,GRPO训练几乎使所有模型规模的性能翻倍(0.5B +11%, 3B +103%, 7B +81%),并且对通用数学基准产生了积极的迁移——我们的模型在MATH、Minerva-Math、OlympiadBench、AMC和AIME上平均获得了+8.4分,而没有在这些任务上进行任何训练。

🔬 方法详解

问题定义:现有的大型语言模型在通用数学推理方面表现出色,但在无线通信等专业领域的数学问题上表现不佳。这些问题通常涉及复杂的公式推导、优化约束和信息论边界,需要精确的数学操作。现有方法难以有效解决这些问题,主要痛点在于缺乏领域知识和训练数据。

核心思路:论文的核心思路是利用无线通信数学问题具有“可验证的正确性”这一独特属性,设计基于强化学习的训练方法。通过定义明确的奖励函数(例如,答案是否正确),可以无需人工标注,直接训练模型。这种方法能够有效地将领域知识融入到模型中,提升其在无线通信数学问题上的推理能力。

技术框架:整体框架包括以下几个主要步骤:1) 构建WirelessMathBench-XL数据集,包含大量无线通信领域的数学问题;2) 使用Group Relative Policy Optimization (GRPO)算法进行强化学习训练;3) 定义二元验证奖励,即答案正确则奖励为1,错误则为0;4) 从预训练的LLM检查点开始训练,无需监督预热。

关键创新:最重要的技术创新点在于利用了无线通信数学问题可验证的特性,实现了无需人工标注的强化学习训练。这与传统的监督学习方法不同,后者需要大量的人工标注数据。此外,GRPO算法能够有效地探索策略空间,提升模型的性能。

关键设计:关键设计包括:1) WirelessMathBench-XL数据集的构建,确保数据集的规模和质量;2) GRPO算法的参数设置,例如学习率、折扣因子等;3) 二元验证奖励的定义,确保奖励信号的准确性;4) 模型规模的选择,实验表明,7B模型在性能和效率之间取得了较好的平衡。

🖼️ 关键图片

📊 实验亮点

实验结果表明,使用GRPO训练的7B模型在WirelessMathBench-XL上达到了39.5%的准确率,接近GPT-4o (40.4%),同时使用的参数比DeepSeek-R1 (671B, 57.4%)少约100倍。GRPO训练使所有模型规模的性能显著提升(0.5B +11%, 3B +103%, 7B +81%),并且在通用数学基准测试中获得了平均+8.4分的提升。

🎯 应用场景

该研究成果可应用于无线通信系统的设计、优化和性能分析。例如,可以利用训练好的模型自动推导信道容量公式、优化资源分配策略、分析信号处理算法的性能。此外,该方法还可以推广到其他具有可验证正确性的专业领域,例如控制理论、电路设计等。

📄 摘要(原文)

Large language models (LLMs) excel at general mathematical reasoning but fail catastrophically on specialized technical mathematics. In wireless communications, where problems require precise manipulation of information-theoretic bounds, optimization constraints, and signal processing formulations, even state-of-the-art models struggle to achieve competent performance. We present WirelessMathLM, demonstrating that compact models (0.5B-7B parameters) can match or exceed much larger models through domain-specific reinforcement learning with verifiable rewards. Our key insight is that wireless mathematics problems possess a unique property--verifiable correctness--that enables effective reinforcement learning without human feedback. We construct WirelessMathBench-XL, a comprehensive benchmark of 4,027 problems from 970 papers. Using Group Relative Policy Optimization (GRPO) with binary verification rewards, we train models directly from base checkpoints without supervised warm-start. Our 7B model achieves 39.5% accuracy on WirelessMathBench-XL, approaching GPT-4o (40.4%) while using about 100 times fewer parameters than DeepSeek-R1 (671B, 57.4%). Remarkably, GRPO training nearly doubles performance across all model scales (0.5B +11%, 3B +103%, 7B +81%), with positive transfer to general mathematics benchmarks--our models gain +8.4 points on average across MATH, Minerva-Math, OlympiadBench, AMC, and AIME without any training on these tasks.