RHYTHM: Reasoning with Hierarchical Temporal Tokenization for Human Mobility

作者: Haoyu He, Haozheng Luo, Yan Chen, Qi R. Wang

分类: cs.LG, cs.AI, cs.CL

发布日期: 2025-09-27 (更新: 2025-10-20)

备注: Advances in Neural Information Processing Systems 39 (NeurIPS) 2025

🔗 代码/项目: GITHUB

💡 一句话要点

RHYTHM:利用分层时间令牌化推理人类移动性,提升预测精度和效率。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 人类移动性预测 大型语言模型 时间令牌化 分层注意力 轨迹预测

📋 核心要点

- 人类移动性预测面临长程依赖和多尺度周期行为的挑战,现有方法难以有效建模。

- RHYTHM通过分层时间令牌化,将轨迹分割成离散令牌,并利用分层注意力捕获周期性依赖,降低计算复杂度。

- 实验表明,RHYTHM在准确率上有所提升,尤其是在周末,同时显著降低了训练时间。

📝 摘要(中文)

本文提出RHYTHM(基于分层时间令牌化推理的人类移动性预测),一个统一的框架,利用大型语言模型(LLMs)作为通用的时空预测器和轨迹推理器。RHYTHM采用时间令牌化将每个轨迹分割成每日片段,并将其编码为离散令牌,通过分层注意力机制捕获每日和每周的依赖关系,从而在保留周期性信息的同时,二次方地减少序列长度。此外,通过冻结的LLM,为轨迹片段和预测目标添加预计算的提示嵌入,丰富令牌表示,并将这些组合嵌入反馈到LLM主干中,以捕获复杂的相互依赖关系。在计算方面,RHYTHM保持预训练的LLM主干冻结,从而加快训练速度并降低内存使用。在三个真实世界数据集上,RHYTHM的性能优于现有方法。值得注意的是,RHYTHM在总体准确率上提高了2.4%,在周末提高了5.0%,训练时间减少了24.6%。代码已公开。

🔬 方法详解

问题定义:人类移动性预测旨在预测个体在未来一段时间内的位置。现有方法通常难以捕捉轨迹中的长程依赖关系和多尺度周期性行为,导致预测精度不高,计算复杂度也较高。

核心思路:RHYTHM的核心思路是将轨迹数据进行时间令牌化,把连续的轨迹数据转化为离散的令牌序列,然后利用大型语言模型(LLMs)强大的建模能力进行预测。通过分层注意力机制,模型能够有效地捕捉轨迹中的周期性模式和长程依赖关系。

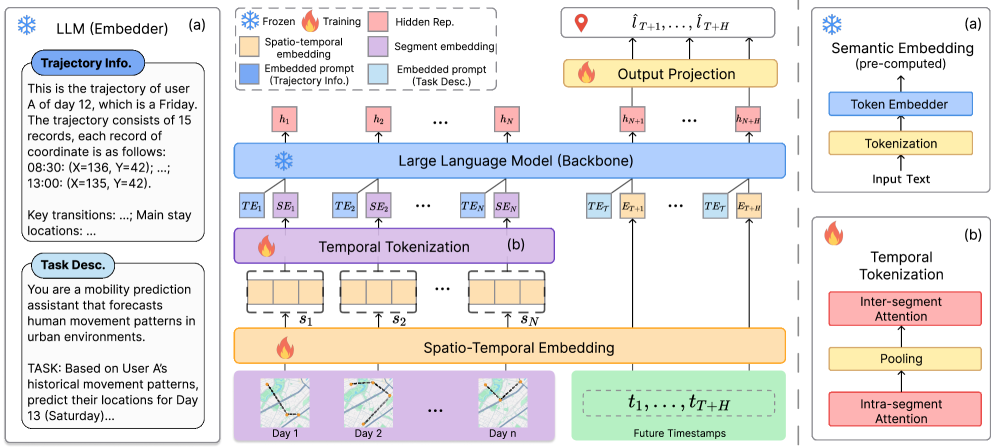

技术框架:RHYTHM的整体框架包括以下几个主要模块:1) 时间令牌化:将轨迹分割成每日片段,并编码为离散令牌。2) 提示嵌入:利用预训练的LLM为轨迹片段和预测目标生成提示嵌入,丰富令牌表示。3) 分层注意力:利用分层注意力机制捕获每日和每周的依赖关系。4) LLM主干:将组合嵌入输入到冻结的LLM主干中,进行预测。

关键创新:RHYTHM的关键创新在于:1) 提出了分层时间令牌化方法,有效地降低了序列长度,同时保留了周期性信息。2) 利用预训练的LLM生成提示嵌入,丰富了令牌表示,提高了预测精度。3) 冻结LLM主干,显著降低了训练时间和内存使用。

关键设计:RHYTHM的关键设计包括:1) 时间令牌化的粒度选择(每日片段)。2) 分层注意力的层数和注意力头的数量。3) 提示嵌入的生成方式和维度。4) LLM主干的选择和冻结策略。损失函数采用交叉熵损失,优化器采用AdamW。

🖼️ 关键图片

📊 实验亮点

RHYTHM在三个真实世界数据集上进行了评估,结果表明,RHYTHM在总体准确率上提高了2.4%,在周末提高了5.0%,训练时间减少了24.6%。这些结果表明,RHYTHM能够有效地提高人类移动性预测的精度和效率。

🎯 应用场景

RHYTHM可应用于城市规划、交通管理、公共安全等领域。例如,可以利用RHYTHM预测城市人流分布,优化交通路线规划,提前预警潜在的安全风险。该研究有助于提升城市管理的智能化水平,为人们的出行提供更便捷、安全的保障。

📄 摘要(原文)

Predicting human mobility is inherently challenging due to complex long-range dependencies and multi-scale periodic behaviors. To address this, we introduce RHYTHM (Reasoning with Hierarchical Temporal Tokenization for Human Mobility), a unified framework that leverages large language models (LLMs) as general-purpose spatio-temporal predictors and trajectory reasoners. Methodologically, RHYTHM employs temporal tokenization to partition each trajectory into daily segments and encode them as discrete tokens with hierarchical attention that captures both daily and weekly dependencies, thereby quadratically reducing the sequence length while preserving cyclical information. Additionally, we enrich token representations by adding pre-computed prompt embeddings for trajectory segments and prediction targets via a frozen LLM, and feeding these combined embeddings back into the LLM backbone to capture complex interdependencies. Computationally, RHYTHM keeps the pretrained LLM backbone frozen, yielding faster training and lower memory usage. We evaluate our model against state-of-the-art methods using three real-world datasets. Notably, RHYTHM achieves a 2.4% improvement in overall accuracy, a 5.0% increase on weekends, and a 24.6% reduction in training time. Code is publicly available at https://github.com/he-h/rhythm.